فيما يلي قائمة منسقة من الأوراق حول المهام ذات الصلة ثلاثية الأبعاد التي يتم تمكينها بواسطة نماذج اللغة الكبيرة (LLMS). أنه يحتوي على مهام مختلفة بما في ذلك الفهم ثلاثي الأبعاد والتفكير والتوليد والعوامل المجسدة. أيضًا ، نقوم بتضمين نماذج الأساس الأخرى (مقطع ، SAM) للصورة الكاملة لهذه المنطقة.

هذا مستودع نشط ، يمكنك مراقبة اتباع أحدث التطورات. إذا وجدت أنها مفيدة ، فيرجى تفضل ببطولة هذا الريبو واستشهد بالورقة.

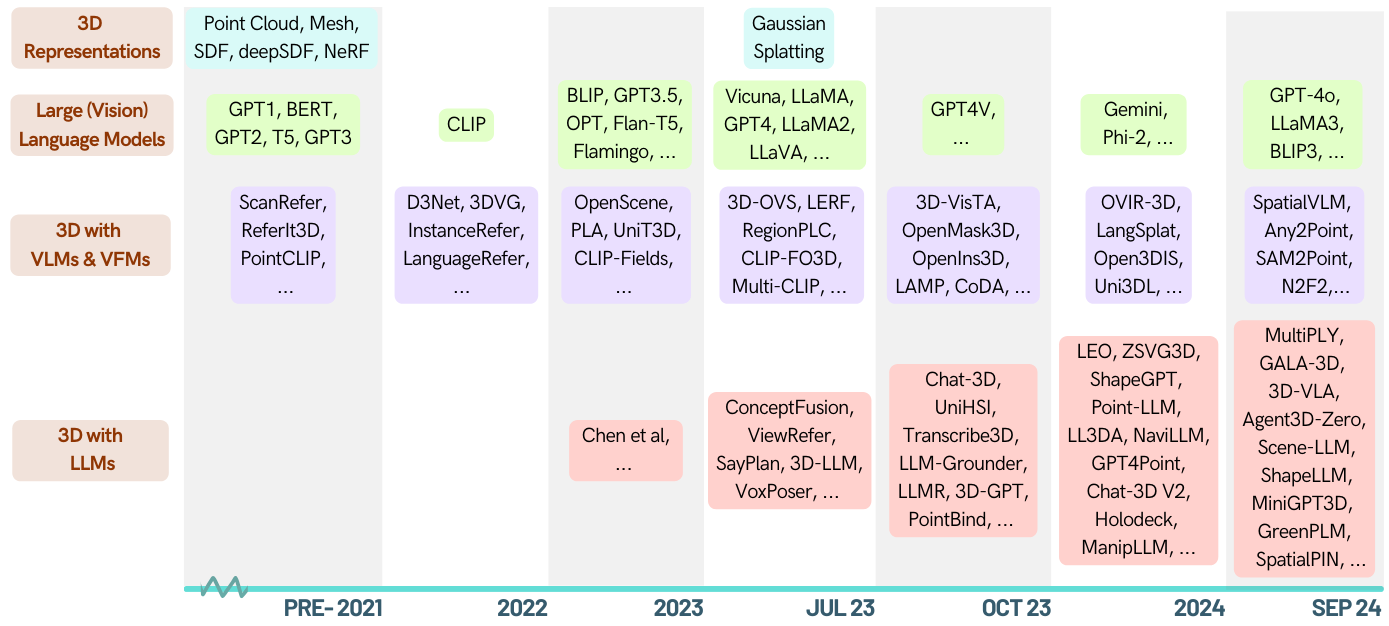

[2024-05-16]؟ تحقق من ورقة المسح الأولى في مجال 3D-LLM: عندما تدخل LLMS إلى العالم ثلاثي الأبعاد: مسح وتحليل تلوي للمهام ثلاثية الأبعاد عبر نماذج لغة كبيرة متعددة الوسائط

[2024-01-06] أضاف Runsen Xu معلومات زمنية ، وأعادت Xianzheng MA تنظيمها بترتيب ZA لتحسين أحدث التطورات.

[2023-12-16] قام Xianzheng MA و Yash Bhalgat برعاية هذه القائمة ونشروا الإصدار الأول ؛

رهيبة-LLM-3D

فهم ثلاثي الأبعاد (LLM)

فهم ثلاثي الأبعاد (نماذج مؤسسة أخرى)

التفكير ثلاثي الأبعاد

الجيل ثلاثي الأبعاد

3D عميل مجسد

المعايير ثلاثية الأبعاد

المساهمة

| تاريخ | الكلمات الرئيسية | المعهد (الأول) | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2024-10-12 | الموقف 3D | UIUC | يهم الوعي الظرفي في منطق لغة الرؤية ثلاثية الأبعاد | CVPR '24 | مشروع |

| 2024-09-28 | llava-3d | هوكو | LLAVA-3D: طريق بسيط ولكنه فعال لتمكين LMMS مع الوعي ثلاثي الأبعاد | arxiv | مشروع |

| 2024-09-08 | MSR3D | بيغاي | التفكير متعدد الوسائط في المشاهد ثلاثية الأبعاد | Neupips '24 | مشروع |

| 2024-08-28 | Greenplm | صاخبة | المزيد من النص ، نقطة أقل: نحو فهم النقطات ثلاثية الأبعاد الموفرة للبيانات | arxiv | جيثب |

| 2024-06-17 | لانا | يونيبو | Llana: لغة كبيرة ومساعد NERF | Neupips '24 | مشروع |

| 2024-06-07 | مكاني | أكسفورد | spatialpin: تعزيز قدرات التفكير المكاني لنماذج لغة الرؤية من خلال دفع وتفاعل ثلاثية الأبعاد | Neupips '24 | مشروع |

| 2024-06-03 | spatialrgpt | UCSD | SpatialRgpt: التفكير المكاني في نماذج لغة الرؤية | Neupips '24 | جيثب |

| 2024-05-02 | minigpt-3d | صاخبة | MINIGPT-3D: محاذاة السحب ثلاثية الأبعاد بكفاءة مع نماذج لغة كبيرة باستخدام priors ثنائية الأبعاد | ACM MM '24 | مشروع |

| 2024-02-27 | Shapellm | xjtu | Shapellm: فهم الكائنات ثلاثية الأبعاد الشاملة للتفاعل المجسد | arxiv | مشروع |

| 2024-01-22 | spatialvlm | Google DeepMind | spatialvlm: منح نماذج باللغة الرؤية مع قدرات التفكير المكاني | CVPR '24 | مشروع |

| 2023-12-21 | LIDAR-LLM | PKU | LIDAR-LLM: استكشاف إمكانات نماذج اللغة الكبيرة لفهم LiDAR ثلاثي الأبعاد | arxiv | مشروع |

| 2023-12-15 | 3DAP | مختبر شنغهاي منظمة العفو الدولية | 3Daxiespromps: إطلاق العنان لقدرات المهام المكانية ثلاثية الأبعاد لـ GPT-4V | arxiv | مشروع |

| 2023-12-13 | محادثة الدردشة | زجو | مشهد الدردشة: سد المشهد ثلاثي الأبعاد ونماذج لغة كبيرة مع معرفات الكائنات | Neupips '24 | جيثب |

| 2023-12-5 | GPT4POINT | هوكو | GPT4POINT: إطار موحد لفهم وتوليد لغة النقاط | arxiv | جيثب |

| 2023-11-30 | LL3DA | جامعة فودان | LL3DA: ضبط التعليمات التفاعلية المرئية لفهم OMNI-3D والمنطق والتخطيط | arxiv | جيثب |

| 2023-11-26 | ZSVG3D | Cuhk (SZ) | البرمجة البصرية للأساس البصري ثلاثي الأبعاد | arxiv | مشروع |

| 2023-11-18 | ليو | بيغاي | عميل عام مجسد في العالم ثلاثي الأبعاد | arxiv | جيثب |

| 2023-10-14 | JM3D-LLM | جامعة شيامن | JM3D & JM3D-LLM: رفع التمثيل ثلاثي الأبعاد مع إشارات متعددة الوسائط مشتركة | ACM MM '23 | جيثب |

| 2023-10-10 | UNI3D | باي | UNI3D: استكشاف تمثيل ثلاثي الأبعاد موحد على نطاق واسع | ICLR '24 | مشروع |

| 2023-9-27 | - | Kaust | مراسلات الشكل ثلاثية الأبعاد صفر | SIGGRAPH ASIA '23 | - |

| 2023-9-21 | LLM-GROUNTER | U-Mich | LLM-Grounder: Open-Vocabulary 3D Visual Boose مع نموذج لغة كبير كعامل | ICRA '24 | جيثب |

| 2023-9-1 | نقاط | cuhk | Point-Bind & Point-LLM: محاذاة Cloud Point مع متعدد الوسائط لفهم ثلاثي الأبعاد وتوليد وتعليمات متابعة | arxiv | جيثب |

| 2023-8-31 | pointllm | cuhk | Pointllm: تمكين نماذج اللغة الكبيرة لفهم السحب النقطية | ECCV '24 | جيثب |

| 2023-8-17 | Chat-3D | زجو | chat-3d: ضبط نموذج لغة كبيرة بشكل فعال للحوار الشامل للمشاهد ثلاثية الأبعاد | arxiv | جيثب |

| 2023-8-8 | 3D-Vista | بيغاي | 3D-Vista: محول تدريب مسبقًا للرؤية ثلاثية الأبعاد ومحاذاة النص | ICCV '23 | جيثب |

| 2023-7-24 | 3D-LLM | UCLA | 3D-LLM: حقن العالم ثلاثي الأبعاد في نماذج لغة كبيرة | Neupips '23 | جيثب |

| 2023-3-29 | ViewRefer | cuhk | ViewRefer: فهم المعرفة متعددة الرؤية للتأريض البصري ثلاثي الأبعاد | ICCV '23 | جيثب |

| 2022-9-12 | - | معهد ماساتشوستس للتكنولوجيا | الاستفادة من نماذج اللغة الكبيرة (البصرية) لفهم المشهد ثلاثي الأبعاد الروبوت | arxiv | جيثب |

| بطاقة تعريف | الكلمات الرئيسية | المعهد (الأول) | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2024-10-12 | المعجم | UIUC | معجم 3: تحقيق نماذج الأساس البصري لفهم المشهد ثلاثي الأبعاد المعقد | Neupips '24 | مشروع |

| 2024-10-07 | Diff2scene | CMU | التجزئة الدلالية ثلاثية الأبعاد المفتوحة مع نماذج نشر النص إلى صورة | ECCV 2024 | مشروع |

| 2024-04-07 | any2point | مختبر شنغهاي منظمة العفو الدولية | any2point: تمكين أي نماذج كبيرة من الفهم ثلاثي الأبعاد فعال | ECCV 2024 | جيثب |

| 2024-03-16 | N2F2 | أوكسفورد-فيج | N2F2: فهم المشهد الهرمي مع حقول الميزات العصبية المتداخلة | arxiv | - |

| 2023-12-17 | SAI3D | PKU | SAI3D: قطاع أي مثيل في مشاهد ثلاثية الأبعاد | arxiv | مشروع |

| 2023-12-17 | Open3dis | فينا | Open3Dis: تجزئة مثيل ثلاثي الأبعاد المفتوح مع إرشادات القناع ثنائي الأبعاد | arxiv | مشروع |

| 2023-11-6 | OVIR-3D | جامعة روتجرز | OVIR-3D: استرجاع مثيل ثلاثي الأبعاد المفتوح بدون تدريب على البيانات ثلاثية الأبعاد | كورل 23 | جيثب |

| 2023-10-29 | OpenMask3d | إيث | OpenMask3d: تجزئة مثيل 3D المفتوح | Neupips '23 | مشروع |

| 2023-10-5 | الانصهار المفتوح | - | الانصهار المفتوح: في الوقت الفعلي ، رسم خرائط ثلاثي الأبعاد المفتوح ، تمثيل المشهد القابل للاستعلام | arxiv | جيثب |

| 2023-9-22 | OV-3DDET | هكست | CODA: اكتشاف مربع رواية تعاونية ومحاذاة عرضية للكشف عن الكائنات ثلاثية الأبعاد المفتوحة | Neupips '23 | جيثب |

| 2023-9-19 | خروف | - | من اللغة إلى العوالم ثلاثية الأبعاد: تكييف نموذج اللغة لتصور السحابة النقطة | OpenReview | - |

| 2023-9-15 | Opennerf | - | Opennerf: قم بتجزئة المشهد العصبي ثلاثي الأبعاد المفتوح مع ميزات البكسل والمنظرات الجديدة المقدمة | OpenReview | جيثب |

| 2023-9-1 | OpenIns3d | كامبريدج | OpenIns3d: Snap and Skionup لتجزئة مثيلات الفتحة المفتوحة ثلاثية الأبعاد | arxiv | مشروع |

| 2023-6-7 | رفع التباين | أوكسفورد-فيج | رفع التباين: تجزئة مثيل الكائن ثلاثي الأبعاد عن طريق الانصهار البطيء التباين | Neupips '23 | جيثب |

| 2023-6-4 | متعددة | إيث | متعددة المقدمة: التدريب المسبق للنبات المسبق للأسئلة في الإجابة على المهام في المشاهد ثلاثية الأبعاد | arxiv | - |

| 2023-5-23 | 3D-OVS | NTU | تجزئة عرض ثلاثية الأبعاد عرضة للإشراف 3D بشكل ضعيف | Neupips '23 | جيثب |

| 2023-5-21 | حقول VL | جامعة أدنبرة | حقول VL: نحو التمثيلات المكانية الضمنية المورقة باللغة | ICRA '23 | مشروع |

| 2023-5-8 | مقطع FO3D | جامعة تسينغهوا | Clip-FO3D: تعلم تمثيل مجاني للمشهد ثلاثي الأبعاد مفتوح العالم من مقطع كثيف ثنائي الأبعاد | ICCVW '23 | - |

| 2023-4-12 | 3D-VQA | إيث | التدريب المسبق للمشبك قبل التدريب على الإجابة على الأسئلة في المشاهد ثلاثية الأبعاد | CVPRW '23 | جيثب |

| 2023-4-3 | regionplc | هوكو | RegionPLC: التعلم التباين الإقليمي للنقاط لفهم المشهد ثلاثي الأبعاد في العالم المفتوح | arxiv | مشروع |

| 2023-3-20 | CG3D | جو | Clip Goes 3D: الاستفادة من الضبط السريع للغة التعرف ثلاثي الأبعاد | arxiv | جيثب |

| 2023-3-16 | ليرف | UC Berkeley | ليرف: حقول الإشعاع المدمجة اللغة | ICCV '23 | جيثب |

| 2023-2-14 | مفهوم | معهد ماساتشوستس للتكنولوجيا | المفهوم: رسم الخرائط ثلاثية الأبعاد متعددة الوسائط مفتوحة | RSS '23 | مشروع |

| 2023-1-12 | Clip2Scene | هوكو | Clip2Scene: نحو فهم مشهد ثلاثي الأبعاد فعال من خلال المقطع | CVPR '23 | جيثب |

| 2022-12-1 | UNIT3D | توم | UNIT3D: محول موحد للتسمية الكثيفة ثلاثية الأبعاد والأرض البصري | ICCV '23 | جيثب |

| 2022-11-29 | جيش التحرير الشعبى الصينى | هوكو | جيش التحرير الشعبى الصينى: فهم المشهد ثلاثي الأبعاد المُعتمد على اللغة | CVPR '23 | جيثب |

| 2022-11-28 | Openscene | إيثز | Openscene: فهم المشهد ثلاثي الأبعاد مع المفردات المفتوحة | CVPR '23 | جيثب |

| 2022-10-11 | حقول القصاصات | نيويورك | حقول المقطع: حقول دلالية خاضعة للإشراف بشكل ضعيف للذاكرة الآلية | arxiv | مشروع |

| 2022-7-23 | التجريد الدلالي | كولومبيا | التجريد الدلالي: فهم مشهد ثلاثي الأبعاد في العالم المفتوح من نماذج لغة الرؤية ثنائية الأبعاد | كورل '22 | مشروع |

| 2022-4-26 | Scannet200 | توم | تجزئة دلالية ثلاثية الأبعاد ذات الأرضية الداخلية في البرية | ECCV '22 | مشروع |

| تاريخ | الكلمات الرئيسية | المعهد (الأول) | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2023-5-20 | 3D-Clr | UCLA | ثلاثية الأبعاد التعلم والتفكير من صور متعددة الرؤية | CVPR '23 | جيثب |

| - | TESSCRINCE3D | TTI ، شيكاغو | SESSCRINCE3D: Grounding LLMS باستخدام المعلومات المكتوبة للتفكير ثلاثي الأبعاد مع التكاليف المصححة ذاتيا | كورل 23 | جيثب |

| تاريخ | الكلمات الرئيسية | معهد | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2023-11-29 | شكل | جامعة فودان | الشكل: توليد الشكل ثلاثي الأبعاد مع نموذج لغة متعددة الوسائط موحدة | arxiv | جيثب |

| 2023-11-27 | meshgpt | توم | meshgpt: توليد شبكات مثلث مع محولات فك التشفير فقط | arxiv | مشروع |

| 2023-10-19 | 3D-GPT | آنو | 3D-GPT: النمذجة ثلاثية الأبعاد الإجرائية مع نماذج لغة كبيرة | arxiv | جيثب |

| 2023-9-21 | llmr | معهد ماساتشوستس للتكنولوجيا | LLMR: في الوقت الفعلي ، فإن المطالبة بالعوالم التفاعلية باستخدام نماذج لغة كبيرة | arxiv | - |

| 2023-9-20 | Dreamllm | Megvii | Dreamllm: الفهم والخلق متعدد الوسائط التآزرية | arxiv | جيثب |

| 2023-4-1 | Chatavatar | Meemos Tech | Dreamface: الجيل التدريجي من الوجوه ثلاثية الأبعاد القابلة للرسوم تحت توجيه النص | ACM TOG | موقع إلكتروني |

| تاريخ | الكلمات الرئيسية | معهد | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2024-01-22 | spatialvlm | DeepMind | spatialvlm: منح نماذج باللغة الرؤية مع قدرات التفكير المكاني | CVPR '24 | مشروع |

| 2023-11-27 | Dobb-e | نيويورك | على جلب الروبوتات إلى المنزل | arxiv | جيثب |

| 2023-11-26 | ستيف | زجو | انظر وفكر: وكيل تجسد في البيئة الافتراضية | arxiv | جيثب |

| 2023-11-18 | ليو | بيغاي | عميل عام مجسد في العالم ثلاثي الأبعاد | arxiv | جيثب |

| 2023-9-14 | unihsi | مختبر شنغهاي منظمة العفو الدولية | تفاعل موحد للمشهد البشري عن طريق سلسلة الاتصالات المدعومة | arxiv | جيثب |

| 2023-7-28 | RT-2 | Google-Deepmind | RT-2: نقل نماذج الحركة التي تعمل باللغة الرؤية معرفة الويب إلى التحكم الآلي | arxiv | جيثب |

| 2023-7-12 | يقول | مركز QUT للروبوتات | Sayplan: تأريض نماذج لغة كبيرة باستخدام الرسوم البيانية للمشهد ثلاثي الأبعاد للتخطيط لمهمة الروبوت القابل للتطوير | كورل 23 | جيثب |

| 2023-7-12 | voxposer | ستانفورد | Voxposer: خرائط القيمة ثلاثية الأبعاد قابلة للتكوين للمعالجة الآلية مع نماذج اللغة | arxiv | جيثب |

| 2022-12-13 | RT-1 | جوجل | RT-1: محول الروبوتات للتحكم في العالم الحقيقي على نطاق واسع | arxiv | جيثب |

| 2022-12-8 | LLM-Planner | جامعة ولاية أوهايو | LLM-Planner: تخطيط قليلة على الأرض للعوامل المجسدة مع نماذج لغة كبيرة | ICCV '23 | جيثب |

| 2022-10-11 | حقول القصاصات | جامعة نيويورك ، ميتا | حقول المقطع: حقول دلالية خاضعة للإشراف بشكل ضعيف للذاكرة الآلية | RSS '23 | جيثب |

| 2022-09-20 | nlmap-saycan | جوجل | تمثيل مشهد استعلام المفتوح المفتوح للتخطيط في العالم الحقيقي | ICRA '23 | جيثب |

| تاريخ | الكلمات الرئيسية | معهد | ورق | النشر | آحرون |

|---|---|---|---|---|---|

| 2024-09-08 | MSQA / MSNN | بيغاي | التفكير متعدد الوسائط في المشاهد ثلاثية الأبعاد | Neupips '24 | مشروع |

| 2024-06-10 | 3D-Grand / 3D-Pope | أميتش | أحفاد ثلاثي الأبعاد: مجموعة بيانات على نطاق مليون لصالح 3D-LLMs مع أسس أفضل وأقل الهلوسة | arxiv | مشروع |

| 2024-06-03 | مكفيات مقاعد البنية | UCSD | SpatialRgpt: التفكير المكاني في نماذج لغة الرؤية | Neupips '24 | جيثب |

| 2024-1-18 | Sconeverse | بيغاي | Sconeverse: توسيع نطاق التعلم باللغة ثلاثية الأبعاد لفهم المشهد الأسس | arxiv | جيثب |

| 2023-12-26 | تجسيد | مختبر شنغهاي منظمة العفو الدولية | تجسيد: جناح إدراك ثلاثي الأبعاد متعدد الوسائط شامل نحو تجسد الذكاء الاصطناعي | arxiv | جيثب |

| 2023-12-17 | M3dbench | جامعة فودان | M3Dbench: دعنا نوجه نماذج كبيرة مع مطالبات ثلاثية الأبعاد متعددة الوسائط | arxiv | جيثب |

| 2023-11-29 | - | DeepMind | تقييم VLMs لشرح التعليقات المتعددة المستندة إلى الدرجات من الكائنات ثلاثية الأبعاد | arxiv | جيثب |

| 2023-09-14 | crosscoherence | يونيبو | بالنظر إلى الكلمات والنقاط مع الاهتمام: معيار للتماسك النص إلى الشكل | ICCV '23 | جيثب |

| 2022-10-14 | SQA3D | بيغاي | SQA3D: أسئلة تقع تجيب في مشاهد ثلاثية الأبعاد | ICLR '23 | جيثب |

| 2021-12-20 | Scanqa | Riken AIP | Scanqa: الإجابة على أسئلة ثلاثية الأبعاد عن فهم المشهد المكاني | CVPR '23 | جيثب |

| 2020-12-3 | Scan2Cap | توم | Scan2Cap: التسمية التوضيحية الكثيفة المدركة للسياق في عمليات مسح RGB-D | CVPR '21 | جيثب |

| 2020-8-23 | المرجع | ستانفورد | المرجع 3: المستمعون العصبيون لتحديد الكائنات ثلاثية الأبعاد الدقيقة في مشاهد العالم الحقيقي | ECCV '20 | جيثب |

| 2019-12-18 | المسح الضوئي | توم | ScanRefer: توطين الكائنات ثلاثية الأبعاد في عمليات مسح RGB-D باستخدام اللغة الطبيعية | ECCV '20 | جيثب |

مساهماتك دائما موضع ترحيب!

سأحتفظ ببعض طلبات السحب مفتوحة إذا لم أكن متأكدًا مما إذا كانت رائعة بالنسبة إلى 3D LLMS ، يمكنك التصويت لصالحهم عن طريق الإضافة؟ لهم.

إذا كان لديك أي أسئلة حول هذه القائمة التي تم الرأي ، فيرجى الاتصال على [email protected] أو معرف WeChat: MXZ1997112.

إذا وجدت هذا المستودع مفيدًا ، فيرجى التفكير في الاستشهاد بهذه الورقة:

@misc{ma2024llmsstep3dworld,

title={When LLMs step into the 3D World: A Survey and Meta-Analysis of 3D Tasks via Multi-modal Large Language Models},

author={Xianzheng Ma and Yash Bhalgat and Brandon Smart and Shuai Chen and Xinghui Li and Jian Ding and Jindong Gu and Dave Zhenyu Chen and Songyou Peng and Jia-Wang Bian and Philip H Torr and Marc Pollefeys and Matthias Nießner and Ian D Reid and Angel X. Chang and Iro Laina and Victor Adrian Prisacariu},

year={2024},

journal={arXiv preprint arXiv:2405.10255},

}هذا الريبو مستوحى من رهيبة