علم محرر Downcodes أن فريق Tongyi Qianwen قد فتح مؤخرًا أحدث سلسلة كاملة من نماذج Qwen2.5-Coder، وهو ما يمثل علامة فارقة أخرى في مجال النماذج الكبيرة مفتوحة المصدر. لقد جذبت نماذج سلسلة Qwen2.5-Coder الكثير من الاهتمام نظرًا لقدراتها البرمجية القوية ووظائفها المتنوعة وعمليتها المريحة، وقد أظهرت أداءً ممتازًا في إنشاء التعليمات البرمجية والإصلاح والاستدلال، مما يوفر للمطورين أدوات قوية لتعزيز التطوير الإضافي للتعليمات البرمجية المفتوحة ماجستير في القانون. سيعمل المصدر المفتوح لهذه السلسلة من النماذج على تعزيز تطبيق وابتكار تكنولوجيا الذكاء الاصطناعي في مجال البرمجة بشكل كبير.

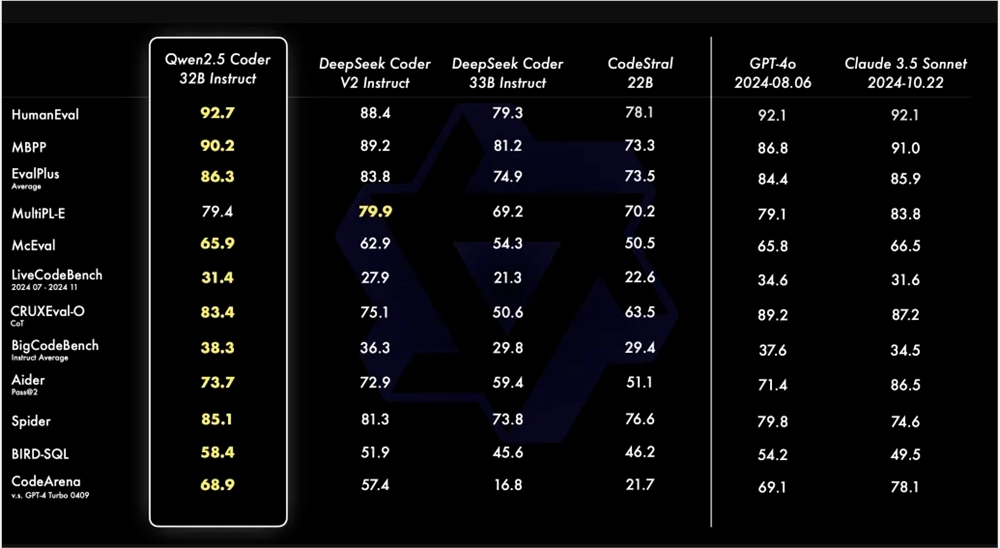

أعلن فريق Tongyi Qianwen مؤخرًا أنه سيفتح المصدر لأحدث سلسلة Qwen2.5-Coder. وتهدف هذه الخطوة إلى تعزيز تطوير Open Code LLMs. لقد اجتذب Qwen2.5-Coder الانتباه لقوته وتنوعه وعمليته. وصل نموذج Qwen2.5-Coder-32B-Instruct إلى مستوى SOTA من حيث إمكانات التعليمات البرمجية، وهو ما يعادل GPT-4o، مما يُظهر إمكانات شاملة، بما في ذلك إنشاء التعليمات البرمجية وإصلاح التعليمات البرمجية واستدلال التعليمات البرمجية. إنه يحقق أعلى أداء في معايير إنشاء التعليمات البرمجية المتعددة ويحقق درجة 73.7 على معيار Aider، وهو ما يشبه GPT-4o.

يدعم Qwen2.5-Coder أكثر من 40 لغة برمجة وسجل 65.9 نقطة على McEval، مع أداء لغات مثل Haskell وRacket بشكل جيد. ويرجع ذلك إلى تنظيف البيانات ومطابقتها الفريدة في مرحلة ما قبل التدريب. بالإضافة إلى ذلك، يقدم Qwen2.5-Coder-32B-Instruct أداءً جيدًا أيضًا في إمكانيات إصلاح التعليمات البرمجية في لغات برمجة متعددة، حيث سجل 75.2 في معيار MdEval، ليحتل المرتبة الأولى.

من أجل اختبار أداء محاذاة Qwen2.5-Coder-32B-Instruct على التفضيلات البشرية، تم إنشاء Code Arena المعياري لتقييم تفضيلات التعليمات البرمجية المشروحة داخليًا. تظهر النتائج أن Qwen2.5-Coder-32B-Instruct له مزايا في المحاذاة المفضلة.

تحتوي سلسلة Qwen2.5-Coder على نماذج مفتوحة المصدر بأربعة أحجام هذه المرة، بما في ذلك 0.5B/3B/14B/32B، والتي تغطي أحجام النماذج الستة الرئيسية لتلبية احتياجات المطورين المختلفين. يقدم المسؤول نموذجين: Base وInstruct، الأول بمثابة الأساس للمطورين لضبط النموذج، والثاني بمثابة نموذج الدردشة المتوافق رسميًا. هناك علاقة إيجابية بين حجم النموذج والأداء، ويحقق Qwen2.5-Coder أداء SOTA في جميع الأحجام.

يعتمد الطراز 0.5B/1.5B/7B/14B/32B من Qwen2.5-Coder ترخيص Apache2.0، في حين أن النموذج 3B مرخص للأبحاث فقط. تحقق الفريق من فعالية Scaling on Code LLMs من خلال تقييم أداء Qwen2.5-Coder بأحجام مختلفة في جميع مجموعات البيانات.

يوفر المصدر المفتوح لـ Qwen2.5-Coder للمطورين خيارًا قويًا ومتنوعًا وعمليًا لنماذج البرمجة، مما يساعد على تعزيز تطوير نماذج لغات البرمجة وتطبيقها.

رابط نموذج Qwen2.5-Coder:

https://modelscope.cn/collections/Qwen25-Coder-9d375446e8f5814a

باختصار، يوفر المصدر المفتوح لـ Qwen2.5-Coder أداة قوية للمطورين، وسيؤدي أدائها الممتاز وإمكانية تطبيقها على نطاق واسع إلى تعزيز تطوير مجال إنشاء الأكواد والبرمجة بشكل كبير. ونحن نتطلع إلى أن يتمكن Qwen2.5-Coder من لعب دور في المزيد من سيناريوهات التطبيق في المستقبل.