كشفت دراسة جديدة أجراها معهد ماساتشوستس للتكنولوجيا (MIT) عن أوجه تشابه مذهلة بين البنية الداخلية لنماذج اللغات الكبيرة (LLMs) والدماغ البشري، مما أثار جدلاً ساخنًا في مجال الذكاء الاصطناعي. سيشرح محرر Downcodes بالتفصيل النتائج الرائعة لهذا البحث وأهميته بالنسبة للتطور المستقبلي للذكاء الاصطناعي. من خلال التحليل المتعمق لمساحة تنشيط LLM، اكتشف الباحثون ميزات هيكلية ثلاثية المستويات سيساعدنا اكتشاف هذه الميزات على فهم آلية عمل LLM بشكل أفضل وتوفير اتجاهات جديدة لتطوير تكنولوجيا الذكاء الاصطناعي المستقبلية.

لقد بدأ الذكاء الاصطناعي بالفعل في "تنمية الدماغ"؟! أظهر أحدث بحث من معهد ماساتشوستس للتكنولوجيا أن البنية الداخلية لنموذج اللغة الكبير (LLM) تشبه بشكل مدهش الدماغ البشري!

استخدمت هذه الدراسة تقنية التشفير التلقائي المتفرقة لإجراء تحليل متعمق لمساحة التنشيط في LLM واكتشفت ثلاثة مستويات من الميزات الهيكلية المذهلة:

أولاً، على المستوى المجهري، اكتشف الباحثون وجود هياكل شبيهة "بلورية". تتكون وجوه هذه "البلورات" من متوازيات الأضلاع أو شبه منحرف، تشبه تشبيهات الكلمات المألوفة، مثل "رجل:امرأة::ملك:ملكة".

والأمر الأكثر إثارة للدهشة هو أن هذه الهياكل "البلورية" تصبح أكثر وضوحًا بعد إزالة بعض عوامل التداخل غير ذات الصلة (مثل طول الكلمة) من خلال تقنيات التحليل التمييزي الخطي.

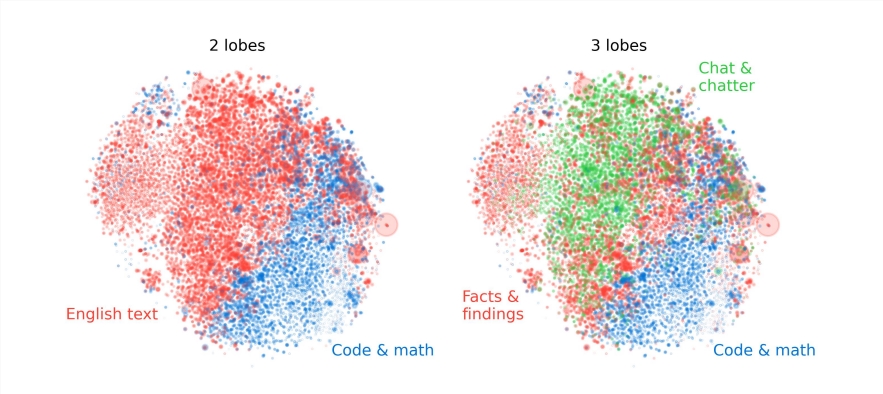

ثانيًا، على المستوى المتوسط، وجد الباحثون أن مساحة التنشيط في LLM لها بنية معيارية مشابهة للأقسام الوظيفية للدماغ البشري.

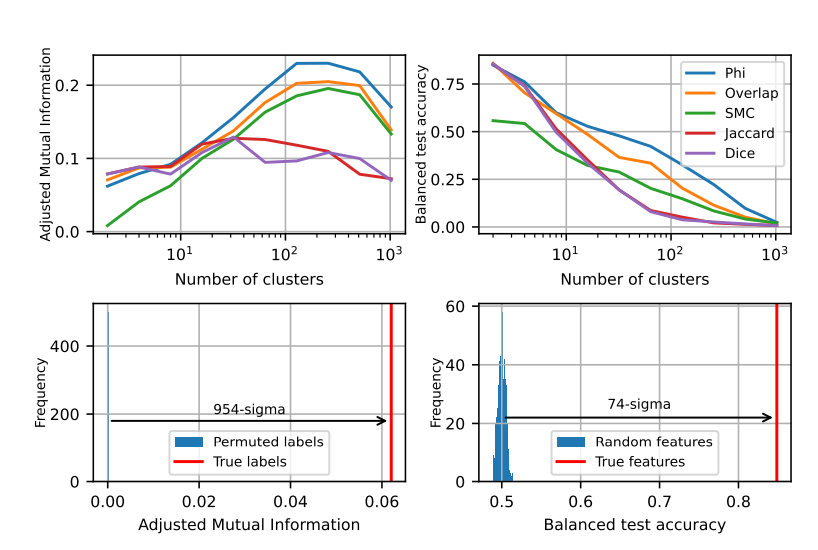

على سبيل المثال، تتجمع الميزات المتعلقة بالرياضيات والبرمجة معًا لتشكل "فصًا" مشابهًا للفصوص الوظيفية للدماغ البشري. من خلال التحليل الكمي لمؤشرات متعددة، أكد الباحثون الموقع المكاني لهذه "الفصوص"، مما يدل على أن السمات المتزامنة هي أيضًا أكثر تجمعًا مكانيًا، وهو ما يتجاوز بكثير ما يمكن توقعه من التوزيع العشوائي.

على المستوى الكلي، وجد الباحثون أن الهيكل العام لسحابة نقاط ميزة LLM ليس متناحيًا، ولكنه يمثل توزيع القيمة الذاتية لقانون الطاقة، وهذا التوزيع أكثر وضوحًا في الطبقة الوسطى.

قام الباحثون أيضًا بتحليل كمي للإنتروبيا العنقودية ذات المستويات المختلفة ووجدوا أن الإنتروبيا العنقودية للطبقة الوسطى كانت أقل، مما يشير إلى أن تمثيل الميزة كان أكثر تركيزًا، بينما كانت الإنتروبيا العنقودية للطبقات المبكرة والمتأخرة أعلى، مما يشير إلى أن الميزة وكان التمثيل أكثر تشتتاً.

يزودنا هذا البحث بمنظور جديد لفهم الآليات الداخلية لنماذج اللغات الكبيرة، ويضع أيضًا الأساس لتطوير أنظمة ذكاء اصطناعي أكثر قوة وذكاءً في المستقبل.

إن نتيجة البحث هذه مثيرة، فهي لا تعمق فهمنا لنماذج اللغة واسعة النطاق فحسب، بل تشير أيضًا إلى اتجاه جديد للتطور المستقبلي للذكاء الاصطناعي. يعتقد محرر موقع Downcodes أنه مع التقدم المستمر للتكنولوجيا، سيُظهر الذكاء الاصطناعي إمكاناته القوية في المزيد من المجالات وسيجلب مستقبلًا أفضل للمجتمع البشري.