سيأخذك محرر Downcodes إلى فهم ظاهرة مزعجة في مجال الذكاء الاصطناعي - انهيار النموذج. تخيل أن نموذج الذكاء الاصطناعي يشبه مدون الطعام الذي يبدأ في تناول الطعام الذي يطبخه، فكلما أكل أكثر، أصبح مدمنًا عليه، ويصبح الطعام غير مستساغًا أكثر فأكثر، وفي النهاية يصبح "سيئًا". هو عندما ينهار النموذج. ويحدث ذلك عندما يعتمد نموذج الذكاء الاصطناعي بشكل كبير على البيانات التي ينشئها، مما يؤدي إلى انخفاض جودة النموذج أو حتى الفشل الكامل. سوف تتعمق هذه المقالة في الأسباب والتأثيرات وكيفية تجنب انهيار النموذج.

لقد حدث شيء غريب في دائرة الذكاء الاصطناعي مؤخرًا، مثل مدون الطعام الذي بدأ فجأة في تناول الطعام الذي يطبخه، وكلما أكل أكثر، زاد إدمانه، وأصبح الطعام غير مستساغ أكثر فأكثر. من المخيف جدًا قول هذا الشيء. المصطلح المهني يسمى انهيار النموذج.

ما هو انهيار النموذج بكل بساطة، إذا استخدم نموذج الذكاء الاصطناعي كمية كبيرة من البيانات التي تم إنشاؤها ذاتيًا أثناء عملية التدريب، فسوف يقع في حلقة مفرغة، مما يؤدي إلى تدهور جودة إنشاء النموذج، وفي النهاية؟ يفشل.

وهذا يشبه النظام البيئي المغلق، ونموذج الذكاء الاصطناعي هو الشيء الحي الوحيد في هذا النظام، والغذاء الذي ينتجه هو البيانات. في البداية، كان لا يزال بإمكانه العثور على بعض المكونات الطبيعية (بيانات حقيقية)، ولكن مع مرور الوقت، بدأ يعتمد أكثر فأكثر على المكونات "الاصطناعية" التي ينتجها (بيانات صناعية). المشكلة هي أن هذه المكونات "الاصطناعية" تعاني من نقص التغذية وتحمل بعض عيوب النموذج نفسه. إذا أكلت أكثر من اللازم، فسوف ينهار "جسم" نموذج الذكاء الاصطناعي، وستصبح الأشياء المتولدة أكثر فأكثر فاحشة.

يدرس هذا البحث ظاهرة انهيار النموذج ويحاول الإجابة على سؤالين رئيسيين:

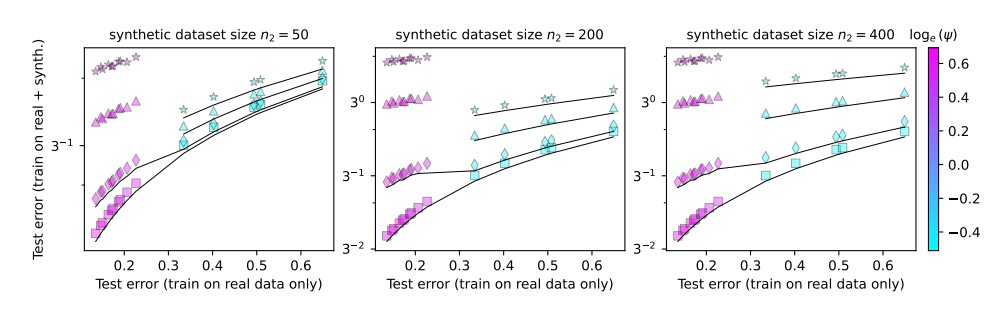

هل انهيار النموذج أمر لا مفر منه؟ هل يمكن حل المشكلة عن طريق خلط البيانات الحقيقية والاصطناعية؟

كلما كان النموذج أكبر، كلما كان من الأسهل أن يتعطل؟

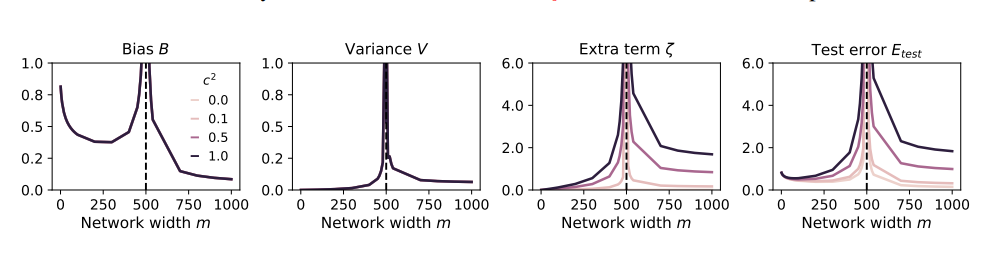

ومن أجل دراسة هذه القضايا، قام مؤلفو الورقة بتصميم سلسلة من التجارب واستخدموا نموذج الإسقاط العشوائي لمحاكاة عملية تدريب الشبكة العصبية. ووجدوا أن استخدام جزء صغير من البيانات الاصطناعية (على سبيل المثال، 1%) قد يؤدي إلى انهيار النموذج. ومما يزيد الطين بلة، أنه مع زيادة حجم النموذج، تصبح ظاهرة انهيار النموذج أكثر خطورة.

هذا يشبه مدون الطعام الذي بدأ بتجربة جميع أنواع المكونات الغريبة من أجل جذب الانتباه، ولكن انتهى به الأمر إلى أن يعاني من معدة سيئة. ومن أجل تعويض الخسائر، لم يكن بإمكانه سوى زيادة تناوله للطعام وتناول المزيد من الأشياء الغريبة. ونتيجة لذلك، أصبحت معدته أسوأ فأسوأ، واضطر أخيرًا إلى ترك عالم الأكل والبث.

إذًا، كيف ينبغي لنا أن نتجنب انهيار النموذج؟

وقدم مؤلفو الورقة بعض الاقتراحات:

إعطاء الأولوية لاستخدام البيانات الحقيقية: البيانات الحقيقية تشبه الأغذية الطبيعية، فهي غنية بالمواد المغذية، وهي مفتاح النمو الصحي لنماذج الذكاء الاصطناعي.

استخدم البيانات الاصطناعية بحذر: البيانات الاصطناعية مثل الأغذية الاصطناعية، على الرغم من أنها يمكن أن تكمل بعض العناصر الغذائية، إلا أنه لا يجب الاعتماد عليها كثيرًا، وإلا فإنها ستؤدي إلى نتائج عكسية.

التحكم في حجم النموذج: كلما كان النموذج أكبر، كلما زادت الشهية، وأصبح من الأسهل الإصابة بسوء في المعدة. عند استخدام البيانات الاصطناعية، التحكم في حجم النموذج لتجنب الإفراط في التغذية.

يعد انهيار النموذج تحديًا جديدًا نواجهه في عملية تطوير الذكاء الاصطناعي، وهو يذكرنا أنه أثناء متابعة نطاق النموذج وكفاءته، يجب علينا أيضًا الاهتمام بجودة البيانات وصحة النموذج. وبهذه الطريقة فقط يمكن لنماذج الذكاء الاصطناعي أن تستمر في التطور بشكل صحي وتخلق قيمة أكبر للمجتمع البشري.

الورقة: https://arxiv.org/pdf/2410.04840

بشكل عام، يعد انهيار النماذج مشكلة تستحق الاهتمام في تطوير الذكاء الاصطناعي. نحن بحاجة إلى التعامل مع البيانات الاصطناعية بحذر، والاهتمام بجودة البيانات الحقيقية، والتحكم في حجم النموذج لتجنب ظاهرة "الذكاء الاصطناعي". الأكل أكثر من اللازم." آمل أن يساعد هذا التحليل الجميع على فهم انهيار النموذج بشكل أفضل والمساهمة في التطوير الصحي للذكاء الاصطناعي.