أطلقت شركة Alibaba Cloud سلسلة Qwen2-Math، وهي نموذج لغة جديد واسع النطاق يركز على مجال الرياضيات، والذي اجتذب اهتمامًا واسع النطاق في الصناعة. تتفوق هذه السلسلة من النماذج على النماذج مفتوحة المصدر الموجودة في العديد من الاختبارات المعيارية الرياضية، بل وتتفوق على النماذج مغلقة المصدر المعروفة مثل GPT-4o وClaude-3.5-Sonnet في بعض الجوانب. سيقدم لك محرر Downcodes شرحًا متعمقًا للأداء الممتاز والتكنولوجيا المبتكرة واتجاه التطوير المستقبلي لنماذج سلسلة Qwen2-Math، وسيأخذك لاستكشاف أحدث الإنجازات في مجال رياضيات الذكاء الاصطناعي.

أطلقت Alibaba Cloud مؤخرًا سلسلة Qwen2-Math من نماذج اللغات واسعة النطاق، وقد اجتذب الوافد الجديد للذكاء الاصطناعي الذي يركز على مجال الرياضيات اهتمامًا واسع النطاق في الصناعة بمجرد الكشف عنه.

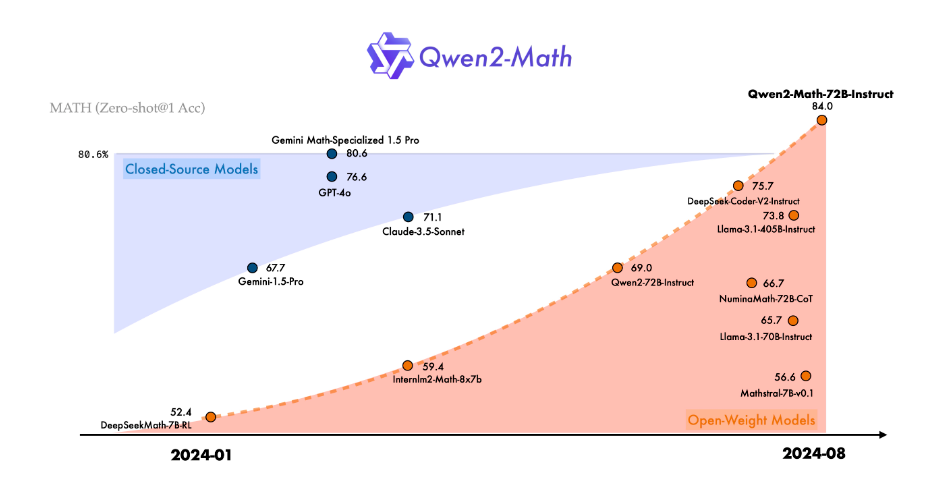

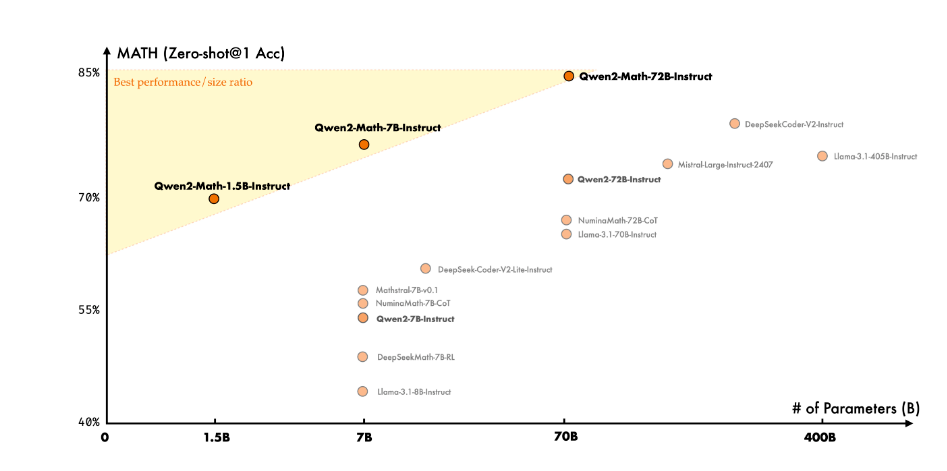

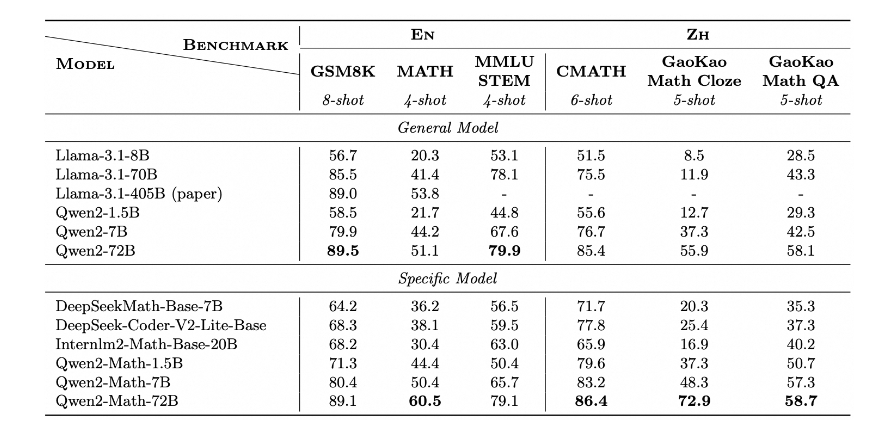

كأحدث أعضاء سلسلة Qwen2، أظهرت نماذج Qwen2-Math وQwen2-Math-Instruct-1.5B/7B/72B قوة مذهلة في قدرات حل المشكلات الرياضية. يُذكر أن هذه السلسلة من النماذج لم تتفوق فقط على النماذج مفتوحة المصدر الموجودة في العديد من الاختبارات المعيارية الرياضية، ولكنها تفوقت أيضًا في بعض الجوانب بما في ذلك GPT-4o وClaude-3.5-Sonnet وGemini-1.5-Pro وLlama-Well-. يمكن تسمية النماذج مغلقة المصدر المعروفة، بما في ذلك 3.1-405B، بالحصان الأسود في مجتمع رياضيات الذكاء الاصطناعي.

نجاح Qwen2-Math ليس من قبيل الصدفة. كرس فريق Alibaba Cloud الكثير من الجهد في العام الماضي لتحسين القدرات المنطقية لنماذج اللغة الكبيرة في المسائل الحسابية والرياضية. أساس هذه السلسلة من النماذج هو Qwen2-1.5B/7B/72B، وعلى هذا الأساس، أجرى فريق البحث والتطوير تدريبًا مسبقًا متعمقًا باستخدام مجموعة رياضيات احترافية مصممة بعناية. تغطي هذه المجموعة الفريدة نصوص الرياضيات واسعة النطاق وعالية الجودة عبر الإنترنت، والكتب المهنية، وأمثلة التعليمات البرمجية، وأسئلة الامتحانات الضخمة، وتتضمن أيضًا بيانات التدريب المسبق في الرياضيات التي تم إنشاؤها بشكل مستقل بواسطة Qwen2.

ومن الجدير بالذكر بشكل خاص نموذج Qwen2-Math-Instruct. يعتمد نموذج المكافأة الاحترافي في الرياضيات هذا على تدريب Qwen2-Math-72B على أسلوب تدريب مبتكر. يجمع فريق البحث والتطوير بذكاء بين إشارة المكافأة الكثيفة والإشارة الثنائية لمعرفة ما إذا كان النموذج يجيب بشكل صحيح أم لا. يتم استخدام هذه الإشارة المدمجة كإشارة إشراف لإنشاء بيانات SFT (الضبط الدقيق الخاضع للإشراف) من خلال أخذ عينات الرفض، وفي التعلم المعزز. بعد تطبيق تقنية تحسين السياسة النسبية (GRPO) لمجموعة SFT. تعمل طريقة التدريب الفريدة هذه على تحسين قدرات النموذج على حل المشكلات الرياضية بشكل كبير.

في التطبيقات العملية، يُظهر Qwen2-Math-Instruct أداءً مذهلاً. سواء كان اختبار AIME لعام 2024 (امتحان الرياضيات الدعوي الأمريكي) أو 2023 AMC (مسابقة الرياضيات الأمريكية)، فقد كان أداء هذا النموذج جيدًا في العديد من البيئات، بما في ذلك البحث الجشع (الجشع)، وتصويت الأغلبية، وتقليل المخاطر، وغيرها من الاستراتيجيات.

والأمر الأكثر إثارة هو أن Qwen2-Math أظهر أيضًا قوة كبيرة في حل بعض المشكلات على مستوى الأولمبياد الدولي للرياضيات (IMO). ومن خلال تحليل سلسلة من حالات الاختبار، وجد الباحثون أن Qwen2-Math لا يمكنه حل مشكلات المنافسة الرياضية البسيطة بسهولة فحسب، بل يوفر أيضًا حلولاً مقنعة عند مواجهة المشكلات المعقدة.

ومع ذلك، لم يتوقف فريق Alibaba Cloud عند هذا الحد. لقد كشفوا أن سلسلة Qwen2-Math الحالية تدعم اللغة الإنجليزية فقط، لكنهم يعملون بالفعل بنشاط على تطوير نماذج ثنائية اللغة تدعم اللغتين الإنجليزية والصينية، ويخططون لإطلاق إصدارات متعددة اللغات في المستقبل القريب. بالإضافة إلى ذلك، يواصل الفريق تحسين النموذج لتحسين قدرته على حل المشكلات الرياضية الأكثر تعقيدًا وصعوبة.

لا شك أن ظهور Qwen2-Math قد فتح إمكانيات جديدة لتطبيق الذكاء الاصطناعي في مجال الرياضيات. لن يؤدي ذلك إلى إحداث تغييرات ثورية في صناعة التعليم ومساعدة الطلاب على فهم المعرفة الرياضية وإتقانها بشكل أفضل فحسب، بل قد يلعب أيضًا دورًا مهمًا في البحث العلمي والهندسة وغيرها من المجالات التي تتطلب حسابات رياضية معقدة.

صفحة المشروع: https://top.aibase.com/tool/qwen2-math

تنزيل النموذج: https://huggingface.co/Qwen

بشكل عام، يمثل ظهور سلسلة نماذج Qwen2-Math إنجازًا كبيرًا للذكاء الاصطناعي في مجال الرياضيات، وإمكانات تطويره المستقبلية هائلة وتستحق الاهتمام المستمر. يعتقد محرر Downcodes أنه مع التقدم التكنولوجي المستمر، سيوفر Qwen2-Math المزيد من الإمكانيات لتعليم الرياضيات والبحث العلمي.