شرح عالم الميتا توماس سكيلوم عملية تطوير Llama 3.1 بالتفصيل في بودكاست Latent Space وقام بمعاينة اتجاه تطوير Llama 4. Llama 3.1 ليس عبارة عن تكديس معلمات بسيط، ولكنه عبارة عن مقايضة بين حجم المعلمة ووقت التدريب وقيود الأجهزة. إن حجم المعلمة 405B الخاص به هو استجابة لـ GPT-4o. على الرغم من أن حجم النموذج الضخم يجعل من الصعب تشغيله على أجهزة الكمبيوتر العادية، إلا أن ميزة المصدر المفتوح تتيح لعدد أكبر من الأشخاص المشاركة وتعزيز التطور التكنولوجي.

تمثل ولادة Llama3.1 توازنًا مثاليًا بين مقياس المعلمات ووقت التدريب وقيود الأجهزة. الجسم الضخم لـ 405B ليس اختيارًا عشوائيًا، بل هو تحدي صادر عن Meta لـ GPT-4o. على الرغم من أن قيود الأجهزة تمنع تشغيل Llama3.1 على كل كمبيوتر منزلي، إلا أن قوة مجتمع المصادر المفتوحة تجعل كل شيء ممكنًا.

أثناء تطوير Llama 3.1، قام Scialom وفريقه بإعادة فحص قانون القياس. ووجدوا أن حجم النموذج كان أمرًا أساسيًا بالفعل، ولكن الأهم من ذلك هو الكمية الإجمالية لبيانات التدريب. اختار Llama3.1 زيادة عدد الرموز التدريبية، حتى لو كان ذلك يعني إنفاق المزيد من الطاقة الحاسوبية.

لا توجد تغييرات جذرية في بنية Llama 3.1، لكن Meta بذلت جهودًا كبيرة من حيث حجم البيانات وجودتها. أعطى المحيط الرمزي 15T Llama3.1 قفزة نوعية في عمق واتساع المعرفة.

فيما يتعلق باختيار البيانات، يعتقد سيالوم اعتقادًا راسخًا أن هناك الكثير من الرسائل النصية المهملة على الإنترنت العامة، وأن الذهب الحقيقي هو البيانات الاصطناعية. في عملية ما بعد التدريب على Llama3.1، لم يتم استخدام أي إجابات مكتوبة يدويًا على الإطلاق، ولكن تم الاعتماد بشكل كامل على البيانات الاصطناعية التي تم إنشاؤها بواسطة Llama2.

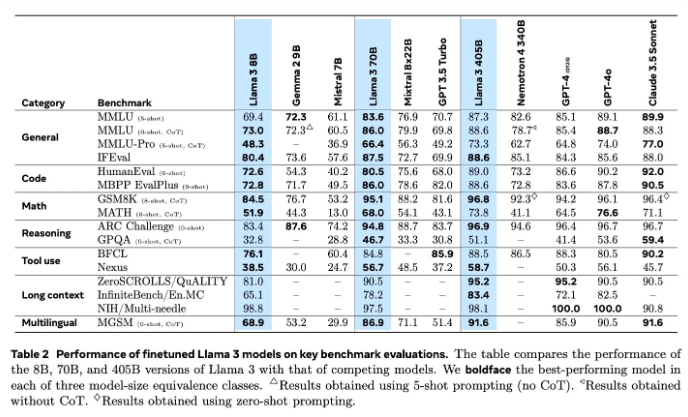

لقد كان تقييم النماذج دائمًا مشكلة صعبة في مجال الذكاء الاصطناعي. لقد جرب Llama3.1 مجموعة متنوعة من أساليب التقييم والتحسين، بما في ذلك نماذج المكافآت والاختبارات المعيارية المتنوعة. لكن التحدي الحقيقي يكمن في العثور على المحفزات الصحيحة التي يمكن أن تهزم النماذج القوية.

بدأت Meta تدريب Llama4 في يونيو، وهذه المرة ركزت على تكنولوجيا العميل. يبشر تطوير أدوات الوكيل مثل Toolformer باستكشاف Meta الجديد في مجال الذكاء الاصطناعي.

المصدر المفتوح لـ Llama3.1 ليس مجرد محاولة جريئة من Meta، ولكنه أيضًا تفكير عميق حول مستقبل الذكاء الاصطناعي. مع إطلاق Llama4، لدينا سبب للاعتقاد بأن Meta ستستمر في قيادة الطريق في مجال الذكاء الاصطناعي. دعونا نتطلع إلى كيفية إعادة تعريف Llama4 والتكنولوجيا الوكيلة لمستقبل الذكاء الاصطناعي.

من خلال الفهم المتعمق لعملية البحث والتطوير الخاصة بـ Llama 3.1، يمكننا أن نرى ابتكارات Meta المستمرة وجهودها في مجال نماذج اللغة واسعة النطاق، بالإضافة إلى تركيزها على مجتمع المصادر المفتوحة. يشير اتجاه البحث والتطوير في Llama 4 أيضًا إلى اتجاه التطوير المستقبلي لتكنولوجيا الذكاء الاصطناعي، والذي يستحق الانتظار والمشاهدة. دعونا نتطلع إلى كيفية تطور تكنولوجيا الذكاء الاصطناعي في المستقبل.