أعلنت OpenAI أنه تم تصور الوضع الصوتي المتقدم لـ ChatGPT. يمكن للمستخدمين المشتركين في Plus أو Team أو Pro التفاعل مع ChatGPT في الوقت الفعلي من خلال كاميرات هواتفهم المحمولة والحصول على إمكانات مشاركة الشاشة. لقد تم تأجيل هذه الميزة عدة مرات من قبل وتم إطلاقها رسميًا بعد فترة طويلة من الاختبار، ومع ذلك، لا يمكن لجميع المستخدمين استخدامها على الفور، وسيتعين على بعض المناطق وأنواع المستخدمين الانتظار حتى يناير من العام المقبل أو حتى لفترة أطول.

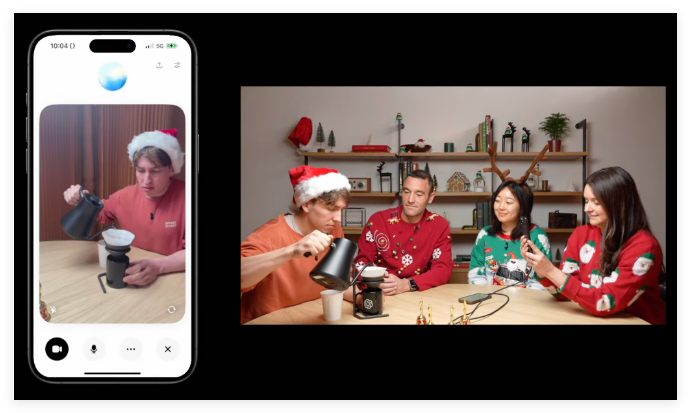

أعلنت شركة OpenAI يوم الخميس أنه تم تصور ميزة المحادثة الشبيهة بالإنسان "وضع الكلام المتقدم" التي طورتها لـ ChatGPT. يمكن الآن للمستخدمين المشتركين في ChatGPT Plus أو Team أو Pro توجيه كاميرا هواتفهم نحو كائن ما وسوف يستجيب ChatGPT في الوقت الفعلي تقريبًا.

يتميز هذا الوضع الصوتي المتقدم بميزات الرؤية أيضًا بإمكانيات مشاركة الشاشة التي تحلل المحتوى الموجود على شاشة الجهاز. على سبيل المثال، يمكنه شرح قوائم الإعدادات المختلفة وتقديم المشورة بشأن المسائل الرياضية.

طريقة الاستخدام بسيطة للغاية: انقر فوق أيقونة الصوت بجوار شريط الدردشة ChatGPT، ثم انقر فوق أيقونة الفيديو في الزاوية اليسرى السفلية لبدء الفيديو. إذا كنت ترغب في مشاركة شاشتك، فيمكنك النقر فوق قائمة النقاط الثلاث واختيار "مشاركة الشاشة".

وفيما يتعلق بطرح الميزة، قالت OpenAI أنه سيتم طرح وضع الكلام المتقدم مع الرؤية بدءًا من يوم الخميس وينتهي الأسبوع المقبل. ومن المهم ملاحظة أن هذا لن يكون متاحًا لجميع المستخدمين على الفور. وسيتعين على مستخدمي ChatGPT Enterprise وEdu الانتظار حتى يناير من العام المقبل، بينما لم يعلن المستخدمون في الاتحاد الأوروبي وسويسرا وأيسلندا والنرويج وليختنشتاين عن جدول زمني محدد بعد.

خلال ظهوره مؤخرًا في برنامج "60 دقيقة" على قناة CNN، أظهر رئيس OpenAI، جريج بروكمان، قدرات التحليل البصري المتقدمة لأنماط الكلام لأندرسون كوبر. عندما رسم كوبر أجزاء من جسم الإنسان على السبورة، تمكن ChatGPT من فهم رسوماته والتعليق عليها. على سبيل المثال، ينص على أن موقع الدماغ دقيق ويقترح أن شكل الدماغ أقرب إلى الشكل الناقص.

ومع ذلك، أثناء العرض التوضيحي، كشف وضع الكلام المتقدم هذا أيضًا عن بعض الأخطاء المتعلقة بالقضايا الهندسية، مما يوضح الخطر المحتمل لـ "الهلوسة".

ومن الجدير بالذكر أن هذا الوضع الصوتي المتقدم مع الميزات المرئية قد تم تأجيله عدة مرات. وفي أبريل/نيسان، وعدت شركة OpenAI بأنها ستطلق "في غضون أسابيع"، لكنها قالت لاحقًا إنها ستحتاج إلى مزيد من الوقت. ولم تكن هذه الميزة متاحة لبعض مستخدمي ChatGPT حتى أوائل هذا الخريف، ولم تكن وظيفة التحليل المرئي متاحة بعد في ذلك الوقت.

وسط المنافسة المتزايدة في مجال الذكاء الاصطناعي، يعمل المنافسون مثل جوجل وميتا أيضًا على تطوير قدرات مماثلة. افتتحت Google هذا الأسبوع مشروع الذكاء الاصطناعي المحادثة لتحليل الفيديو في الوقت الفعلي Project Astra لبعض مختبري Android.

بالإضافة إلى الميزات المرئية، أطلقت OpenAI أيضًا "وضع سانتا" الاحتفالي يوم الخميس، مما يسمح للمستخدمين بتمكين صوت سانتا من خلال أيقونة ندفة الثلج بجوار شريط الإشعارات في تطبيق ChatGPT.

يمثل هذا التحديث المرئي للوضع الصوتي المتقدم لـ ChatGPT تحسنًا في قدرة الذكاء الاصطناعي على التفاعل مع العالم الحقيقي، ولكنه يكشف أيضًا عن التحديات والقيود في تطوير التكنولوجيا. وفي المستقبل، فإن تحسين وتعميم الوظائف المماثلة يستحق التطلع إليه. وسيستمر تقدم تكنولوجيا الذكاء الاصطناعي في التأثير على أسلوب حياتنا.