حقق أحدث نموذج للغة المرئية المفتوحة من NVIDIA، NVILA، اختراقات كبيرة في الدقة والكفاءة، ليصبح علامة فارقة أخرى في مجال الذكاء الاصطناعي المرئي. بالمقارنة مع نماذج الرؤية واسعة النطاق الأخرى، حققت NVILA تخفيضات كبيرة في تكاليف التدريب واستخدام الذاكرة وزمن الوصول، كما أظهرت أداءً ممتازًا في اختبارات قياس الأداء المتعددة، حتى أنها تجاوزت بعض المنافسين. تقدم المقالة التفاصيل الفنية لـ NVILA بالتفصيل، بما في ذلك تقنية "التوسيع أولاً والضغط لاحقًا" بالإضافة إلى توسيع S2 الديناميكي وتشذيب مجموعة البيانات المستندة إلى DeltaLoss واستراتيجيات التحسين الأخرى، بهدف تحقيق التوازن بين دقة وكفاءة النموذج. يمثل هذا تطورًا في تكنولوجيا نماذج اللغة المرئية في اتجاه أكثر اقتصادًا وكفاءة.

أطلقت NVIDIA مؤخرًا جيلًا جديدًا من نماذج اللغة المرئية المفتوحة - NVILA. تم تصميمه لتحسين الدقة والكفاءة، وقد أصبح رائدًا في مجال الذكاء الاصطناعي المرئي بأدائه المتميز.

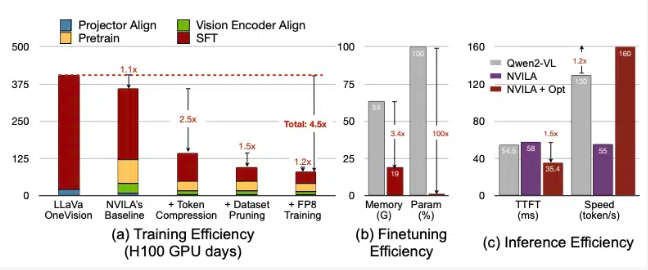

وفقًا لـ NVIDIA، تقلل NVILA تكاليف التدريب بمقدار 4.5 مرة، وتقلل الذاكرة المطلوبة للضبط الدقيق بمقدار 3.4 مرة، وتقلل زمن الاستجابة للملء المسبق وفك التشفير بمقدار مرتين تقريبًا. تتم مقارنة هذه البيانات بنموذج رؤية كبير آخر، LLaVa OneVision.

في اختبارات الفيديو، تفوقت NVILA على GPT4o Mini، كما حققت أداءً جيدًا أيضًا في المقارنات مع GPT4o وSonnet3.5 وGemini1.5Pro. بالإضافة إلى ذلك، حققت NVILA أيضًا انتصارًا طفيفًا في المقارنة مع Llama3.2. على الرغم من ذلك، ذكرت NVIDIA أن النموذج لم يتم إصداره بعد إلى منصة Hugging Face، ووعدت بإصدار الكود والنموذج قريبًا لتعزيز إمكانية تكرار النموذج.

أشارت NVIDIA إلى أن تكلفة تدريب نماذج اللغة المرئية مرتفعة جدًا. ويستغرق تدريب نموذج اللغة المرئية بمعلمة 7B ما يقرب من 400 يوم من وحدات معالجة الرسومات. في الوقت نفسه، يعد الضبط الدقيق لمثل هذا النموذج أيضًا مستهلكًا للذاكرة بشكل كبير، حيث يتطلب نموذج المعلمة 7B أكثر من 64 جيجابايت من ذاكرة وحدة معالجة الرسومات.

لذلك، تستخدم NVIDIA تقنية تسمى التوسيع ثم الضغط لتحقيق التوازن بين دقة النموذج وكفاءته. بدلاً من تقليل حجم الصور ومقاطع الفيديو، يستخدم النموذج إطارات متعددة من صور ومقاطع فيديو عالية الدقة لضمان عدم فقدان أي تفاصيل.

أثناء عملية الضغط، يقوم النموذج بتقليل حجم البيانات المدخلة عن طريق ضغط المعلومات المرئية إلى عدد أقل من الرموز المميزة وتجميع وحدات البكسل للاحتفاظ بالمعلومات المهمة. ذكرت NVIDIA في الورقة أن مضاعفة الدقة ستؤدي إلى مضاعفة عدد الرموز المرئية، مما سيزيد من تكاليف التدريب والاستدلال بأكثر من الضعف. ولذلك، فإنها تقلل هذه التكلفة عن طريق ضغط الرموز المميزة للمكان/الوقت.

كما أظهرت NVIDIA أيضًا عروضًا توضيحية لبعض النماذج، ويمكن لـ NVILA الإجابة على استفسارات متعددة بناءً على صورة أو مقطع فيديو. تتم أيضًا مقارنة نتائج مخرجاتها بنموذج VILA1.5 الذي تم إصداره مسبقًا بواسطة NVIDIA. بالإضافة إلى ذلك، قدمت NVIDIA أيضًا بعض التقنيات الأخرى بالتفصيل، مثل التوسع الديناميكي S2، وتشذيب مجموعة البيانات المستندة إلى DeltaLoss، والتكميم باستخدام دقة FP8، وما إلى ذلك.

يتم تطبيق هذه التقنيات على نموذج المعلمة 8B، ويمكن الاطلاع على التفاصيل المحددة على Arxiv.

المدخل الورقي: https://arxiv.org/pdf/2412.04468

تسليط الضوء على:

يعمل نموذج NVILA على تقليل تكاليف التدريب بمقدار 4.5 مرات، مما يحسن كفاءة الذكاء الاصطناعي البصري.

مع الصور وإطارات الفيديو عالية الدقة، تضمن NVILA سلامة المعلومات المدخلة.

تعد NVIDIA بإصدار التعليمات البرمجية والنماذج قريبًا لتعزيز إمكانية تكرار الأبحاث.

بشكل عام، جلب ظهور NVILA إمكانيات جديدة لتطوير نماذج اللغة المرئية، وستعمل عملية التدريب والاستدلال الفعالة على خفض عتبة تطبيقات الذكاء الاصطناعي المرئي وتعزيز المزيد من التطوير في هذا المجال. نحن نتطلع إلى الكشف المبكر عن التعليمات البرمجية والنماذج من NVIDIA حتى يتمكن المزيد من الباحثين من المشاركة وتعزيز تقدم تقنية الذكاء الاصطناعي المرئي بشكل مشترك.