أعلنت Meta مؤخرًا عن إطلاق أحدث عضو في سلسلة Llama - Llama3.370B. أعلن أحمد الدحلة، نائب رئيس شركة ميتا للذكاء الاصطناعي التوليدي، عن التخفيض الكبير.

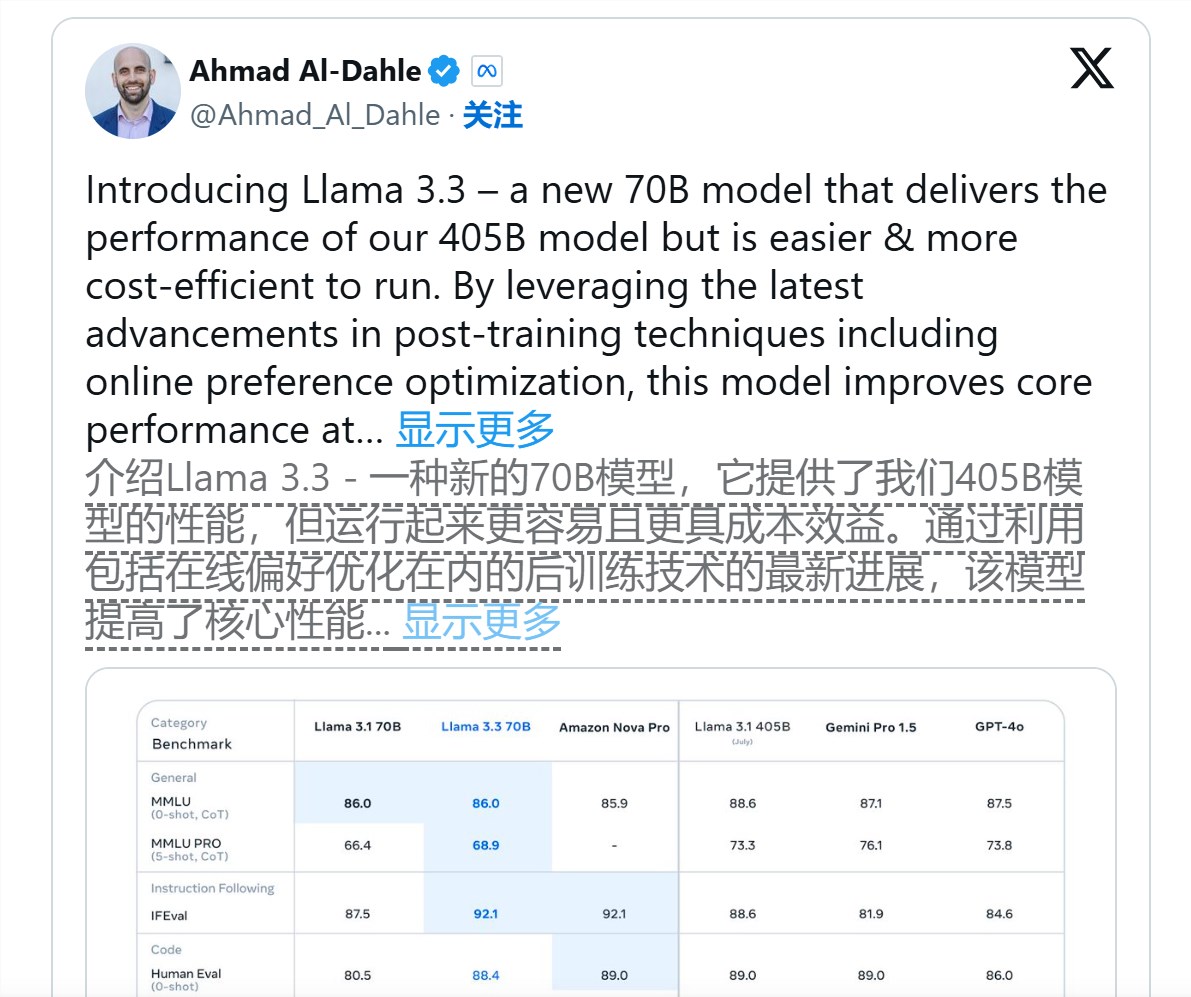

وقال الدهلي إنه من خلال الاستفادة من أحدث تقنيات ما بعد التدريب، فإن Llama3.370B لا يعمل على تحسين الأداء فحسب، بل يقلل أيضًا من تكاليف التشغيل. وفقًا لنتائج الاختبار المعياري الصادرة عن Meta، تجاوز Llama3.370B Gemini1.5Pro من Google، وGPT-4 من OpenAI، وNova Pro الذي تم إصداره حديثًا من Amazon في العديد من المجالات، خاصة في اختبار MMLU الذي يقيم قدرة النموذج على فهم اللغة.

النموذج متاح الآن للتنزيل من مصادر مثل Hugging Face ومنصة Llama الرسمية، وهي خطوة من Meta تهدف إلى السيطرة على مجال الذكاء الاصطناعي بنماذج "مفتوحة". يمكن تطبيق نموذج Meta's Llama على مجموعة متنوعة من السيناريوهات ويدعم التسويق، على الرغم من أن Meta قد وضعت قيود الاستخدام لبعض المطورين، مما يتطلب منصات تضم أكثر من 700 مليون مستخدم شهريًا للتقدم للحصول على تراخيص خاصة. وعلى الرغم من ذلك، تم تنزيل نموذج اللاما أكثر من 650 مليون مرة، مما يشير إلى شعبيته الواسعة بين مطوري الذكاء الاصطناعي حول العالم.

من أجل دعم التدريب على نماذج الذكاء الاصطناعي على نطاق واسع في المستقبل، تستثمر Meta بكثافة في البنية التحتية للحوسبة. أعلنت الشركة مؤخرًا أنها ستقوم ببناء مركز بيانات للذكاء الاصطناعي بقيمة 10 مليارات دولار في لويزيانا، وهو أكبر مركز بيانات للذكاء الاصطناعي لشركة Meta حتى الآن. ذكر زوكربيرج خلال مكالمة الأرباح أنه من أجل تدريب الجيل التالي من نموذج Llama4، ستكون قوة الحوسبة المطلوبة 10 أضعاف قوة Llama3. اشترت Meta حاليًا أكثر من 100000 مجموعة GPU من Nvidia، بما يتوافق مع موارد المنافسين مثل xAI.

مع استمرار ارتفاع تكلفة التدريب على نماذج الذكاء الاصطناعي التوليدي، تظهر النفقات الرأسمالية لشركة Meta أيضًا اتجاهًا متزايدًا. زادت النفقات الرأسمالية في الربع الثاني من عام 2024 بنسبة 33٪ تقريبًا لتصل إلى 8.5 مليار دولار أمريكي. ويرجع هذا النمو بشكل أساسي إلى استثمار Meta المستمر في الخوادم ومراكز البيانات والبنية التحتية للشبكات.