أصدرت Magic Square Quantitative مؤخرًا جيلًا جديدًا من الطراز الكبير DeepSeek-V3. إن مقياس المعلمات الذي يبلغ 671 مليارًا وهندسة MoE تجعل أداءها مشابهًا لأفضل النماذج مغلقة المصدر، كما أنها تتميز بخصائص التكلفة المنخفضة والكفاءة العالية، والتي اجتذبت انتشارًا واسع النطاق الاهتمام في الصناعة. حقق DeepSeek-V3 أداءً جيدًا في العديد من الاختبارات، ولا سيما تجاوز جميع النماذج الحالية في اختبار القدرة الرياضية، ويوفر خدمات واجهة برمجة التطبيقات (API) بسعر أقل بكثير من النماذج مثل GPT-4، مما يوفر للمطورين والمؤسسات حل الذكاء الاصطناعي الفعال من حيث التكلفة. ستحلل هذه المقالة بالتفصيل الأداء والتكلفة واستراتيجية التسويق لـ DeepSeek-V3، وتناقش تأثيرها على صناعة الذكاء الاصطناعي.

أصدرت شركة Magic Square Quantitative جيلًا جديدًا من الطراز الكبير DeepSeek-V3 مساء يوم 26 ديسمبر، مما يدل على تقدم تكنولوجي مذهل. هذا النموذج الذي يستخدم بنية MoE (الخبراء المختلطون) لا يمكن مقارنته من حيث الأداء بأفضل النماذج مغلقة المصدر فحسب، بل إن ميزاته منخفضة التكلفة وعالية الكفاءة جذبت اهتمام الصناعة.

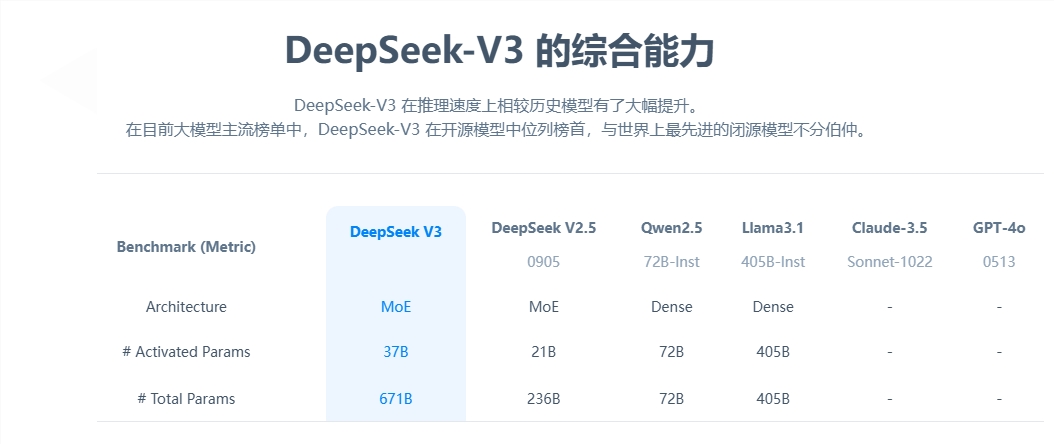

من منظور المعلمات الأساسية، يحتوي DeepSeek-V3 على 671 مليار معلمة، منها 37 مليار معلمة تنشيط، وقد أكمل التدريب المسبق على مقياس بيانات يبلغ 14.8 تريليون رمز مميز. بالمقارنة مع منتج الجيل السابق، تمت زيادة سرعة إنشاء النموذج الجديد بمقدار 3 مرات، ويمكنه معالجة 60 رمزًا في الثانية، مما يحسن بشكل كبير من كفاءة التطبيقات العملية.

فيما يتعلق بتقييم الأداء، يُظهر DeepSeek-V3 قوة ممتازة. إنه لا يتفوق فقط على النماذج مفتوحة المصدر المعروفة مثل Qwen2.5-72B وLlama-3.1-405B، ولكنه أيضًا على قدم المساواة مع GPT-4 وClaude-3.5-Sonnet في اختبارات متعددة. وخاصة في اختبار القدرة الرياضية، تفوق النموذج على جميع النماذج مفتوحة المصدر ومغلقة المصدر الموجودة بنتائج ممتازة.

الشيء الأكثر لفتًا للانتباه هو الميزة المنخفضة التكلفة لـ DeepSeek-V3. وفقًا للأوراق البحثية مفتوحة المصدر، والتي تم حسابها بمبلغ 2 دولارًا أمريكيًا لكل ساعة وحدة معالجة رسومات، فإن إجمالي تكلفة التدريب للنموذج يبلغ 5.576 مليون دولار أمريكي فقط. ترجع هذه النتيجة الرائعة إلى التحسين التعاوني للخوارزميات والأطر والأجهزة. وأشاد كارباثي، المؤسس المشارك لـ OpenAI، بهذا الأمر، مشيرًا إلى أن DeepSeek-V3 حقق أداءً يفوق Llama3 في 2.8 مليون ساعة GPU فقط، وزادت كفاءة الحوسبة بنحو 11 مرة.

فيما يتعلق بالتسويق التجاري، على الرغم من زيادة أسعار خدمة API الخاصة بـ DeepSeek-V3 مقارنة بالجيل السابق، إلا أنها لا تزال تحافظ على أداء عالي التكلفة. يبلغ سعر الإصدار الجديد 0.5-2 يوان لكل مليون رمز إدخال و8 يوان لكل مليون رمز إخراج، بتكلفة إجمالية تبلغ حوالي 10 يوان. وبالمقارنة، يبلغ سعر الخدمة المكافئ لـ GPT-4 حوالي 140 يوانًا، والفجوة السعرية كبيرة.

وباعتباره نموذجًا كبيرًا شاملاً مفتوح المصدر، فإن إصدار DeepSeek-V3 لا يوضح التقدم الذي أحرزته تكنولوجيا الذكاء الاصطناعي في الصين فحسب، بل يوفر أيضًا للمطورين والشركات حل ذكاء اصطناعي عالي الأداء ومنخفض التكلفة.

ويمثل ظهور DeepSeek-V3 طفرة كبيرة في تكنولوجيا الذكاء الاصطناعي في الصين في مجال نماذج اللغات واسعة النطاق. إن مزاياه منخفضة التكلفة وعالية الأداء تجعله ذا قدرة تنافسية عالية في التطبيقات التجارية، ويستحق تطويره المستقبلي التطلع إليه . يساهم المصدر المفتوح لهذا النموذج أيضًا بموارد قيمة لمجتمع الذكاء الاصطناعي العالمي ويعزز مشاركة تكنولوجيا الذكاء الاصطناعي وتطويرها.