Chinesisch |. Englisch

CodeFuse-ChatBot: Entwicklung durch private Wissenserweiterung

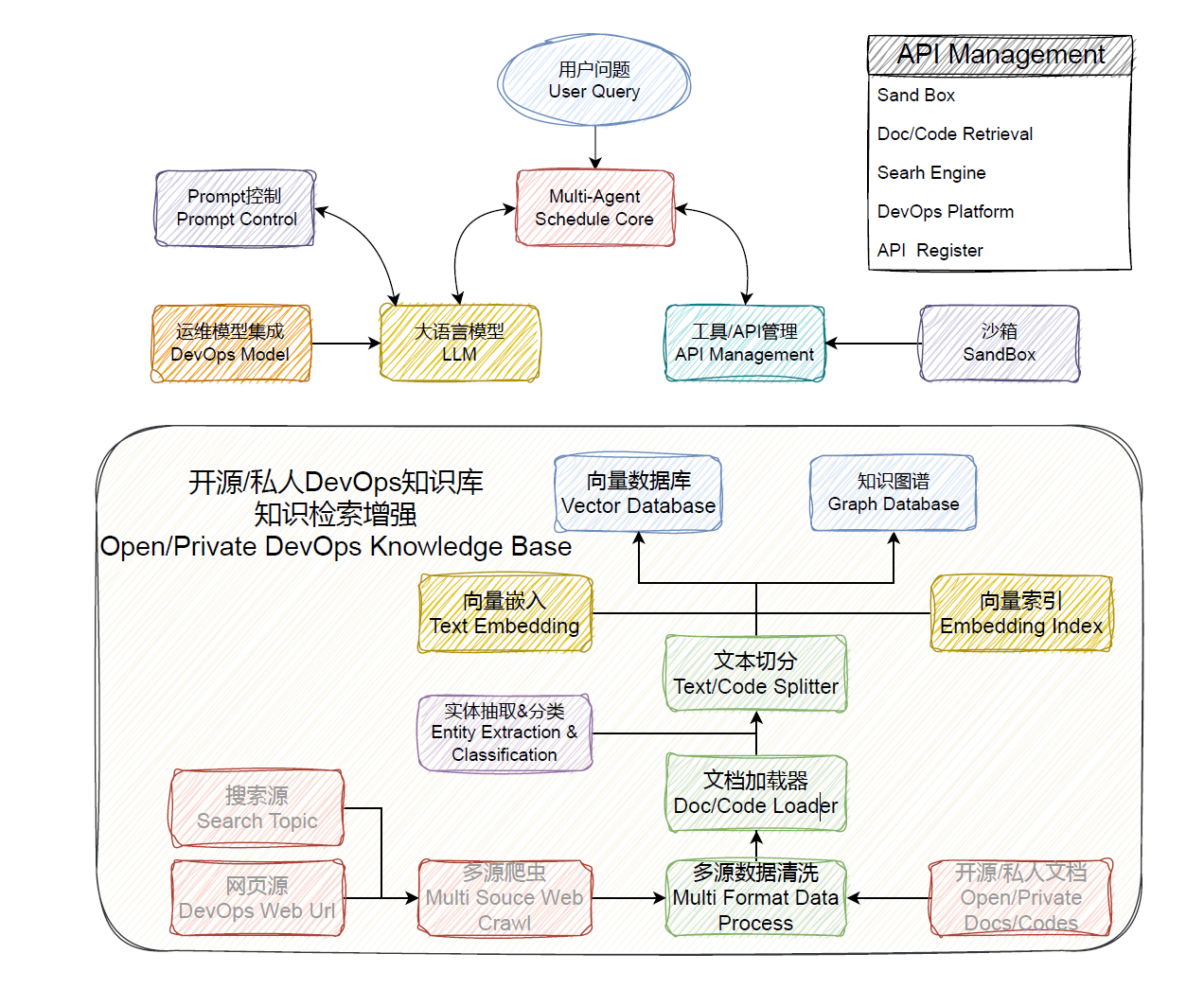

CodeFuse-ChatBot ist ein intelligenter Open-Source-KI-Assistent, der vom Ant CodeFuse-Team entwickelt wurde und sich der Vereinfachung und Optimierung aller Aspekte des Softwareentwicklungslebenszyklus widmet. Dieses Projekt kombiniert den kollaborativen Planungsmechanismus von Multi-Agent und integriert eine umfangreiche Toolbibliothek, Codebibliothek, Wissensdatenbank und Sandbox-Umgebung, sodass das LLM-Modell komplexe Aufgaben im DevOps-Bereich effektiv ausführen und bewältigen kann.

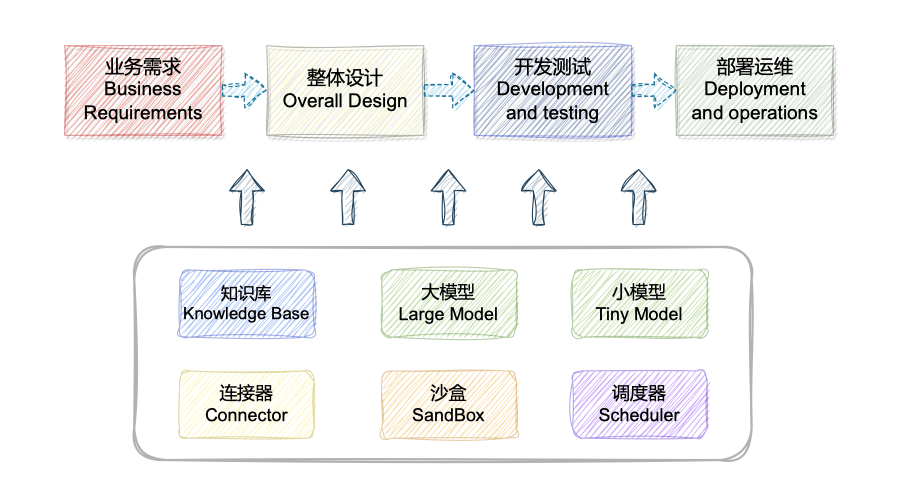

Dieses Projekt zielt darauf ab, einen intelligenten KI-Assistenten für den gesamten Lebenszyklus der Softwareentwicklung durch Retrieval Augmented Generation (RAG), Tool Learning und eine Sandbox-Umgebung zu entwickeln, der die Phasen Design, Codierung, Test, Bereitstellung sowie Betrieb und Wartung abdeckt. Verwandeln Sie sich schrittweise vom traditionellen Entwicklungs- und Betriebsmodell der Datenabfrage überall und dem unabhängigen und dezentralen Plattformbetrieb zum intelligenten Entwicklungs- und Betriebsmodell für große Modellfragen und -antworten, wodurch sich die Entwicklungs- und Betriebsgewohnheiten der Menschen ändern.

Die wichtigsten Unterscheidungstechnologien und Funktionspunkte dieses Projekts sind:

?Auf der Grundlage der Open-Source-LLM- und Embedding-Modelle kann dieses Projekt eine private Offline-Bereitstellung basierend auf dem Open-Source-Modell realisieren. Darüber hinaus unterstützt dieses Projekt auch OpenAI-API-Aufrufe. Greifen Sie auf die Demo zu

Das Kern-F&E-Team konzentriert sich seit langem auf die Forschung im Bereich AIOps + NLP. Wir haben das Codefuse-ai-Projekt gestartet und hoffen, dass alle in großem Umfang hochwertige Entwicklungs-, Betriebs- und Wartungsdokumente beisteuern, um diese Lösung gemeinsam zu verbessern und das Ziel zu erreichen, „die Entwicklung weltweit zu vereinfachen“.

Um Ihnen zu helfen, die Funktionen und Nutzung von Codefuse-ChatBot intuitiver zu verstehen, haben wir eine Reihe von Demonstrationsvideos aufgezeichnet. Wenn Sie sich diese Videos ansehen, können Sie die Hauptfunktionen und Betriebsabläufe dieses Projekts schnell verstehen.

Spezifische Implementierungsdetails finden Sie unter: Technische Routendetails und Projektplan-Follow-up: Projekte

Wenn Sie ein bestimmtes Modell integrieren müssen, teilen Sie uns bitte Ihre Bedürfnisse mit, indem Sie ein Problem einreichen.

| Modellname | Modellgröße | gpu_memory | quantifizieren | HFhub | ModelScope |

|---|---|---|---|---|---|

| chatgpt | - | - | - | - | - |

| codellama-34b-int4 | 34b | 20g | int4 | kommt bald | Link |

Eine vollständige Dokumentation finden Sie unter: CodeFuse-muAgent

pip install codefuse-muagent

Bitte installieren Sie den NVIDIA-Treiber selbst. Dieses Projekt wurde in der Python 3.9.18-, CUDA 11.7-Umgebung, auf Windows- und X86-Architektur-MacOS-Systemen getestet.

Informationen zur Docker-Installation, zum privatisierten LLM-Zugriff und zu damit verbundenen Startproblemen finden Sie unter: Schnelle Nutzungsdetails

Für Apple Silicon müssen Sie möglicherweise zuerst brew install qpdf durchführen.

1. Vorbereitung der Python-Umgebung

# 准备 conda 环境

conda create --name devopsgpt python=3.9

conda activate devopsgpt cd codefuse-chatbot

# python=3.9,notebook用最新即可,python=3.8用notebook=6.5.6

pip install -r requirements.txt2. Starten Sie den Dienst

# 完成server_config.py配置后,可一键启动

cd examples

bash start.sh

# 开始在页面进行相关配置,然后打开`启动对话服务`即可

Oder starten Sie die alte Version über start.py Weitere LLM-Zugriffsmethoden finden Sie hier.

Vielen Dank für Ihr Interesse am Codefuse-Projekt. Wir freuen uns sehr über Ihre Vorschläge, Meinungen (einschließlich Kritik), Kommentare und Beiträge zum Codefuse-Projekt.

Ihre verschiedenen Vorschläge, Meinungen und Kommentare zu Codefuse können direkt über Issues auf GitHub eingereicht werden.

Es gibt viele Möglichkeiten, am Codefuse-Projekt teilzunehmen und einen Beitrag dazu zu leisten: Codeimplementierung, Testschreiben, Verbesserungen von Prozesstools, Verbesserungen der Dokumentation und mehr. Jeder Beitrag ist herzlich willkommen und Sie werden in die Mitwirkendenliste aufgenommen. Weitere Informationen finden Sie im Beitragsleitfaden ...

Dieses Projekt basiert auf langchain-chatchat und codebox-api, und ich möchte ihren Open-Source-Beiträgen meinen tiefen Dank aussprechen!