adaboost implementation

1.0.0

Dies ist eine Implementierung des AdaBoost-Algorithmus für ein Zwei-Klassen-Klassifizierungsproblem. Der Algorithmus wendet nacheinander eine schwache Klassifizierung auf geänderte Versionen der Daten an. Durch die Erhöhung der Gewichte der falsch klassifizierten Beobachtungen konzentriert sich jeder schwache Lernende auf den Fehler des vorherigen. Die Vorhersagen werden durch eine gewichtete Mehrheitsentscheidung aggregiert.

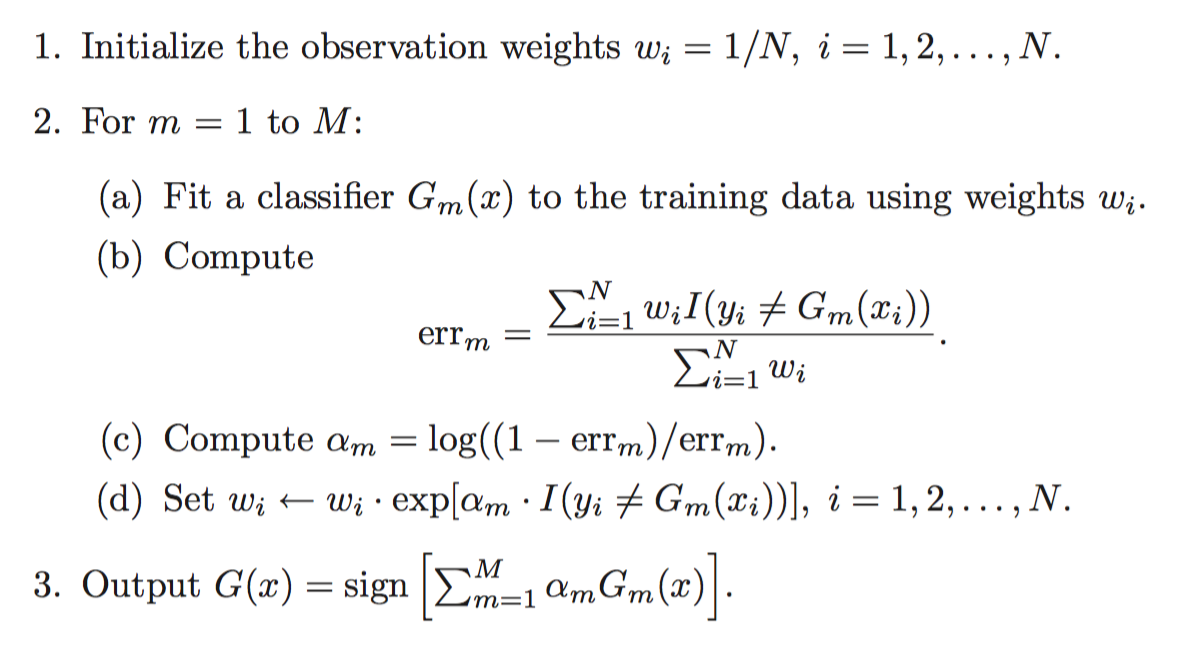

Adaboost-Algorithmus:

Mithilfe des Hastie-Datensatzes (10.2) können wir eine deutliche Reduzierung der Fehlerrate feststellen, wenn wir die Anzahl der Iterationen erhöhen.

Trevor Hastie, Robert Tibshirani, Jerome Friedman – Die Elemente des statistischen Lernens