PDF herunterladen • Über • Errata •

„Lernen Sie weiter, sonst riskieren Sie, irrelevant zu werden.“

In diesem ersten Band präsentiere ich bewusst einen kohärenten, kumulativen und inhaltsspezifischen Kernlehrplan des Bereichs Datenwissenschaft, der Themen wie Informationstheorie, Bayes'sche Statistik, algorithmische Differenzierung, logistische Regression, Perzeptrone und Faltungs-Neuronale Netze umfasst. Ich hoffe, dass Sie dieses Buch anregend finden.

Ich bin davon überzeugt, dass Sie, die Doktoranden und Arbeitssuchenden, für die das Buch in erster Linie gedacht ist, von der Lektüre profitieren werden. Ich hoffe jedoch, dass es auch die erfahrensten Forscher faszinieren wird.

Kontaktieren Sie Amir:

https://www.linkedin.com/in/amirivry/

https://scholar.google.com.mx/citations?user=rQCVwksAAAAJ&hl=iw

Kontaktieren Sie Shlomo:

https://www.linkedin.com/in/quantscientist/

https://scholar.google.com.mx/citations?user=bM0LGgcAAAAJ&hl

Dieses Buch kann über Amazon und andere Standardvertriebskanäle erworben werden. Bitte besuchen Sie die Website des Verlags, um das Buch zu bestellen oder weitere Informationen zu seiner Veröffentlichung zu erhalten. Ein Manuskript des Buches finden Sie unten – es wurde nur für den persönlichen Gebrauch zur Verfügung gestellt und darf nicht verkauft werden.

https://amazon.com/author/quantscientist

https://arxiv.org/abs/2201.00650

@misc{kashani2021deep,

title={Deep Learning Interviews: Hundreds of fully solved job interview questions from a wide range of key topics in AI},

author={Shlomo Kashani and Amir Ivry},

year={2021},

eprint={2201.00650},

note = {ISBN 13: 978-1-9162435-4-5 },

url = {https://www.interviews.ai},

archivePrefix={arXiv},

primaryClass={cs.LG}

}DER VERKAUF ODER DIE KOMMERZIELLE NUTZUNG IST STRENGSTENS UNTERSAGT . Die Benutzerrechte dieser E-Ressource sind in einer Lizenzvereinbarung unten festgelegt. Sie dürfen diese E-Ressource nur für private Studienzwecke verwenden. Jeglicher Verkauf/Weiterverkauf des Inhalts ist strengstens untersagt.

Dieses Buch (www.interviews.ai) wurde für Sie geschrieben: einen angehenden Datenwissenschaftler mit quantitativem Hintergrund, der sich den Herausforderungen des Interviewprozesses in einem zunehmend wettbewerbsintensiven Umfeld stellt. Für die meisten von Ihnen ist das Vorstellungsgespräch die größte Hürde auf dem Weg zu einem Traumjob. Auch wenn Sie über die Fähigkeit, den Hintergrund und die Motivation verfügen, in Ihrer Zielposition hervorragende Leistungen zu erbringen, benötigen Sie möglicherweise eine Anleitung, wie Sie einen Fuß in die Tür bekommen.

Die zweite Ausgabe von Deep Learning Interviews (das Amazon-Softcover ist in Schwarzweiß gedruckt) enthält Hunderte vollständig gelöster Probleme aus einem breiten Spektrum von Schlüsselthemen der KI. Es dient sowohl dem Üben von Interview- oder Prüfungsthemen als auch der Bereitstellung von maschinellem Lernen für M.Sc./Ph.D. Studierenden und Bewerbern, die auf ein Vorstellungsgespräch warten, einen übersichtlichen Überblick über das Fachgebiet. Die Probleme, die es mit sich bringt, sind so schwierig, dass man sich die Zähne ausbeißen und die eigenen Fähigkeiten dramatisch verbessern kann – aber sie werden von zum Nachdenken anregenden Fragen und fesselnden Geschichten umrahmt.

Das macht den Band für Studierende und Arbeitssuchende besonders wertvoll: Er vermittelt ihnen die Fähigkeit, zu jedem relevanten Thema sicher und schnell zu sprechen, technische Fragen klar und richtig zu beantworten und den Zweck und die Bedeutung von Interviewfragen vollständig zu verstehen und Antworten. Das sind starke, unverzichtbare Vorteile, wenn man den Interviewraum betritt.

Der Inhalt des Buches ist eine umfangreiche Auflistung zahlreicher Themen, die für DL-Vorstellungsgespräche und Abschlussprüfungen relevant sind. Damit steht diese Arbeit an der Spitze des wachsenden Trends in der Wissenschaft, einen Kernsatz praktischer mathematischer und rechnerischer Fähigkeiten zu vermitteln. Es ist allgemein anerkannt, dass die Ausbildung jedes Informatikers die grundlegenden Theoreme des ML beinhalten muss, und KI steht im Lehrplan fast jeder Universität. Dieser Band ist als hervorragendes Nachschlagewerk für Absolventen solcher Programme konzipiert.

Das Buch umfasst fast 400 Seiten

Hunderte vollständig gelöste Probleme

Probleme aus zahlreichen Bereichen des Deep Learning

Klare Diagramme und Illustrationen

Ein umfassender Index

Schritt-für-Schritt-Lösungen für Probleme

Nicht nur die gegebenen Antworten, sondern auch die gezeigte Arbeit

Nicht nur die gezeigte Arbeit, sondern gegebenenfalls auch die Begründung

Dieses Buch wurde für Sie geschrieben: einen angehenden Datenwissenschaftler mit quantitativem Hintergrund, der sich den Herausforderungen des Interviewprozesses in einem zunehmend wettbewerbsintensiven Umfeld stellt. Für die meisten von Ihnen ist das Vorstellungsgespräch die größte Hürde auf dem Weg zu einem Traumjob. Auch wenn Sie über die Fähigkeit, den Hintergrund und die Motivation verfügen, in Ihrer Zielposition hervorragende Leistungen zu erbringen, benötigen Sie möglicherweise eine Anleitung, wie Sie einen Fuß in die Tür bekommen. Ihre Neugier wird Sie durch die Problemstellungen, Formeln und Anweisungen des Buches führen und im Laufe der Zeit werden Sie Ihr Verständnis von Deep Learning vertiefen. Es gibt komplizierte Zusammenhänge zwischen Analysis, logistischer Regression, Entropie und Deep-Learning-Theorie; Wenn Sie das Buch durcharbeiten, werden sich diese Zusammenhänge intuitiv anfühlen.

Band I des Buches konzentriert sich auf statistische Perspektiven und verbindet Hintergrundgrundlagen mit Kernideen und praktischem Wissen. Es gibt spezielle Kapitel zu folgenden Themen:

Informationstheorie

Analysis und algorithmische Differenzierung

Bayesianisches Deep Learning und probabilistische Programmierung

Logistische Regression

Ensemble-Lernen

Merkmalsextraktion

Deep Learning: erweitertes Kapitel (über 100 Seiten)

Diese Kapitel erscheinen neben zahlreichen ausführlichen Behandlungen von Themen des Deep Learning mit Codebeispielen in PyTorch, Python und C++.

„PyTorch“ ist eine Marke von Facebook.

Copyright © Shlomo Kashani, Autor des Buches „Deep Learning Interviews“ Shlomo Kashani, Autor des Buches Deep Learning Interviews www.interviews.ai: [email protected]

Vielen Dank an alle Leser, die auf diese Probleme hingewiesen haben. Errata für die Druckversion vom 12.03.2020 und in der Online-Version wiedergegeben:

Die Frage Nr. PRB-267 -CH.PRB- 8.91 wurde aufgrund mangelnder Klarheit entfernt

Frage Nr. PRB-115 – CH.PRB- 5.16 wurde aufgrund mangelnder Klarheit entfernt

Errata für die Druckversion vom 12.05.2020 und in der Online-Version wiedergegeben:

Seite 230, Fragenummer PRB-178, „gestartete Kreuzvalidierung“ in „geschichtete Kreuzvalidierung“ ändern.

Auf Seite 231, Fragenummer PRB-181, wurde nach den Datenfalten ein „ .“ hinzugefügt

Seite 231, Fragenummer PRB-191, „an“ in „a“ ändern

Seite 234, Fragenummer PRB-192 „in“ zweimal wiederholt

Seite 236, Fragenummer PRB-194, „approached“ in „approaches“ ändern , „arr“ in „arr001“

Seite 247, Frage Nr. PRB-210 „an“ in „a“ ändern

Seite 258, Fragenummer PRB-227, „Eine Verwirrungsmetrik“ in „Eine Verwirrungsmatrix“ ändern .

Seite 271, Frage Nummer PRB-240 „MaxPool2D(4,4,)“ in „MaxPool2D(4,4)“ ändern

Seite 273, Frage Nr. PRB-243 „Identität“ in „identifizieren“ ändern

Seite 281, Fragenummer PRB-254 „vorschlagen“ in „vorschlagen“ ändern

Seite 283, Fragenummer PRB-256 „passiert“ falsch geschrieben

Seite 286, „L1, L2“ geändert in „Normen“

Seite 288, Frage Nr. SOL-184 „das Vollständige“ ändern in „ist das Vollständige“

Seite 298, Frage Nr. SOL-208 „ou1“ in „out“ ändern

Seite 319, Frage Nr. SOL-240: „Torch.Size([1, 32, 222, 222])“ ändern . zu „fackel.größe([1, 32, 222, 222]).“

Seite 283, Fragenummer PRB-256 „passiert“ wurde falsch geschrieben

Errata für die Druckversion vom 12.07.2020 und in der Online-Version wiedergegeben:

Seite 187, Fragenummer PRB-140, zwei fehlende Diagramme (6.3, 6.4), die in der Druckversion nicht korrekt wiedergegeben wurden

6.3

6.4 Errata für die Druckversion vom 21.09.2020 und in der Online-Version wiedergegeben:

Seite 34, Lösungsnummer SOL-19 , 0,21886 sollte 0,21305 sein und 0,21886 ± 1,95 × 0,21886 sollte 0,21305 ± 1,95 × 0,21886 sein

Seite 36-7, Lösungsnummer SOL-21 , 4,8792/0,0258 = 189,116 und nicht 57,3 und pi(33) = 0,01748 und nicht pi(33) = 0,211868 .

Seite 49, PRB-47 „Wie hoch ist die Wahrscheinlichkeit, dass der Experte ein Affe ist?“ sollte lauten: „Wie hoch ist die Wahrscheinlichkeit, dass der Experte ein Mensch ist?“

Errata für die Druckversion vom 22.09.2020 und in der Online-Version wiedergegeben:

Seite 73, Lösungsnummer SOL-56 sollte lauten: „Das Hessesche wird durch Differenzieren erzeugt.“

Seite 57, Problemnummer PRB-65 sollte „ zwei Neuronen“ lauten.

Errata für die Druckversion vom 24.09.2020 und in der Online-Version wiedergegeben:

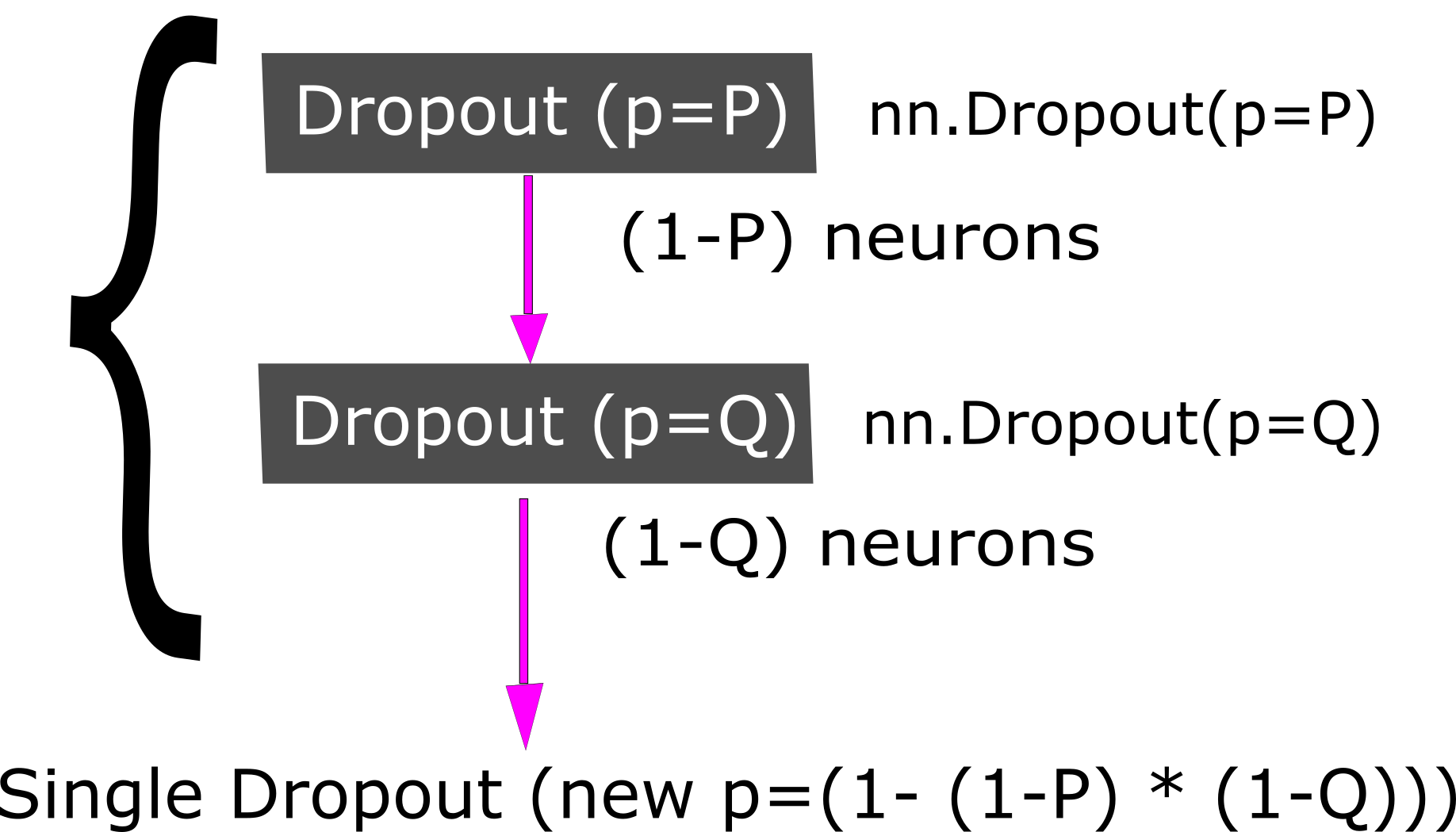

Seite 78, Lösungsnummer SOL-64 , der OnOffLayer ist nur ausgeschaltet, wenn mindestens 150 von 200 Neuronen ausgeschaltet sind. Daher kann dies als Binomialverteilung dargestellt werden und die Wahrscheinlichkeit, dass die Schicht nicht korrekt ist, ist: