GPT-2 ist ein Sprachmodell, das gelernt hat, das nächste Wort in einem bestimmten Text gut vorherzusagen, und das für die Satzgenerierung optimiert ist. KoGPT2 ist ein koreanisches decoder Sprachmodell, das mit über 40 GB Text gelernt wurde, um unzureichende koreanische Sprachleistung zu überwinden.

|

Trainiert mit Character BPE tokenizer aus dem tokenizers -Paket.

Die Wörterbuchgröße beträgt 51.200, und die Erkennungsfähigkeit der Token wurde durch das Hinzufügen von Emoticons und Emojis erhöht, wie sie beispielsweise häufig in Gesprächen verwendet werden, wie unten gezeigt.

?, ?, ?, ?, ?, .. ,

:-),:),-),(-:...

Darüber hinaus wurden nicht verwendete Token wie <unused0> bis <unused99> definiert, sodass diese je nach erforderlicher Aufgabe frei definiert und verwendet werden können.

> from transformers import PreTrainedTokenizerFast

> tokenizer = PreTrainedTokenizerFast . from_pretrained ( "skt/ KoGPT2 -base-v2" ,

bos_token = '</s>' , eos_token = '</s>' , unk_token = '<unk>' ,

pad_token = '<pad>' , mask_token = '<mask>' )

> tokenizer . tokenize ( "안녕하세요. 한국어 GPT-2 입니다.?:)l^o" )

[ '▁안녕' , '하' , '세' , '요.' , '▁한국어' , '▁G' , 'P' , 'T' , '-2' , '▁입' , '니다.' , '?' , ':)' , 'l^o' ]| Modell | Anzahl der Parameter | Typ | Anzahl der Schichten | Anzahl der Köpfe | ffn_dim | versteckte_dims |

|---|---|---|---|---|---|---|

KoGPT2 -base-v2 | 125M | Decoder | 12 | 12 | 3072 | 768 |

> import torch

> from transformers import GPT2LMHeadModel

> model = GPT2LMHeadModel . from_pretrained ( 'skt/ KoGPT2 -base-v2' )

> text = '근육이 커지기 위해서는'

> input_ids = tokenizer . encode ( text , return_tensors = 'pt' )

> gen_ids = model . generate ( input_ids ,

max_length = 128 ,

repetition_penalty = 2.0 ,

pad_token_id = tokenizer . pad_token_id ,

eos_token_id = tokenizer . eos_token_id ,

bos_token_id = tokenizer . bos_token_id ,

use_cache = True )

> generated = tokenizer . decode ( gen_ids [ 0 ])

> print ( generated )

근육이 커지기 위해서는 무엇보다 규칙적인 생활습관이 중요하다 .

특히 , 아침식사는 단백질과 비타민이 풍부한 과일과 채소를 많이 섭취하는 것이 좋다 .

또한 하루 30 분 이상 충분한 수면을 취하는 것도 도움이 된다 .

아침 식사를 거르지 않고 규칙적으로 운동을 하면 혈액순환에 도움을 줄 뿐만 아니라 신진대사를 촉진해 체내 노폐물을 배출하고 혈압을 낮춰준다 .

운동은 하루에 10 분 정도만 하는 게 좋으며 운동 후에는 반드시 스트레칭을 통해 근육량을 늘리고 유연성을 높여야 한다 .

운동 후 바로 잠자리에 드는 것은 피해야 하며 특히 아침에 일어나면 몸이 피곤해지기 때문에 무리하게 움직이면 오히려 역효과가 날 수도 있다 ...| NSMC(acc) | KorSTS (Speerkämpfer) | |

|---|---|---|

| KoGPT2 2.0 | 89,1 | 77,8 |

Zusätzlich zur koreanischen Wikipedia wurden verschiedene Daten wie Nachrichten und jedermanns Korpus v1.0 zum Trainieren des Modells verwendet.

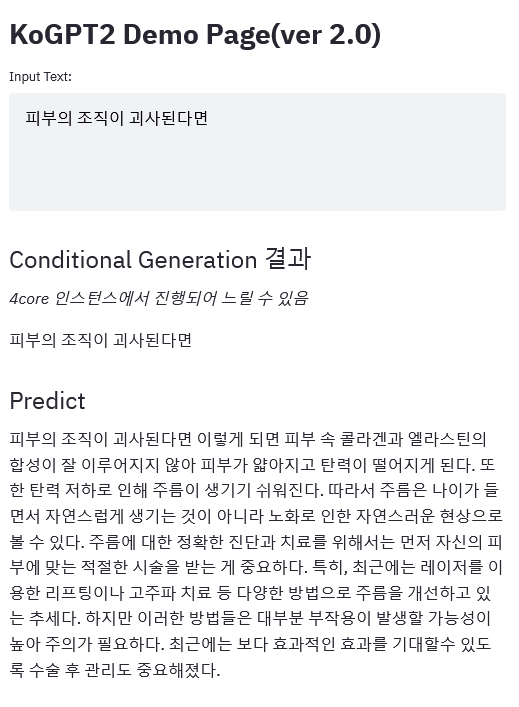

Demo-Link

|

Bitte posten Sie hier Probleme im Zusammenhang mit KoGPT2 .

KoGPT2 wird unter der CC-BY-NC-SA 4.0-Lizenz veröffentlicht. Bitte beachten Sie bei der Verwendung von Modellen und Codes die Lizenzbedingungen. Die vollständige Lizenz finden Sie in der LICENSE-Datei.