Operante Konditionierung ist ein klassisches Paradigma der experimentellen Psychologie, bei dem Tiere lernen, eine Aktion auszuführen, um eine Belohnung zu erhalten. Mithilfe dieses Paradigmas ist es möglich, Lernkurven zu extrahieren und Reaktionszeiten genau zu messen. Hier beschreiben wir ein vollständig 3D-druckbares Gerät, das in der Lage ist, operante Konditionierung an frei beweglichen Mäusen durchzuführen und gleichzeitig die Position des Tieres in Echtzeit zu verfolgen.

3D-gedruckte Modelle finden Sie hier oder hier.

In Figures/EXPLODED VIEW.jpg gibt es ein intuitives Diagramm des Montageschemas. Alle Bauteile haben wir mit Cura 4.0 mit mittlerer Auflösung (100 µm), einer Geschwindigkeit von 90 mm/s und einer Füllung von 20 % gedruckt. Das Design der OC-Kammer ist recht einfach, sodass fast alle Drucker ausreichend präzise sind, um die gesamte Kammer erfolgreich zu drucken.

Eine Liste aller Komponenten finden Sie hier: Stückliste

OC-KAMMER

KAMERA

LIEFERUNG

Zusätzlich benötigen Sie:

Verbinden Sie alle Komponenten wie in Figures/Diagram_Scheme.png beschrieben

Um die Software auf dem Raspberry Pi (RPI) zu installieren, laden Sie einfach den gesamten Code herunter oder kopieren Sie ihn in einen Ordner des Raspian OS.

Python

Arduino

Kompilieren und laden Sie den Sketch namens „skinner.ino“ auf den Arduino UNO

Um die Schwellenwerte kapazitiver Sensoren zu kalibrieren, laden Sie die Arduino-Skizze „skinnerCapacitiveTest“. Diese Funktion druckt lediglich die kapazitiven Sensorwerte der seriellen Schnittstelle aus. Es ist hilfreich, den richtigen Schwellenwert für die Erkennung von Mausberührungen festzulegen.

Um den Code auszuführen, geben Sie im Terminal Folgendes ein:

cd h ome p i o c_chamber \ or replace with the folder path containing the scpript

python3 cvConditioningTracking.pyAlternativ können Sie cvConditioningTracking in der IDLE-IDE öffnen und F5 drücken.

Der Benutzer kann einige der Low-Level-Parameter der Experimente anpassen, indem er den Wert der Variablen in den ersten 25 Zeilen der Datei cvConditioningTracking.py bearbeitet. Eine detailliertere Erläuterung dieser Parameter finden Sie in der Datei selbst.

Die Kammer kann Experimente in zwei Modi durchführen: Trainingsmodus und Permutationsmodus . Der Benutzer kann einen der beiden Modi auswählen, indem er den Parameter task in der cvConditioningTracking-Datei bearbeitet. Die Details und Unterschiede der beiden Modi finden Sie im Dokument.

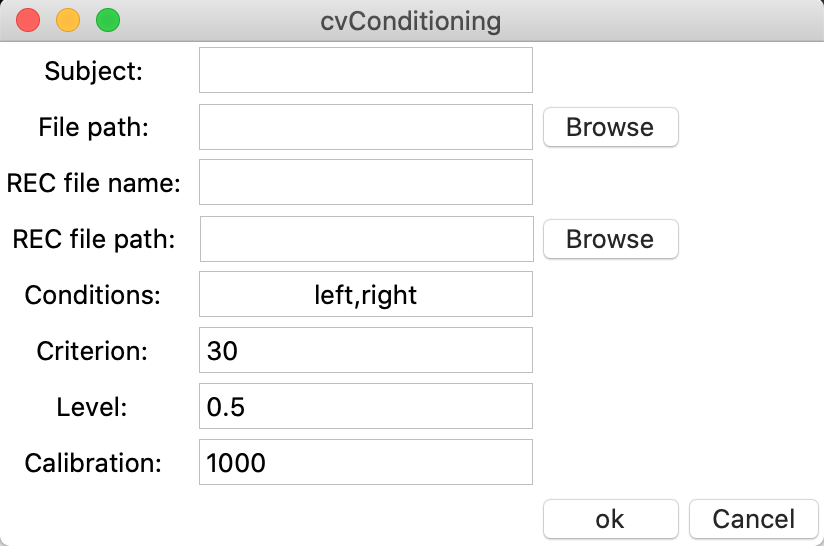

Zu Beginn der Experimente wird dem Benutzer eine grafische Benutzeroberfläche angezeigt, die einige grundlegende Informationen zu den Experimenten sammelt, die gerade ausgeführt werden.

Betreff: Eine Zeichenfolge, die eine Kennung für die aktuelle Maus enthält. Wenn es leer bleibt, wird keine Datei gespeichert.

Dateipfad: Speicherort zum Speichern der Experimentdatei. Die Ausgabe besteht aus zwei .txt-Dateien, die den Datensatz des Experiments enthalten, wie im Abschnitt „Datensatz“ beschrieben, gespeichert im Ordner DATA und DATAtracker. Der Benutzer kann nach einem Speicherort auf dem PC suchen. Wenn das Feld leer bleibt, wird standardmäßig das aktuelle Arbeitsverzeichnis verwendet.

REC-Dateiname: Eine Zeichenfolge, die den Namen enthält, der zum Speichern der Videoaufzeichnung verwendet werden soll. Wenn es leer bleibt, wird keine Datei gespeichert.

REC-Dateipfad: Speicherort der Videoaufzeichnung mit einem Overlay, das die Mausposition und den aktiven Bereich enthält. Der Benutzer kann nach einem Speicherort auf dem PC suchen. Wenn das Feld leer bleibt, wird standardmäßig das aktuelle Arbeitsverzeichnis verwendet.

Bedingungen: Experimentelle Bedingungen. Die Liste der Reize, die im Experiment präsentiert werden. Es können eine oder mehrere durch Komma getrennte Bedingungen angegeben werden:

Alle hier angegebenen Bedingungen werden in zufälliger Reihenfolge angezeigt.

Kriterium: Anzahl der Frames, die erforderlich sind, damit die Maus im aktiven Bereich bleibt, um einen Versuch zu aktivieren. 20 Bilder = 1 Sek

Ebene: Wählen Sie die vertikale Position der Linie aus, die den aktiven Bereich der Kammer vom inaktiven trennt. Der Wert ist auf die Kammerhöhe normiert. 0 = Boden der Kammer, 1 = Oberseite der Kammer, 0,5 (Standard) = Mitte der Kammer

Kalibrierung: Anzahl der Bilder, die zu Beginn des Experiments für die Kamerakalibrierung verwendet werden sollen. Die Kalibrierung der Kamera zu Beginn des Experiments ist wichtig, um die Maus besser über den Hintergrund verfolgen zu können.

Weitere Anpassungsoptionen sind verfügbar, indem Sie die ersten Zeilen der folgenden Dateien bearbeiten:

Um die Verwendung komplexerer visueller Reize zu ermöglichen, gibt es eine Backbone-Version des Codes, die mit einem LCD-Display funktioniert. Um den Code auszuführen, ist Psychopy2 erforderlich. Um Psychopy auf RPI zu installieren, befolgen Sie diese Anweisungen. Sobald Psychopy installiert ist, öffnen Sie cvConditioningTracking.py in der Psychopy-IDE und führen Sie den Code aus. Dieser Code enthält ein Modul namens LCD.py, mit dem ausgewählte Bilder angezeigt werden können. Derzeit handelt es sich bei dem Code um einen Stub, eine ungetestete Version, der zu Demonstrationszwecken ausgeführt wird.

Der Datensatzordner enthält unsere in diesem Dokument beschriebenen Rohdaten mit 6 Themen. Jedes Subjekt ist in einem eigenen Ordner enthalten und nach dem Schema CAGE-LABEL-GENO codiert. Darüber hinaus gibt es zwei Jupyter Notebooks mit einem Beispiel, wie man TXT-Ausgabedateien in Python als Pandas-Dataframes lesen kann.

Eine detaillierte Beschreibung des Geräts finden Sie hier: 3D-druckbares Gerät zur automatisierten operanten Konditionierung in der Maus

Für weitere Informationen und Fehlerbehebung zögern Sie nicht, uns unter zu kontaktieren