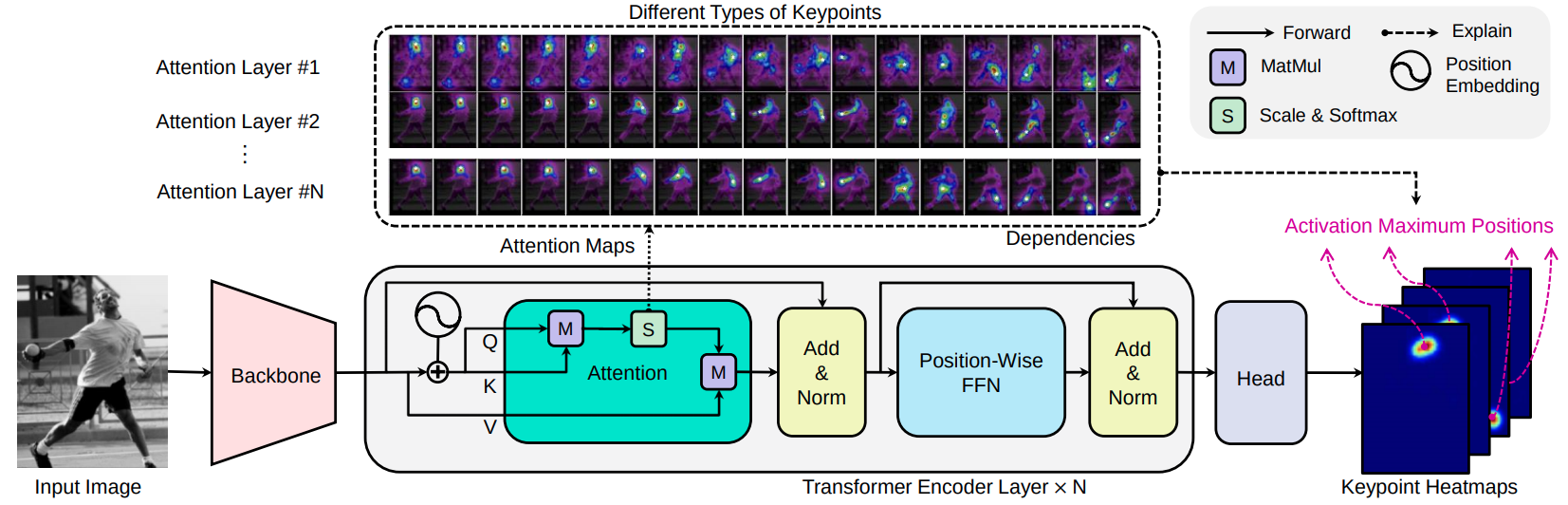

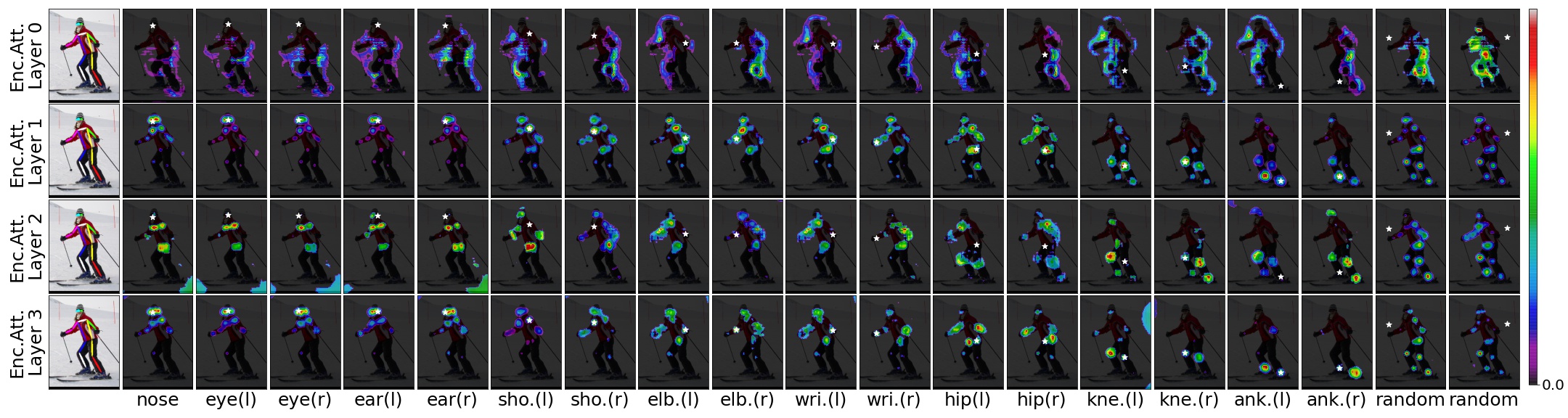

Transponieren ist ein menschliches Pose -Schätzmodell, das auf einem CNN -Merkmalextraktor, einem Transformator -Encoder und einem Vorhersagekopf basiert. Bei einem Bild können die im Transformator eingebauten Aufmerksamkeitsschichten effizient räumliche Beziehungen zwischen Tastoint und Abhängigkeiten der vorhergesagten Tastoint-Standorte effizient aufnehmen.

[ARXIV 2012.14214] [Papier] [Demo-notebook]

Transponierung: Tastoint -Lokalisierung über Transformator, Sen Yang, Zhibin Quan, Mu Nie, Wankou Yang, ICCV 2021

Wir wählen zwei Arten von CNNs als Backbone -Kandidaten: Resnet und HRNET. Die abgeleiteten Faltungsblöcke sind Resnet-Small, HRNet-Small-W32 und HRNet-Small-W48.

| Modell | Rückgrat | #TATTENTENTIONS -LEGEN | D | H | #Heads | #Params | AP (Coco Val GT Bbox) | Herunterladen |

|---|---|---|---|---|---|---|---|---|

| Transponieren-R-A3 | Resnet-s | 3 | 256 | 1024 | 8 | 5.2mb | 73,8 | Modell |

| Transponieren-R-A4 | Resnet-s | 4 | 256 | 1024 | 8 | 6,0 MB | 75.1 | Modell |

| Transponieren-HS | HRNET-S-W32 | 4 | 64 | 128 | 1 | 8,0 MB | 76.1 | Modell |

| Transponieren-H-A4 | HRNET-S-W48 | 4 | 96 | 192 | 1 | 17,3 MB | 77,5 | Modell |

| Transponieren-H-A6 | HRNET-S-W48 | 6 | 96 | 192 | 1 | 17,5 MB | 78.1 | Modell |

Probieren Sie die Web -Demo aus:

Sie können Transponieren von Transponieren-R-A4 oder Transponierungs-H-A4-Modellen mit vorbereiteten Gewichten auf dem Datassatz von CoCO Train2017 von Torch Hub direkt laden, einfach nur von:

import torch

tpr = torch . hub . load ( 'yangsenius/TransPose:main' , 'tpr_a4_256x192' , pretrained = True )

tph = torch . hub . load ( 'yangsenius/TransPose:main' , 'tph_a4_256x192' , pretrained = True )| Modell | Eingangsgröße | Fps* | Gflops | AP | AP .5 | AP .75 | AP (m) | AP (l) | Ar | AR .5 | AR .75 | ARM) | AR (l) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transponieren-R-A3 | 256x192 | 141 | 8.0 | 0,717 | 0,889 | 0,788 | 0,680 | 0,786 | 0,771 | 0,930 | 0,836 | 0,727 | 0,835 |

| Transponieren-R-A4 | 256x192 | 138 | 8.9 | 0,726 | 0,891 | 0,799 | 0,688 | 0,798 | 0,780 | 0,931 | 0,845 | 0,735 | 0,844 |

| Transponieren-HS | 256x192 | 45 | 10.2 | 0,742 | 0,896 | 0,808 | 0,706 | 0,810 | 0,795 | 0,935 | 0,855 | 0,752 | 0,856 |

| Transponieren-H-A4 | 256x192 | 41 | 17.5 | 0,753 | 0,900 | 0,818 | 0,717 | 0,821 | 0,803 | 0,939 | 0,861 | 0,761 | 0,865 |

| Transponieren-H-A6 | 256x192 | 38 | 21.8 | 0,758 | 0,901 | 0,821 | 0,719 | 0,828 | 0,808 | 0,939 | 0,864 | 0,764 | 0,872 |

Notiz:

| Modell | Eingangsgröße | #Params | Gflops | AP | AP .5 | AP .75 | AP (m) | AP (l) | Ar | AR .5 | AR .75 | ARM) | AR (l) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transponieren-HS | 256x192 | 8,0 m | 10.2 | 0,734 | 0,916 | 0,811 | 0,701 | 0,793 | 0,786 | 0,950 | 0,856 | 0,745 | 0,843 |

| Transponieren-H-A4 | 256x192 | 17,3 m | 17.5 | 0,747 | 0,919 | 0,822 | 0,714 | 0,807 | 0,799 | 0,953 | 0,866 | 0,758 | 0,854 |

| Transponieren-H-A6 | 256x192 | 17,5 m | 21.8 | 0,750 | 0,922 | 0,823 | 0,713 | 0,811 | 0,801 | 0,954 | 0,867 | 0,759 | 0,859 |

Jupyter Notebook Demo

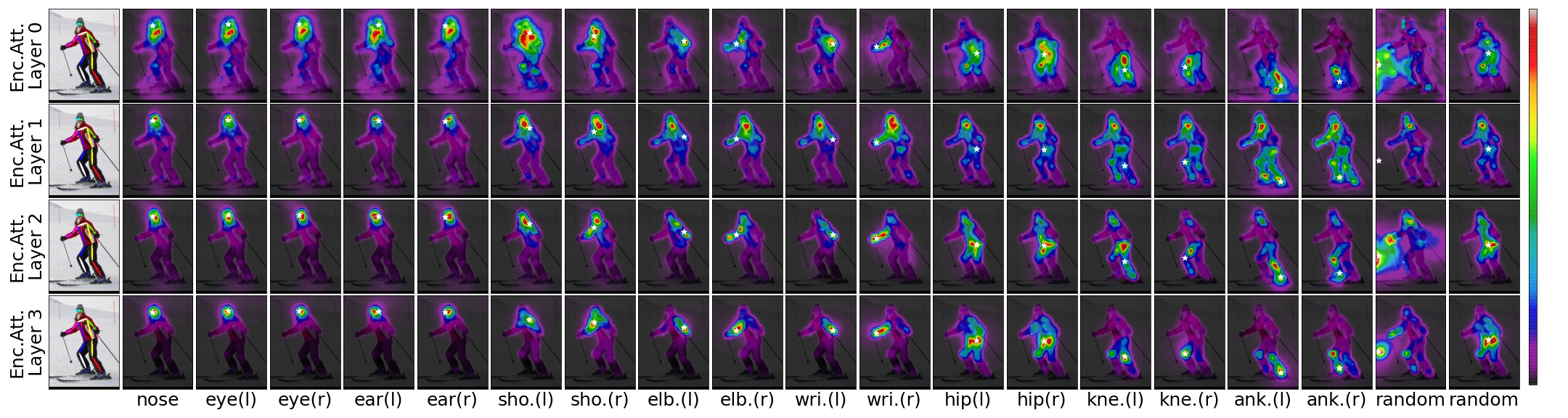

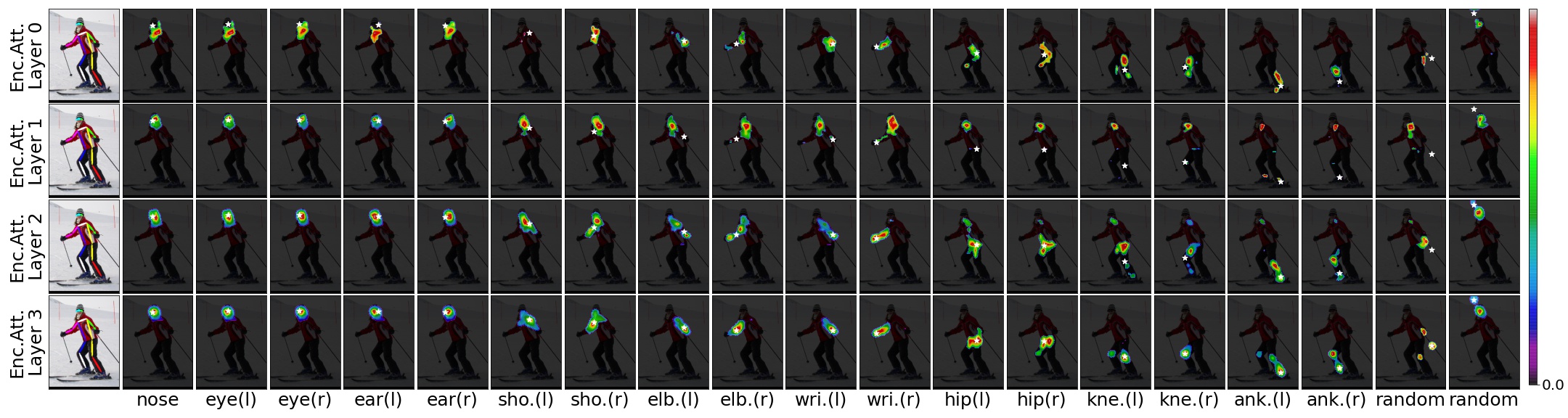

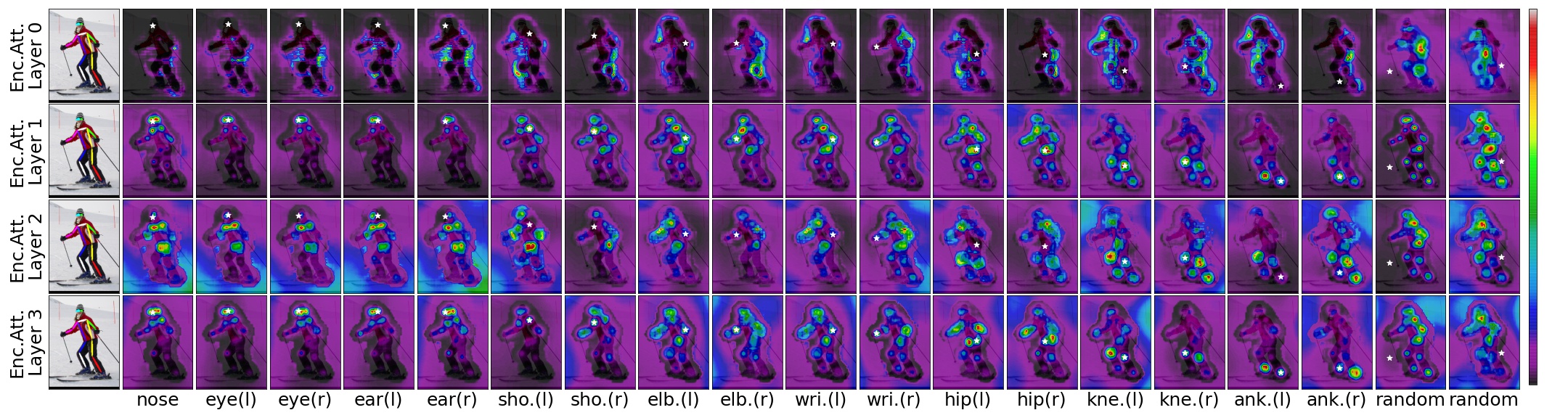

Bei einem Eingangsbild, einem vorgezogenen Transponierungsmodell und den vorhergesagten Stellen können wir die räumlichen Abhängigkeiten der vorhergesagten Stellen mit Schwellenwert für die Aufmerksamkeitswerte visualisieren.

TransPose-R-A4 mit threshold=0.00

TransPose-R-A4 mit threshold=0.01

TransPose-H-A4 mit threshold=0.00

TransPose-H-A4 mit threshold=0.00075

Klonen Sie dieses Repository, und wir nennen das Verzeichnis, das Sie als $ {pose_root} kloniert haben

git clone https://github.com/yangsenius/TransPose.gitInstallieren Sie Pytorch> = 1.6 und Torchvision> = 0,7 von der offiziellen Website von Pytorch

Paketabhängigkeiten installieren. Stellen Sie sicher, dass die Python -Umgebung> = 3,7

pip install -r requirements.txtMachen Sie Ausgabe (Trainingsmodelle und -dateien) und Protokoll (Tensorboard -Protokoll) unter $ {pose_root} & machen Sie Libs

mkdir output log

cd ${POSE_ROOT} /lib

makeLaden Sie vorgezogene Modelle von den Veröffentlichungen dieses Repo in das angegebene Verzeichnis herunter

$ {POSE_ROOT}

`-- models

`-- pytorch

|-- imagenet

| |-- hrnet_w32-36af842e.pth

| |-- hrnet_w48-8ef0771d.pth

| |-- resnet50-19c8e357.pth

|-- transpose_coco

| |-- tp_r_256x192_enc3_d256_h1024_mh8.pth

| |-- tp_r_256x192_enc4_d256_h1024_mh8.pth

| |-- tp_h_32_256x192_enc4_d64_h128_mh1.pth

| |-- tp_h_48_256x192_enc4_d96_h192_mh1.pth

| |-- tp_h_48_256x192_enc6_d96_h192_mh1.pth Wir befolgen die Schritte von HRNET, um den Coco -Zug/Val/Test -Datensatz und die Anmerkungen vorzubereiten. Die erfassten Personenergebnisse werden von OneDrive oder googledrive heruntergeladen. Bitte laden Sie sie herunter oder verlinken Sie sie mit $ {pose_root}/data/coco/und lassen Sie sie so aussehen:

$ {POSE_ROOT}/data/coco/

| -- annotations

| |-- person_keypoints_train2017.json

| `-- person_keypoints_val2017.json

| -- person_detection_results

| |-- COCO_val2017_detections_AP_H_56_person.json

| `-- COCO_test-dev2017_detections_AP_H_609_person.json

`-- images

|-- train2017

| |-- 000000000009.jpg

| |-- ...

`-- val2017

|-- 000000000139.jpg

|-- ... python tools/test.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yaml TEST.USE_GT_BBOX Truepython tools/train.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yamlTolles Dankeschön für diese Papiere und ihre Open-Source

Dieses Repository wird unter der MIT -Lizenz veröffentlicht.

Wenn Sie dieses Repository nützlich finden, geben Sie ihm bitte einen Stern? Oder überlegen Sie, ob Sie unsere Arbeit zitieren:

@inproceedings{yang2021transpose,

title={TransPose: Keypoint Localization via Transformer},

author={Yang, Sen and Quan, Zhibin and Nie, Mu and Yang, Wankou},

booktitle={IEEE/CVF International Conference on Computer Vision (ICCV)},

year={2021}

}