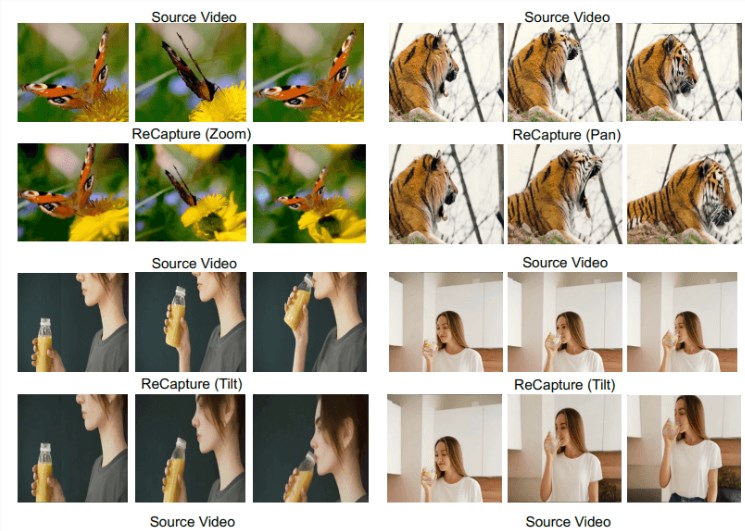

Der Herausgeber von Downcodes erklärt Ihnen, wie die Google ReCapture-Technologie funktioniert und wie diese bahnbrechende Technologie die Videobearbeitung verändern wird! Mit ReCapture können normale Benutzer problemlos Kamerabewegungsanpassungen auf professionellem Niveau vornehmen, die Videoobjektivsprache neu gestalten und revolutionäre Änderungen in der Videopostproduktion mit sich bringen. Diese Technologie basiert nicht mehr auf herkömmlichen 4D-Zwischendarstellungsmethoden, sondern nutzt geschickt das Bewegungswissen generativer Videomodelle, um die Videobearbeitung in einen Video-zu-Video-Konvertierungsprozess umzuwandeln, wodurch der Vorgang erheblich vereinfacht wird und die Eigenschaften des Videos erhalten bleiben und Bildqualität.

Die neueste vom Google-Forschungsteam eingeführte ReCapture-Technologie untergräbt die traditionelle Videobearbeitungsmethode. Diese Innovation ermöglicht es normalen Benutzern, auf einfache Weise Kamerabewegungsanpassungen auf professionellem Niveau vorzunehmen und die Objektivsprache für bereits aufgenommene Videos neu zu gestalten.

In der herkömmlichen Video-Postproduktion war das Ändern des Kamerawinkels eines aufgenommenen Videos schon immer ein technisches Problem. Wenn bestehende Lösungen unterschiedliche Arten von Videoinhalten verarbeiten, ist es oft schwierig, komplexe Kamerabewegungseffekte und Bilddetails gleichzeitig beizubehalten. ReCapture verfolgt einen anderen Ansatz und verwendet nicht die herkömmliche 4D-Zwischendarstellungsmethode, sondern nutzt stattdessen geschickt das im generativen Videomodell gespeicherte Bewegungswissen und definiert die Aufgabe durch stabile Videodiffusion als Video-zu-Video-Konvertierungsprozess neu.

Das System verwendet einen zweistufigen Workflow. In der ersten Stufe wird das Ankervideo generiert, bei dem es sich um die erste Ausgabeversion mit der neuen Kameraposition handelt. Diese Stufe kann durch die Erstellung von Mehrwinkelvideos mithilfe von Diffusionsmodellen wie CAT3D oder durch Einzelbild-Tiefenschätzung und Punktwolken-Rendering erreicht werden. Obwohl diese Version möglicherweise einige zeitliche Inkonsistenzen und visuelle Mängel aufweist, legte sie den Grundstein für Phase Zwei.

In der zweiten Phase wird eine Feinabstimmung des maskierten Videos durchgeführt. Dabei wird ein generatives Videomodell genutzt, das auf vorhandenem Filmmaterial trainiert wurde, um realistische Bewegungseffekte und Timing-Änderungen zu erzeugen. Das System führt eine zeitliche LoRA-Schicht (Low Rank Adaptation) ein, um das Modell so zu optimieren, dass es die spezifischen dynamischen Eigenschaften von Ankervideos verstehen und reproduzieren kann, ohne das gesamte Modell neu zu trainieren. Gleichzeitig sorgt die räumliche LoRA-Schicht dafür, dass Bilddetails und Inhalte mit der neuen Kamerabewegung übereinstimmen. Dadurch kann das generative Videomodell Vorgänge wie Zoomen, Schwenken und Neigen ausführen und dabei die charakteristische Bewegung des Originalvideos beibehalten.

Obwohl ReCapture wichtige Fortschritte bei der benutzerfreundlichen Videoverarbeitung gemacht hat, befindet es sich noch im Forschungsstadium und ist noch weit von einer kommerziellen Anwendung entfernt. Es ist erwähnenswert, dass Google zwar viele Video-KI-Projekte hat, diese jedoch noch nicht auf den Markt gebracht hat. Unter ihnen ist das Veo-Projekt möglicherweise das am nächsten kommende kommerzielle Projekt. Ebenso wurden das kürzlich eingeführte Movie-Gen-Modell von Meta und das zu Beginn des Jahres veröffentlichte Sora von OpenAI noch nicht kommerzialisiert. Derzeit wird der Video-KI-Markt hauptsächlich von Start-ups wie Runway angeführt, das im vergangenen Sommer sein neuestes Gen-3Alpha-Modell auf den Markt brachte.

Das Aufkommen der ReCapture-Technologie läutet die zukünftige Entwicklungsrichtung im Bereich der Videobearbeitung ein. Obwohl sie sich noch im Forschungsstadium befindet, werden ihre leistungsstarken Funktionen und praktischen Bedienungsmethoden zweifellos mehr Möglichkeiten für die Videoerstellung eröffnen. Wir freuen uns auf die baldige Reife und kommerzielle Anwendung dieser Technologie in der Zukunft, die der Mehrheit der Benutzer ein komfortableres und effizienteres Videobearbeitungserlebnis bieten wird.