In letzter Zeit hat sich der Wettbewerb zwischen den KI-Giganten Google und OpenAI verschärft. Die beiden Parteien konkurrieren hart um die Entwicklung und Iterationsgeschwindigkeit großer Sprachmodelle. Das neu veröffentlichte Modell Gemini-Exp-1121 von Google hat das GPT-4o von OpenAI in vielen Schlüsselindikatoren übertroffen und belegt erneut den Spitzenplatz im KI-Wettbewerb. Der Herausgeber von Downcodes wird Ihnen einen detaillierten Einblick in diesen „Blitz“ im Bereich der KI sowie die neuesten Fortschritte in Technologie und Funktionalität zwischen beiden Parteien geben.

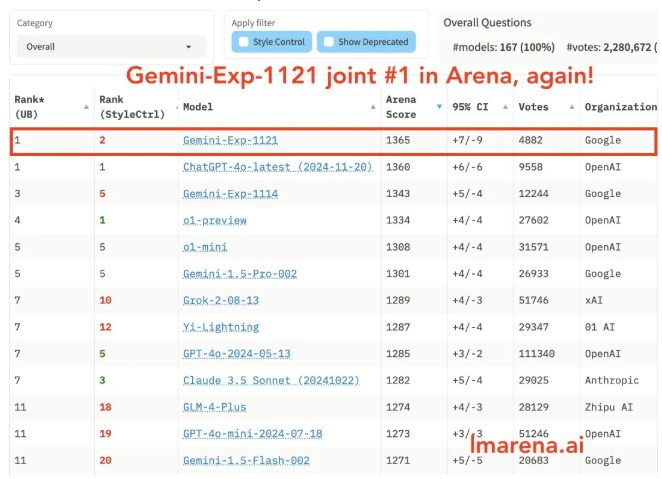

In letzter Zeit hat sich der Wettbewerb zwischen Google und OpenAI erneut verschärft. Nur einen Tag nachdem die neue Version von GPT-4o die KI-Wettbewerbsliste anführte, brachte Google das neueste experimentelle Modell Gemini-Exp-1121 auf den Markt und eroberte sich schnell die Meisterschaft zurück. Erst vor einer Woche veröffentlichte Google Gemini-Exp-1114, was darauf hindeutet, dass Google sehr schnell auf die Dynamik von OpenAI reagiert hat.

Jack Rae, Chefwissenschaftler von Google DeepMind, sagte, dies sei ein „Blitz“, was bedeutet, dass die Iterationsgeschwindigkeit nach dem Training schneller sei als vor dem Training.

Nach offiziellen Angaben wurde Gemini-Exp-1121 in vielen Aspekten deutlich verbessert, was sich vor allem in der Verbesserung der Codierungs-, Argumentations- und visuellen Verständnisfähigkeiten widerspiegelt. Darüber hinaus hat dieses Modell bei der Stilkontrolle komplexer Aufforderungswörter ein Niveau erreicht, das mit dem aktuellen Top-O1-Preview und New Sonnet3.5 vergleichbar ist.

In tatsächlichen Tests schnitt Gemini-Exp-1121 auch beim Verstehen von Comics besser ab als die neue Version von GPT-4o. Die Antworten waren umfassender und es konnten eindeutig Untertitel und fette Hervorhebungen zur Darstellung von Informationen verwendet werden. Bei der klassischen Frage zum logischen Denken von Animal Crossing River war die Antwort von Gemini-Exp-1121 völlig richtig und zeigte eine stärkere Fähigkeit zum logischen Denken. Andererseits machte die neue Version von GPT-4o einige Fehler.

Gleichzeitig entwickelt OpenAI auch aktiv neue Funktionen. Kürzlich wurde der Code für die „Live-Kamera“-Videofunktion in der neuesten Version von ChatGPT entdeckt, was seine Fortschritte bei der Sprach- und visuellen Erkennung markiert. OpenAI-Benutzer werden diese Funktion auch zum ersten Mal erleben, wenn sie den erweiterten Sprachmodus verwenden, was die Absicht zeigt, die Verwendung dieser Funktion in Zukunft auszuweiten.

Es ist absehbar, dass sich die Hauptkommunikationsmethode mit Chatbot im nächsten Jahr schrittweise vom traditionellen Textdialog auf Sprach- und intelligentere Agentendienste verlagern wird. Diese Änderung könnte durch die Einführung der „Live-Kamera“-Funktion vorangetrieben werden.

Dieser KI-Wettbewerb dauert immer noch an und Google und OpenAI jagen sich gegenseitig, was darauf hindeutet, dass die KI-Technologie auch in Zukunft für Durchbrüche und Innovationen sorgen und den Benutzern bequemere und intelligentere Dienste bieten wird. Warten wir ab, wer am Ende gewinnt!