Der Herausgeber von Downcodes erfuhr, dass im Bereich der Videogenerierung erhebliche Fortschritte erzielt wurden! Genmo hat sein neuestes Videogenerierungsmodell Mochi1 als Open Source bereitgestellt, das über 10 Milliarden Parameter verfügt und das größte derzeit öffentlich veröffentlichte Videogenerierungsmodell ist. Mochi1 nutzt die innovative Asymmetric Diffusion Transformer (AsymmDiT)-Architektur, die einfach und leicht zu modifizieren ist, den Entwicklern der Open-Source-Community großen Komfort bietet und hochwertige Videos mit einer Länge von bis zu 5,4 Sekunden und einer Bildrate von bis zu 30 erzeugen kann Bilder/Sekunde.

Im Bereich der Videogenerierung ist ein großer Durchbruch gelungen! Genmo hat sein neuestes Videogenerierungsmodell, Mochi1, als Open Source bereitgestellt und damit einen neuen Maßstab im Bereich der Videogenerierung gesetzt. Mochi1 nutzt die innovative Asymmetric Diffusion Transformer (AsymmDiT)-Architektur und verfügt über bis zu 10 Milliarden Parameter, was es zum bislang größten öffentlich veröffentlichten Videogenerierungsmodell macht.

Noch wichtiger ist, dass es komplett von Grund auf trainiert wird und über eine einfache und modifizierbare Architektur verfügt, die Entwicklern in der Open-Source-Community großen Komfort bietet.

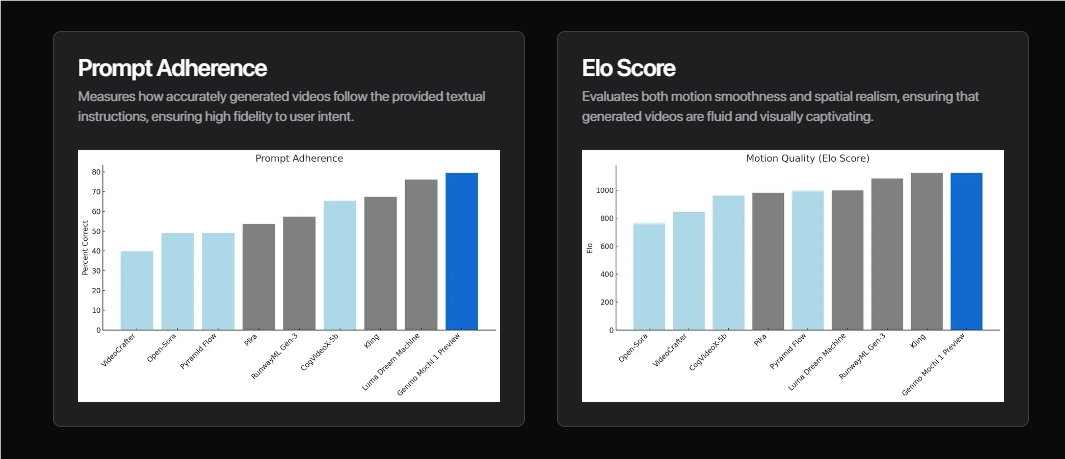

Das größte Highlight von Mochi1 ist seine hervorragende Bewegungsqualität und die präzise Einhaltung von Textansagen. Es ist in der Lage, flüssige Videos mit einer Länge von bis zu 5,4 Sekunden und einer Bildrate von bis zu 30 Bildern/Sekunde zu erzeugen, mit atemberaubender zeitlicher Kohärenz und realistischer Bewegungsdynamik.

Mochi1 kann auch verschiedene physikalische Phänomene simulieren, wie z. B. Fluiddynamik, Haarsimulation usw. Die von ihm generierten Charaktere haben natürliche und sanfte Bewegungen, die fast mit realen Darbietungen vergleichbar sind.

Um Entwicklern die Verwendung zu erleichtern, hat Genmo auch seine Video-VAE als Open-Source-Lösung bereitgestellt, mit der das Video auf 1/128 der Originalgröße komprimiert werden kann, wodurch der Rechenaufwand und der Speicherbedarf des Modells effektiv reduziert werden.

Die AsymmDiT-Architektur verarbeitet Benutzeraufforderungen und komprimierte Video-Tags effizient über einen multimodalen Selbstaufmerksamkeitsmechanismus und lernt separate MLP-Schichten für jede Modalität, wodurch die Effizienz und Leistung des Modells weiter verbessert wird.

Die Veröffentlichung von Mochi1 markiert einen wichtigen Schritt im Bereich der Open-Source-Videogenerierung. Das Unternehmen Genmo gab bekannt, dass es noch vor Jahresende die Vollversion von Mochi1 veröffentlichen wird, einschließlich Mochi1HD, das die 720p-Videoerzeugung unterstützt. Bis dahin werden die Wiedergabetreue und die Glätte des Videos weiter verbessert.

Um mehr Menschen die leistungsstarken Funktionen von Mochi1 zugänglich zu machen, hat Genmo außerdem einen kostenlosen gehosteten Spielplatz gestartet, den Benutzer unter genmo.ai/play erleben können. Die Gewichte und die Architektur von Mochi1 wurden auch auf der HuggingFace-Plattform veröffentlicht, damit Entwickler sie herunterladen und verwenden können.

Genmo besteht aus Kernmitgliedern von Projekten wie DDPM, DreamFusion und Emu Video, und zu seinem Beraterteam gehören Ion Stoica, Vorstandsvorsitzender und Mitbegründer von Databricks und Anyscale; Pieter Abbeel, Mitbegründer von Covariant und frühes Teammitglied von OpenAI ; und Branchenführer für Sprachmodellsysteme wie Joey Gonzalez, Pionier und Mitbegründer von Turi.

Die Mission von Genmo besteht darin, die rechte Gehirnhälfte der allgemeinen künstlichen Intelligenz zu erschließen, und Mochi1 ist der erste Schritt beim Aufbau eines Weltsimulators, der sich alles vorstellen kann, ob möglich oder unmöglich.

Genmo hat kürzlich eine von NEA angeführte Serie-A-Finanzierungsrunde in Höhe von insgesamt 28,4 Millionen US-Dollar abgeschlossen, die ausreichende finanzielle Unterstützung für die zukünftige Forschung und Entwicklung des Unternehmens bietet.

Obwohl Mochi1 beeindruckende Ergebnisse erzielt hat, weist es dennoch einige Einschränkungen auf. Beispielsweise kann die erste Version derzeit nur 480p-Videos produzieren, mit leichten Verzerrungen und Verzerrungen in einigen Randfällen extremer Bewegung. Darüber hinaus ist Mochi1 derzeit für den fotorealistischen Stil optimiert und seine Leistung bei Animationsinhalten muss verbessert werden.

Genmo sagt, dass es den Mochi1 weiter verbessern wird und ermutigt die Community, das Modell an unterschiedliche ästhetische Vorlieben anzupassen. Gleichzeitig haben sie auf ihren Spielplätzen strenge Sicherheitsauditprotokolle implementiert, um sicherzustellen, dass die gesamte Videoerzeugung ethisch vertretbar ist.

Modell-Download: https://huggingface.co/genmo/mochi-1-preview

Online-Erlebnis: https://www.genmo.ai/play

Offizielle Einführung: https://www.genmo.ai/blog

Die Open Source von Mochi1 bringt neue Möglichkeiten in den Bereich der Videogenerierung und seine leistungsstarken Funktionen und die komfortable Nutzung sind es wert, gespannt zu sein. Die kontinuierlichen Bemühungen von Genmo und die aktive Beteiligung der Community werden die Weiterentwicklung der Videogenerierungstechnologie weiter vorantreiben. Wir freuen uns auf die Ankunft von Mochi1HD und das Aufkommen weiterer innovativer Errungenschaften.