Das Shanghai Artificial Intelligence Laboratory gab kürzlich bekannt, dass das von ihm entwickelte multimodale Großmodell InternLM-XComposer auf Version 2.5 (IXC-2.5) aktualisiert wurde. Diese Version hat große Durchbrüche beim Verständnis langer Kontexte, beim Verständnis visueller Sprache und bei der Anwendungserweiterung erzielt, das Verständnis und die Erstellung von Textbildern erheblich verbessert und bestehende Open-Source-Modelle in mehreren Benchmark-Tests übertroffen. Einige Indikatoren sind sogar mit GPT-4V und Gemini Pro vergleichbar ist vergleichbar. IXC-2.5 zeigt eine starke Leistung und ein breites Anwendungspotenzial und setzt neue Maßstäbe für die Entwicklung multimodaler Großmodelle.

Kürzlich wurde das multimodale Großmodell InternLM-XComposer auf Version 2.5 aktualisiert. Dieses vom Shanghai Artificial Intelligence Laboratory entwickelte Modell hat durch seine hervorragenden Eingabe- und Ausgabefunktionen für lange Kontexte ein verbessertes Text- und Bildverständnis gebracht revolutionäre Durchbrüche.

IXC-2.5 ist dank der in seinem Training verwendeten 24K-verschachtelten Bild-Text-Daten problemlos in der Lage, lange Kontexte von bis zu 96 KB zu verarbeiten. Diese lange Kontextfähigkeit ermöglicht es IXC-2.5, bei Aufgaben, die einen umfangreichen Eingabe- und Ausgabekontext erfordern, eine gute Leistung zu erbringen.

Im Vergleich zur Vorgängerversion verfügt IXC-2.5 über drei wesentliche Verbesserungen beim Verständnis visueller Sprache:

Ultrahochauflösendes Verständnis: IXC-2.5 unterstützt hochauflösende Bilder mit jedem Seitenverhältnis über den nativen visuellen Encoder 560×560ViT.

Feinkörniges Videoverständnis: Behandeln Sie Videos als ein ultrahochauflösendes zusammengesetztes Bild, das aus Dutzenden bis Hunderten von Bildern besteht und Details durch dichtes Sampling und höhere Auflösung erfasst.

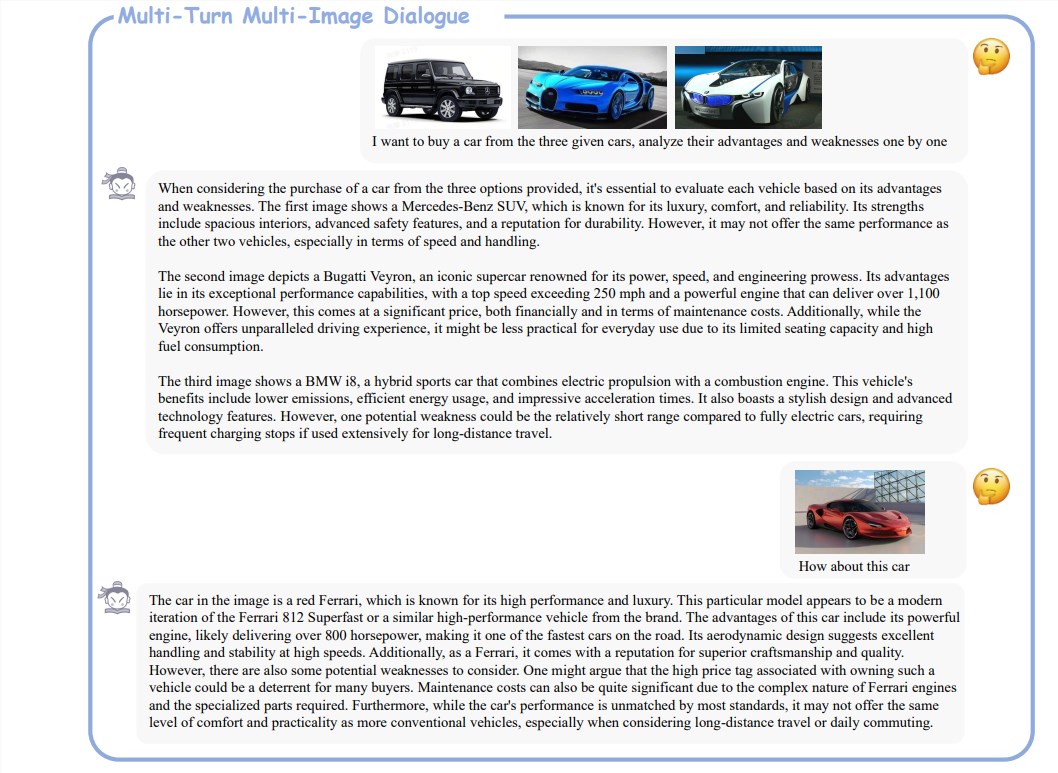

Multi-Turn- und Multi-Picture-Dialog: Unterstützt Freiform-Multi-Turn- und Multi-Picture-Dialog für eine natürliche Interaktion mit Menschen.

Zusätzlich zur Verbesserung des Verständnisses erweitert IXC-2.5 auch zwei überzeugende Anwendungen durch die Verwendung zusätzlicher LoRA-Parameter für die Erstellung von Textbildern:

Webseiten erstellen: Basierend auf Textbildanweisungen kann IXC-2.5 HTML-, CSS- und JavaScript-Quellcodes schreiben, um Webseiten zu erstellen.

Schreiben Sie qualitativ hochwertige grafische Artikel: Verwenden Sie speziell entwickelte Chain-of-Thought- (CoT) und Direct Preference Optimization (DPO)-Technologien, um die Qualität Ihrer Schreibinhalte deutlich zu verbessern.

IXC-2.5 wird anhand von 28 Benchmarks bewertet und übertrifft bestehende, hochmoderne Open-Source-Modelle bei 16 Benchmarks. Darüber hinaus erreichte oder übertraf es GPT-4V und Gemini Pro in 16 Schlüsselaufgaben. Dieser Erfolg beweist voll und ganz die starke Leistung und das breite Anwendungspotenzial von IXC-2.5.

Papieradresse: https://arxiv.org/pdf/2407.03320

Projektadresse: https://github.com/InternLM/InternLM-XComposer

Alles in allem stellt die Veröffentlichung der Version IXC-2.5 einen bedeutenden Fortschritt in der multimodalen Großmodelltechnologie dar, und ihre leistungsstarke Leistung und vielfältigen Anwendungsszenarien deuten auf eine rosige Zukunft für die zukünftige Entwicklung der Technologie der künstlichen Intelligenz hin. Wir freuen uns auf immer leistungsfähigere Funktionsupdates in der Zukunft!