Mit der rasanten Entwicklung der Technologie der künstlichen Intelligenz überschwemmen immer mehr KI-generierte Inhalte das Internet, und die Frage, wie man deren Authentizität erkennt, ist zu einem wichtigen Thema geworden. Adam Mosseri, der Chef von Instagram, hat dazu kürzlich eine Erklärung abgegeben, in der er die Nutzer dazu auffordert, wachsam zu sein und Online-Bilder mit Vorsicht zu behandeln, insbesondere solche realistischen, durch künstliche Intelligenz generierten Inhalte. Er betonte, dass Plattformen dafür verantwortlich seien, Nutzern dabei zu helfen, solche Inhalte zu identifizieren, und forderte Nutzer auf, ihre Fähigkeit zu verbessern, die Informationsquelle zu identifizieren, auf sie zu achten und Irreführungen zu vermeiden.

Adam Mosseri, Leiter von Instagram, sagte in den sozialen Medien, dass Benutzer bei den Bildern, die sie online sehen, vorsichtig sein sollten, insbesondere bei durch künstliche Intelligenz generierten Inhalten, die leicht mit der Realität verwechselt werden können. Mosseri betonte, dass die Technologie der künstlichen Intelligenz ihre Fähigkeit, realistische Inhalte zu produzieren, erheblich verbessert habe, daher sollten Benutzer vorsichtig sein und die Informationsquelle berücksichtigen, und soziale Plattformen hätten die Verantwortung, in dieser Hinsicht zu helfen.

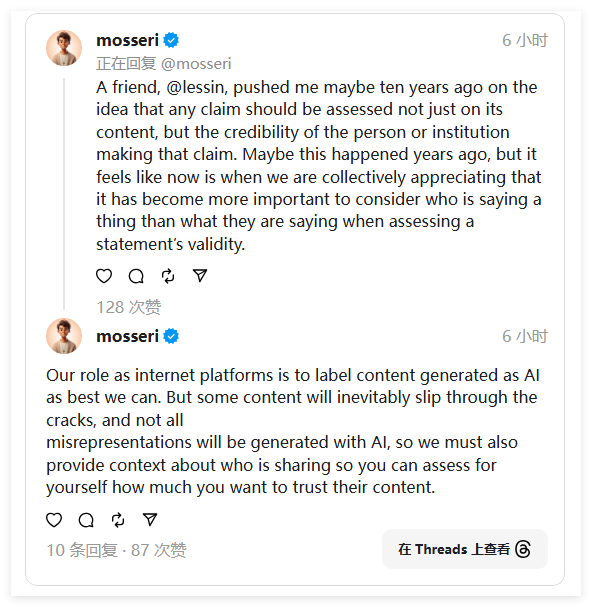

„Als Internetplattform ist es unsere Aufgabe, KI-generierte Inhalte so weit wie möglich zu kennzeichnen“, schrieb er. Allerdings räumte Mosseri ein, dass diese Kennzeichnungen aufgrund der Einschränkungen der Technologie manchmal fehlen. Daher muss die Plattform auch Hintergrundinformationen über den Sharer bereitstellen, um Benutzern bei der Beurteilung der Glaubwürdigkeit der Informationen zu helfen.

Mosseri wies weiter darauf hin, dass ebenso wie man sich darüber im Klaren sein muss, dass Chatbots falsche Informationen liefern können, bevor man Suchmaschinen mit künstlicher Intelligenz nutzt, auch die Überprüfung, ob der Herausgeber eines Bildes oder einer Aussage von einem vertrauenswürdigen Konto stammt, ein wichtiges Mittel zur Beurteilung der Authentizität des Bildes ist Inhalt. Derzeit stellt die Meta-Plattform keine ähnlichen Hintergrundinformationen bereit wie Mosseri, obwohl das Unternehmen kürzlich angedeutet hat, dass in Zukunft größere Änderungen an den Inhaltsregeln vorgenommen werden.

Das von ihm beschriebene System klingt eher nach einem benutzergesteuerten Moderationsmechanismus, ähnlich den Community-Notizen auf Platform X und YouTube oder der benutzerdefinierten Moderationsfunktion von Bluesky. Obwohl es keine klaren Neuigkeiten darüber gibt, ob Meta ähnliche Funktionen einführen wird, ist es erwähnenswert, dass Meta kürzlich aus den Erfahrungen von Bluesky gelernt hat und in Zukunft möglicherweise entsprechende Verbesserungen vornehmen wird.

Mosseris Aussage erinnert uns daran, dass es in einer Zeit der Informationsexplosion von entscheidender Bedeutung ist, die Medienkompetenz zu verbessern und das Urteilsvermögen zu stärken. Soziale Plattformen müssen außerdem mehr Verantwortung übernehmen, aktiv nach wirksamen Methoden suchen, um Benutzern dabei zu helfen, Herausforderungen durch durch künstliche Intelligenz generierte Inhalte zu erkennen und darauf zu reagieren, und gemeinsam eine sicherere und zuverlässigere Online-Umgebung aufbauen.