Im Zeitalter der Informationsexplosion nehmen Videoinhalte exponentiell zu und herkömmliche Such- und Analysetechnologien sind nicht mehr in der Lage, die Nachfrage zu decken. Twelve Labs wurden ins Leben gerufen und nutzten die Technologie der künstlichen Intelligenz, um revolutionäre Veränderungen im Videoverständnis herbeizuführen. Die vom Unternehmen entwickelten fortschrittlichen Modelle können Videoinhalte tiefgreifend verstehen und über die einfache Schlüsselworterkennung hinaus eine präzise Analyse von Aktionen, Objekten und Geräuschen ermöglichen, wodurch Benutzern eine genauere und effizientere Erfahrung bei der Videosuche und -analyse geboten wird.

In der Flut digitaler Medien wächst Video in einem beispiellosen Tempo. Allerdings stoßen herkömmliche Such- und Analysemethoden immer an die Grenzen der Technologie. Twelve Labs revolutioniert diese Situation, indem es die Kraft der künstlichen Intelligenz nutzt, um ein revolutionäres Verständnis von Videoinhalten zu ermöglichen.

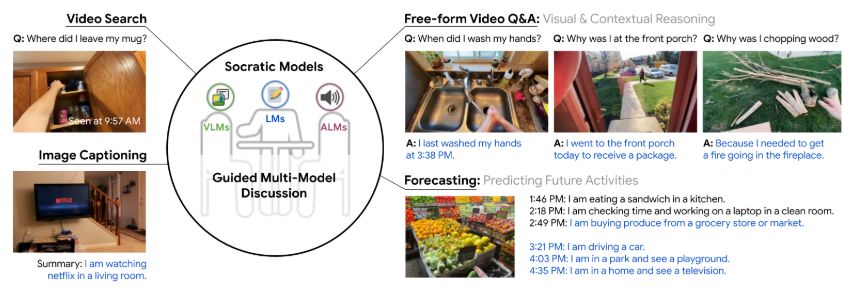

Die herkömmliche Videosuche endet nur auf der Titel- und Tag-Ebene, was so ist, als würde man nur die Spitze des Eisbergs sehen. Jae Lee, Gründer von Twelve Labs, weiß, dass echtes Videoverständnis tiefergehende Technologie erfordert. Ihr Modell geht über die Erkennung von Schlüsselwörtern hinaus und kann auch Aktionen, Objekte und Hintergrundgeräusche in Videos verstehen.

Dies bedeutet, dass Benutzer äußerst präzise Fragen stellen können, z. B. „Wann hat der Mann im roten Hemd das Restaurant betreten?“ und genaue Antworten erhalten. Diese disruptive Fähigkeit hat die Aufmerksamkeit von Technologiegiganten wie Nvidia und Samsung auf sich gezogen.

Anders als die allgemeinen multimodalen Modelle von Google und Microsoft verfolgt Lab 12 einen einzigartigen Ansatz und konzentriert sich auf das Videoverständnis. Ihr Modell ermöglicht es Entwicklern, ihre eigenen Videoanalysetools anzupassen, wobei die Anwendungen von der Anzeigenplatzierung bis zur Inhaltsmoderation reichen.

Noch lobenswerter ist, dass Twelve Labs bei der Innovation der Technologie stets ethische Sensibilität bewahrt. Sie entwickeln strenge Bias-Testmechanismen, um die Fairness und Inklusivität von KI-Modellen sicherzustellen.

Das Marengo-Modell des Unternehmens geht über die Analyse einzelner Videos hinaus und bietet „Any-to-Any“-Suchfunktionen für Video, Bilder und Audio. Diese multimodale Einbettungstechnologie eröffnet neue Möglichkeiten für komplexe Anwendungen wie die Anomalieerkennung.

Twelve Labs hat kürzlich eine Finanzierung in Höhe von 30 Millionen US-Dollar sowie die Unterstützung von Investoren wie SK Telecom und HubSpot Ventures erhalten und steht an der Spitze der Entwicklung künstlicher Intelligenz. Der Beitritt von Yin Jin, dem ehemaligen Apple-Siri-Architekten, hat der Globalisierungsstrategie des Unternehmens neuen Schwung verliehen.

Die Ziele des Unternehmens sind ehrgeizig: Künftig wird es in mehreren vertikalen Bereichen wie Automobil und Sicherheit tätig sein und möglicherweise sogar in der Verteidigungstechnologie tätig werden. Insbesondere die Investition von In-Q-Tel weist auf die potenziellen Anwendungen seiner Technologie im Bereich der nationalen Sicherheit hin.

Twelve Labs definiert die Art und Weise, wie wir Videoinhalte verstehen und mit ihnen interagieren, neu. In diesem Zeitalter der Informationsexplosion werden KI-Technologien wie die ihre, die sich auf Verantwortungsbewusstsein und Innovation konzentrieren, zu einer Schlüsselkraft bei der Förderung der digitalen Medienrevolution.

Wenn Videos keine statischen Inhalte mehr sind, sondern genauso tiefgreifend verstanden und interagiert werden können wie Text, werden wir ein neues Informationszeitalter einläuten. Und Labor 12 steht an der Spitze dieser Ära.

Alles in allem ist Lab 12 mit seinen technologischen Durchbrüchen im Bereich des Videoverständnisses und seinem Schwerpunkt auf Ethik führend bei der Innovation der Technologie der künstlichen Intelligenz im Bereich der digitalen Medien, und es lohnt sich, auf seine zukünftige Entwicklung zu blicken.