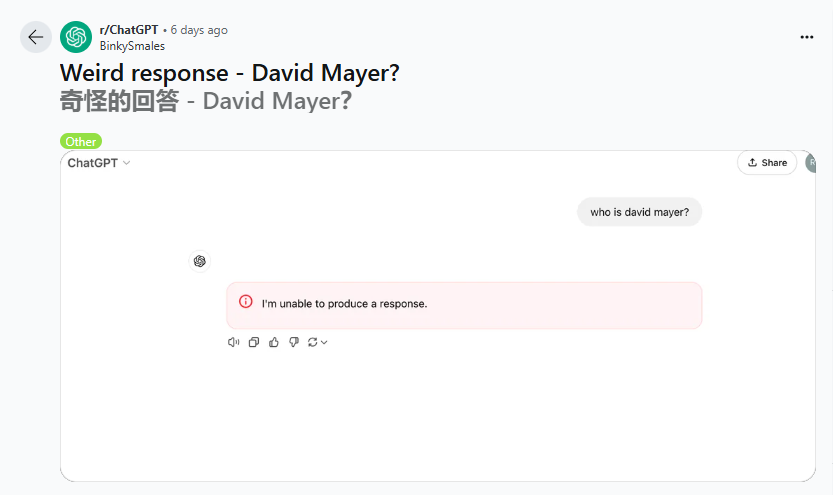

Kürzlich hat ein seltsames Phänomen des OpenAI-Chatbots ChatGPT für hitzige Diskussionen in den sozialen Medien gesorgt: Wenn ein Benutzer den Namen „David Mayer“ eingibt, unterbricht ChatGPT das Gespräch direkt und antwortet: „Ich kann keine Antwort generieren.“ Diese Anomalie hat zu weit verbreiteten Spekulationen und Diskussionen geführt, und OpenAI hat noch keine offizielle Erklärung abgegeben.

Kürzlich trat in den sozialen Medien ein verwirrendes Phänomen auf: Der Chatbot ChatGPT von OpenAI konnte nicht normal reagieren, als der Name „David Mayer“ erwähnt wurde, und unterbrach das Gespräch direkt.

Diese Situation hat bei vielen Internetnutzern Diskussionen und Spekulationen ausgelöst. Viele Menschen äußerten ihre Verwirrung über dieses Phänomen und versuchten, ChatGPT nach Informationen über „David Mayer“ zu fragen, aber alle stießen auf das gleiche Ende.

Als der Benutzer versuchte, „David Mayer“ zu fragen, antwortete ChatGPT: „Ich kann keine Antwort generieren.“ Die Chat-Sitzung wurde dann unerwartet beendet und der Benutzer musste ein Fenster erneut öffnen, um den Assistenten weiter verwenden zu können. Dieses Phänomen hat breite Aufmerksamkeit und Diskussionen erregt. OpenAI hat jedoch noch keine offizielle Antwort darauf gegeben und alle sind immer noch voller Fragen über die Ursache dieser Situation.

Es ist erwähnenswert, dass der Name David Mayer unter Persönlichkeiten des öffentlichen Lebens nicht verbreitet ist. Der vielleicht berühmteste ist David Meyer de Rothschild, ein britischer Entdecker, Umweltschützer und Erbe der Bankiersfamilie Rothschild. Obwohl die Persönlichkeit des öffentlichen Lebens keine Begegnungen mit dem KI-Chatbot hatte, hat die Spezifität seines Namens viele Spekulationen ausgelöst.

Einige Internetnutzer spekulierten, dass die sensible Reaktion von ChatGPT auf „David Mayer“ mit bestimmten rechtlichen Problemen zusammenhängen könnte. Beispielsweise haben die Namen mehrerer Personen, die das „Recht auf Vergessenwerden“ gemäß der Europäischen Datenschutz-Grundverordnung (DSGVO) beantragt haben, ähnliche Probleme ausgelöst. Darüber hinaus erwähnte jemand ein tschetschenisches ISIS-Mitglied, das „David Mayer“ als Pseudonym verwendete, was möglicherweise auch einer der Gründe war, die die ChatGPT-Reaktion auslösten.

Mittlerweile bereiten auch andere Namen ChatGPT Probleme, etwa zwei Juraprofessoren namens Jonathan Zittrain und Jonathan Turley. Es ist erwähnenswert, dass Zittrain in The Atlantic über „Kontrolle von KI-Agenten“ geschrieben hat. Diese Reihe von Phänomenen ist sehr überraschend. Viele Benutzer haben auch versucht, ihren Namen in „David Mayer“ zu ändern, aber ChatGPT weigert sich immer noch, diese Änderung anzuerkennen.

Während wir immer noch auf eine offizielle Erklärung von OpenAI warten, verdeutlicht dieser Vorfall sicherlich die betriebliche Komplexität und den Black-Box-Charakter großer Sprachmodelle. Dies ist auch eine wichtige Erinnerung für Benutzer: Wenn sie KI-Produkte verwenden, sollten sie den Antworten, die sie geben, nicht so leicht vertrauen.

Höhepunkte:

? ChatGPT antwortet nicht, wenn „David Mayer“ erwähnt wird, und erzwingt die Beendigung des Gesprächs.

„David Mayer“ könnte mit rechtlichen Fragen im Zusammenhang mit dem Recht auf Vergessenwerden der DSGVO zusammenhängen.

? Auch andere Namen können zu Fehlfunktionen von ChatGPT führen, was die Komplexität des KI-Modells verdeutlicht.

Das abnormale Verhalten von ChatGPT hat Bedenken hinsichtlich der potenziellen Risiken und Transparenzprobleme großer Sprachmodelle geweckt und die Notwendigkeit einer Ethik der KI-Technologie und eines Datensicherheitsmanagements erneut unterstrichen. Die weitere Entwicklung dieses Vorfalls verdient weitere Aufmerksamkeit.