Meta -AI -Forscher und akademische Partner haben ein innovatives System entwickelt, MILS (Multimodal Iterative LLM Solver), das große Sprachmodelle für die Verarbeitung von Bildern, Videos und Audio ohne spezialisierte Schulung lehrt. MILs stützt sich eher auf die natürliche Problemlösungsfähigkeit von Sprachmodellen als auf große Mengen an Datenschulungen, wobei die einzigartigen Vorteile angezeigt werden.

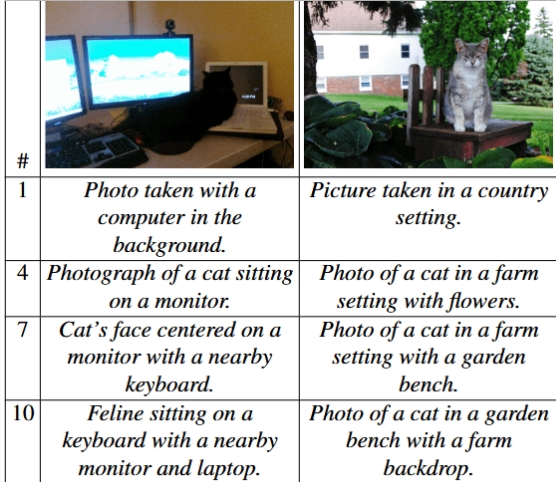

Mils arbeitet mit zwei KI -Modellen, um Aufgabenlösungen durchzuführen: Einer ist ein "Generator", der für die Vorstellung von Aufgabenlösungen verantwortlich ist, und der andere ist ein "Rating", der zur Bewertung der Wirksamkeit der generierten Lösung verwendet wird. Das vom Torschützen bereitgestellte Feedback kann dem Generator helfen, die Antwort kontinuierlich zu optimieren, bis er ein zufriedenstellendes Ergebnis erzielt. In der Aufgabe der Bildbeschreibung können Mils beispielsweise die Bildbeschreibungen nach und nach verfeinern, wodurch Bilddetails auf verschiedenen Ebenen genau beschrieben werden.

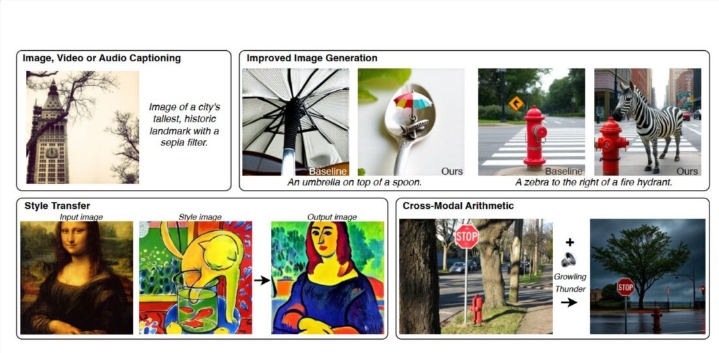

MILs spielt besonders gut in der Bildbeschreibung. Durch die Verwendung des LLAMA-3.1-8B-Modells als Generator und das Clip-Modell als Torschütze kann Mils Bildbeschreibungen erstellen, die mit denen der aktuellen Hauptmethoden vergleichbar sind, obwohl Clip nicht spezifisch für Bildbeschreibungsaufgaben trainiert wird. Darüber hinaus verbessert MILs die Erzeugungsfunktionen der Text-zu-Image-Erzeugung durch feinabstimmende Texteingabeaufforderungen und können mit AI-generierte Eingabeaufforderungen mit Image-Verarbeitungs-Tools kombinieren, um Bildbearbeitungsaufgaben wie Stilkonvertierung zu erledigen.

Die Genauigkeit der Bildbeschreibung nimmt mit der Anzahl der Schritte zwischen dem Generator und dem Torschützen zu. | Foto: Ashutosh usw.

Die Funktionen von Mils sind nicht auf Bilder beschränkt, sondern erstreckt sich auch auf die Video- und Audiofelder. Bei der getesteten MSR-VTT-Videodatensätze übertreffen die MILS vorhandene Modelle in der Beschreibung des Videoinhalts. Da MILS die Modellparameter während des Betriebs nicht ändert, kann es verschiedene Arten von Daten in lesbare Text umwandeln, wodurch die Zusammenführung und Konvertierung von Informationen aus mehreren Quellen wie Bildern und Audio in das gewünschte Format unterstützt werden, wodurch multimodale Informationen konvergierte Anwendungen neu geöffnet werden Möglichkeiten.

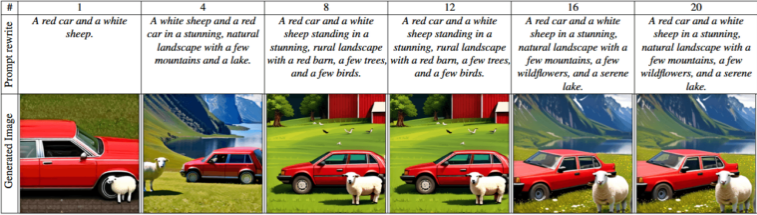

Tests zeigen, dass die Verwendung größerer Generatoren und Bewertungsmodelle genauere Ergebnisse erzielen kann und die Anzahl potenzieller Lösungen erhöht kann, was die Leistung erheblich verbessern kann. Die Forscher fanden auch heraus, dass die Ausweitung eines größeren Sprachmodells nicht nur die Qualität der Ergebnisse verbessert, sondern auch die Leistung erheblich verbessert.

Landschaften entwickeln sich von einfachen grundlegenden Beschreibungen bis hin zu komplexen Landschaftsdarstellungen mit genaueren Details und natürlicheren Elementen. | Foto: Ashutosh usw.

Diese innovative Strategie von Mils entspricht dem aktuellen Trend des Bereichs der künstlichen Intelligenz gegenüber intelligenteren Argumentationsfunktionen. Das Meta -Team sagte auch, dass MILs in den Bereichen Felder wie 3D -Datenverarbeitung ein großes Potenzial in der Zukunft aufweisen könnten, um die Entwicklung der multimodalen KI weiter zu fördern.

Mit der schnellen Entwicklung von OpenAIs GPT-4 und anderen Open-Source-Alternativen wie Lama 3.2 von Meta, Mistral's Pixtral und Deepseeks Janus Pro beschleunigen diese aufstrebenden multimodalen KI-Systeme ihre Anwendung auf den Alltag und legt eine wichtige Grundlage für die Zukunft. Entwicklung künstlicher Intelligenz.