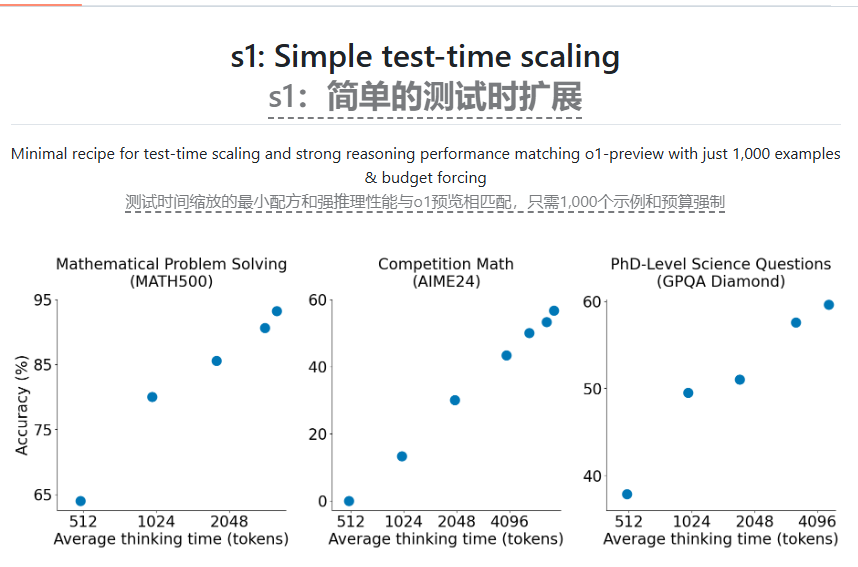

Kürzlich haben Forscher der Stanford University und der University of Washington ein KI -Inferenzmodell namens S1 erfolgreich ausgebildet, das nur 50 US -Dollar kostet. Die Leistung des Modells in mathematischen und Programmierfähigkeitstests ist vergleichbar mit dem O1 -Modell von OpenAI und Deepseeks R1 -Modell. Dieses Ergebnis hat neue Gedanken über die Kommerzialisierung von KI -Modellen ausgelöst und auch bei großen KI -Labors Bedenken ausgelöst.

Das Forschungsteam hat die erforderlichen Inferenzfunktionen aus dem vorgefertigten Basismodell durch Destillationstechnologie extrahiert und mit dem experimentellen Modell des Gemini2.0-Flash-Denkens von Google geschult. Dieser Prozess ist nicht nur billig, sondern auch schnelles Training.

Dennoch sind große AI-Labors mit dem Phänomen von kostengünstigen Replikationsmodellen unzufrieden. Meta, Google und Microsoft planen, in den nächsten zwei Jahren Hunderte von Milliarden Dollar zu investieren, um KI-Modelle der nächsten Generation zu schulen, um ihre Position auf dem Markt zu konsolidieren.

Die Forschungsergebnisse von S1 zeigen die Möglichkeit, eine starke Inferenzleistung durch relativ kleine Datensätze und beaufsichtigte Feinabstimmungsmethoden zu erzielen, die auch neue Richtungen für zukünftige KI-Forschung liefert.

Papier: https://arxiv.org/pdf/2501.19393

Code: https://github.com/simplescaling/s1

Schlüsselpunkte:

Die Trainingskosten des S1 -Modells betragen weniger als 50 US -Dollar, und seine Leistung ist vergleichbar mit der der Top -Inferenzmodelle.

Durch die Destillationstechnologie extrahiert das Forschungsteam Argumentationsfunktionen aus fertigen Modellen, und der Schulungsprozess ist schnell und effizient.

Große KI-Labors haben Bedenken hinsichtlich der Situation kostengünstiger Replikationsmodelle geäußert, und Investitionen werden sich in Zukunft auf die KI-Infrastruktur konzentrieren.