Die neuesten Forschungen im Bereich der künstlichen Intelligenz zeigen eine überraschende Ähnlichkeit zwischen großen Sprachmodellen (LLMs) und menschlichen Gehirnstrukturen. Durch eingehende Analyse des Aktivierungsraums von LLM stellten Wissenschaftler am MIT fest, dass seine interne Struktur eine signifikante Korrespondenz mit den MES-, MESO- und Makrospiegeln des menschlichen Gehirns aufweist. Diese Entdeckung bietet uns nicht nur eine neue Perspektive, um zu verstehen, wie KI funktioniert, sondern bildet auch die Grundlage für die zukünftige Entwicklung intelligenterer KI -Systeme.

KI hat tatsächlich begonnen, "Ihr Gehirn zu wachsen"?!

Diese Studie verwendete eine spärliche Autoencodertechnologie, um eine eingehende Analyse des Aktivierungsraums von LLM durchzuführen, und entdeckte drei Ebenen struktureller Merkmale, was erstaunlich war:

Erstens entdeckten Forscher auf mikroskopischer Ebene die Existenz einer "Kristall" -Struktur. Die Gesichter dieser "Kristalle" bestehen aus Parallelogrammen oder Trapezoiden, ähnlich wie bei den vertrauten Vokabeln wie "Mann: Frauen: König: Königin".

Noch überraschender ist, dass diese "Kristallstrukturen" deutlicher werden, nachdem einige irrelevante Interferenzfaktoren (z. B. Wortlänge) durch lineare Diskriminanzanalysetechniken entfernt wurden.

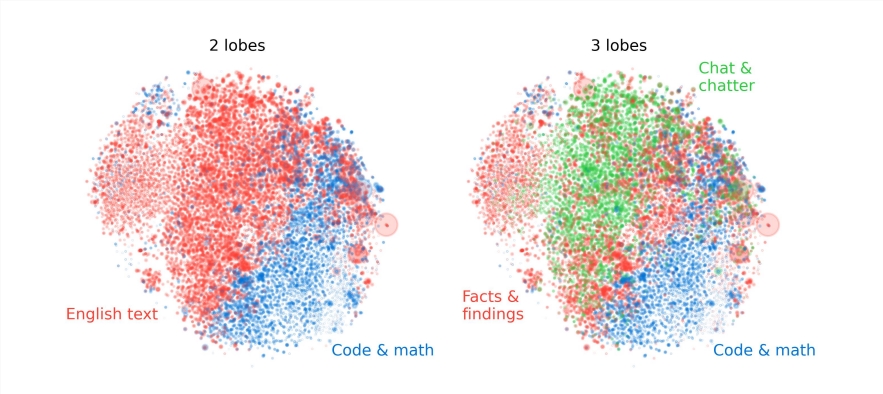

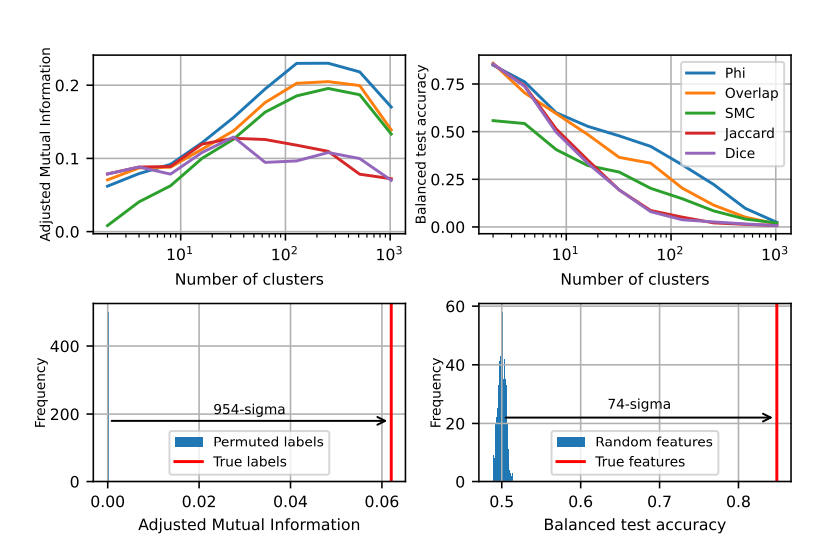

Zweitens fanden die Forscher auf Meso-Ebene fest, dass der Aktivierungsraum von LLM eine modulare Struktur aufweist, die der funktionellen Aufteilung des menschlichen Gehirns ähnelt.

Zum Beispiel werden Merkmale, die sich auf Mathematik und Code beziehen, zu einem "Gehirnlappen", der dem Funktionslappen des menschlichen Gehirns ähnelt. Durch die quantitative Analyse durch mehrere Indikatoren bestätigten die Forscher die räumliche Lokalität dieser "Gehirnlappen", was darauf hinweist, dass die gleichzeitigen Merkmale auch räumlich konzentrierter sind und die Erwartungen der Zufallsverteilung weit übertreffen.

Auf Makroebene stellten die Forscher fest, dass die Gesamtstruktur der LLM -Merkmalspunkt -Cloud nicht isotrop ist, sondern eine Eigenverteilung des Leistungsgesetzes zeigt, und diese Verteilung ist in der Zwischenschicht am offensichtlichsten.

Die Forscher quantifizierten auch die Clustering -Entropie auf verschiedenen Ebenen und fanden heraus, dass die Clustering -Entropie der Zwischenschicht niedriger war, was darauf hinweist war mehr verteilt.

Diese Studie bietet uns eine neue Perspektive, um die internen Mechanismen großer Sprachmodelle zu verstehen, und bildet die Grundlage für die zukünftige Entwicklung von leistungsstärkeren und intelligenteren KI -Systemen.

Diese Studie zeigt nicht nur die Ähnlichkeit zwischen KI und dem menschlichen Gehirn, sondern bietet auch eine neue Richtung für die zukünftige Entwicklung der KI -Technologie, was darauf hinweist, dass die KI schlauer und effizienter wird.