Clona este repositorio en el Your ComfyUI root directoryComfyUIcustom_nodes e instala los paquetes de Python dependientes:

cd Your_ComfyUI_root_directoryComfyUIcustom_nodes clon de git https://github.com/Bin-sam/DynamicPose-ComfyUI.git instalación de pip -r requisitos.txt

Descargue modelos previamente entrenados:

./pretrained_weights/

|-- denoising_unet.pth

|-- motion_module.pth

|-- pose_guider.pth

|-- reference_unet.pth

|-- rtmpose

| |-- rtmw-x_simcc-cocktail14_pt-ucoco_270e-384x288-f840f204_20231122.pth

| |-- rtmw-x_8xb320-270e_cocktail14-384x288.py

| |-- rtmdet_m_640-8xb32_coco-person.py

| |-- rtmdet_m_8xb32-100e_coco-obj365-person-235e8209.pth

| |-- rtmpose-x_8xb256-700e_coco-384x288.py

| |-- rtmpose-x_simcc-body7_pt-body7_700e-384x288-71d7b7e9_20230629.pth

|-- DWPose

| |-- dw-ll_ucoco_384.onnx

| |-- yolox_l.onnx Descargue el codificador de imágenes de clip (por ejemplo, sd-image-variations-diffusers) y colóquelo en Your_ComfyUI_root_directoryComfyUImodelsclip_vision

Descargue vae (por ejemplo, sd-vae-ft-mse) y colóquelo en Your_ComfyUI_root_directoryComfyUImodelsvae

Descargue stable-diffusion-v1-5 (por ejemplo, stable-diffusion-v1-5) y colóquelo en Your_ComfyUI_root_directoryComfyUImodelsdiffusers

difusión-estable-v1-5_unet

Modelos previamente entrenados de Moore-AnimateAnyone

Los enlaces de descarga del modelo DWpose se encuentran bajo el título "DWPose para ControlNet".

Los modelos anteriores deben colocarse en la carpeta pretrained_weights de la siguiente manera:

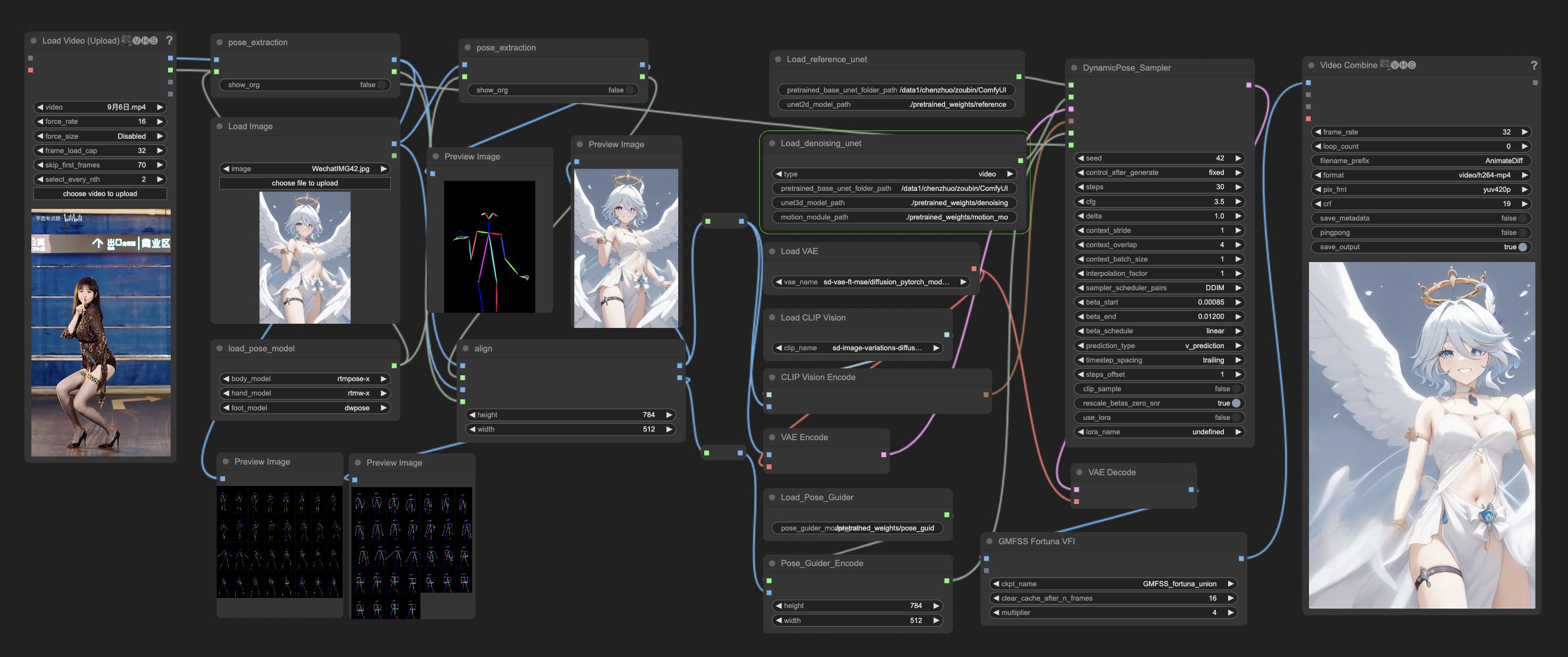

Usando ejemplos de canalización

este flujo de trabajo es Pose_to_video