BAT GPT

中文说明见后,本英文由GPT翻译。

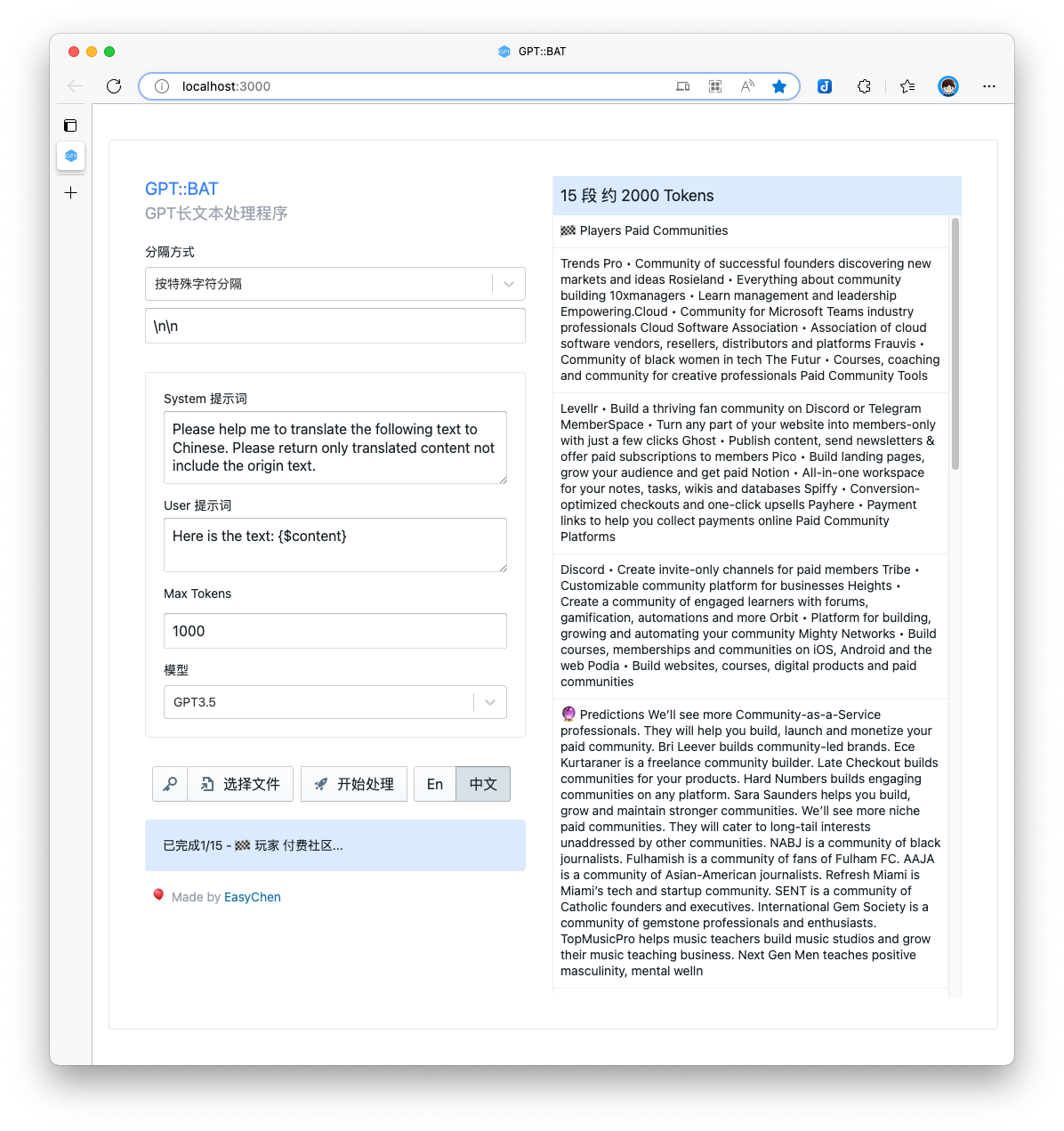

Debido a la capacidad limitada de GPT, especialmente GPT-3.5, puede resultar difícil procesar contenido extenso en una ventana de chat. Por lo tanto, desarrollé GPT BAT, que puede dividir textos largos, enviarlos a GPT y luego concatenar los resultados para descargarlos.

Pruébelo en https://r.ftqq.com/gpt-bat/

Instrucciones

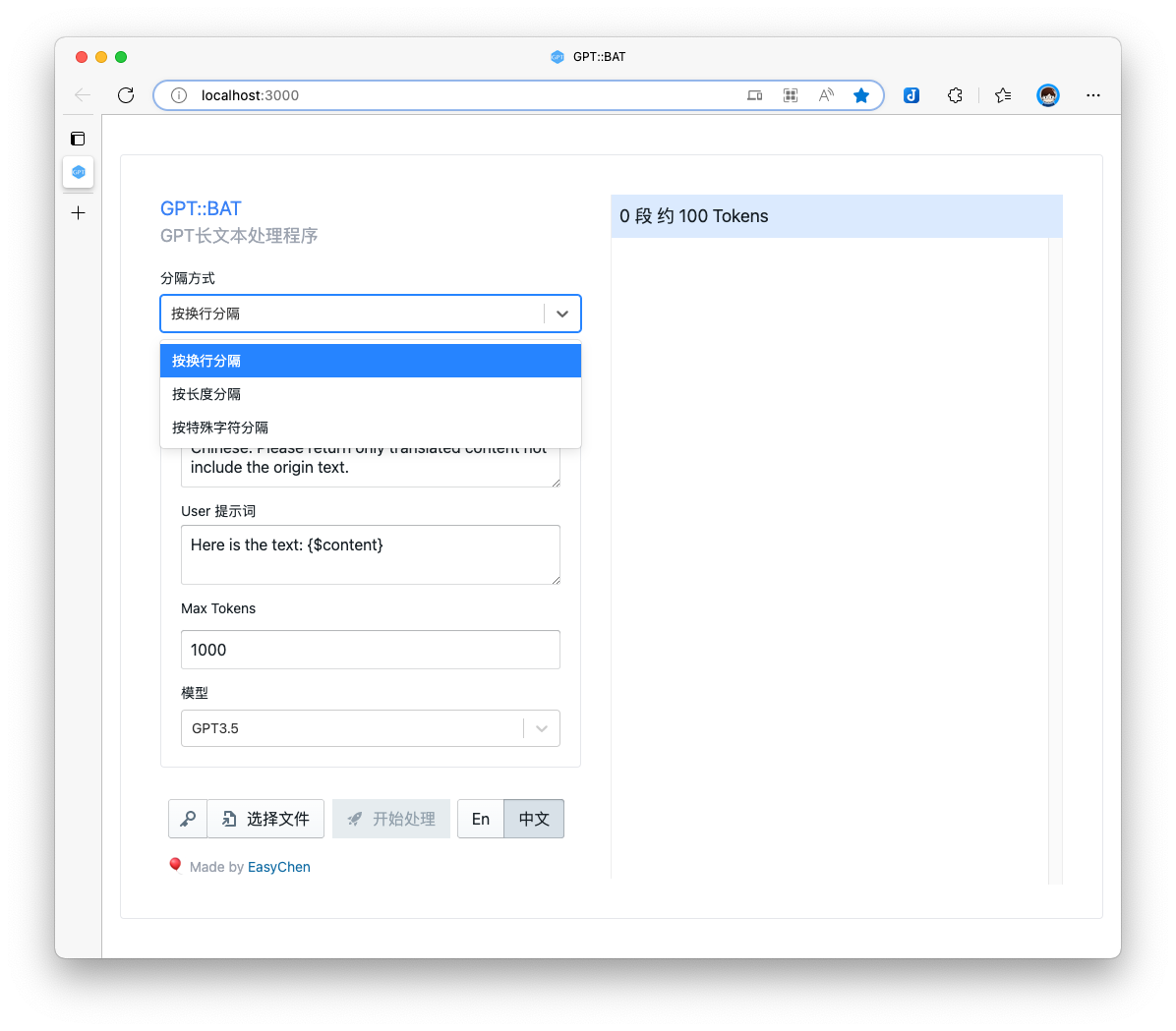

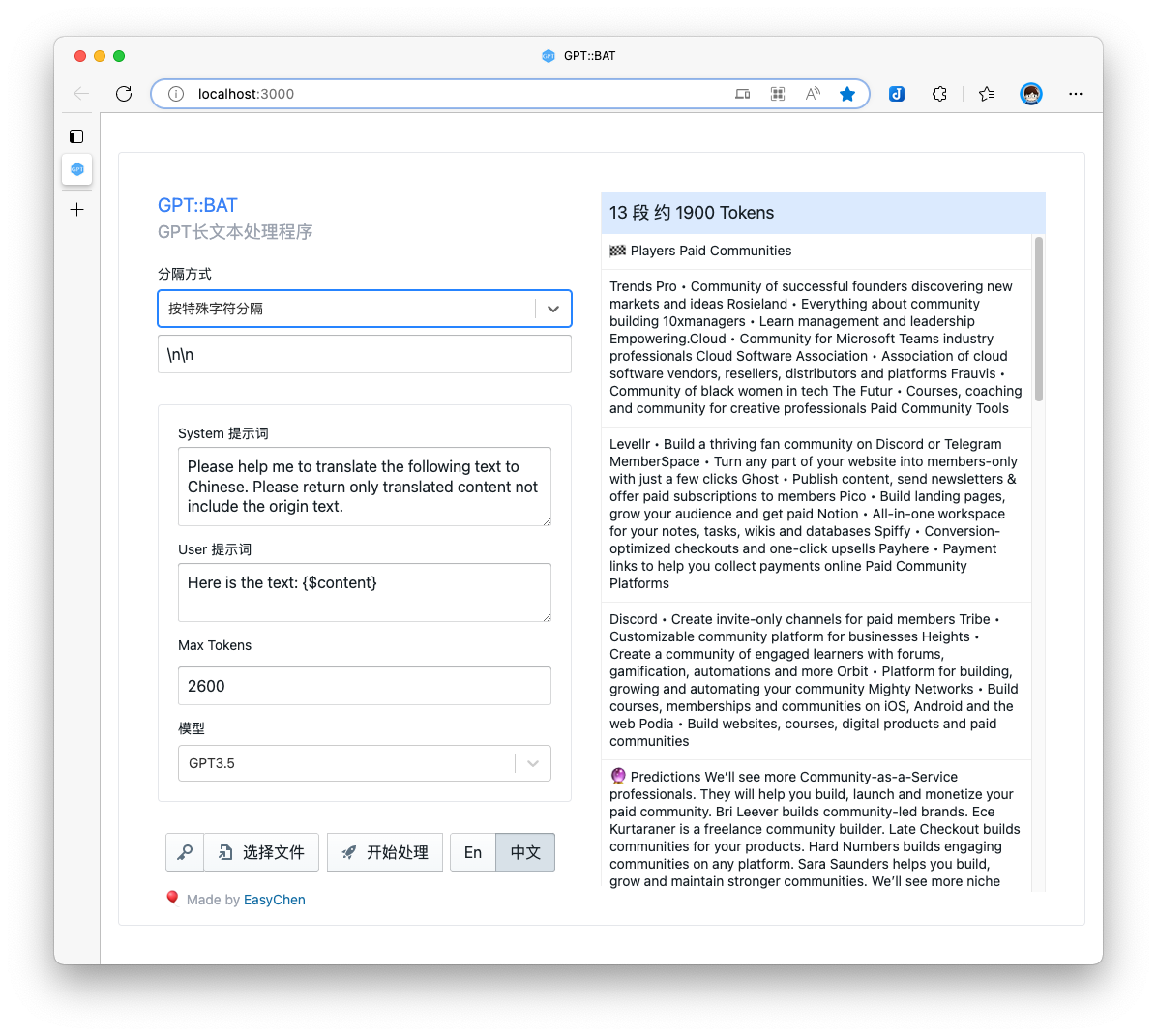

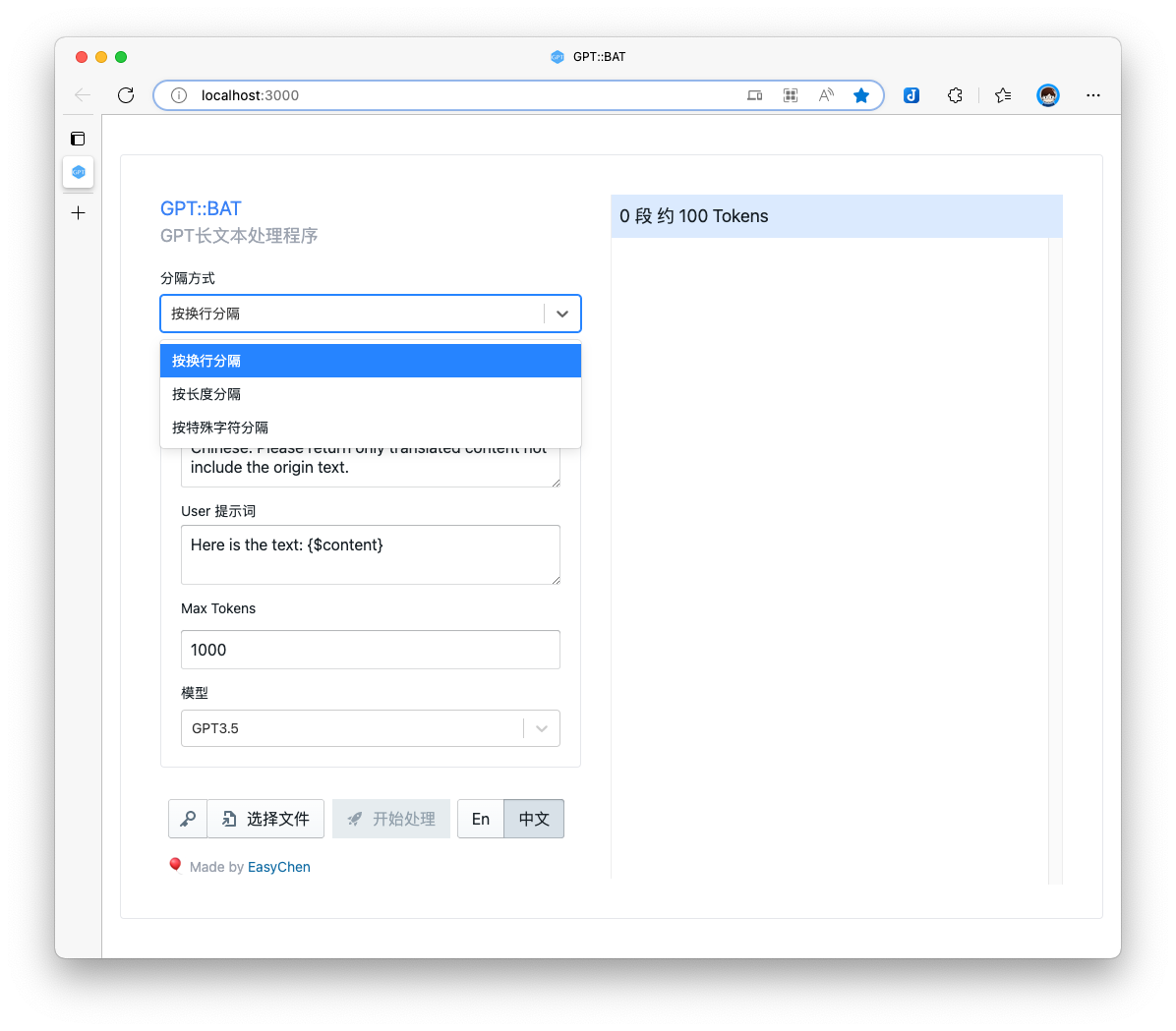

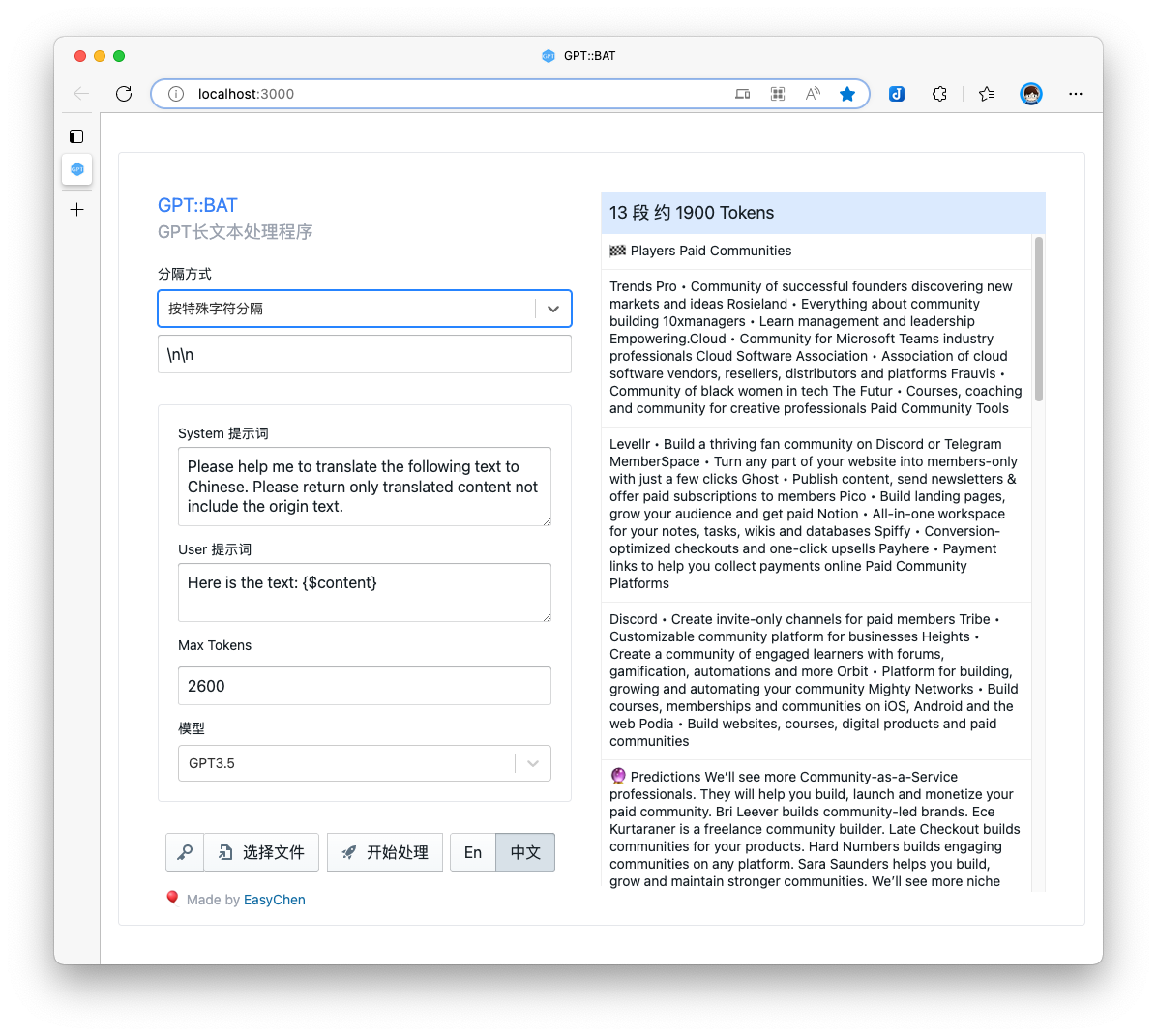

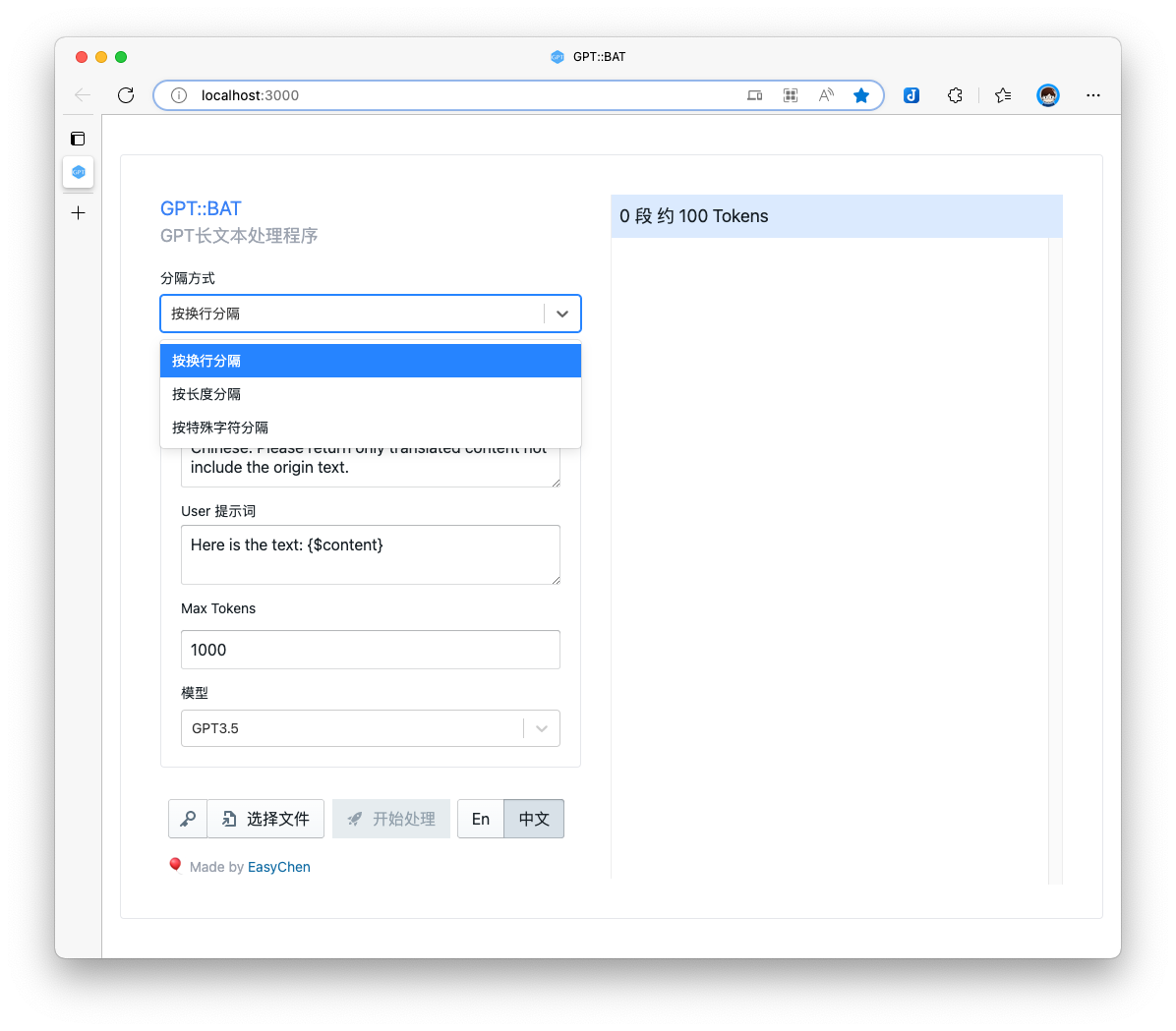

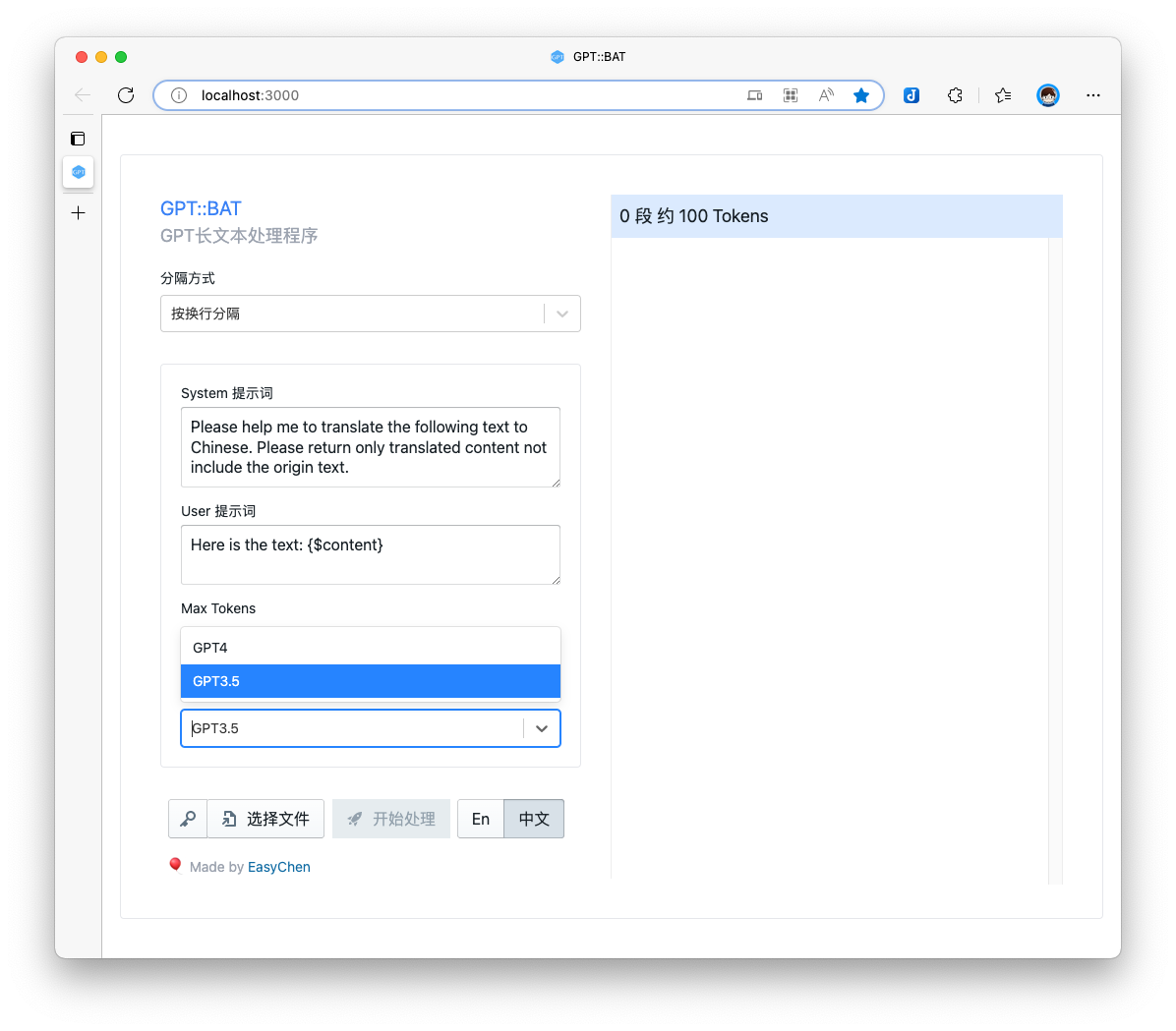

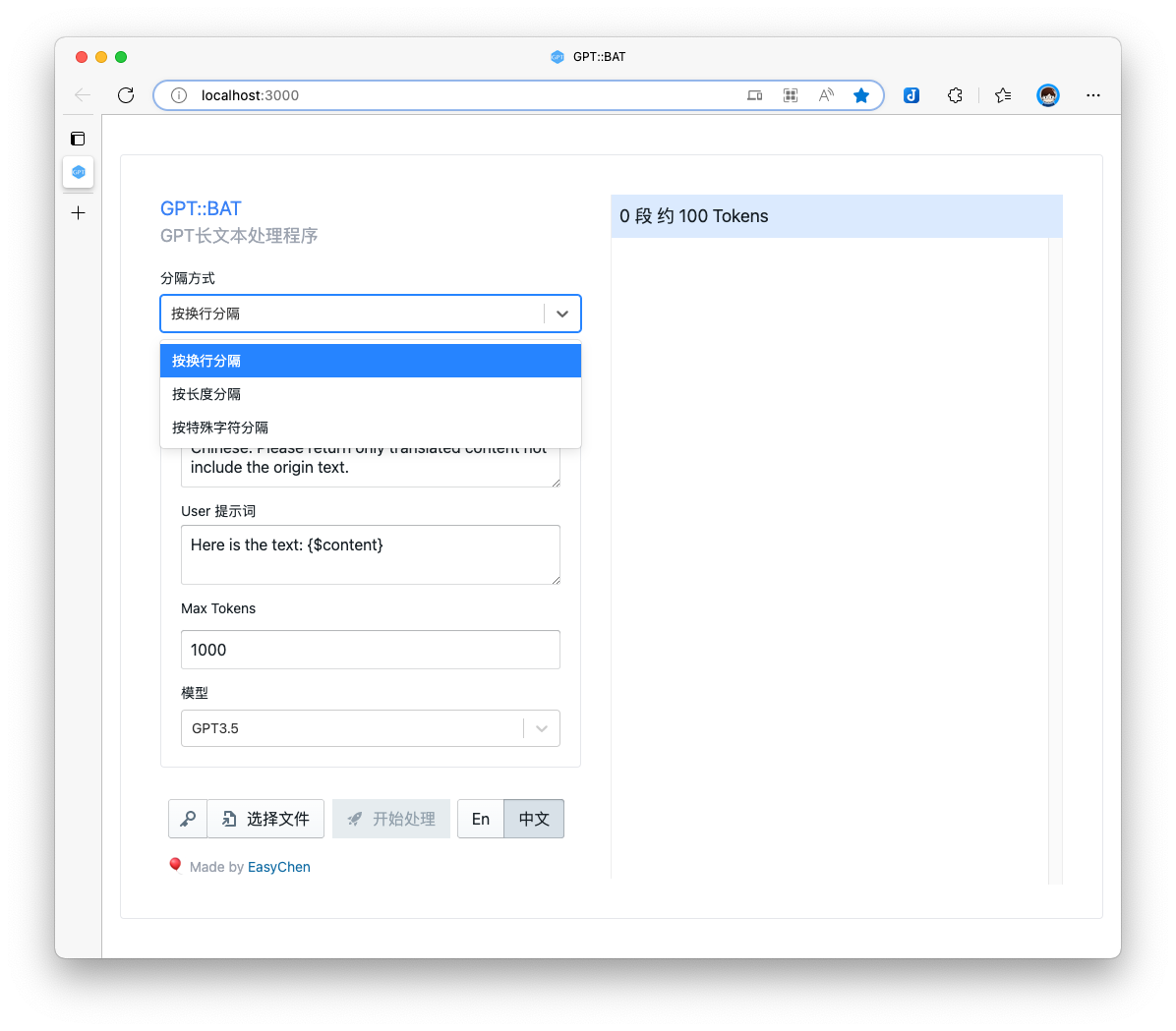

- Elija un método de división, que puede ser por línea, por longitud o por un carácter específico.

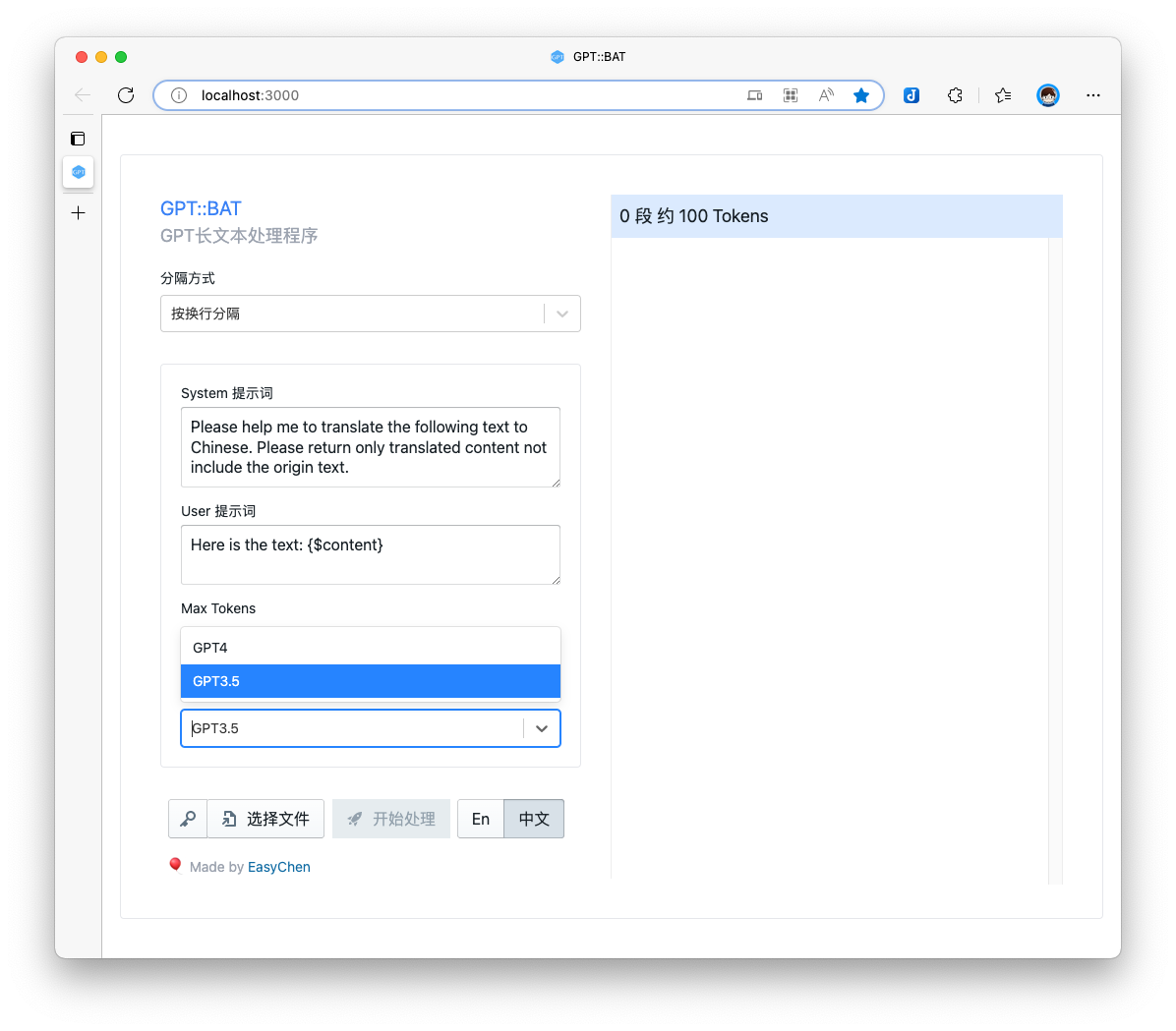

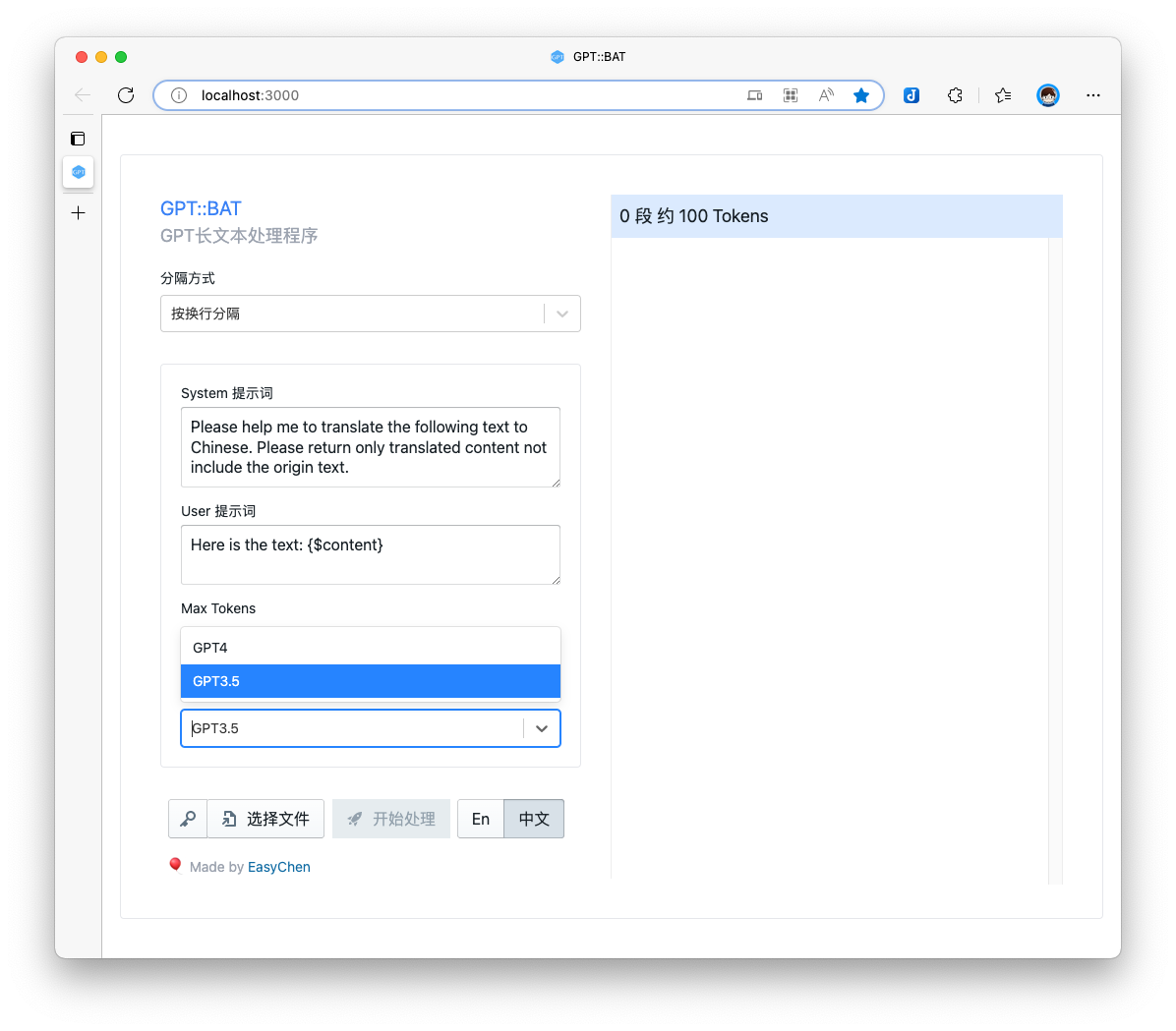

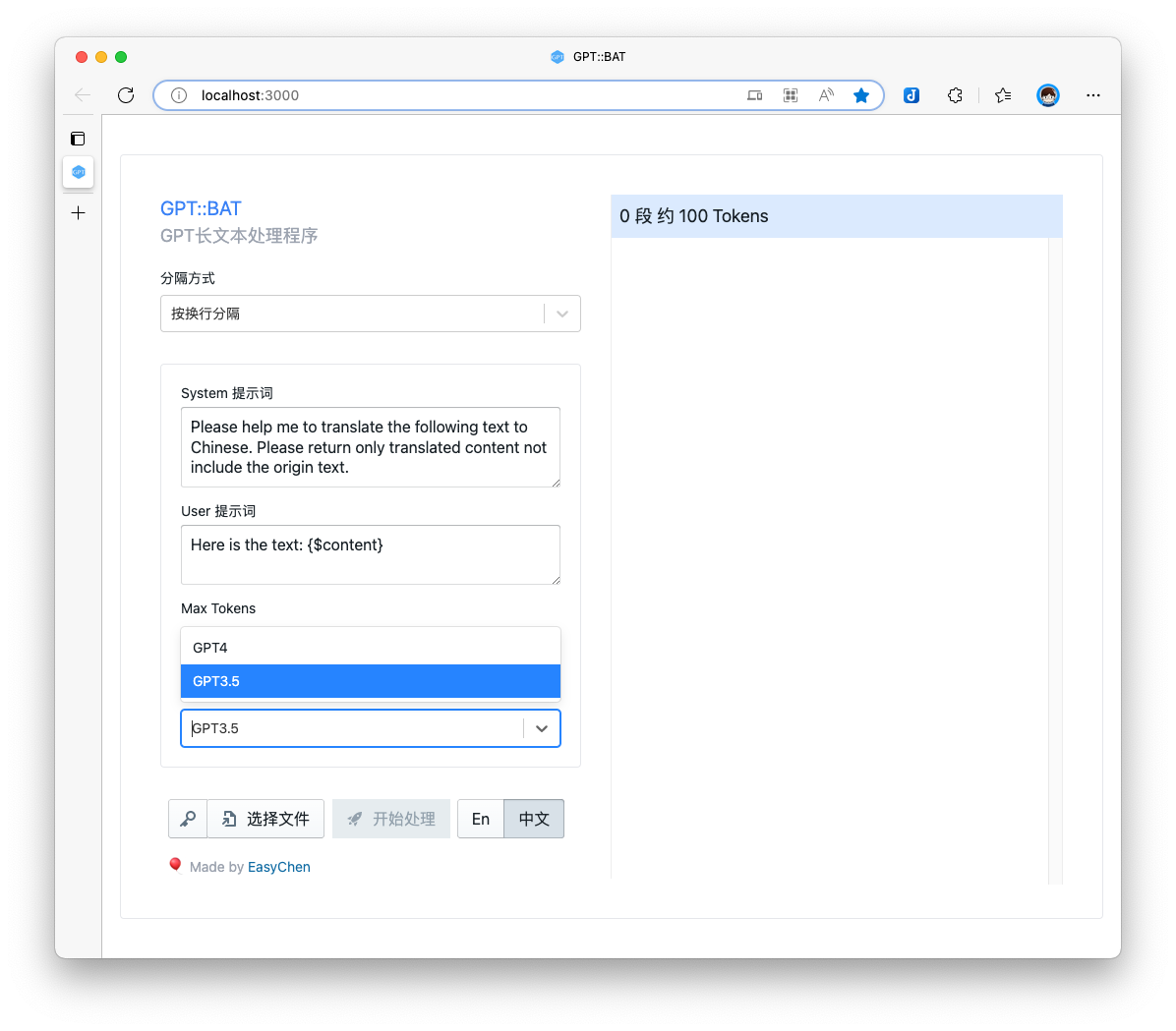

- Complete la configuración para cada llamada a la API de chat de GPT, incluido el mensaje del sistema, el mensaje del usuario, los tokens máximos y el modelo.

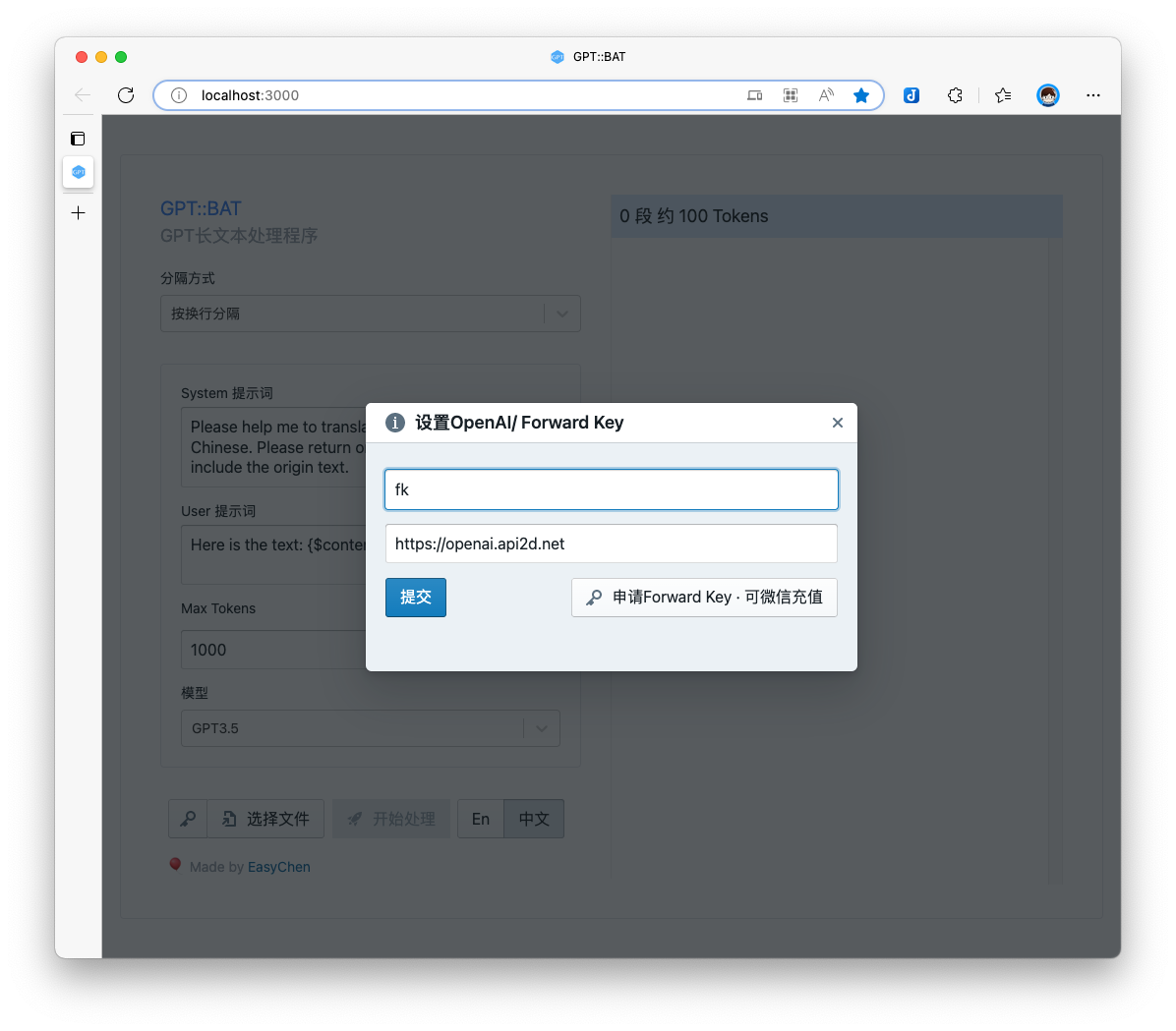

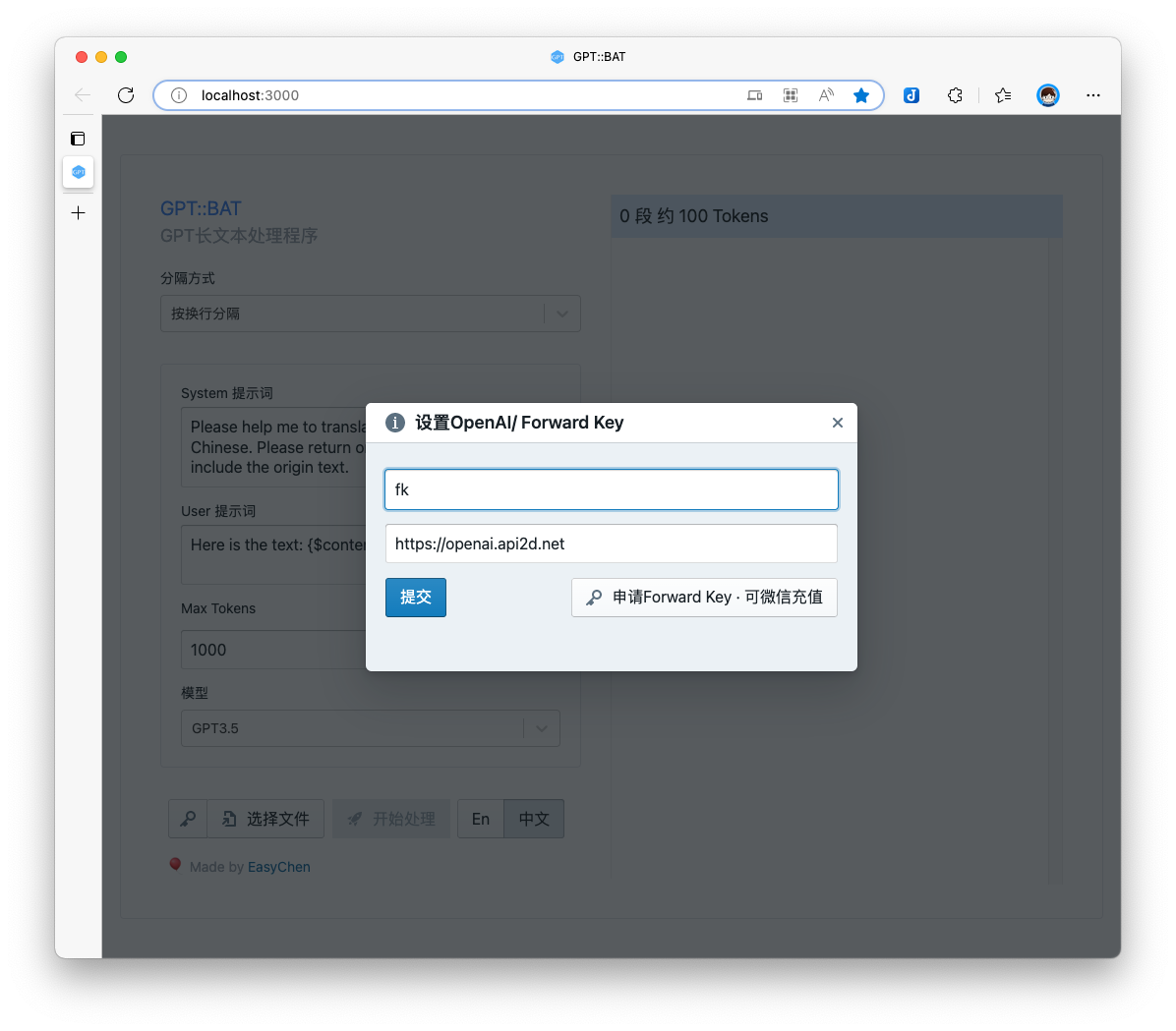

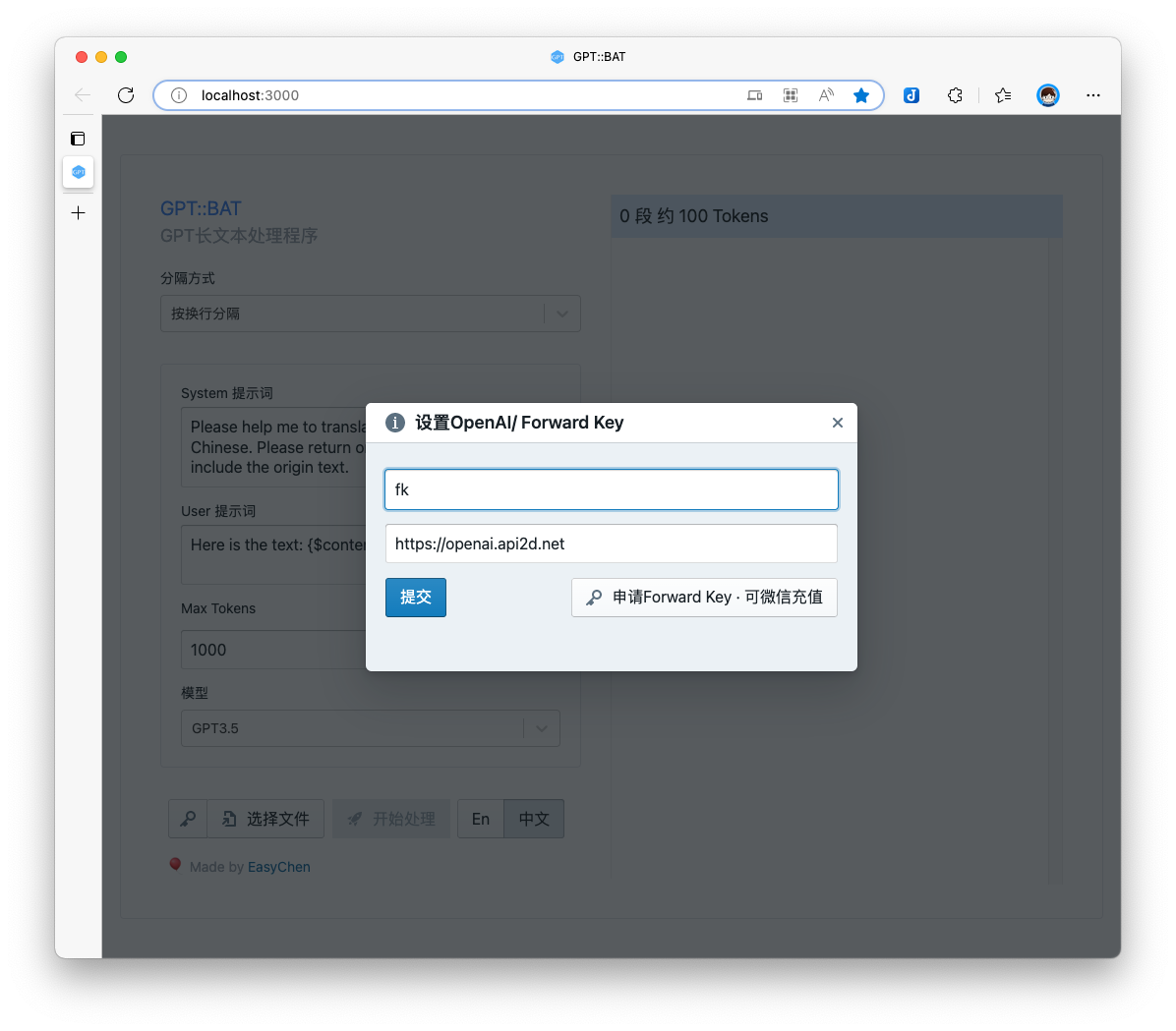

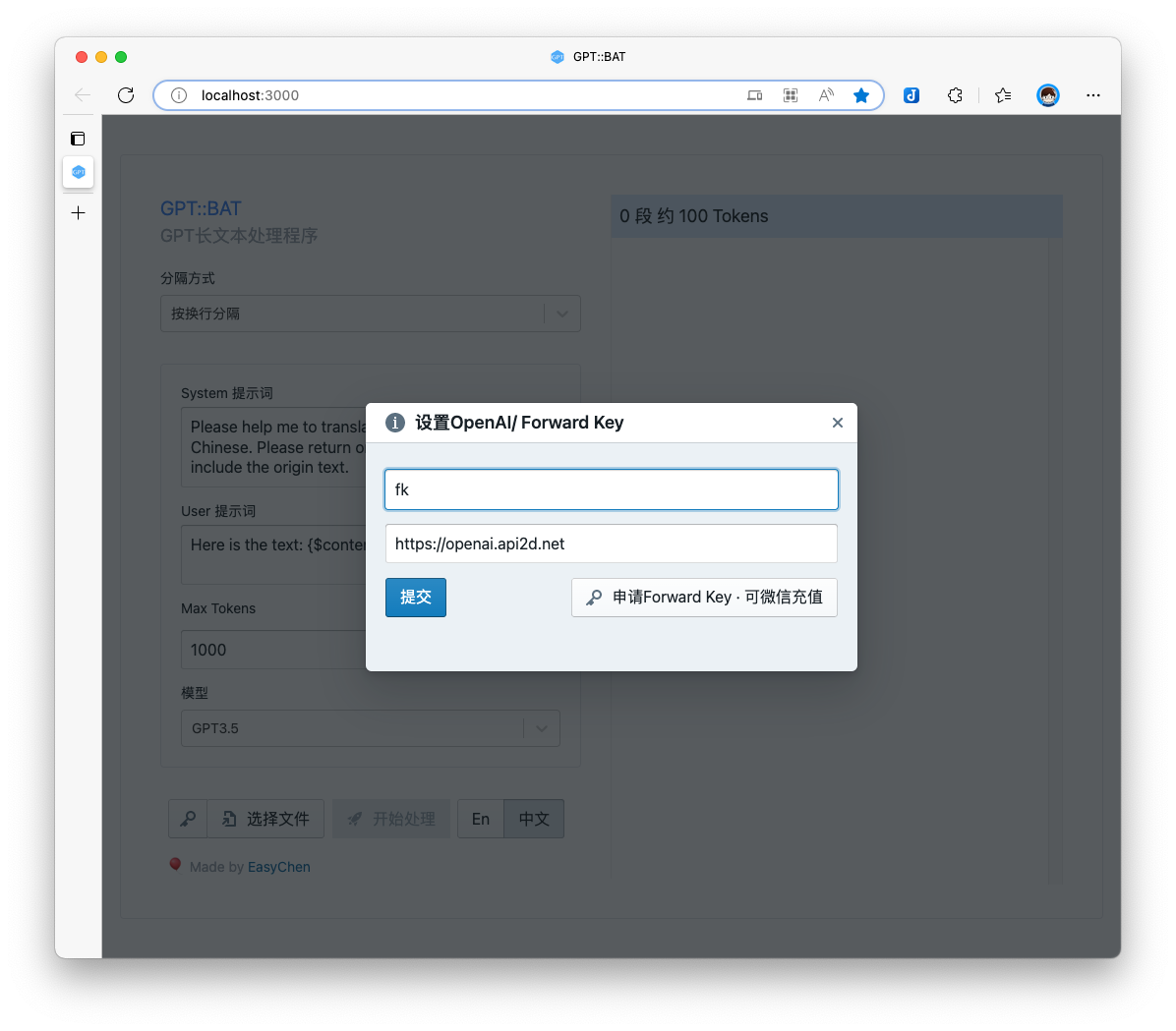

- Haga clic en ? en la esquina inferior izquierda e ingrese su clave OpenAI o API2D.

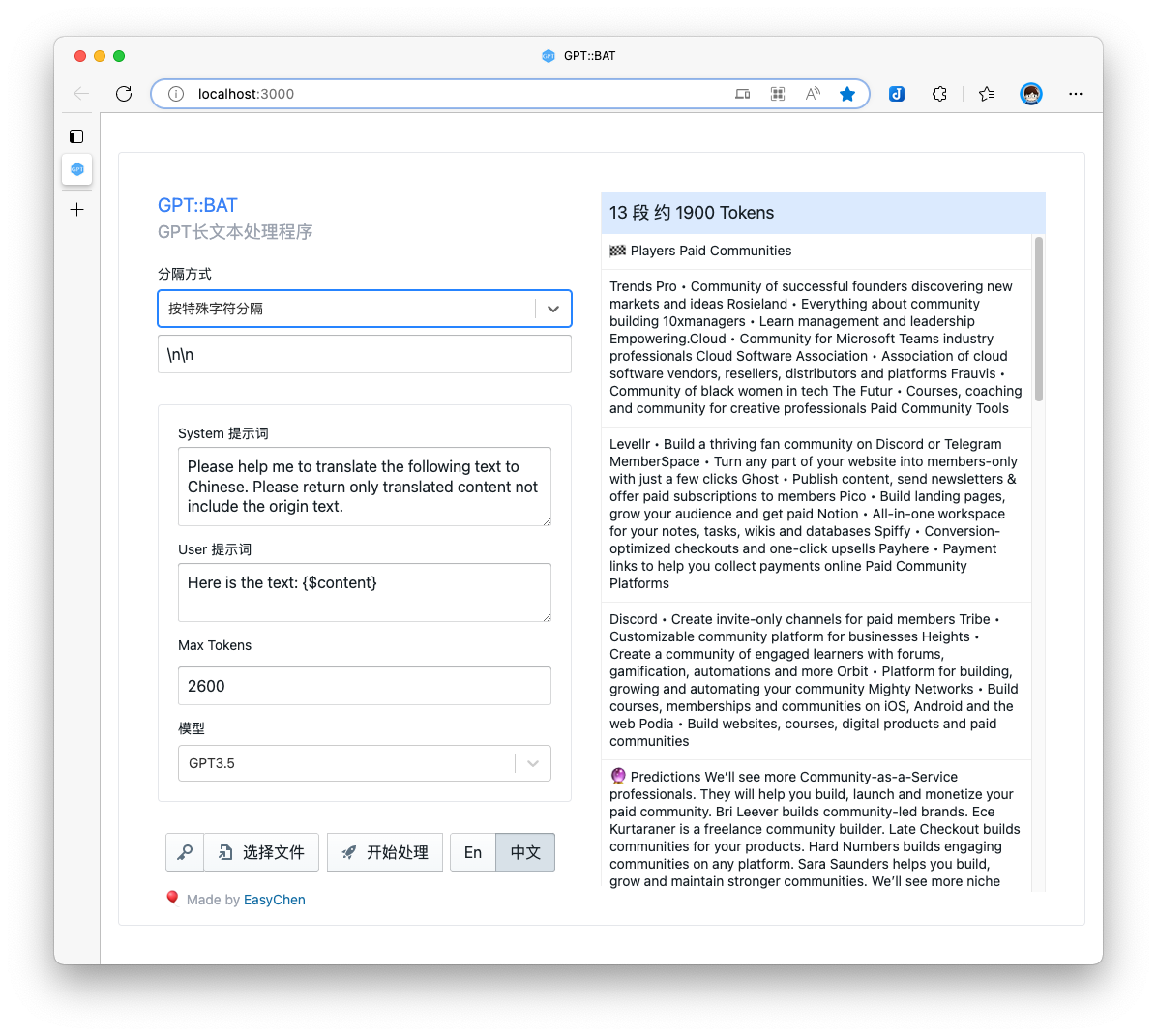

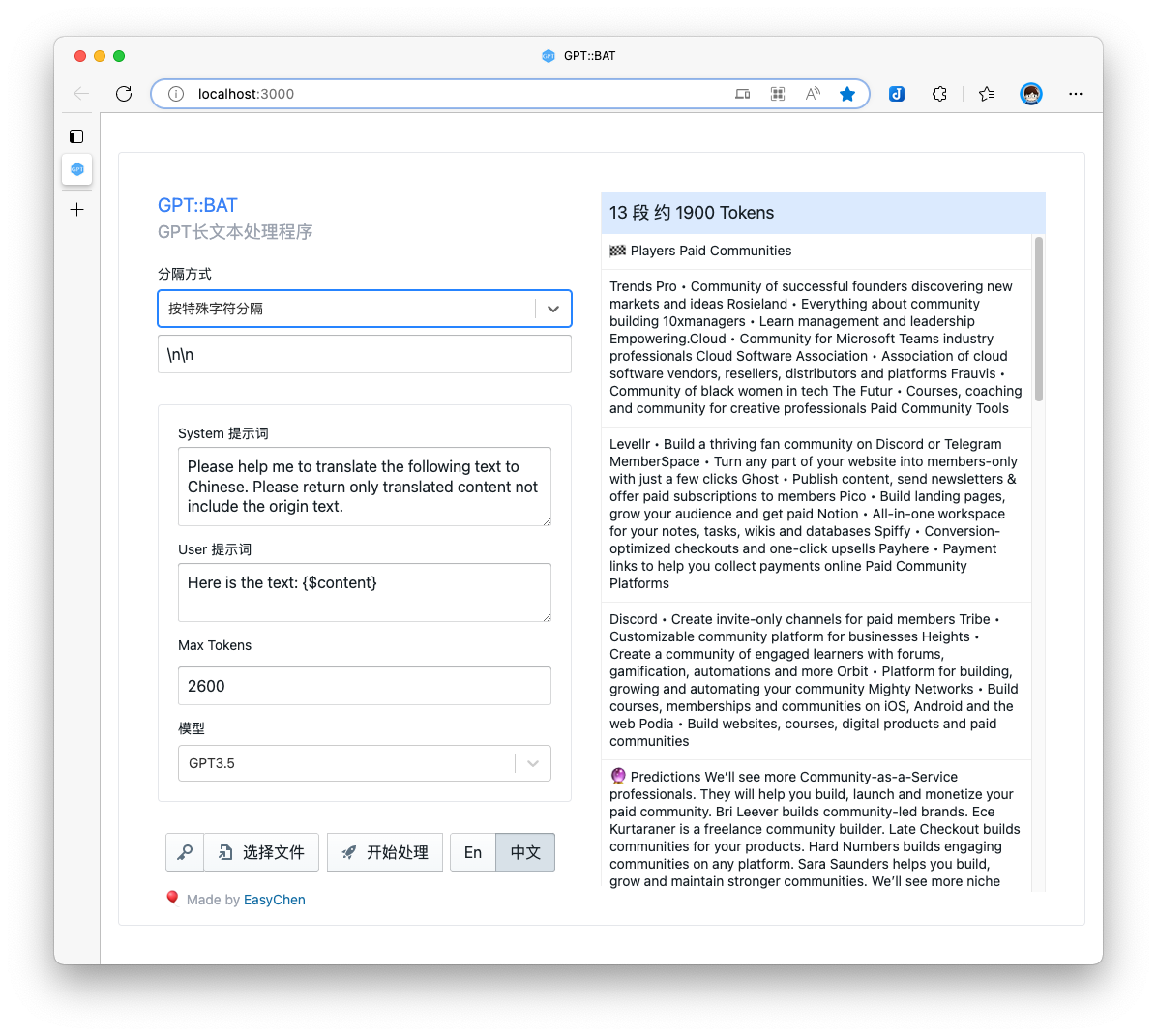

- Seleccione el archivo a procesar. La vista previa de la derecha muestra el texto segmentado y la cantidad estimada de tokens necesarios. Tenga en cuenta que este recuento de tokens es sólo una estimación aproximada y que el consumo real puede diferir.

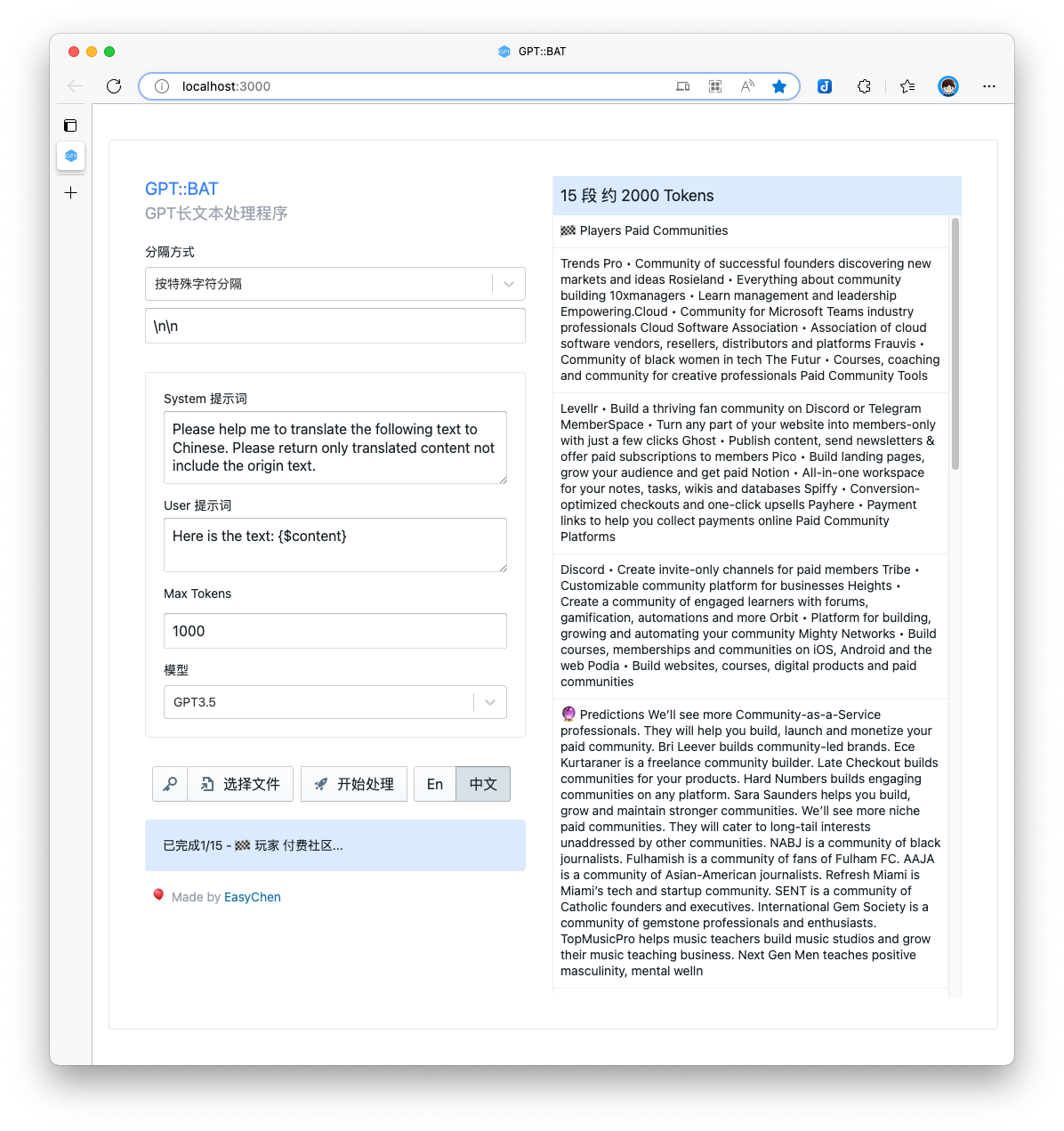

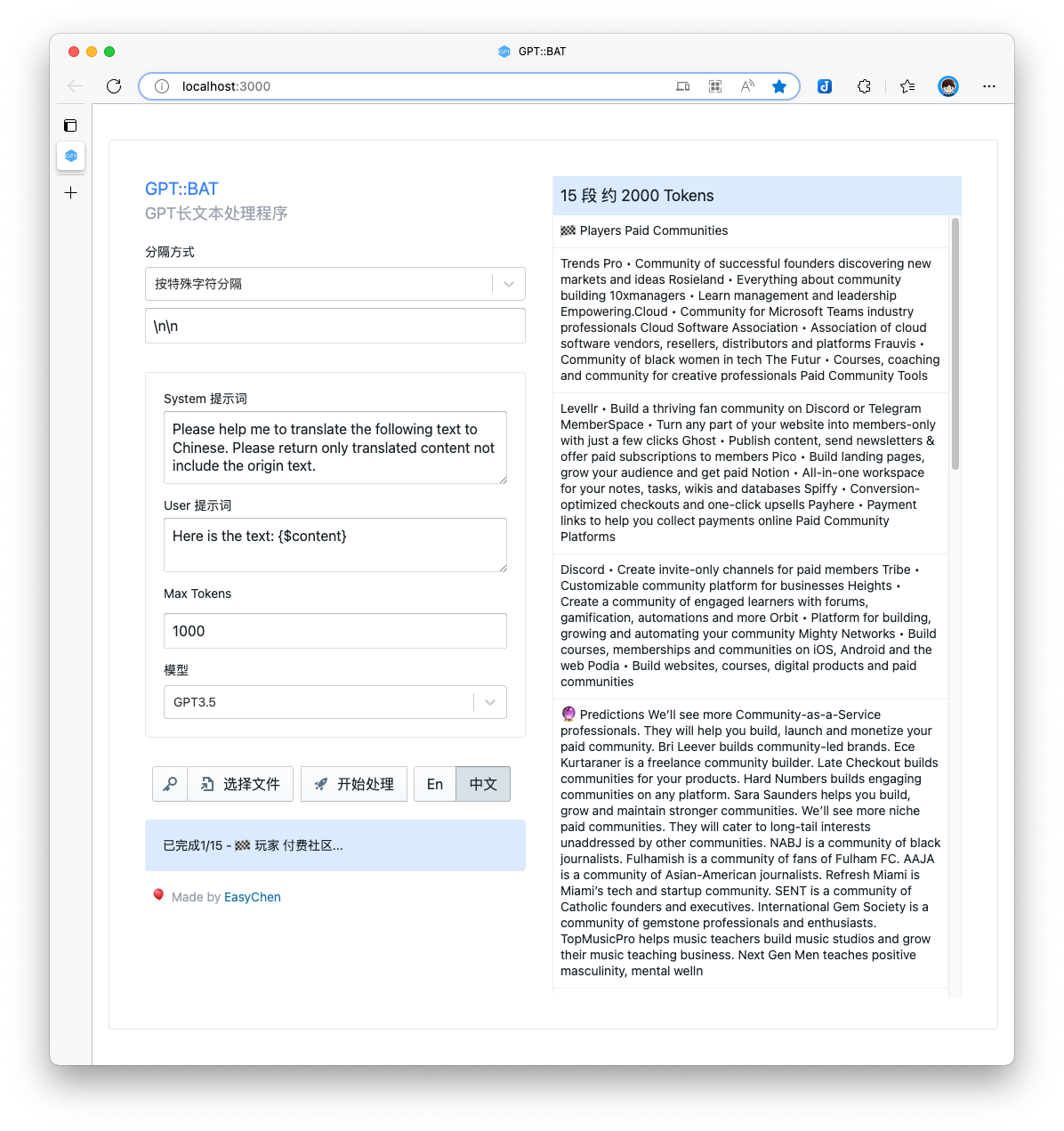

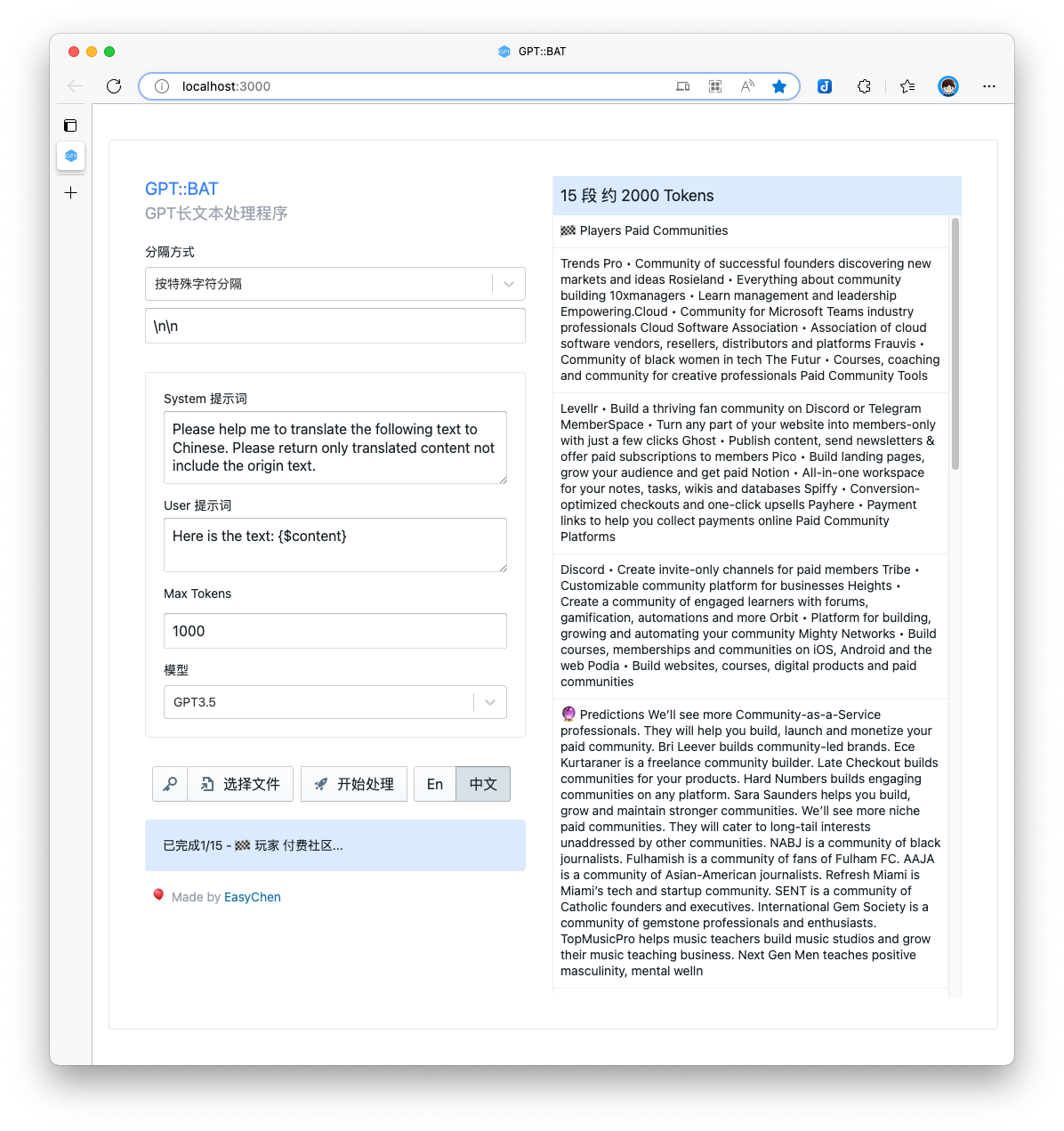

- Haga clic en "Iniciar procesamiento" para comenzar la operación por lotes. Si hay algún error, puede actualizar y volver a intentarlo. Las partes procesadas se almacenarán en caché en el navegador y se omitirán en intentos posteriores. Una vez completado, el archivo se descargará automáticamente. Verifique el archivo y borre el caché si es necesario.

BAT GPT

由于GPT尤其是3.5每次能处理的内容有限,如果有长内容要处理,聊天窗口就显得特别麻烦,因此我开发了GPT BAT,它可以将长文分隔,提交给GPT,然后再将内容拼接下载.

https://r.ftqq.com/gpt-bat/

使用说明

- 选择分隔方式,可以按行、按长度或者按特殊字符分隔。

- 填入每次调用 Chat GPT 接口的设置,包括 Sistema 提示词,Usuario 提示词,Max Tokens,模型.

- 点击左下角的 ? Clave de API2D de OpenAI

- Token 数量,注意这个 Token只是非常粗略的估算,一切以最终消费为准.

- 点击「开始处理」,进行批量操作。如中途失败,可刷新重试,已处理部分会缓存到浏览器,自行跳过不会再次处理。完成后会自动下载文件,查看文件无误后,可以清除缓存。