Mejora tu Alexa haciéndola responder como ChatGPT.

Este repositorio contiene un tutorial sobre cómo crear una habilidad de Alexa simple que utiliza la API OpenAI para generar respuestas del modelo ChatGPT.

Inicie sesión en su cuenta de desarrollador de Amazon y navegue hasta la Consola de desarrollador de Alexa.

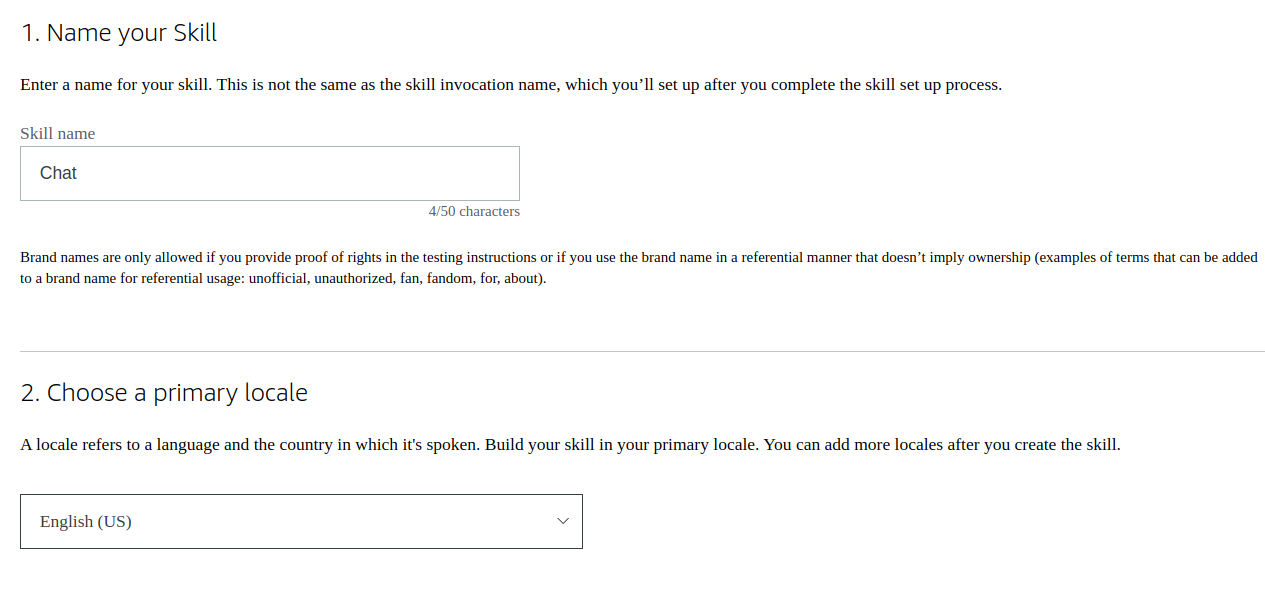

Haga clic en "Crear habilidad" y nombre la habilidad "Chat". Elija la configuración regional principal según su idioma.

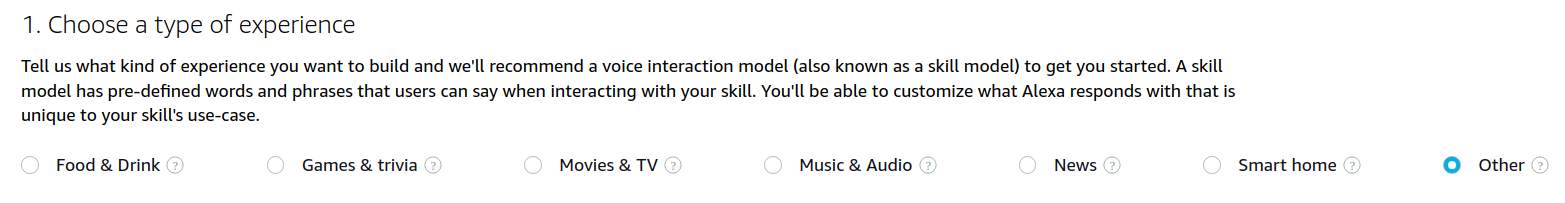

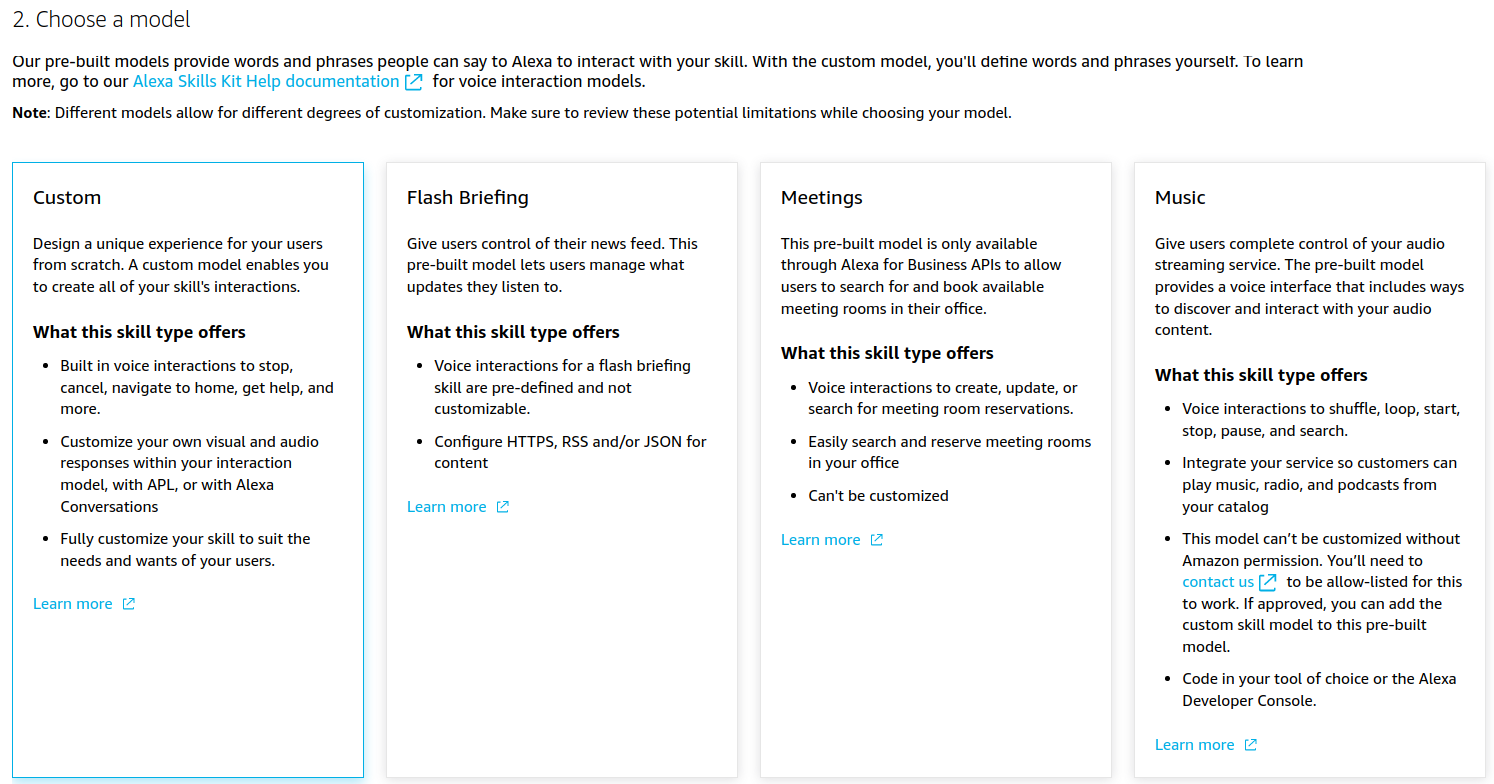

Elija "Otro" y "Personalizado" para el modelo.

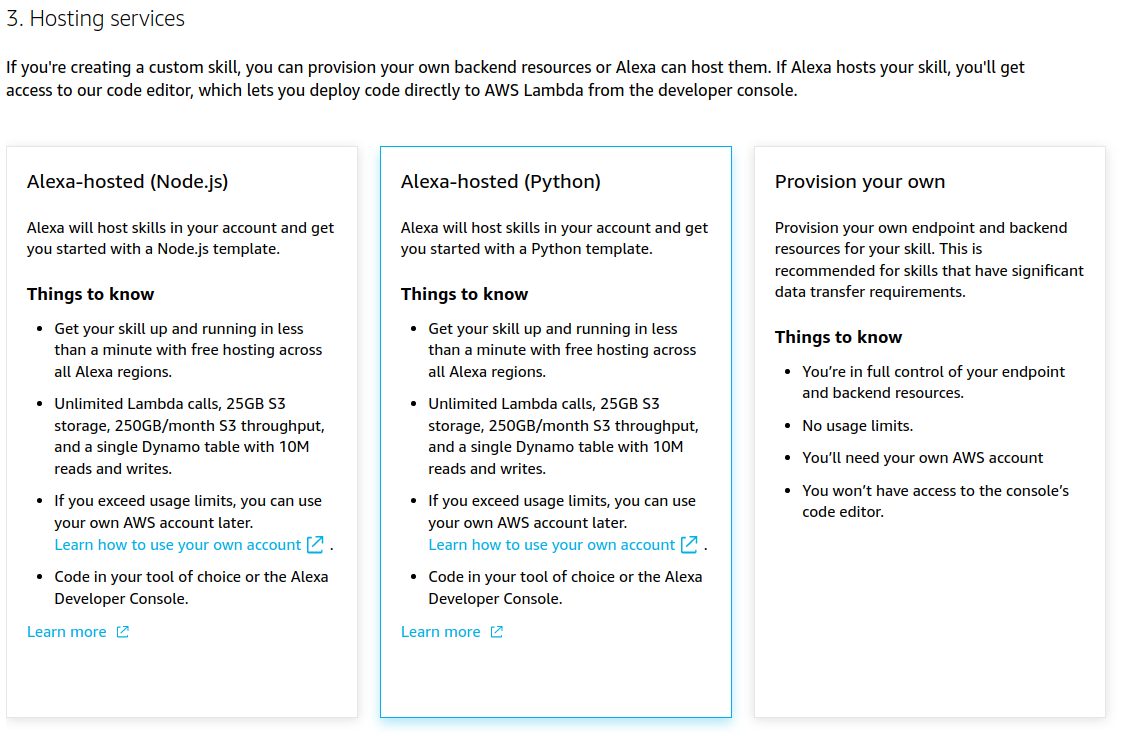

Elija "Alojado en Alexa (Python)" para los recursos de backend.

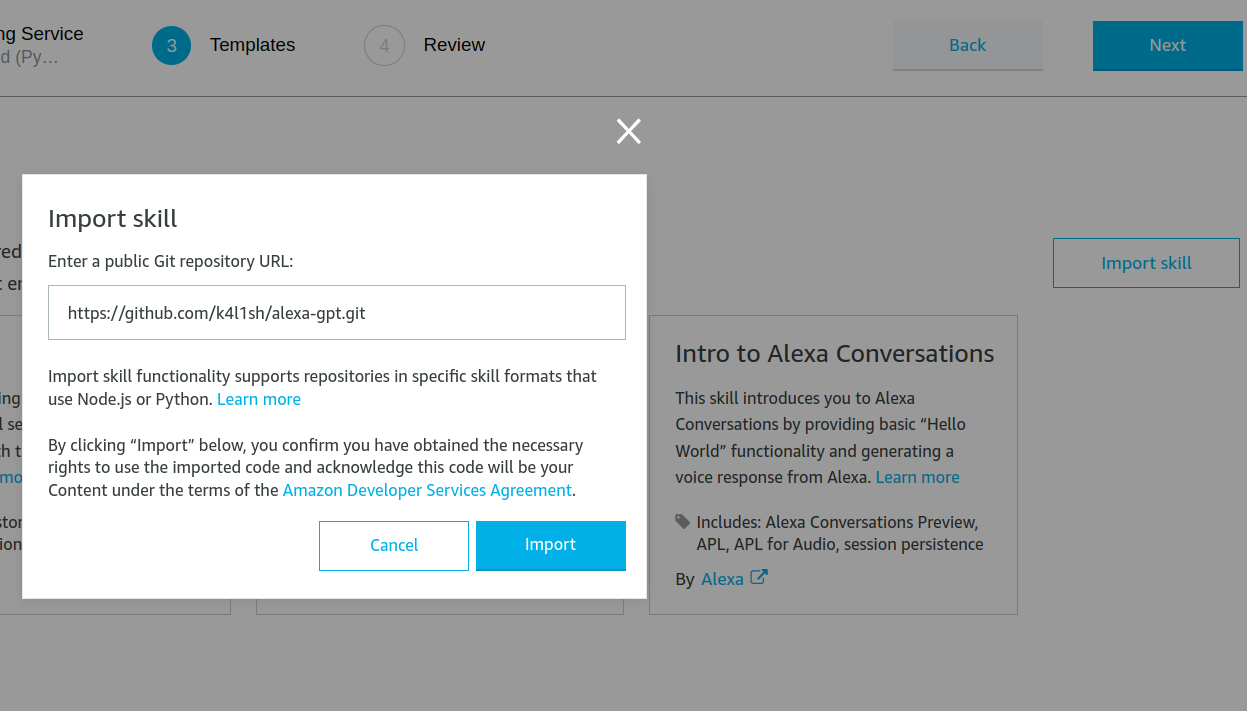

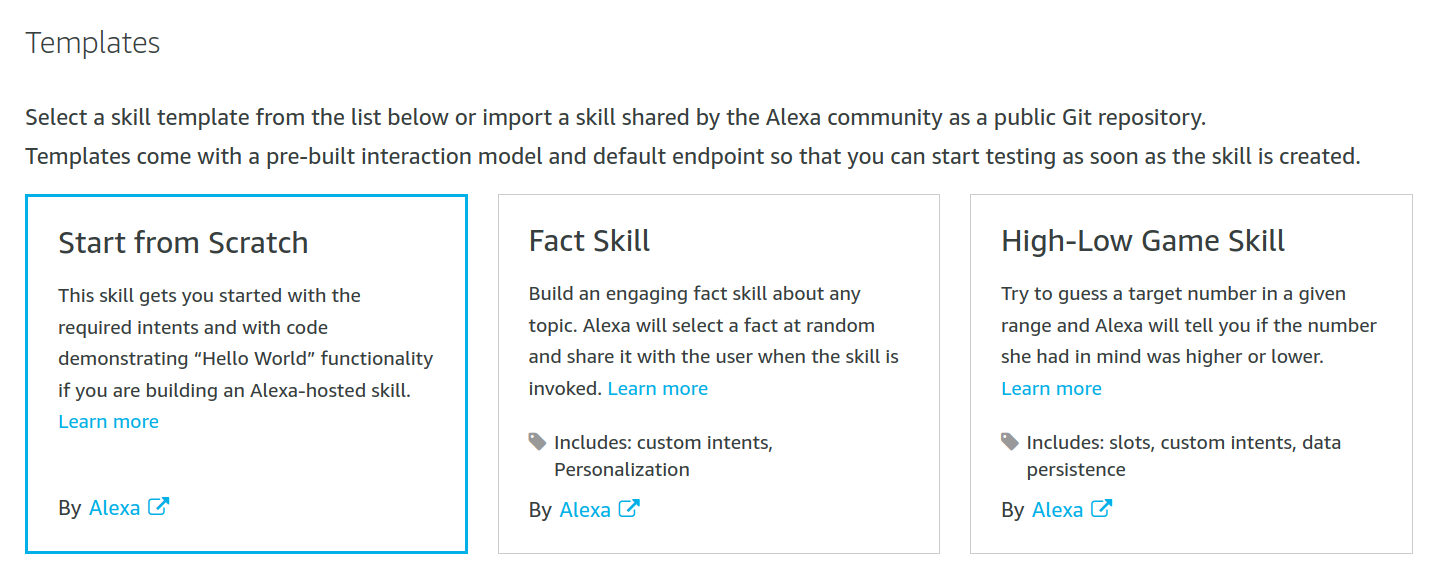

Ahora tienes dos opciones:

O si quieres crear la habilidad manualmente

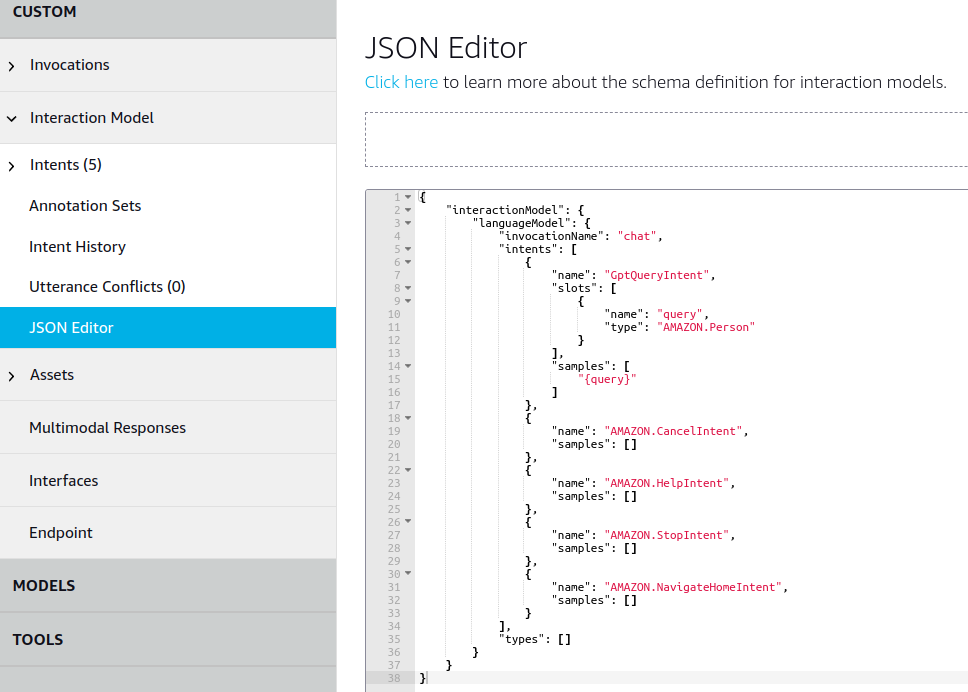

En la sección "Compilar", navegue hasta la pestaña "Editor JSON".

Si ha importado directamente la habilidad desde este repositorio, simplemente cambie el "nombre de invocación" a "chat" u otra palabra preferida para la activación y continúe con el paso 12.

Sin embargo, si elige crear manualmente la habilidad, reemplace el contenido JSON existente con el contenido JSON proporcionado:

{

"interactionModel" : {

"languageModel" : {

"invocationName" : " chat " ,

"intents" : [

{

"name" : " GptQueryIntent " ,

"slots" : [

{

"name" : " query " ,

"type" : " AMAZON.Person "

}

],

"samples" : [

" {query} "

]

},

{

"name" : " AMAZON.CancelIntent " ,

"samples" : []

},

{

"name" : " AMAZON.HelpIntent " ,

"samples" : []

},

{

"name" : " AMAZON.StopIntent " ,

"samples" : []

},

{

"name" : " AMAZON.NavigateHomeIntent " ,

"samples" : []

}

],

"types" : []

}

}

}

Guarde el modelo y haga clic en "Construir modelo".

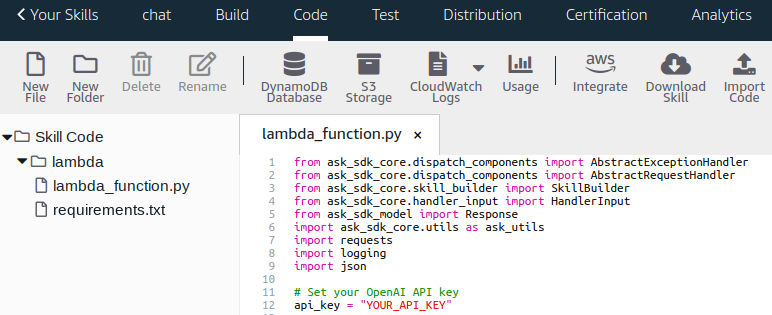

Vaya a la sección "Código" y agregue "openai" a requisitos.txt. Su archivo de requisitos.txt debería verse así:

ask-sdk-core==1.11.0

boto3==1.9.216

requests>=2.20.0Cree una clave API de OpenAI en la página de claves API haciendo clic en "+ Crear nueva clave secreta".

Reemplace su archivo lambda_functions.py con el lambda_function.py proporcionado.

from ask_sdk_core . dispatch_components import AbstractExceptionHandler

from ask_sdk_core . dispatch_components import AbstractRequestHandler

from ask_sdk_core . skill_builder import SkillBuilder

from ask_sdk_core . handler_input import HandlerInput

from ask_sdk_model import Response

import ask_sdk_core . utils as ask_utils

import requests

import logging

import json

# Set your OpenAI API key

api_key = "YOUR_API_KEY"

logger = logging . getLogger ( __name__ )

logger . setLevel ( logging . INFO )

class LaunchRequestHandler ( AbstractRequestHandler ):

"""Handler for Skill Launch."""

def can_handle ( self , handler_input ):

# type: (HandlerInput) -> bool

return ask_utils . is_request_type ( "LaunchRequest" )( handler_input )

def handle ( self , handler_input ):

# type: (HandlerInput) -> Response

speak_output = "Chat G.P.T. mode activated"

session_attr = handler_input . attributes_manager . session_attributes

session_attr [ "chat_history" ] = []

return (

handler_input . response_builder

. speak ( speak_output )

. ask ( speak_output )

. response

)

class GptQueryIntentHandler ( AbstractRequestHandler ):

"""Handler for Gpt Query Intent."""

def can_handle ( self , handler_input ):

# type: (HandlerInput) -> bool

return ask_utils . is_intent_name ( "GptQueryIntent" )( handler_input )

def handle ( self , handler_input ):

# type: (HandlerInput) -> Response

query = handler_input . request_envelope . request . intent . slots [ "query" ]. value

session_attr = handler_input . attributes_manager . session_attributes

if "chat_history" not in session_attr :

session_attr [ "chat_history" ] = []

response = generate_gpt_response ( session_attr [ "chat_history" ], query )

session_attr [ "chat_history" ]. append (( query , response ))

return (

handler_input . response_builder

. speak ( response )

. ask ( "Any other questions?" )

. response

)

class CatchAllExceptionHandler ( AbstractExceptionHandler ):

"""Generic error handling to capture any syntax or routing errors."""

def can_handle ( self , handler_input , exception ):

# type: (HandlerInput, Exception) -> bool

return True

def handle ( self , handler_input , exception ):

# type: (HandlerInput, Exception) -> Response

logger . error ( exception , exc_info = True )

speak_output = "Sorry, I had trouble doing what you asked. Please try again."

return (

handler_input . response_builder

. speak ( speak_output )

. ask ( speak_output )

. response

)

class CancelOrStopIntentHandler ( AbstractRequestHandler ):

"""Single handler for Cancel and Stop Intent."""

def can_handle ( self , handler_input ):

# type: (HandlerInput) -> bool

return ( ask_utils . is_intent_name ( "AMAZON.CancelIntent" )( handler_input ) or

ask_utils . is_intent_name ( "AMAZON.StopIntent" )( handler_input ))

def handle ( self , handler_input ):

# type: (HandlerInput) -> Response

speak_output = "Leaving Chat G.P.T. mode"

return (

handler_input . response_builder

. speak ( speak_output )

. response

)

def generate_gpt_response ( chat_history , new_question ):

"""Generates a GPT response to a new question"""

headers = {

"Authorization" : f"Bearer { api_key } " ,

"Content-Type" : "application/json"

}

url = "https://api.openai.com/v1/chat/completions"

messages = [{ "role" : "system" , "content" : "You are a helpful assistant. Answer in 50 words or less." }]

for question , answer in chat_history [ - 10 :]:

messages . append ({ "role" : "user" , "content" : question })

messages . append ({ "role" : "assistant" , "content" : answer })

messages . append ({ "role" : "user" , "content" : new_question })

data = {

"model" : "gpt-4o-mini" ,

"messages" : messages ,

"max_tokens" : 300 ,

"temperature" : 0.5

}

try :

response = requests . post ( url , headers = headers , data = json . dumps ( data ))

response_data = response . json ()

if response . ok :

return response_data [ 'choices' ][ 0 ][ 'message' ][ 'content' ]

else :

return f"Error { response . status_code } : { response_data [ 'error' ][ 'message' ] } "

except Exception as e :

return f"Error generating response: { str ( e ) } "

sb = SkillBuilder ()

sb . add_request_handler ( LaunchRequestHandler ())

sb . add_request_handler ( GptQueryIntentHandler ())

sb . add_request_handler ( CancelOrStopIntentHandler ())

sb . add_exception_handler ( CatchAllExceptionHandler ())

lambda_handler = sb . lambda_handler ()Coloque su clave API de OpenAI que obtuvo de su cuenta OpenAI

Guardar e implementar. Vaya a la sección "Prueba" y habilite "Prueba de habilidades" en "Desarrollo".

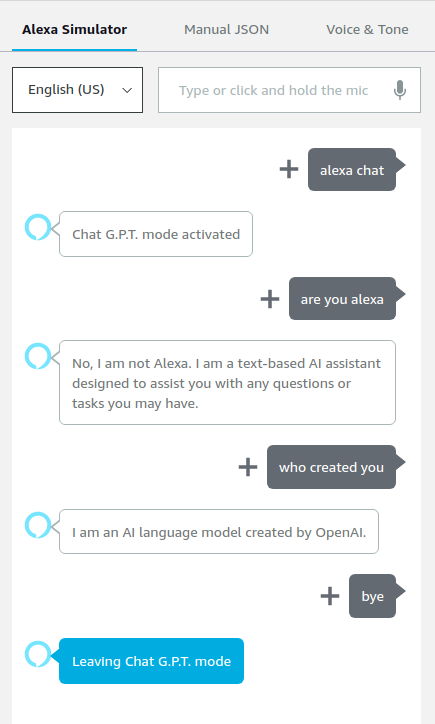

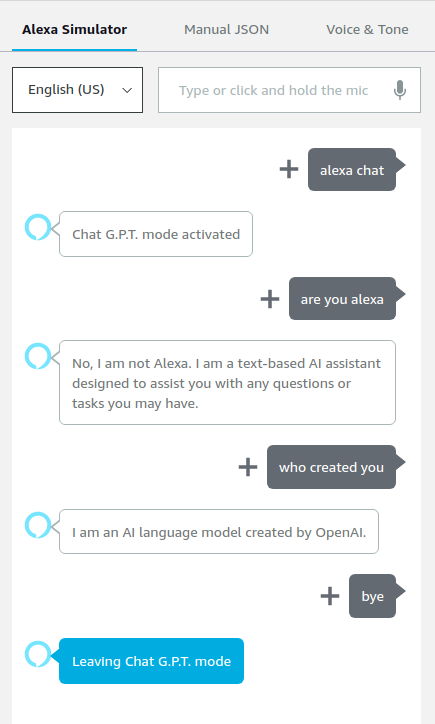

Ahora estás listo para usar tu Alexa en modo ChatGPT. Deberías ver resultados como este:

Tenga en cuenta que la ejecución de esta habilidad generará costos por el uso de AWS Lambda y la API de OpenAI. Asegúrese de comprender la estructura de precios y controlar su uso para evitar cargos inesperados.