Foundationa LLM : la plataforma para implementar, escalar, asegurar y gobernar la IA generativa en las empresas

Foundationa LLM proporciona la plataforma para implementar, escalar, proteger y gobernar la IA generativa en la empresa. Con Foundationa LLM puedes:

- Cree agentes de IA que se basen en los datos de su empresa, ya sean texto, datos semiestructurados o estructurados.

- Haga que los agentes de IA estén disponibles para sus usuarios a través de una interfaz de chat personalizada o integre la API REST al agente de IA en su aplicación para una experiencia de copiloto o integre la API del agente en un proceso automatizado de máquina a máquina.

- Agentes de creación de experimentos que pueden utilizar una variedad de modelos de lenguaje grandes, incluidos OpenAI GPT-4, Mistral y Llama 2 o cualquier modelo extraído del catálogo de modelos de Hugging Face que proporciona un punto final de finalización REST.

- Administre, configure y proteja de manera centralizada sus agentes de IA Y sus activos subyacentes, incluidos mensajes, fuentes de datos, canalizaciones de datos de vectorización, bases de datos vectoriales y modelos de lenguaje de gran tamaño mediante el portal de administración.

- Permita que todos en su empresa creen sus propios agentes de IA. Sus usuarios que no son desarrolladores pueden crear e implementar sus propios agentes de forma autoservicio desde el portal de administración, pero no nos interponemos en el camino de sus desarrolladores avanzados de IA que pueden implementar sus propias orquestaciones integradas en LangChain, Semantic Kernel, Prompt Flow o cualquier orquestación que exponga un punto final de finalización.

- Implemente y administre canalizaciones de datos de vectorización escalables que pueden ingerir millones de documentos para proporcionar conocimiento a su modelo.

- Ofrezca a sus usuarios tantos agentes de IA centrados en tareas como deseen.

- Controle el acceso a los agentes de IA y los recursos a los que acceden mediante controles de acceso basados en roles (RBAC).

- Aproveche las capacidades en rápida evolución de Azure AI y Azure OpenAI desde una pila integrada.

Nota

Foundationa LLM no es un modelo de lenguaje grande. Le permite utilizar los modelos de lenguaje grandes de su elección (por ejemplo, OpenAI GPT-4, Mistral, LLama 2, etc.)

Foundationa LLM implementa una plataforma copiloto segura, integral y altamente configurable en su entorno de nube de Azure:

- Simplifica la integración con fuentes de datos empresariales utilizadas por el agente para el aprendizaje en contexto (por ejemplo, habilitando patrones RAG, CoT, ReAct y monólogo interno).

- Proporciona una defensa en profundidad con controles de seguridad detallados sobre los datos utilizados por el agente y filtros previos y posteriores a la finalización que protegen contra ataques.

- Solución reforzada atacada por un equipo rojo de LLM desde el principio.

- La carga de la solución escalable equilibra varios puntos finales de LLM.

- Extensible a nuevas fuentes de datos, nuevos orquestadores de LLM y LLM.

¿Por qué se necesita Foundationa LLM ?

En pocas palabras, vimos a muchas personas reinventar la rueda solo para obtener un copiloto personalizado o un agente de IA que estuviera conectado a tierra y basara sus respuestas en sus propios datos en lugar de en el conocimiento paramétrico entrenado del modelo. Muchas de las soluciones que vimos fueron ideales para demostraciones excelentes, pero en realidad eran juguetes que envolvían llamadas a puntos finales de OpenAI; no eran algo pensado ni listo para implementarse en producción a escala empresarial. Construimos Foundationa LLM para proporcionar un viaje continuo, uno que fuera rápido para comenzar, de modo que las personas pudieran experimentar rápidamente con LLM pero no caer por un precipicio después de eso con una solución que sería insegura, sin licencia, inflexible y sin todas las funciones necesarias para crezca desde el prototipo hasta una solución de producción sin tener que empezar de nuevo.

Los problemas centrales para entregar copilotos empresariales o agentes de IA son:

- Los copilotos de nivel empresarial o agentes de IA son complejos y tienen muchas partes móviles (sin mencionar la infraestructura).

- La industria tiene una brecha de habilidades cuando se trata de desempeñar los roles necesarios para ofrecer estas complejas soluciones de copiloto.

- Los principales riesgos de la IA (inexactitud, ciberseguridad, cumplimiento, explicabilidad, privacidad) no se mitigan con herramientas individuales.

- La entrega de una solución de copiloto o agente de IA lleva mucho tiempo, es costosa y frustrante cuando se comienza desde cero.

El concepto erróneo versus la realidad

Idea falsa

Existe la idea errónea de que crear aplicaciones LLM y agentes de IA se trata de ingeniería rápida; es tan fácil como:

Esto puede ser cierto para demostraciones y escenarios de juguetes, pero para los agentes de IA en la empresa existen muchos más requisitos, como por ejemplo:

- ¿Escalar y cargar por lotes miles o millones de documentos como conocimiento para el modelo? ¿Aprovechar otros LLM (Llama 2, Mistral) junto con los modelos ChatGPT?

- ¿Mantener las fuentes de conocimiento confidenciales privadas para los usuarios autorizados?

- ¿Evitar que se envíen datos confidenciales (PII, secretos comerciales) al LLM?

- ¿Conseguir tener múltiples agentes de IA?

- ¿Gobierna el uso de tokens y gestiona las devoluciones de cargos por aplicaciones?

Realidad

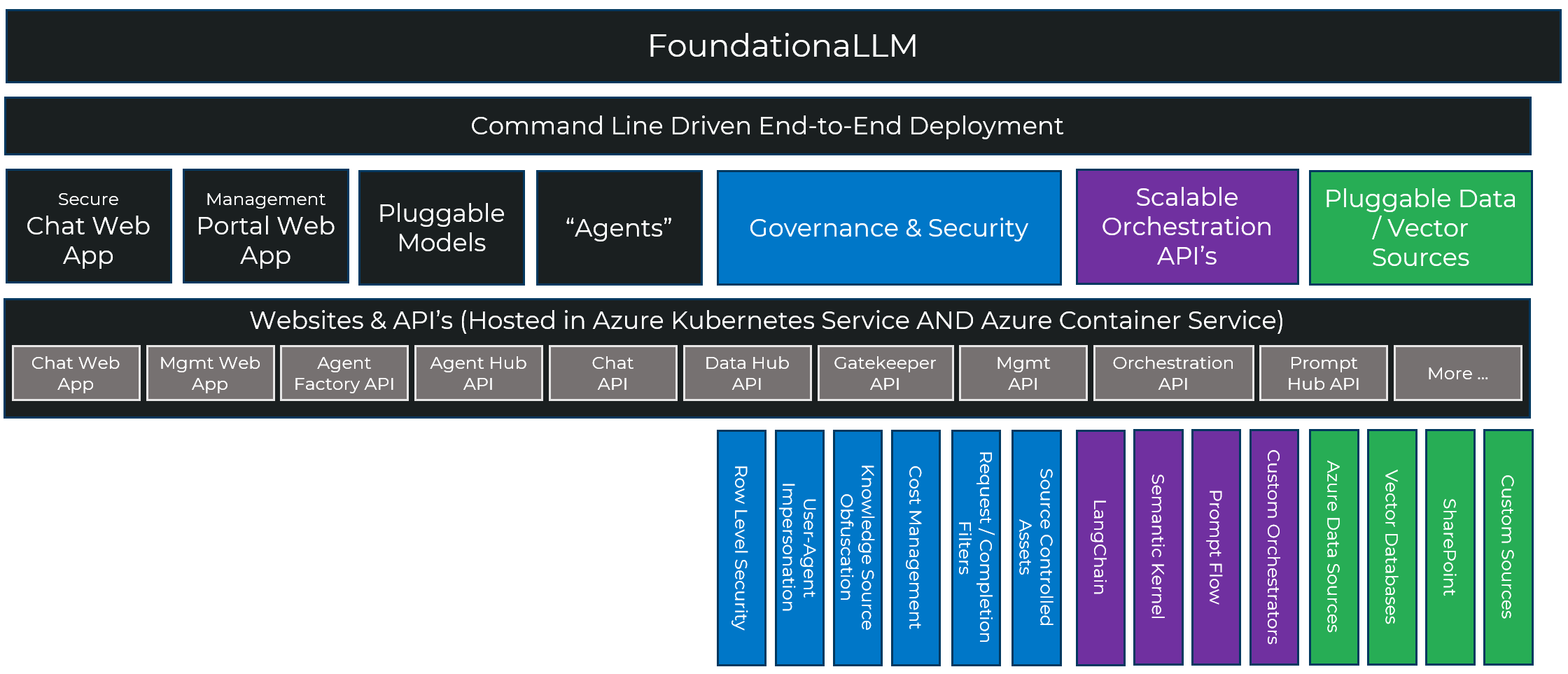

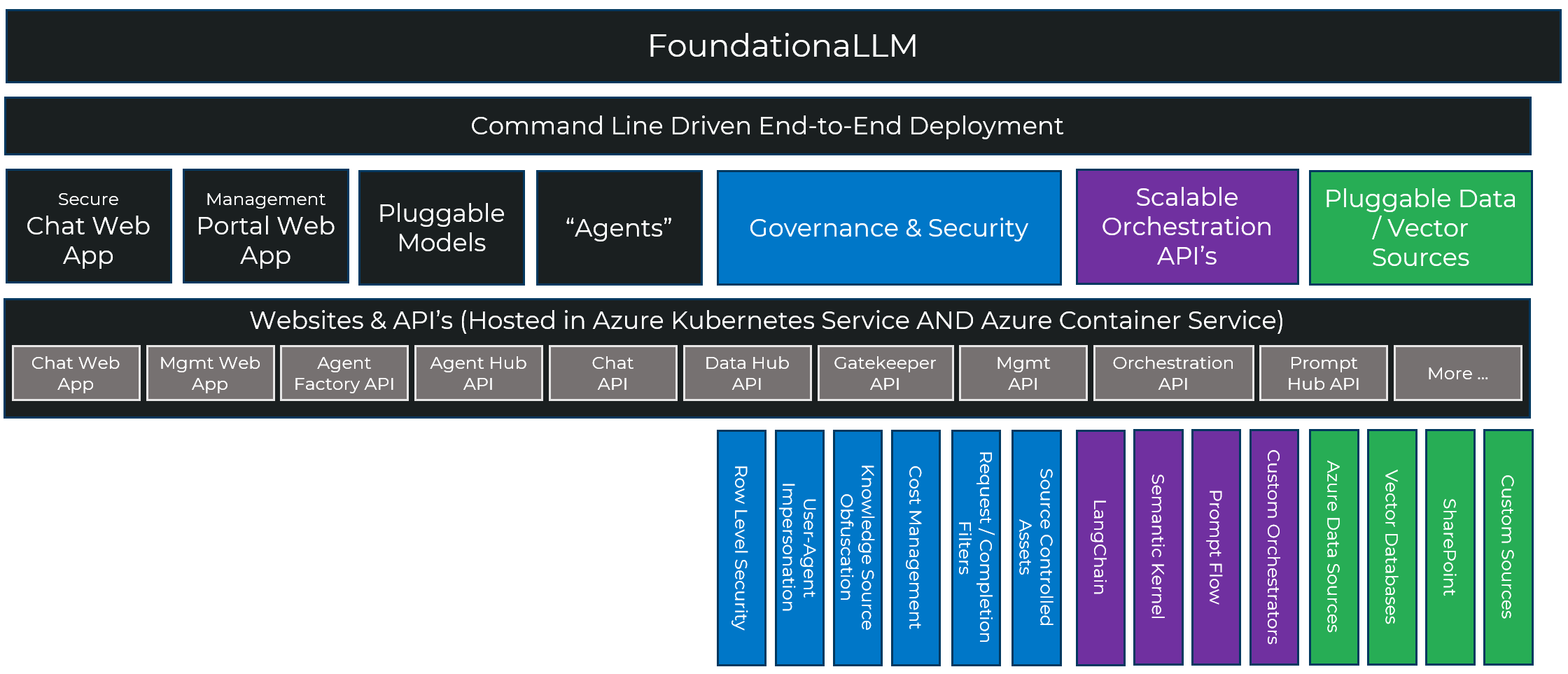

Hay muchos componentes necesarios para crear un agente de IA seguro, bien gobernado, escalable y extensible, y Foundationa LLM proporciona una pila integral para hacer que este proceso sea más rápido, más repetible y más confiable:

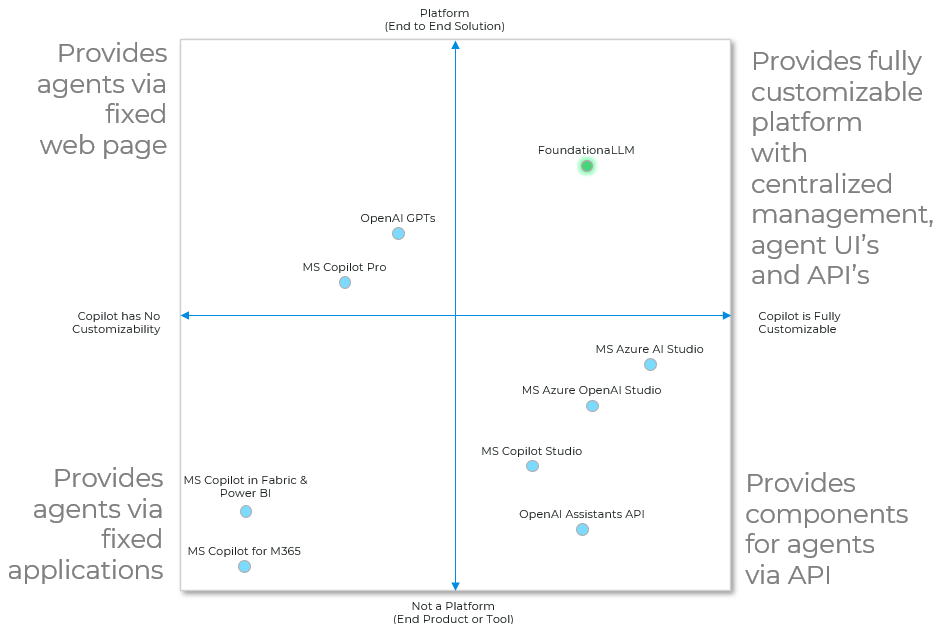

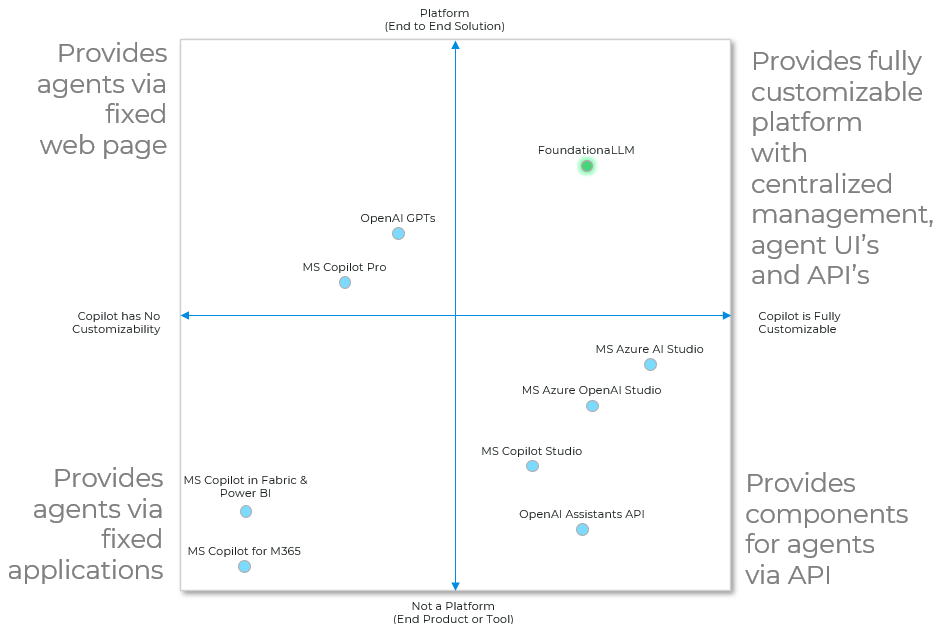

¿Dónde se ubica Foundationa LLM en comparación con otras soluciones?

Hay muchas herramientas excelentes en el ecosistema que ayudan con partes de la creación de un copiloto o un agente de IA. Solo Foundationa LLM los reúne para proporcionar una plataforma de extremo a extremo para crear agentes de IA totalmente personalizables con administración centralizada, UI de agente y API.

En su forma más básica, un copiloto o agente de IA utiliza conocimientos proporcionados por la empresa y modelos generativos de IA para crear texto, escribir código o representar imágenes, a menudo razonando sobre indicaciones proporcionadas por humanos. En todas estas modalidades, la IA se utiliza para ayudar a un humano directamente con una tarea específica.

Esta capacidad básica surge en dos arquetipos, los cuales Foundationa LLM admite de forma nativa:

- Gestión del conocimiento: ayude a los usuarios a encontrar rápidamente la información que buscan y a entregarla en el nivel y formato adecuados. Los ejemplos incluyen resúmenes, reformulación o reorientación para dirigirse a una persona (por ejemplo, explíquelo como si tuviera cinco años), análisis de sentimientos y recomendaciones.

- Análisis: ayude a los usuarios a obtener rápidamente la información que buscan basada en datos. Los ejemplos incluyen recomendaciones, predicciones, detección de anomalías, análisis estadístico y consulta e informes de datos.

Foundationa LLM simplifica y agiliza la creación de agentes de gestión del conocimiento (p. ej., agentes de preguntas y respuestas) y analíticos (p. ej., inteligencia empresarial de autoservicio) sobre las fuentes de datos presentes en toda su empresa.

Documentación

Póngase al día con Foundationa LLM leyendo la documentación. Esto incluye instrucciones de implementación, inicios rápidos, arquitectura y referencias de API.

Empezando

Foundationa LLM proporciona un enfoque simple basado en línea de comandos para poner en funcionamiento su primera implementación. Básicamente, son dos comandos. Después de eso, puede personalizar la solución, ejecutarla localmente en su máquina y actualizar la implementación con sus personalizaciones.

Siga las instrucciones de implementación de inicio rápido para implementar Foundationa LLM en su suscripción de Azure.

Informes de problemas y soporte

Si tiene algún problema con Foundationa LLM , abra un problema en GitHub. Responderemos a su problema lo antes posible. Utilice las etiquetas ( bug , documentation , general question , release xxx ) para categorizar su problema y proporcionar tantos detalles como sea posible para ayudarnos a comprender y resolver el problema.

Contribuyendo a Foundationa LLM

Nos complace aceptar contribuciones al proyecto FoundationaLLM en forma de comentarios, informes de errores y solicitudes de extracción. Consulte Contribución a FoundationaLLM para obtener instrucciones.