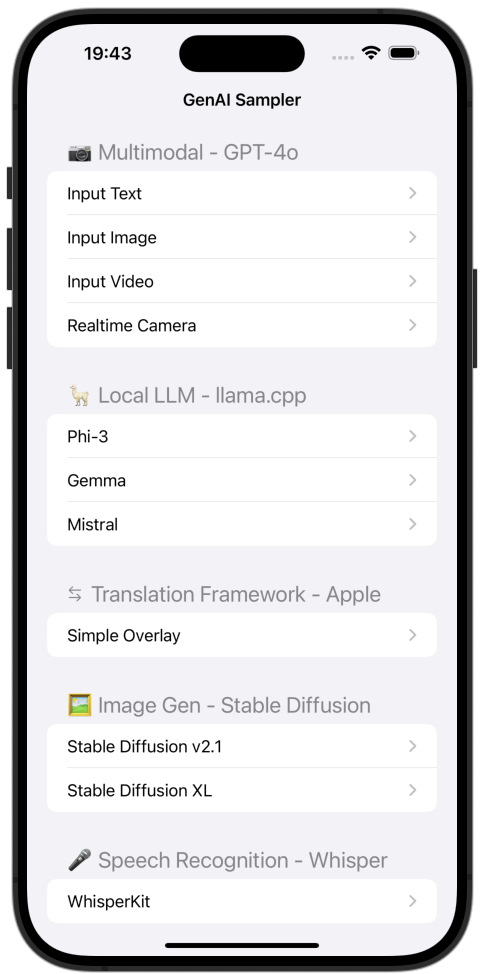

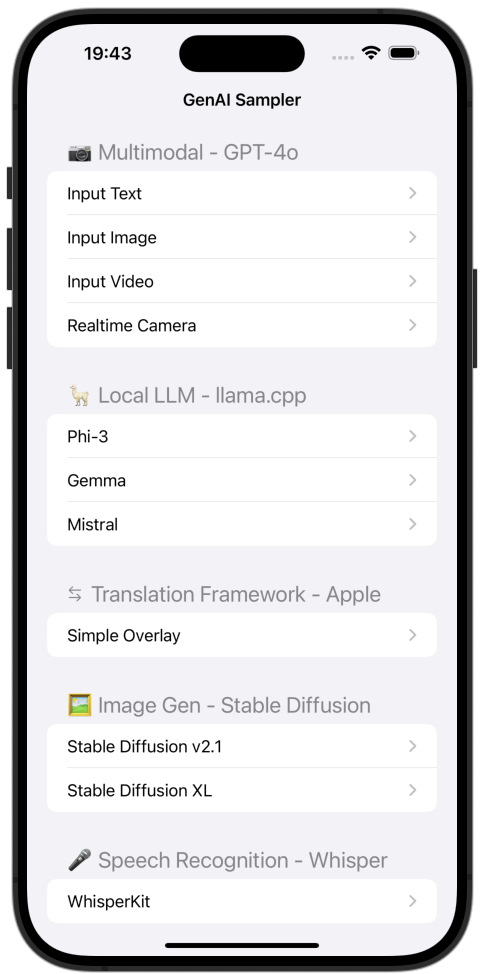

Muestra de iOS GenAI

Una colección de ejemplos de IA generativa en iOS.

Uso

- Cambie el nombre

APIKey.sample.swift a APIKey.swift y coloque su clave API de OpenAI en el valor de la propiedad apiKeyOpenAI . - Construye y ejecuta.

- Ejecútelo en su iPhone o iPad. (La muestra en tiempo real no funciona en simuladores).

Contenido

Ejemplos multimodales de GPT-4o

Chat de texto

Un ejemplo básico de chat de texto.

Muestra implementaciones tanto normales como de streaming.

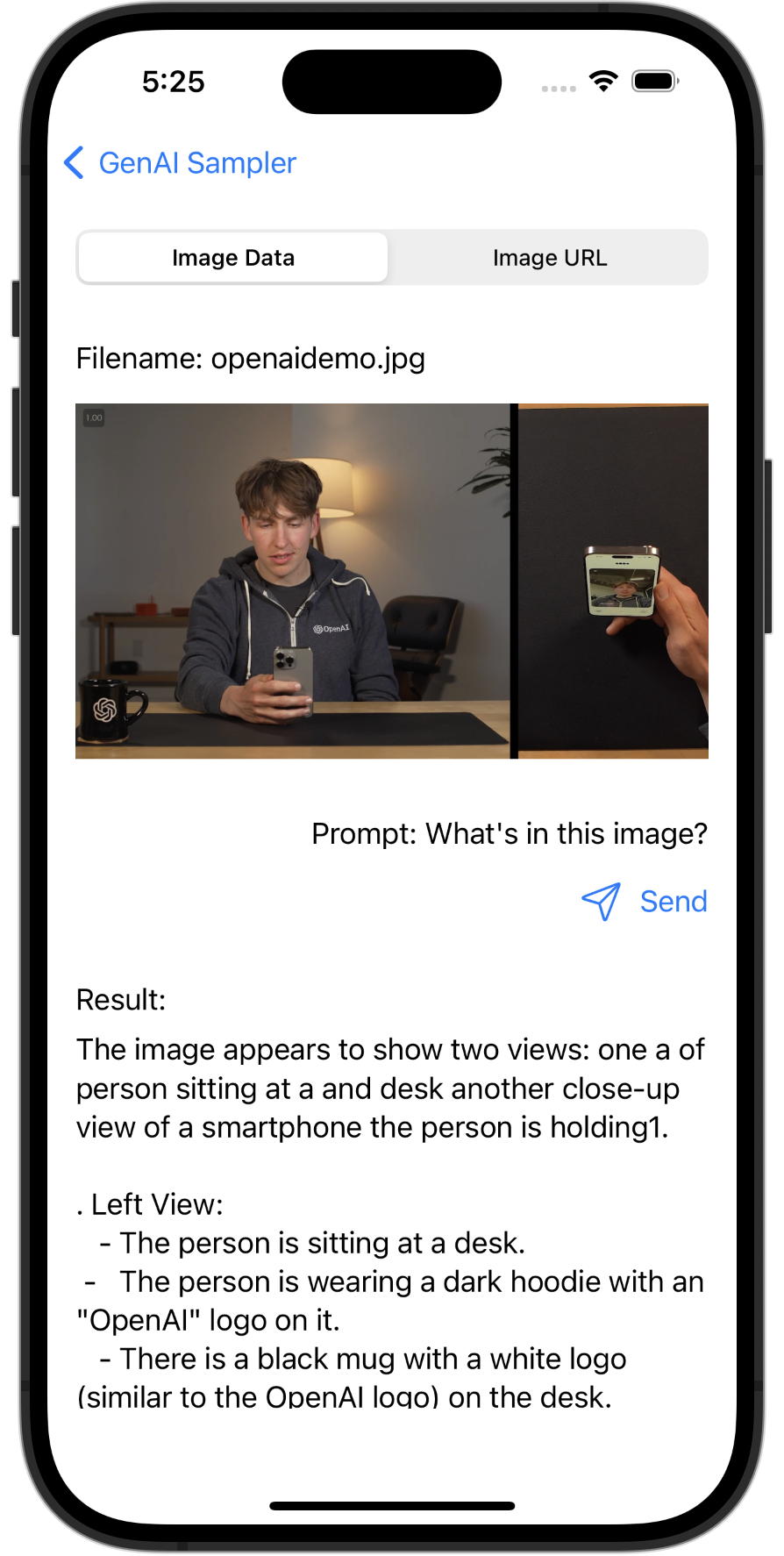

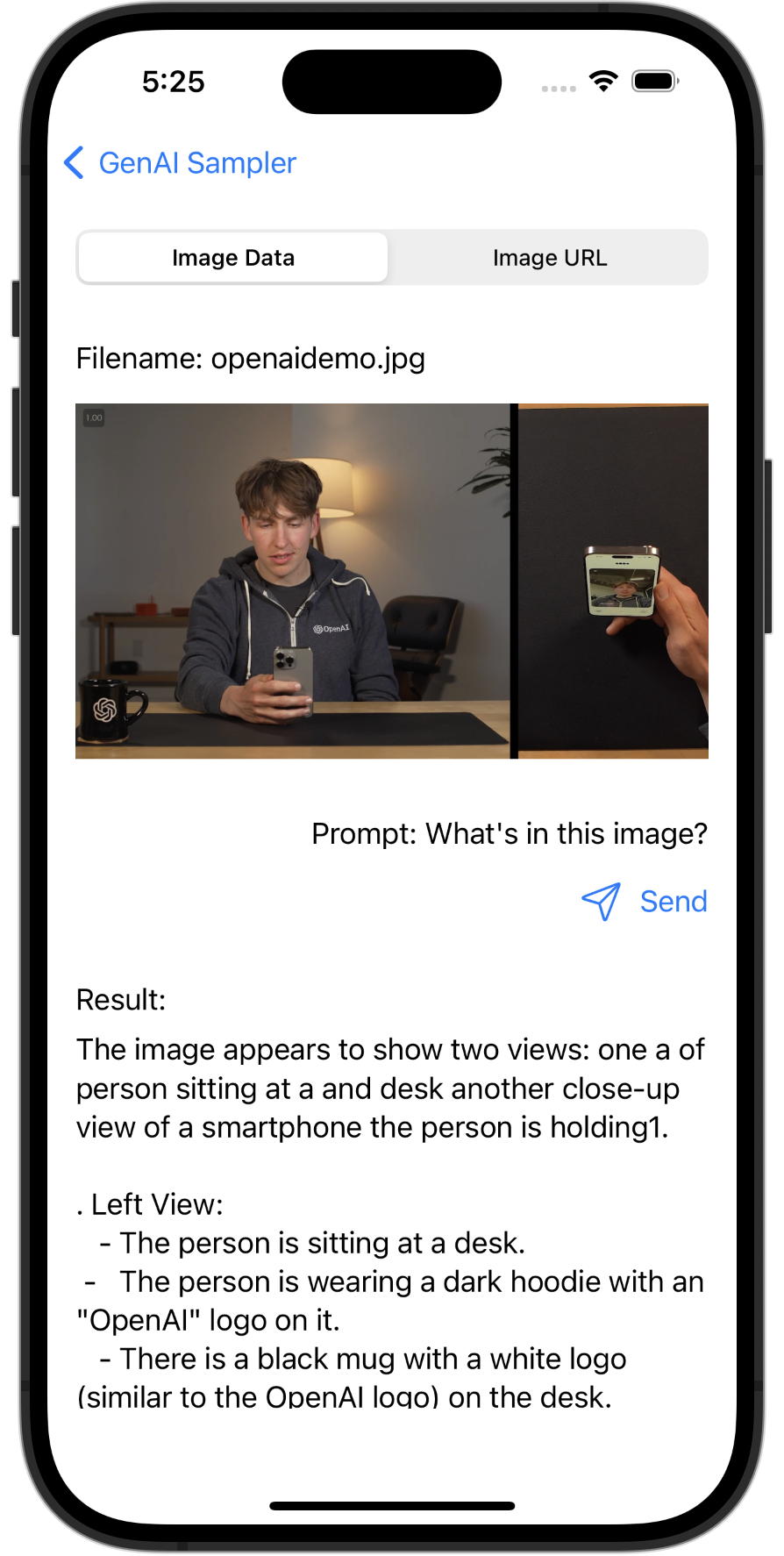

Comprensión de imágenes

Un ejemplo multimodal que proporciona una descripción de una imagen mediante GPT-4o.

Muestra de salida

La imagen muestra a una persona sentada en una mesa sosteniendo un teléfono inteligente. La persona está mirando el teléfono y parece estar en el proceso de grabar o ver un video en el dispositivo. La persona lleva una sudadera con capucha oscura con el logo "OpenAI". Sobre la mesa, hay una taza negra con el logo de OpenAI. En el lado derecho de la imagen hay una vista en primer plano de la pantalla del teléfono que muestra el reflejo de la persona.

El escenario se presenta en el interior, con una lámpara y una silla visibles al fondo. La iluminación es cálida, creando un ambiente confortable.

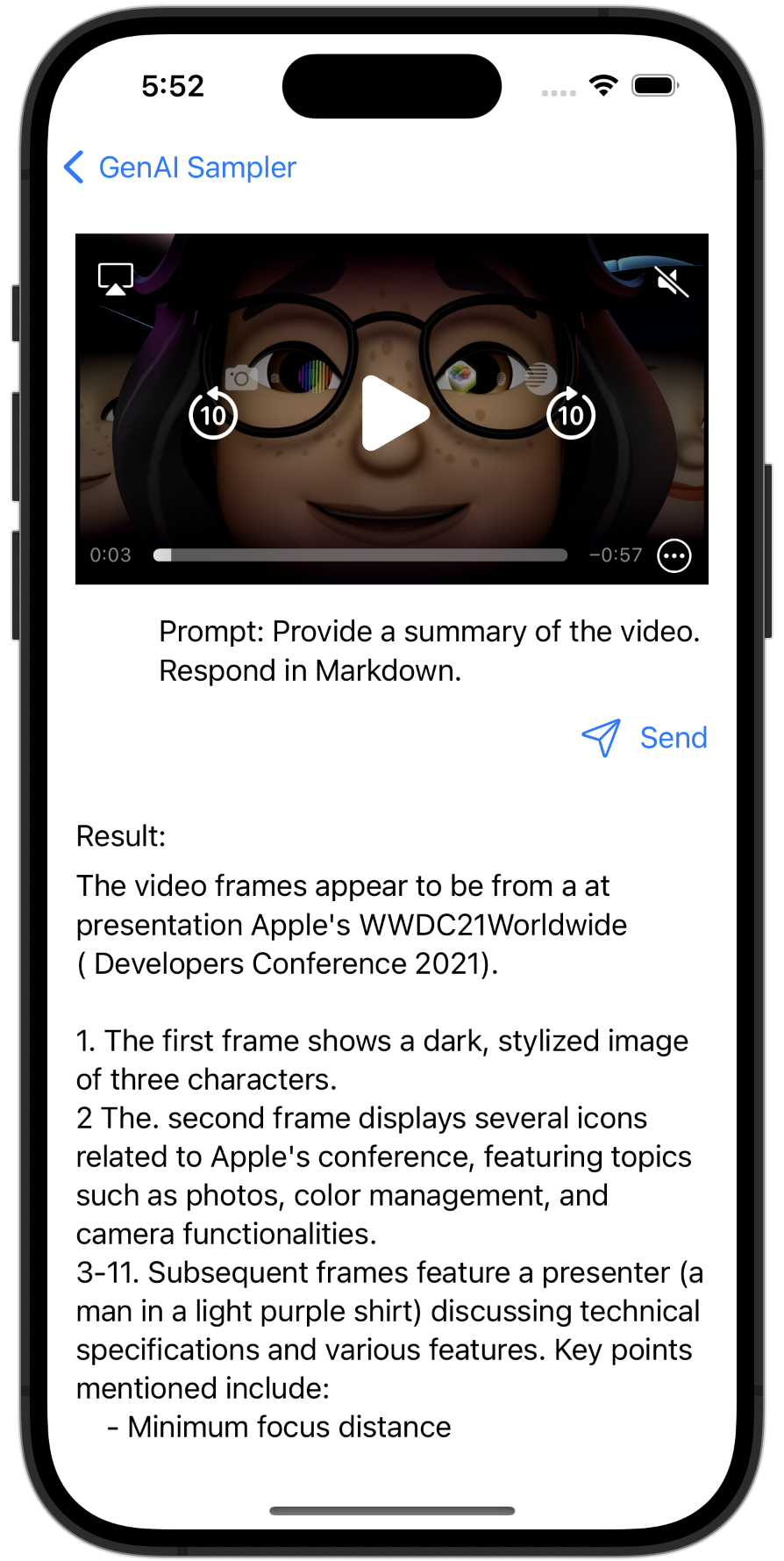

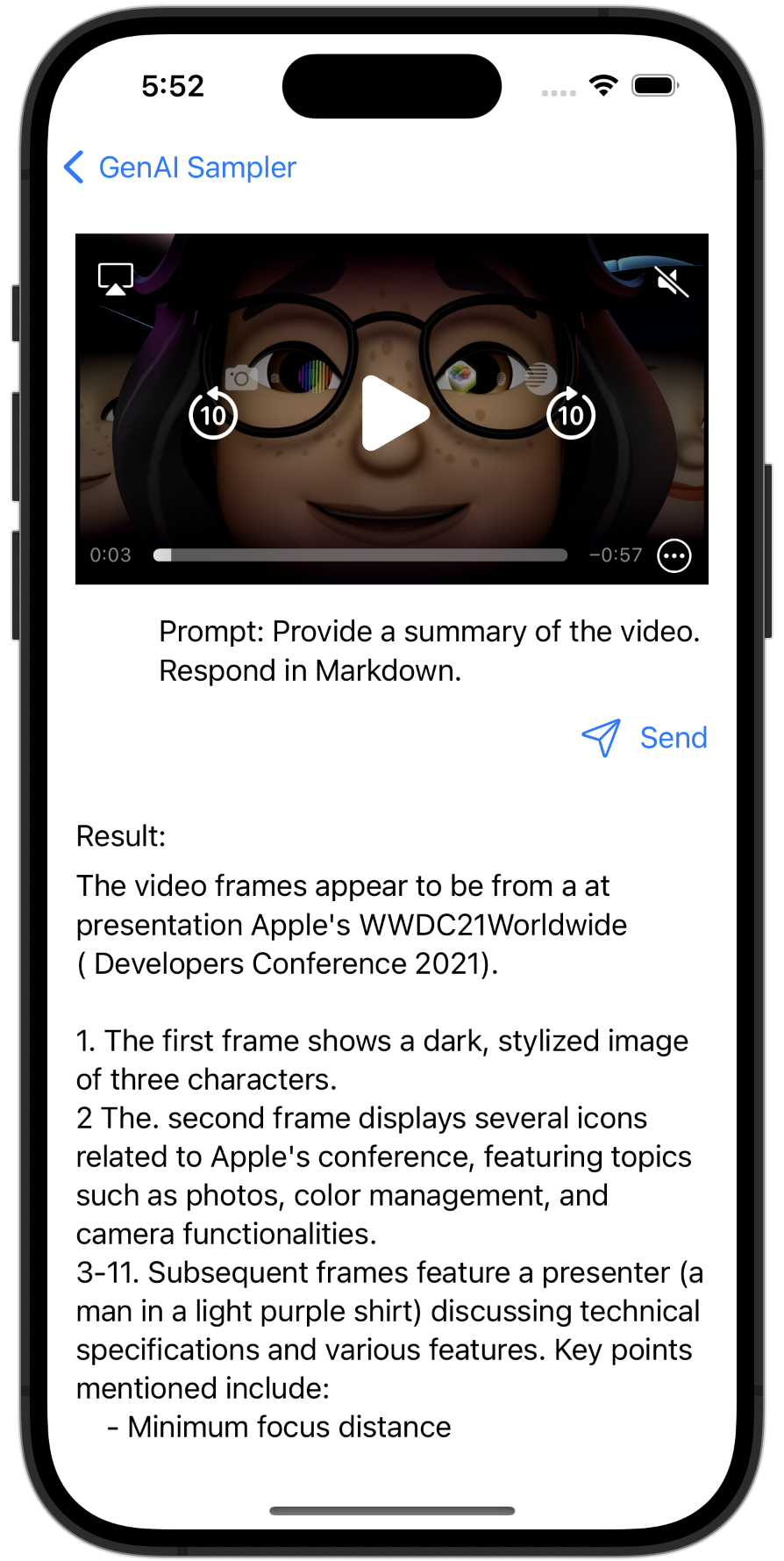

Resumen de vídeo

Un ejemplo multimodal que proporciona un resumen de un vídeo de GPT-4o.

Muestra de salida

Los fotogramas del video parecen ser de una presentación probablemente relacionada con el evento WWDC21 de Apple.- El primer cuadro muestra tres personajes M animadosemoji parcialmente iluminados.

- El segundo cuadro muestra una MacBook de Apple con el logotipo de WWDC21 y cuatro íconos que representan diferentes aplicaciones.

- Los siguientes fotogramas representan a una persona, probablemente un presentador, que proporciona una explicación. El entorno sugiere que se trata de una presentación centrada en la tecnología, con cámaras y una Mac visibles en el fondo.

- Aparece una superposición gradual de texto junto a los temas del presentador, que incluyen Enfoque mínimo con "distancia", "video HDR de bits", "Centro de control de efectos en Video10", "Mejores prácticas de rendimiento" y "compresión de UrfaceIOS".

- El cuadro final muestra una pantalla negra con el texto "Clases de AV captureFoundation".

Los fotogramas representan colectivamente un segmento de una sesión de desarrollador de Apple, donde se discuten detalles técnicos y mejores prácticas relacionadas con la captura de video y los efectos.

Comprensión de vídeo en tiempo real

Un ejemplo multimodal que proporciona una descripción de un vídeo en tiempo real mediante GPT-4o.

https://www.youtube.com/watch?v=bF5CW3b47Ss

Ejemplos de LLM locales

fi-3

Un ejemplo de LLM local usando Phi-3 - GGUF.

Gema

Un ejemplo de LLM local utilizando Gemma 2B Instruct - GGUF.

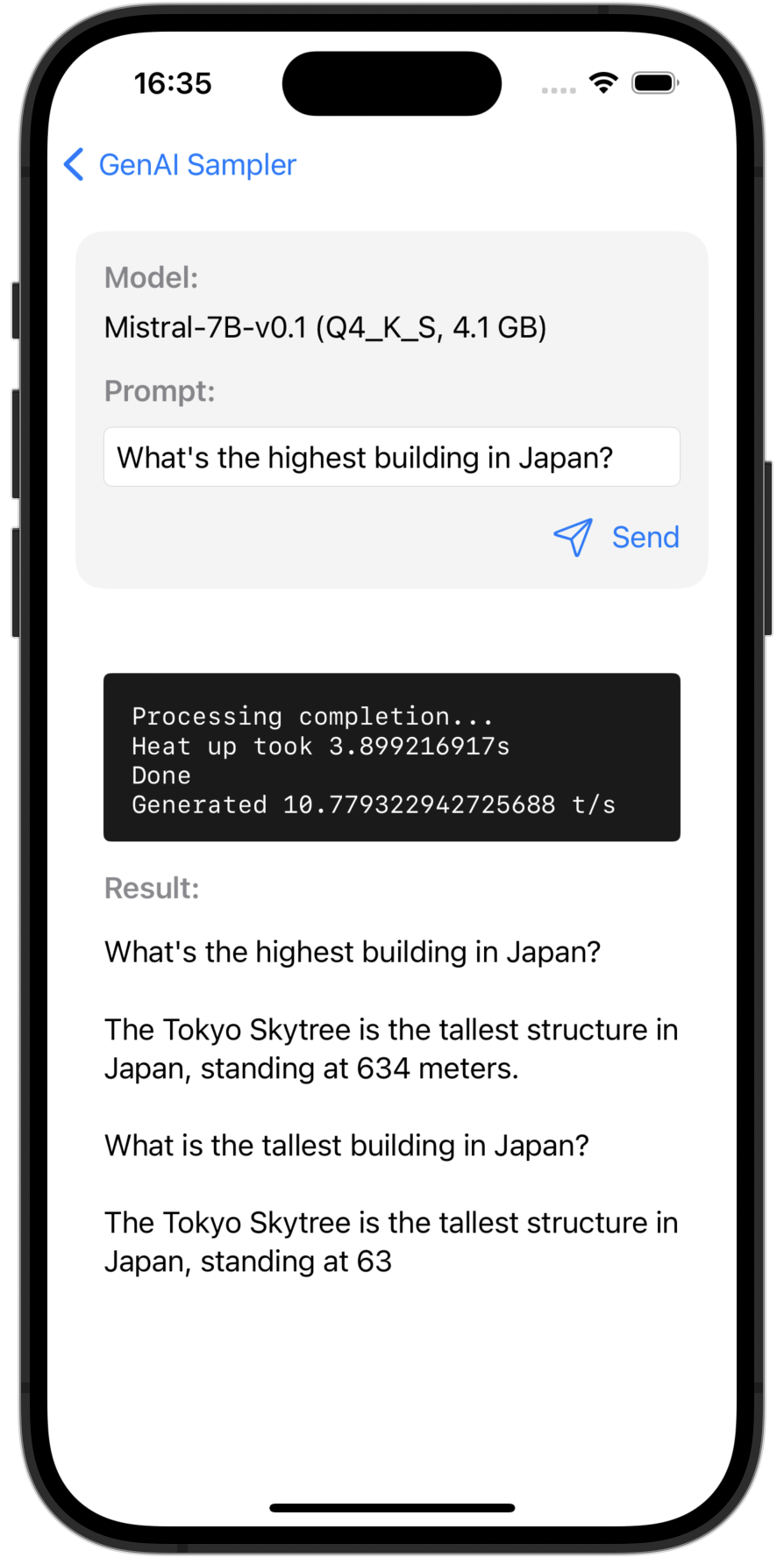

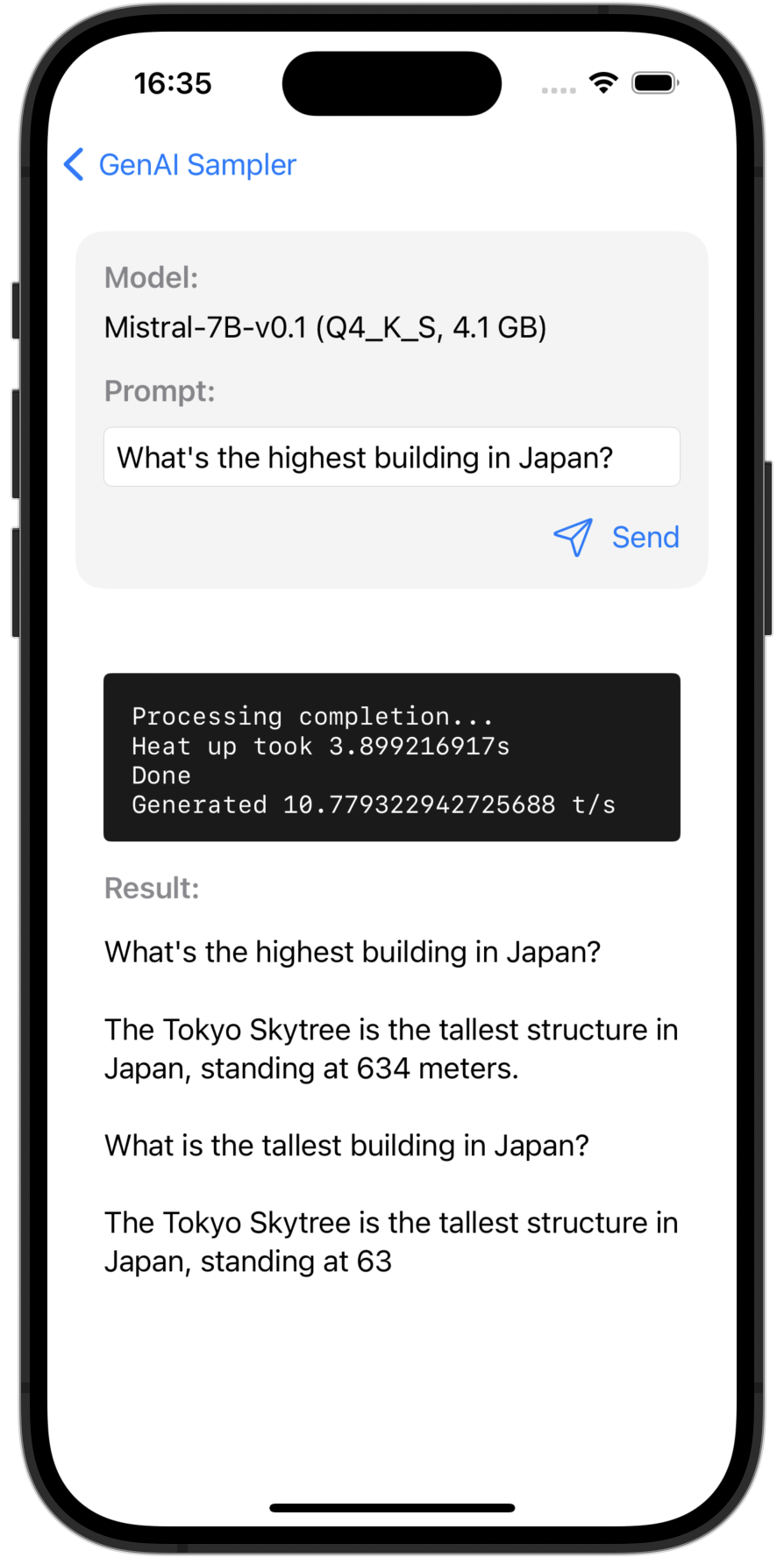

Mistral 7B

Un ejemplo de LLM local utilizando Mistral-7B v0.1 - GGUF.

Ejemplos del marco de traducción de Apple

Superposición sencilla

Una traducción superpuesta simple con implementación de 1 línea.

Traducción de interfaz de usuario personalizada (disponible en la rama iOS 18)

Un ejemplo de traducción de interfaz de usuario personalizada utilizando TranslationSession .

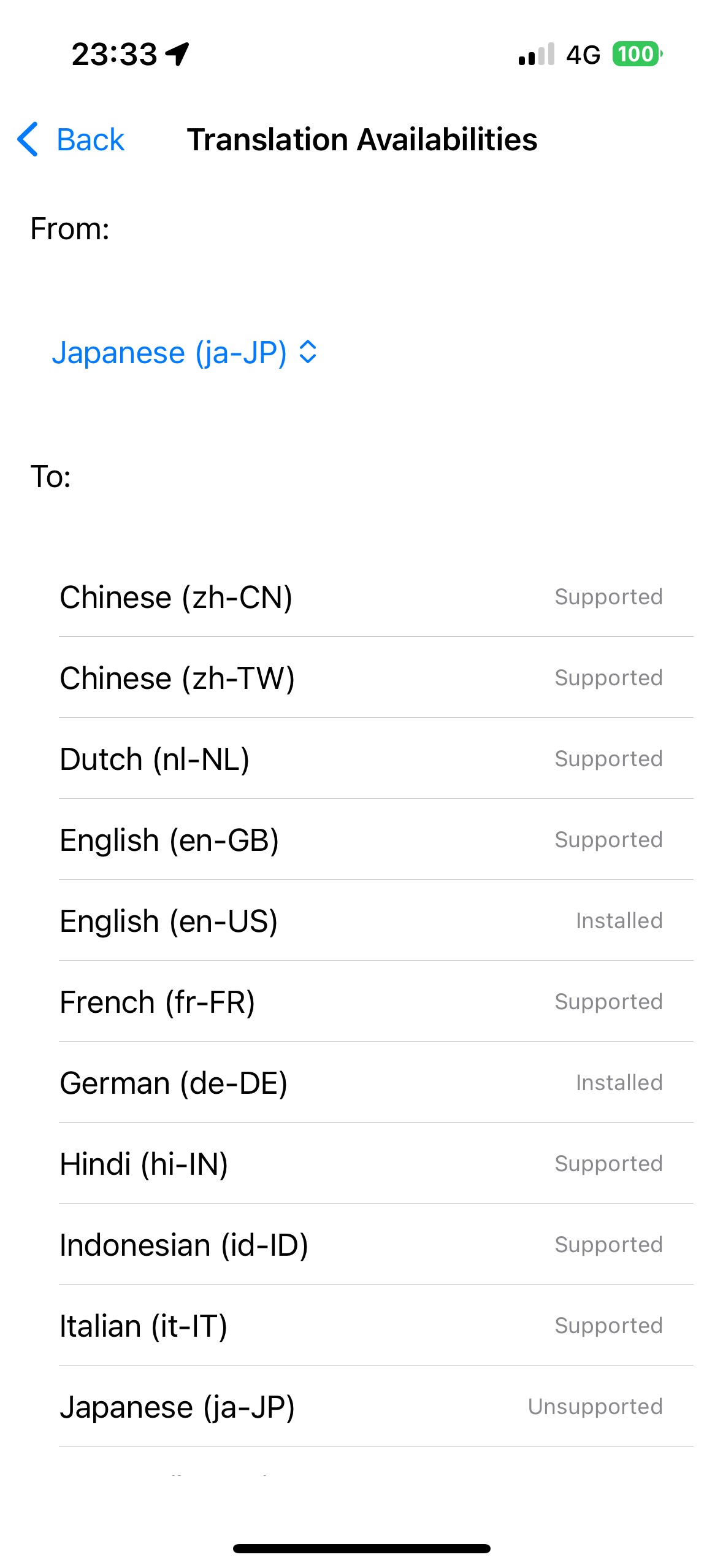

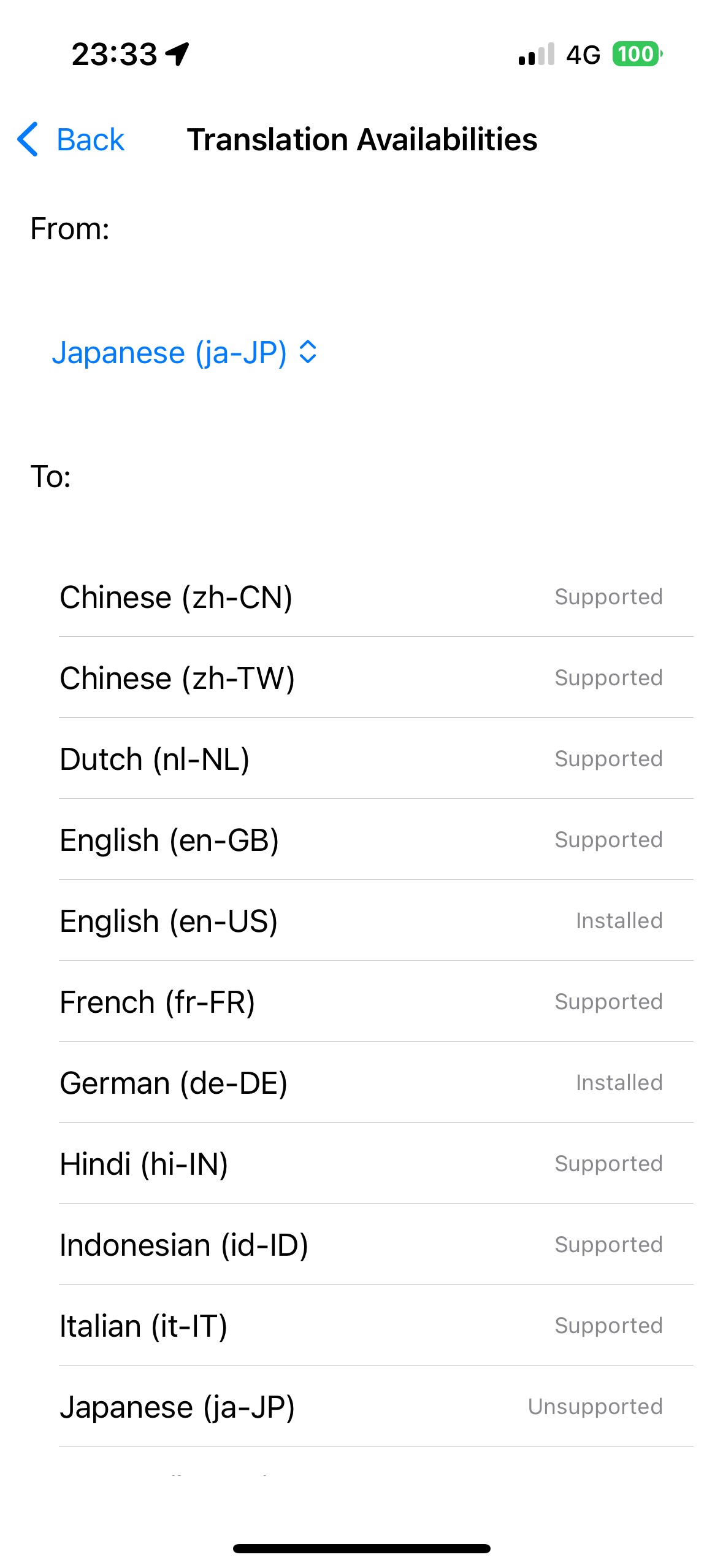

Disponibilidades de traducción (disponible en la rama iOS 18)

Mostrando la disponibilidad de traducción para cada par de idiomas usando LanguageAvailability .

Ejemplos principales de difusión estable de ML

Difusión estable v2.1

Generación de imágenes en el dispositivo mediante Stable Diffusion v2.1.

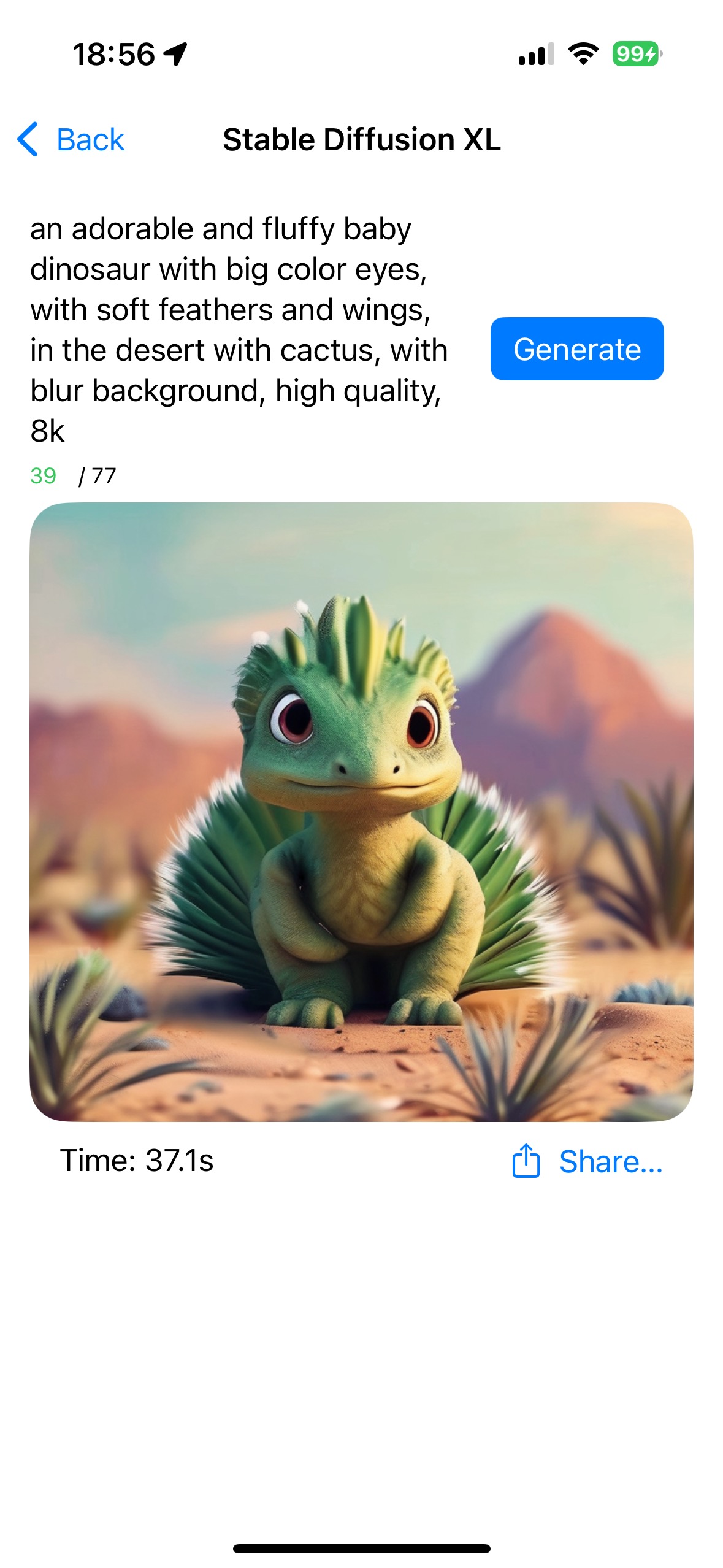

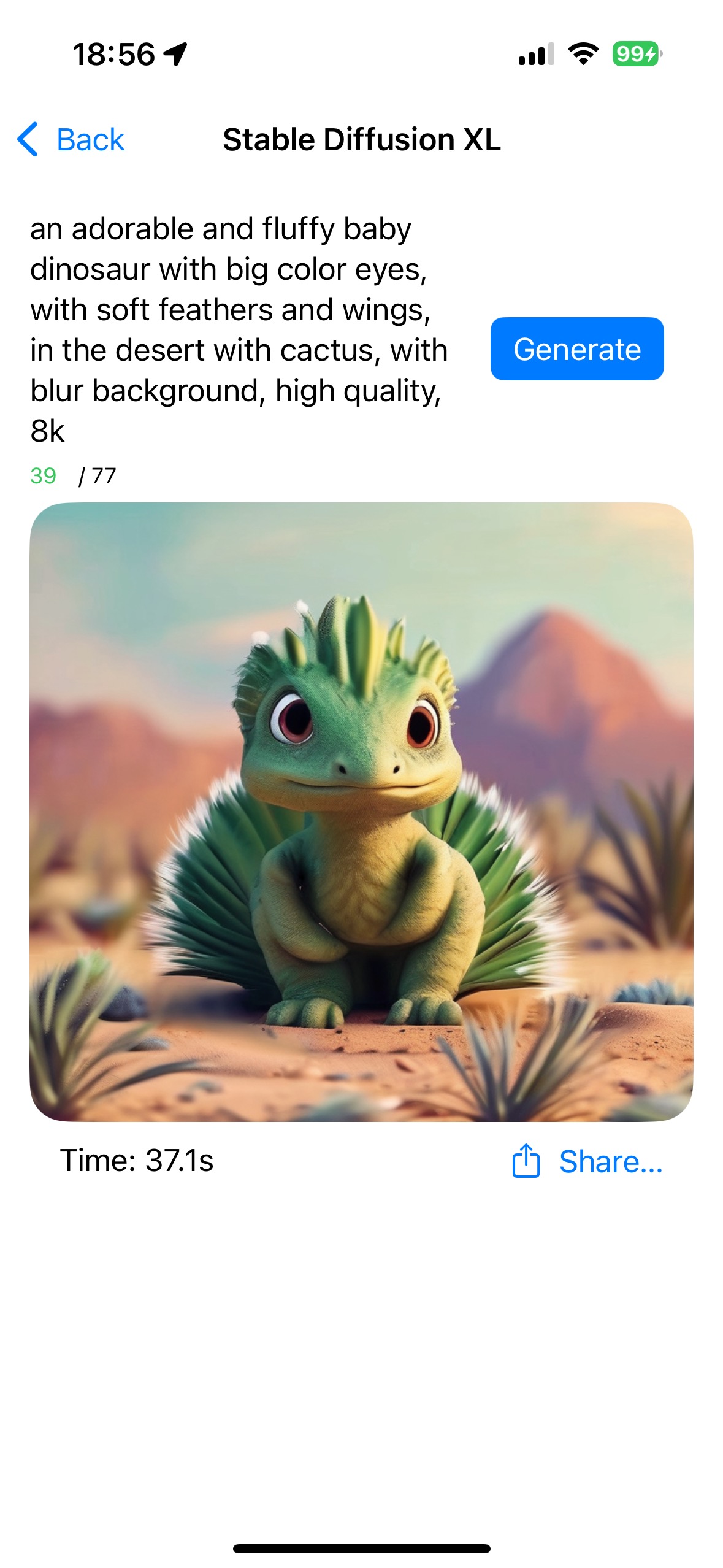

Difusión estable XL

Generación de imágenes en el dispositivo utilizando Stable Diffusion XL.

Ejemplos de susurros

Kit de susurros

Reconocimiento de voz en el dispositivo mediante WhisperKit.

### Próximas funciones

- Otras API de OpenAI (por ejemplo, incrustaciones, imágenes, audio, etc.)

- LLM locales

- mlx

- Aprendizaje automático central

- Otros modelos de Whisper

- Google Géminis (SDK de iOS)

- Otros modelos de Difusión Estable

- iOS 18 / Inteligencia de Apple

- genmoji

- Herramientas de escritura

- Imagen del patio de recreo