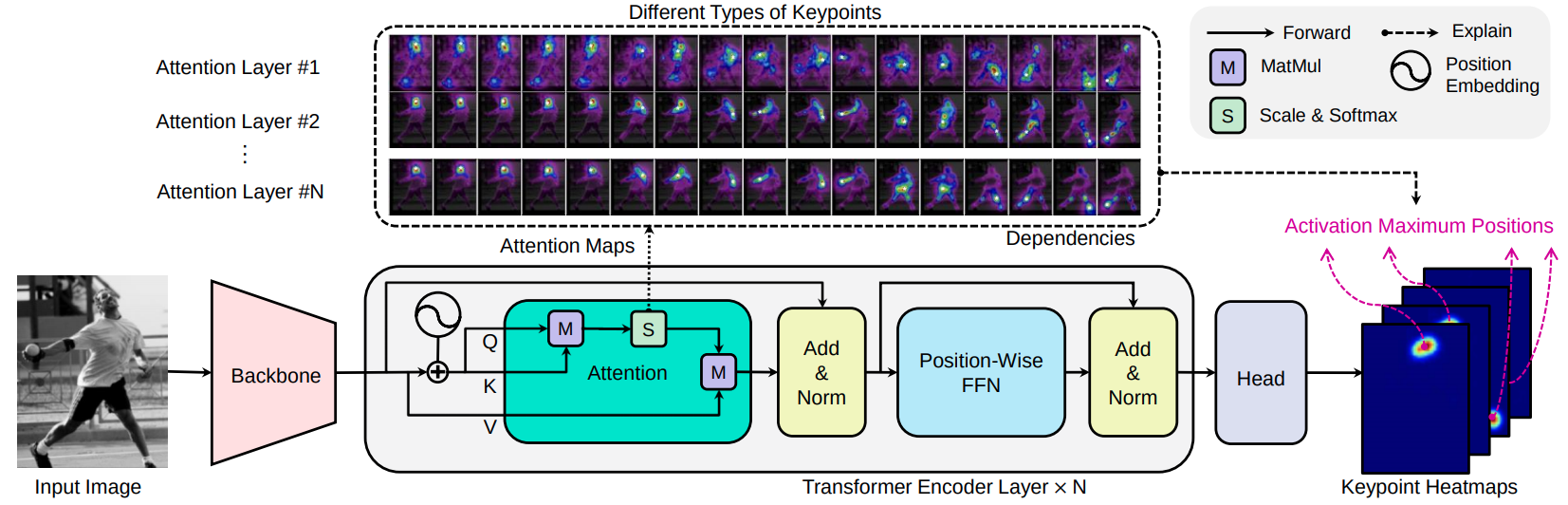

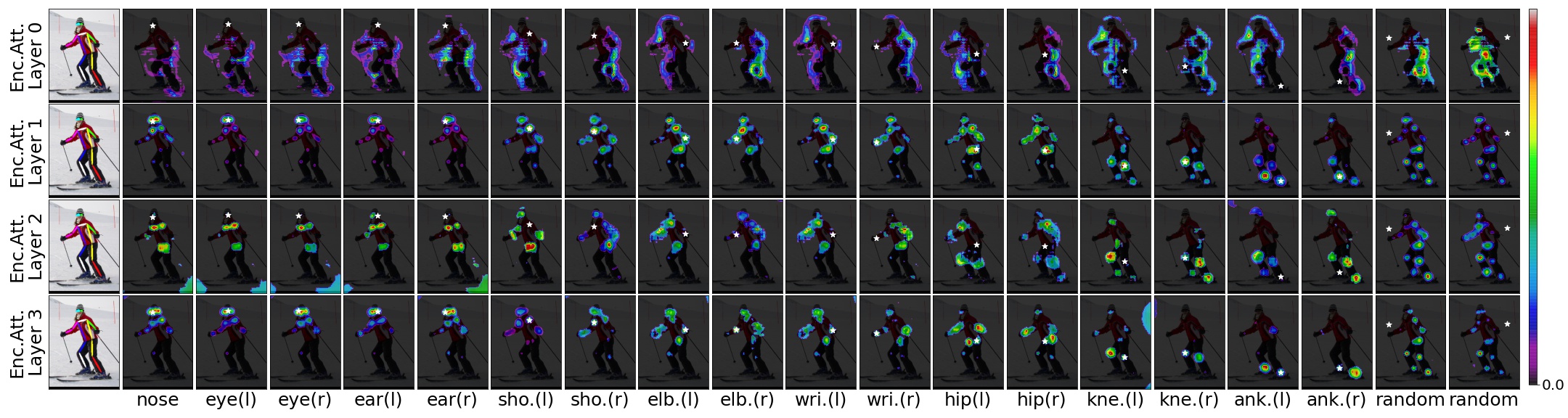

Transpose es un modelo de estimación de pose humana basado en un extractor de características CNN, un codificador de transformador y un cabezal de predicción. Dada una imagen, las capas de atención incorporadas en el transformador pueden capturar eficientemente las relaciones espaciales de largo alcance entre los puntos clave y explicar en qué dependencias se basan mucho las ubicaciones de puntos clave predichos.

[ARXIV 2012.14214] [Paper] [Notebook de demostración]

Transposición: Localización de punto clave a través de Transformer, Sen Yang, Zhibin Quan, Mu Nie, Wankou Yang, ICCV 2021

Elegimos dos tipos de CNN como candidatos a la columna vertebral: Resnet y HRNet. Los bloques convolucionales derivados son resnet-pequeños, hrnet-small-w32 y hrnet-small-w48.

| Modelo | Columna vertebral | #Capas de atención | d | H | #Heads | #Params | AP (Coco Val GT BBox) | Descargar |

|---|---|---|---|---|---|---|---|---|

| Transposición-R-A3 | Resnet-s | 3 | 256 | 1024 | 8 | 5.2Mb | 73.8 | modelo |

| Transposición-R-A4 | Resnet-s | 4 | 256 | 1024 | 8 | 6.0 MB | 75.1 | modelo |

| Transposición-HS | HRNET-S32 | 4 | 64 | 128 | 1 | 8.0 MB | 76.1 | modelo |

| Transposición-H-A4 | HRNET-S48 | 4 | 96 | 192 | 1 | 17.3MB | 77.5 | modelo |

| Transposición-H-A6 | HRNET-S48 | 6 | 96 | 192 | 1 | 17.5MB | 78.1 | modelo |

Prueba la demostración web:

Puede cargar directamente los modelos Transpose-R-A4 o Transpose-H-A4 con pesos previos a la pretrada en Coco Train2017 DataSet desde la antorcha, simplemente por:

import torch

tpr = torch . hub . load ( 'yangsenius/TransPose:main' , 'tpr_a4_256x192' , pretrained = True )

tph = torch . hub . load ( 'yangsenius/TransPose:main' , 'tph_a4_256x192' , pretrained = True )| Modelo | Tamaño de entrada | FPS* | Gflops | AP | AP .5 | AP .75 | AP (M) | AP (L) | Arkansas | Ar .5 | AR .75 | BRAZO) | Ar (l) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transposición-R-A3 | 256x192 | 141 | 8.0 | 0.717 | 0.889 | 0.788 | 0.680 | 0.786 | 0.771 | 0.930 | 0.836 | 0.727 | 0.835 |

| Transposición-R-A4 | 256x192 | 138 | 8.9 | 0.726 | 0.891 | 0.799 | 0.688 | 0.798 | 0.780 | 0.931 | 0.845 | 0.735 | 0.844 |

| Transposición-HS | 256x192 | 45 | 10.2 | 0.742 | 0.896 | 0.808 | 0.706 | 0.810 | 0.795 | 0.935 | 0.855 | 0.752 | 0.856 |

| Transposición-H-A4 | 256x192 | 41 | 17.5 | 0.753 | 0.900 | 0.818 | 0.717 | 0.821 | 0.803 | 0.939 | 0.861 | 0.761 | 0.865 |

| Transposición-H-A6 | 256x192 | 38 | 21.8 | 0.758 | 0.901 | 0.821 | 0.719 | 0.828 | 0.808 | 0.939 | 0.864 | 0.764 | 0.872 |

Nota:

| Modelo | Tamaño de entrada | #Params | Gflops | AP | AP .5 | AP .75 | AP (M) | AP (L) | Arkansas | Ar .5 | AR .75 | BRAZO) | Ar (l) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Transposición-HS | 256x192 | 8.0m | 10.2 | 0.734 | 0.916 | 0.811 | 0.701 | 0.793 | 0.786 | 0.950 | 0.856 | 0.745 | 0.843 |

| Transposición-H-A4 | 256x192 | 17.3m | 17.5 | 0.747 | 0.919 | 0.822 | 0.714 | 0.807 | 0.799 | 0.953 | 0.866 | 0.758 | 0.854 |

| Transposición-H-A6 | 256x192 | 17.5m | 21.8 | 0.750 | 0.922 | 0.823 | 0.713 | 0.811 | 0.801 | 0.954 | 0.867 | 0.759 | 0.859 |

Demo del cuaderno de Jupyter

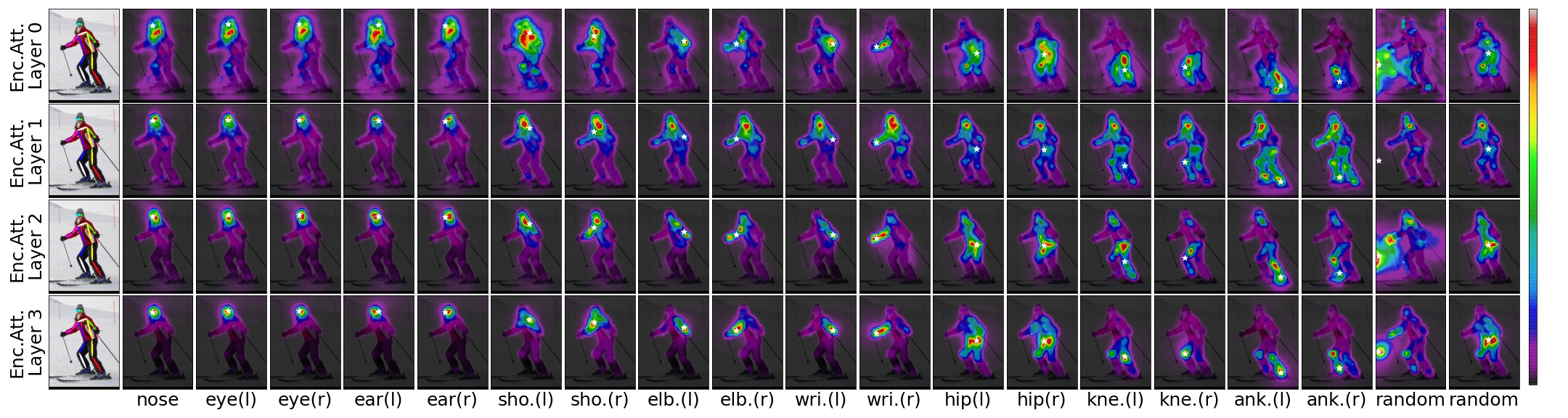

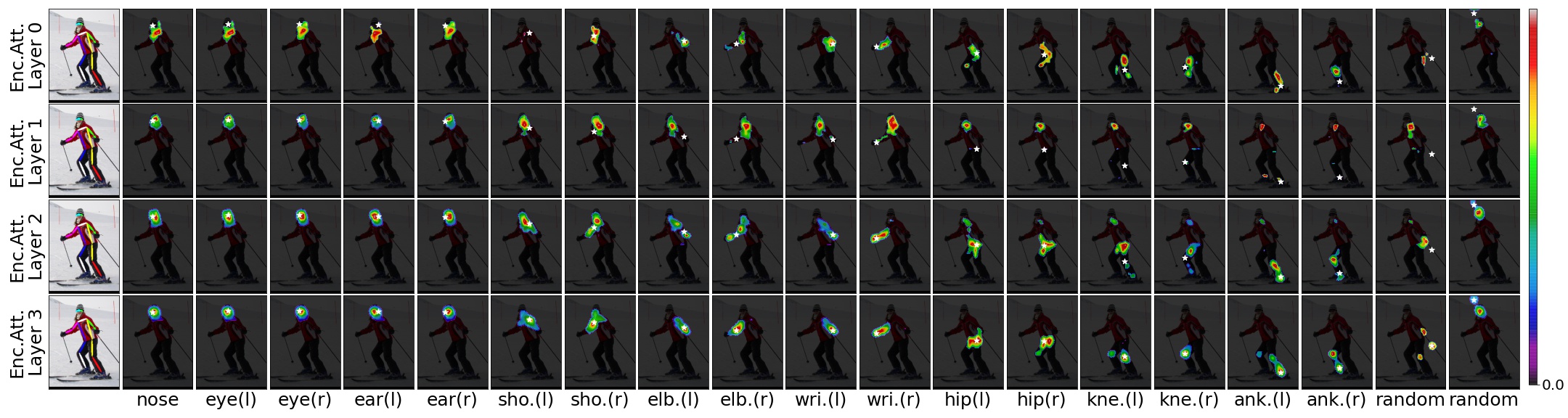

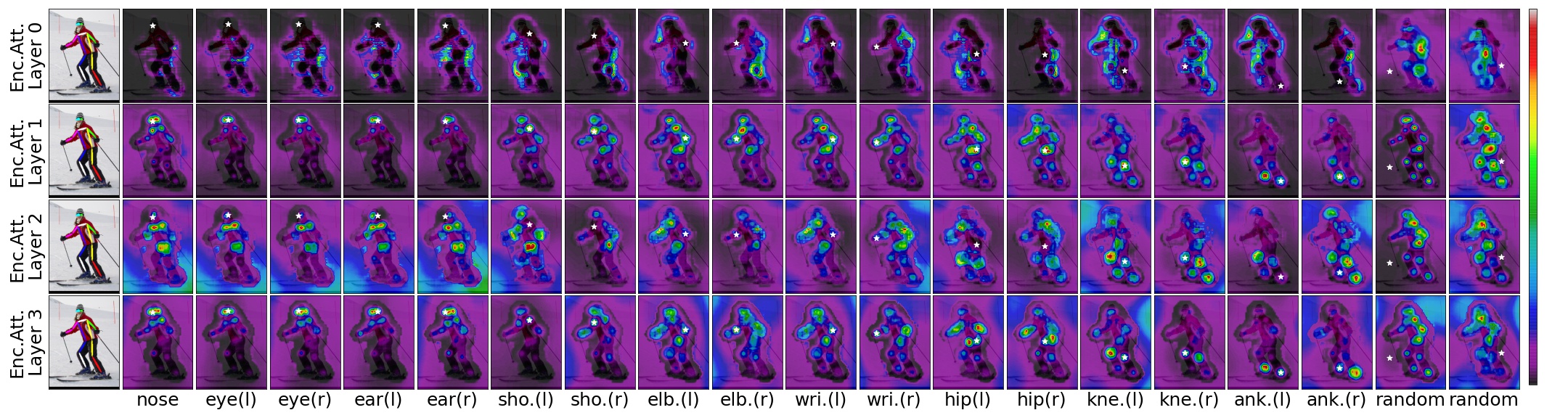

Dada una imagen de entrada, un modelo de transposición previa a la aparición y las ubicaciones predichas, podemos visualizar las dependencias espaciales de las ubicaciones predichas con el umbral para los puntajes de atención.

TransPose-R-A4 con threshold=0.00

TransPose-R-A4 con threshold=0.01

TransPose-H-A4 con threshold=0.00

TransPose-H-A4 con threshold=0.00075

Clone este repositorio, y llamaremos al directorio que clonó como $ {Pose_root}

git clone https://github.com/yangsenius/TransPose.gitInstale Pytorch> = 1.6 y TorchVision> = 0.7 desde el sitio web oficial de Pytorch

Instalar dependencias de paquetes. Asegúrese de que el entorno Python> = 3.7

pip install -r requirements.txtRealizar los directorios de salida (modelos y archivos de capacitación) y registro (tensorboard) en $ {Pose_root} y hacer libs

mkdir output log

cd ${POSE_ROOT} /lib

makeDescargue modelos previos a los envíos de los lanzamientos de este repositorio al directorio especificado

$ {POSE_ROOT}

`-- models

`-- pytorch

|-- imagenet

| |-- hrnet_w32-36af842e.pth

| |-- hrnet_w48-8ef0771d.pth

| |-- resnet50-19c8e357.pth

|-- transpose_coco

| |-- tp_r_256x192_enc3_d256_h1024_mh8.pth

| |-- tp_r_256x192_enc4_d256_h1024_mh8.pth

| |-- tp_h_32_256x192_enc4_d64_h128_mh1.pth

| |-- tp_h_48_256x192_enc4_d96_h192_mh1.pth

| |-- tp_h_48_256x192_enc6_d96_h192_mh1.pth Seguimos los pasos de HRNET para preparar el conjunto de datos Coco Train/Val/Test y las anotaciones. Los resultados de la persona detectada se descargan de OneDrive o Googledrive. Descargue o enlacelos a $ {Pose_root}/Data/Coco/, y haga que se vean así:

$ {POSE_ROOT}/data/coco/

| -- annotations

| |-- person_keypoints_train2017.json

| `-- person_keypoints_val2017.json

| -- person_detection_results

| |-- COCO_val2017_detections_AP_H_56_person.json

| `-- COCO_test-dev2017_detections_AP_H_609_person.json

`-- images

|-- train2017

| |-- 000000000009.jpg

| |-- ...

`-- val2017

|-- 000000000139.jpg

|-- ... python tools/test.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yaml TEST.USE_GT_BBOX Truepython tools/train.py --cfg experiments/coco/transpose_r/TP_R_256x192_d256_h1024_enc4_mh8.yamlGran agradecimiento por estos documentos y sus códigos de código abierto: HRNet, DETR, Darkpose

Este repositorio se publica bajo la licencia MIT.

Si encuentra útil este repositorio, dale una estrella. O considere citar nuestro trabajo:

@inproceedings{yang2021transpose,

title={TransPose: Keypoint Localization via Transformer},

author={Yang, Sen and Quan, Zhibin and Nie, Mu and Yang, Wankou},

booktitle={IEEE/CVF International Conference on Computer Vision (ICCV)},

year={2021}

}