Google anunció recientemente que a partir de la próxima semana, la aplicación Google Photos agregará logotipos de edición de IA a las fotos editadas con funciones de IA como Magic Editor, Magic Eraser y Zoom Enhance. La actualización tenía como objetivo aumentar la transparencia, pero generó controversia. Debido a que el logotipo solo se muestra en los detalles de la foto, no en la foto en sí, es difícil para los usuarios identificar intuitivamente los rastros de edición de IA en el uso diario. El editor de Downcodes interpretará esto en detalle, analizará sus pros y sus contras y discutirá su impacto en el desarrollo futuro de la tecnología de imágenes de IA.

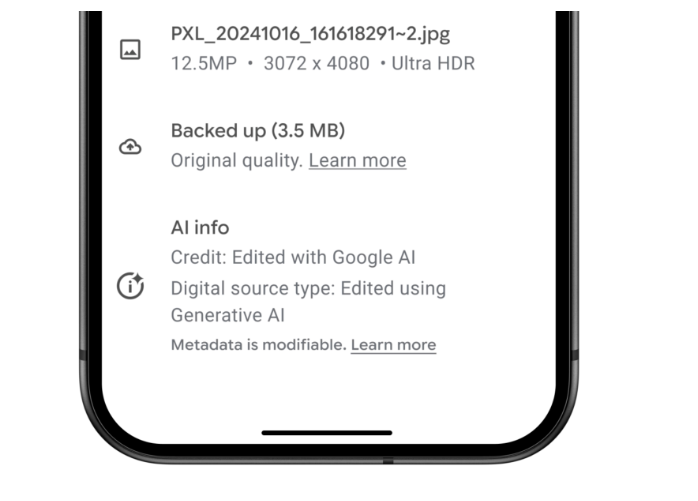

En un momento en el que la tecnología de imágenes de inteligencia artificial se está volviendo cada vez más popular, Google anunció que introducirá una nueva función de edición de logotipos mediante IA en la aplicación Google Fotos a partir de la próxima semana. Todas las fotos editadas con funciones de IA como Magic Editor, Magic Eraser y Zoom Enhance tendrán anotaciones editadas con Google AI que se muestran en la parte inferior de la sección Detalles de la aplicación.

Esta actualización llega más de dos meses después de que Google lanzara el teléfono Pixel 9 equipado con múltiples funciones de edición de fotografías con IA. Sin embargo, este método de etiquetado ha causado cierta controversia. Aunque Google afirma que esta medida es para mejorar aún más la transparencia, el efecto real es cuestionable: la foto en sí no agrega ninguna marca de agua visual, lo que significa que los usuarios no pueden identificarla intuitivamente cuando exploran fotos en las redes sociales, mensajería instantánea o diariamente. Estas fotos han sido procesadas por IA.

Para funciones de edición de fotografías como Best Take y Add Me que no utilizan IA generativa, Google Photos también anotará la información de edición en los metadatos, pero no se mostrará en la pestaña de detalles. Estas funciones se utilizan principalmente para combinar varias fotografías en una imagen completa.

Michael Marconi, gerente de comunicaciones de Google Photos, dijo a TechCrunch: El trabajo aún no está terminado. Continuaremos recopilando comentarios, fortaleciendo y mejorando las salvaguardas de seguridad y evaluando otras soluciones para aumentar la transparencia de la edición generativa de IA. Si bien la compañía no ha dejado claro si agregará una marca de agua visual en el futuro, no ha descartado por completo la posibilidad.

Vale la pena señalar que todas las fotos actualmente editadas por Google AI ya contienen información de edición de AI en los metadatos. La nueva función simplemente mueve esta información a la pestaña Detalles, que es más fácil de encontrar. Sin embargo, el efecto real de este enfoque es preocupante, porque la mayoría de los usuarios no buscan específicamente metadatos o información detallada cuando exploran imágenes en Internet.

Por supuesto, añadir una marca de agua visible dentro de un marco de fotos tampoco es una solución perfecta. Estas marcas de agua se pueden recortar o editar fácilmente y el problema persiste. A medida que las herramientas de imágenes de inteligencia artificial de Google ganan popularidad, es probable que el contenido sintético prolifere en Internet, lo que hace cada vez más difícil para los usuarios distinguir el contenido real del falso.

El método de marca de agua de metadatos adoptado actualmente por Google depende en gran medida de cada plataforma para identificar el contenido generado por IA para los usuarios. Meta ha implementado esta práctica en Facebook e Instagram, y Google planea identificar imágenes de IA en los resultados de búsqueda a finales de este año. Sin embargo, las medidas pertinentes en otras plataformas han avanzado más lentamente.

Esta controversia pone de relieve una cuestión importante en el desarrollo de la tecnología de IA: cómo garantizar la autenticidad del contenido y el derecho de los usuarios a saber al mismo tiempo que se promueve la innovación tecnológica. Aunque Google ha dado el primer paso para mejorar la transparencia, está claro que se necesitan más esfuerzos y mejoras para evitar que el contenido sintético engañe a los usuarios.

Aunque la medida de Google tiene como objetivo aumentar la transparencia, su efecto aún está por verse. Cómo lograr un equilibrio entre el desarrollo de la tecnología de inteligencia artificial y la autenticidad del contenido es un problema difícil al que se enfrentan todas las empresas de tecnología. En el futuro, serán imprescindibles métodos de identificación de contenidos generados por IA más eficaces para proteger mejor los derechos e intereses de los usuarios.