¡El editor de Downcodes lo llevará a comprender los últimos avances de las redes neuronales físicas (PNN)! Esta tecnología emergente utiliza las características de los sistemas físicos para los cálculos y se espera que supere las limitaciones de los modelos de IA existentes. No solo puede entrenar modelos de IA a mayor escala, sino también lograr computación de vanguardia de baja energía y realizar inferencias locales en dispositivos como teléfonos inteligentes, lo que cambiará por completo los escenarios de aplicación de la IA y brindará posibilidades sin precedentes.

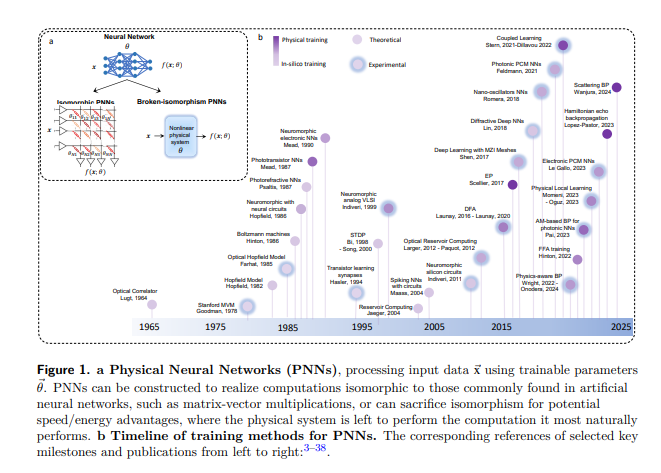

Recientemente, académicos de múltiples instituciones han descubierto una nueva tecnología: las redes neuronales físicas (PNN). Estos no son los algoritmos digitales que estamos familiarizados con los que se ejecutan en las computadoras, sino un nuevo método de computación inteligente basado en sistemas físicos.

Las PNN, como su nombre indica, son redes neuronales que aprovechan las características de los sistemas físicos para realizar cálculos. Si bien actualmente son un área de investigación de nicho, pueden ser una de las oportunidades más infravaloradas de la IA moderna.

El potencial de las PNN: modelos grandes, bajo consumo de energía, informática de punta

Imagínese si pudiéramos entrenar modelos de IA que sean 1.000 veces más grandes que los actuales, pero que también permitieran inferencias locales y privadas en dispositivos de vanguardia, como teléfonos inteligentes o sensores. Parece un escenario de ciencia ficción, pero las investigaciones muestran que no es imposible.

Para lograr un entrenamiento a gran escala de PNN, los investigadores están explorando métodos que incluyen aquellos basados en retropropagación y aquellos sin retropropagación. Cada uno de estos métodos tiene ventajas y desventajas, y actualmente ninguno logra la misma escala y rendimiento que el algoritmo de retropropagación ampliamente utilizado en el aprendizaje profundo. Pero la situación está cambiando rápidamente y el diverso ecosistema de tecnologías de formación proporciona pistas para la utilización de las PNN.

La implementación de PNN involucra múltiples campos, incluida la óptica, la electrónica y la computación inspirada en el cerebro. Pueden estructurarse de manera similar a las redes neuronales digitales para realizar cálculos como la multiplicación de matriz-vector, o pueden sacrificar esta similitud estructural por posibles ventajas de velocidad/energía y dejar que el sistema físico realice sus cálculos más naturales.

El futuro de las PNN: más allá del rendimiento del hardware digital

Es probable que las aplicaciones futuras de las PNN sean muy amplias, desde grandes modelos generativos hasta tareas de clasificación en sensores inteligentes. Será necesario capacitarlos, pero las limitaciones para la capacitación pueden variar según la aplicación. Un método de entrenamiento ideal debería ser independiente del modelo, rápido y eficiente desde el punto de vista energético, y resistente a la variación, la deriva y el ruido del hardware.

Aunque el desarrollo de PNN está lleno de potencial, también enfrenta muchos desafíos. ¿Cómo garantizar la estabilidad de las PNN durante las fases de entrenamiento e inferencia? ¿Cómo integrar estos sistemas físicos con la infraestructura de hardware y software digital existente? Estas son preguntas que deben abordarse.

Dirección del artículo: https://arxiv.org/pdf/2406.03372

La aparición de las redes neuronales físicas (PNN) ha traído nuevas esperanzas y desafíos al campo de la inteligencia artificial. En el futuro, a medida que la tecnología continúe desarrollándose y se resuelvan los problemas, se espera que las PNN desempeñen un papel importante en diversos campos y promuevan la inteligencia artificial a nuevas alturas. El editor de Downcodes seguirá prestando atención a los últimos avances en la investigación de PNN, ¡así que estad atentos!