Mistral AI lanzó sorprendentemente el primer modelo grande multimodal de código abierto, Pixtral12B. Su escala de 12 mil millones de parámetros y su poderosa capacidad para procesar imágenes y texto son comparables a la serie Claude de Anthropic y al GPT-4 de OpenAI. Lo que es aún más sorprendente es que Mistral AI revela directamente los pesos de los modelos e incluso proporciona descargas de enlaces magnéticos, lo que reduce en gran medida el umbral de uso y facilita que los desarrolladores e investigadores comiencen rápidamente. El tamaño de Pixtral12B es de sólo 23,64 GB. Es liviano entre los modelos multimodales, tiene bajo consumo de energía, es fácil de implementar y se puede descargar en unos minutos a través de una red de alta velocidad.

Mistral AI una vez más conmocionó al mundo de la IA y lanzó Pixtral12B, el primer modelo grande multimodal de código abierto. Este modelo, que puede procesar imágenes y texto simultáneamente, no sólo es tecnológicamente avanzado, sino que también atrae la atención generalizada por su apertura. Mistral AI publica directamente los pesos de los modelos en línea e incluso proporciona cuidadosamente enlaces magnéticos.

Lo más destacado de Pixtral12B no son sólo sus potentes funciones, sino también su exquisito diseño. El tamaño total del modelo es de sólo 23,64 GB, lo que lo convierte en un reproductor liviano entre los modelos multimodales. Esta característica reduce en gran medida el consumo de energía y el umbral de implementación, lo que permite que más desarrolladores e investigadores comiencen fácilmente. Se informa que los usuarios con conexiones a Internet de alta velocidad pueden completar la descarga en sólo unos minutos, lo que mejora enormemente la accesibilidad del modelo.

Como la última obra maestra de Mistral AI, Pixtral12B se desarrolló en base a su modelo de texto Nemo12B y tiene 12 mil millones de parámetros. Sus capacidades son comparables a modelos multimodales conocidos, como la serie Claude de Anthropic y el GPT-4 de OpenAI, y pueden comprender y responder una variedad de preguntas complejas relacionadas con imágenes.

En términos de especificaciones técnicas, Pixtral12B es igualmente impresionante: estructura de red de 40 capas, 14,336 dimensiones ocultas, 32 cabezales de atención y un codificador visual dedicado de 400M que admite el procesamiento de imágenes con resolución de 1024x1024.

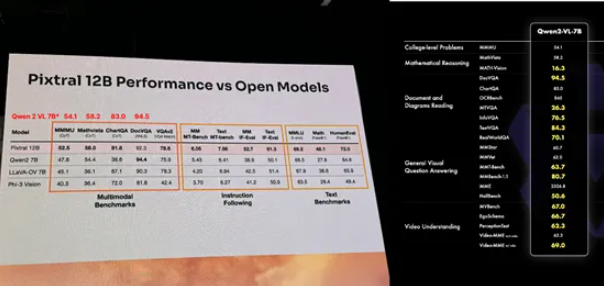

Lo que es más digno de mencionar es que Pixtral12B obtuvo buenos resultados en varias pruebas de referencia autorizadas. En plataformas como MMMU, Mathvista, ChartQA y DocVQA, sus resultados han superado a muchos modelos multimodales conocidos, incluidos Phi-3 y Qwen-27B, lo que demuestra plenamente su gran fortaleza.

Sin duda, la medida de Mistral AI promoverá aún más la ola de modelos multimodales de código abierto. La respuesta de la comunidad a este nuevo modelo ha sido abrumadora, y muchos desarrolladores e investigadores están ansiosos por comenzar a explorar el potencial de Pixtral12B. Esto no sólo refleja la vitalidad de la comunidad de código abierto, sino que también indica que la tecnología de IA multimodal puede marcar el comienzo de una nueva ronda de innovación.

Con el lanzamiento de Pixtral12B, tenemos motivos para esperar el surgimiento de aplicaciones más innovadoras. Ya sea en los campos de la comprensión de imágenes, el análisis de documentos o el razonamiento intermodal, este modelo puede generar avances revolucionarios. Este movimiento de Mistral AI sin duda ha contribuido a la democratización y popularización de la tecnología de IA. Esperemos y veamos cómo remodelará el patrón del campo de la IA en el futuro.

Dirección de Huggingface: https://huggingface.co/mistral-community/pixtral-12b-240910

El lanzamiento de código abierto de Pixtral12B marca una nueva etapa en el desarrollo de la tecnología de IA multimodal. Su diseño liviano y su potente rendimiento promoverán en gran medida la popularización y aplicación de la tecnología de IA. Esperamos ver surgir más aplicaciones innovadoras basadas en Pixtral12B. .