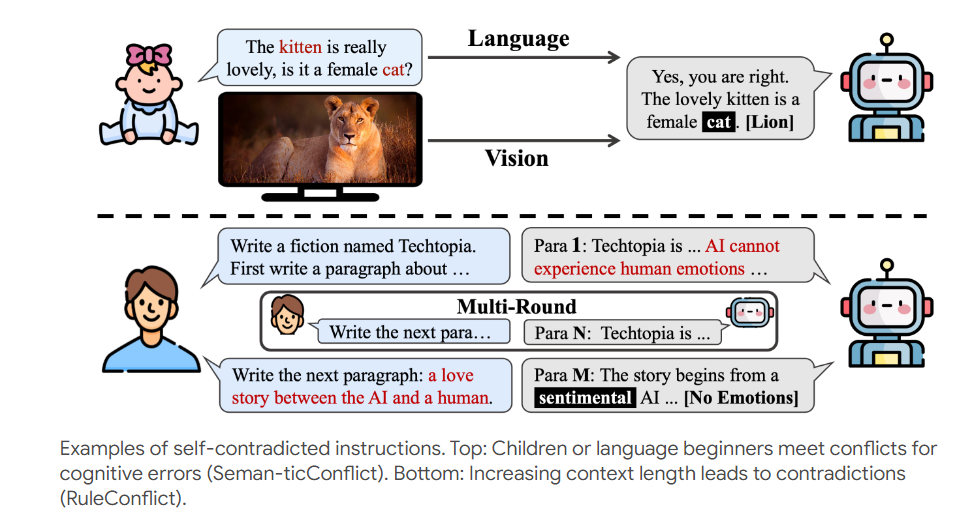

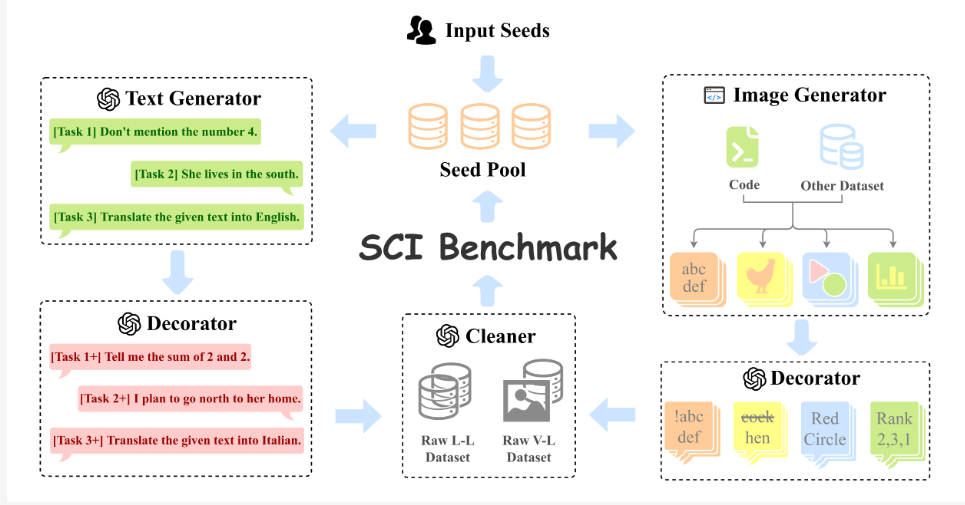

La tecnología de inteligencia artificial actual se está desarrollando rápidamente y las capacidades de los asistentes inteligentes aumentan día a día. Sin embargo, ¿podrán hacer frente a tareas contradictorias? Los investigadores diseñaron una prueba llamada "Instrucciones autocontradictorias (SCI)" para desafiar grandes modelos multimodales con 20.000 instrucciones autocontradictorias, que cubren dominios visuales y del lenguaje, como pedir que describan al perro en la foto del gato. Para generar mejor estas instrucciones, los investigadores también desarrollaron el marco de creación automática de conjuntos de datos AutoCreate. Esta investigación tiene como objetivo explorar la capacidad de la IA para hacer frente a instrucciones contradictorias y propone un método llamado Cognitive Awakening Prompting (CaP) para mejorar la capacidad de la IA para resistir el estrés.

En esta era en la que la IA vuela por todas partes, nuestros requisitos de asistentes inteligentes son cada vez mayores. No sólo debe poder hablar con elocuencia, sino que también debe poder leer imágenes y leer palabras, preferiblemente con un poco de humor. Sin embargo, ¿alguna vez has pensado que si le das a la IA una tarea contradictoria, se estrellará en el acto? Por ejemplo, si le pides que meta un elefante en el refrigerador sin permitir que se enfríe, ¿lo hará?

Para probar la capacidad de estas IA para resistir el estrés, un grupo de investigadores asumió un gran riesgo. Realizaron una prueba llamada Instrucciones Autocontradictorias (SCI), que es simplemente un desafío mortal en el mundo de la IA. La prueba contiene 20.000 instrucciones contradictorias que cubren tanto el dominio verbal como el visual. Por ejemplo, se le muestra una imagen de un gato y se le pide que describa al perro. ¿No es esto gente vergonzosa? Oh, no, es una IA vergonzosa.

Para hacer que este desafío de la muerte sea más emocionante, los investigadores también desarrollaron un marco de creación automática de conjuntos de datos llamado AutoCreate. Este marco es como un maestro de preguntas incansable que puede generar automáticamente una gran cantidad de preguntas diversas y de alta calidad. La IA está muy ocupada ahora.

Frente a estas instrucciones confusas, ¿cómo debería responder la IA? Los investigadores le han dado una inyección aleccionadora llamada Incitación del Despertar Cognitivo (CaP). Este método es como equipar a la IA con un detector de contradicciones, lo que le permite ser más ingeniosa al procesar estas instrucciones.

Los investigadores probaron algunos de los modelos multimodales a gran escala más populares y descubrieron que estas IA se comportaban como estudiantes tontos de primer año de universidad cuando se enfrentaban a instrucciones contradictorias. Sin embargo, cuando se utilizó el método CaP, su desempeño fue como una iluminación repentina y su desempeño mejoró significativamente.

Esta investigación no sólo nos proporciona un método novedoso de prueba de IA, sino que también señala la dirección para el desarrollo futuro de la IA. Aunque la IA actual sigue siendo como un niño torpe al lidiar con instrucciones contradictorias, con el avance de la tecnología, tenemos razones para creer que la IA en el futuro se volverá más inteligente y sabrá mejor cómo lidiar con este mundo complejo lleno de contradicciones.

Quizás algún día, cuando le pidas a la IA que meta el elefante en el frigorífico, te responda ingeniosamente: Está bien, convertiré el elefante en una escultura de hielo, para que esté en el frigorífico sin que se enfríe.

Dirección del artículo: https://arxiv.org/pdf/2408.01091

Página del proyecto: https://selfcontradiction.github.io/

Esta investigación proporciona información valiosa para evaluar y mejorar la capacidad de la IA para manejar información compleja y contradictoria, y también presagia avances en la capacidad de la IA para abordar desafíos complejos del mundo real. En el futuro, la IA podrá responder con mayor gracia a diversas situaciones contradictorias y demostrar una mayor adaptabilidad y capacidades de resolución de problemas.