El Laboratorio de Inteligencia Artificial de Shanghai anunció recientemente que el gran modelo multimodal InternLM-XComposer desarrollado por él se ha actualizado a la versión 2.5 (IXC-2.5). Esta versión ha logrado importantes avances en la comprensión del contexto largo, la comprensión del lenguaje visual y la expansión de aplicaciones, ha mejorado significativamente la comprensión y las capacidades de creación de imágenes de texto y ha superado los modelos de código abierto existentes en múltiples pruebas comparativas. Algunos indicadores son incluso comparables a GPT-4V y Gemini Pro. es comparable. IXC-2.5 muestra un sólido rendimiento y un amplio potencial de aplicación, estableciendo un nuevo punto de referencia para el desarrollo de grandes modelos multimodales.

Recientemente, el modelo grande multimodal InternLM-XComposer se actualizó a la versión 2.5. Este modelo, desarrollado por el Laboratorio de Inteligencia Artificial de Shanghai, ha mejorado la comprensión de texto e imágenes con sus excelentes capacidades de entrada y salida de contexto largo y sus aplicaciones creativas. avances revolucionarios.

IXC-2.5 es capaz de manejar contextos largos de hasta 96K con facilidad, gracias a los datos de imagen y texto entrelazados de 24K utilizados en su entrenamiento. Esta capacidad de contexto prolongado permite que IXC-2.5 funcione bien en tareas que requieren un contexto de entrada y salida extenso.

En comparación con la versión anterior, IXC-2.5 tiene tres mejoras importantes en la comprensión del lenguaje visual:

Comprensión de resolución ultraalta: IXC-2.5 admite imágenes de alta resolución de cualquier relación de aspecto a través del codificador visual nativo de 560×560ViT.

Comprensión de vídeo detallada: trate el vídeo como una imagen compuesta de resolución ultra alta compuesta de decenas a cientos de fotogramas, capturando detalles mediante muestreo denso y mayor resolución.

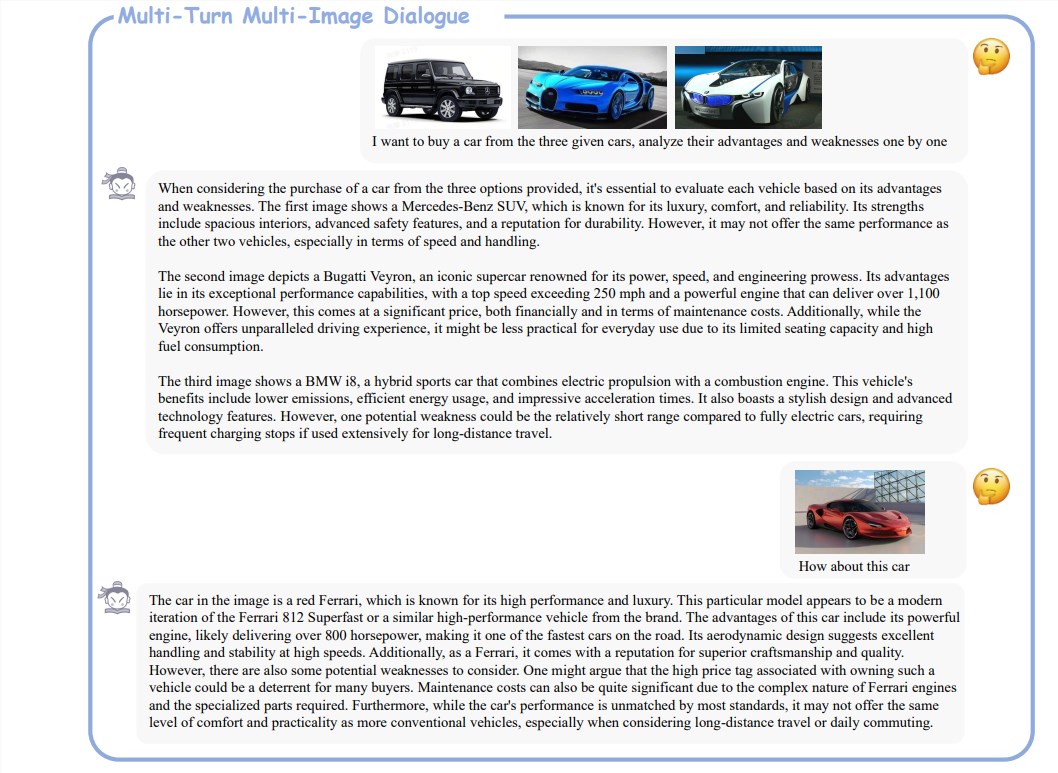

Diálogo de múltiples giros y múltiples imágenes: Admite diálogos de múltiples giros y múltiples imágenes de forma libre para una interacción natural con los humanos.

Además de las mejoras en la comprensión, IXC-2.5 también amplía dos aplicaciones atractivas que utilizan parámetros LoRA adicionales para la creación de imágenes de texto:

Cree páginas web: basándose en instrucciones de imágenes de texto, IXC-2.5 puede escribir códigos fuente HTML, CSS y JavaScript para crear páginas web.

Escriba artículos gráficos de alta calidad: utilice tecnologías de cadena de pensamiento (CoT) y optimización directa de preferencias (DPO) especialmente diseñadas para mejorar significativamente la calidad de su contenido escrito.

IXC-2.5 se evalúa en 28 puntos de referencia y supera a los modelos de última generación de código abierto existentes en 16 puntos de referencia. Además, igualó o superó a GPT-4V y Gemini Pro en 16 tareas clave. Este logro demuestra plenamente el potente rendimiento y el amplio potencial de aplicación de IXC-2.5.

Dirección del artículo: https://arxiv.org/pdf/2407.03320

Dirección del proyecto: https://github.com/InternLM/InternLM-XComposer

Con todo, el lanzamiento de la versión IXC-2.5 marca un progreso significativo en la tecnología de modelos grandes multimodales, y su potente rendimiento y ricos escenarios de aplicación indican un futuro brillante para el desarrollo de la tecnología de inteligencia artificial en el futuro. ¡Esperamos recibir actualizaciones de funciones cada vez más potentes en el futuro!