La última serie de modelos Tülu3 lanzada por el Instituto Allen de Inteligencia Artificial (AI2) ha aportado avances impresionantes en el campo de los modelos de lenguaje de código abierto. Tülu3 no solo es comparable en rendimiento a modelos de código cerrado como GPT-4o-mini, sino que, lo que es más importante, es completamente de código abierto y proporciona datos de capacitación completos, código, recetas de capacitación y marcos de evaluación, lo cual es fundamental para promover la apertura. Modelos fuente. El desarrollo de la tecnología de formación es un hito importante. Resuelve muchos problemas existentes en la aplicación práctica de modelos tradicionales de preentrenamiento, como la generación de información dañina y la dificultad para seguir instrucciones, etc., y aporta nuevas posibilidades de investigación y aplicación en el campo de la inteligencia artificial.

En el campo de la inteligencia artificial, la tecnología posterior al entrenamiento se está convirtiendo gradualmente en un medio importante para mejorar el rendimiento del modelo. Recientemente, el Instituto Allen de Inteligencia Artificial (AI2) lanzó la serie de modelos Tülu3, que es un modelo de lenguaje avanzado de código completamente abierto con un rendimiento comparable al de los modelos de código cerrado como GPT-4o-mini. Tülu3 no solo contiene datos de modelo, código y recetas de capacitación, sino que también proporciona un marco de evaluación, con el objetivo de promover el desarrollo de tecnología posterior a la capacitación de modelos de código abierto.

Tradicionalmente, los modelos previamente entrenados por sí solos suelen ser ineficaces para satisfacer las necesidades de aplicaciones prácticas, pueden producir información tóxica o peligrosa y son difíciles de seguir instrucciones humanas. Por lo tanto, las etapas posteriores a la capacitación, como el ajuste de la instrucción y el aprendizaje por retroalimentación humana, son particularmente importantes. Sin embargo, cómo optimizar el proceso posterior al entrenamiento sigue siendo un problema técnico, especialmente cuando mejorar una habilidad del modelo puede afectar otras habilidades.

Para superar este problema, las principales empresas han aumentado la complejidad de los métodos posteriores a la capacitación, probando múltiples rondas de capacitación y combinando datos artificiales y sintéticos, pero la mayoría de los métodos aún son de código cerrado. Por el contrario, el lanzamiento de la serie Tülu3 superó la brecha de rendimiento entre los modelos de código abierto y los modelos de código cerrado y trajo nuevas ideas de capacitación.

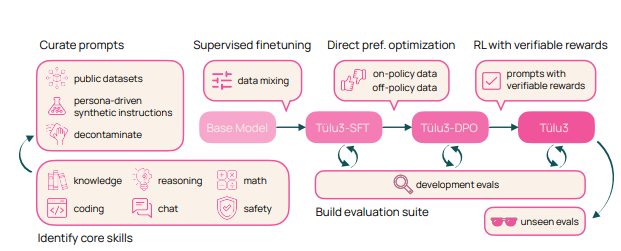

El proceso de formación de Tülu3 se divide en cuatro etapas: construcción de datos, ajuste supervisado, ajuste de preferencias y aprendizaje reforzado con recompensas verificables.

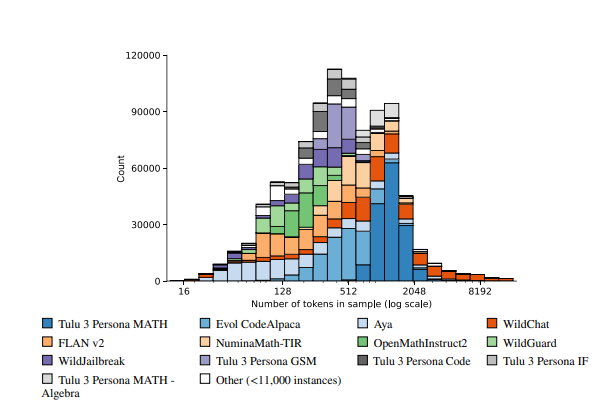

Primero, los investigadores se centran en las habilidades centrales del modelo y crean datos de entrenamiento combinando datos artificiales con datos sintéticos.

En segundo lugar, se realiza un ajuste supervisado para garantizar que el modelo funcione tan bien como otros modelos de última generación en habilidades específicas.

En tercer lugar, se utiliza el método de optimización de preferencia directa para mejorar aún más el rendimiento general del modelo. Finalmente, se introduce el método innovador de aprendizaje reforzado con recompensa verificable para ayudar al modelo a completar mejor las tareas con resultados verificables.

El modelo Tülu3 está construido sobre la base de Llama3.1 y tiene un rendimiento excelente en áreas como razonamiento, matemáticas, programación y seguimiento de instrucciones. En comparación con otros modelos de código abierto y cerrado, las capacidades integrales de Tülu3 funcionan bien en múltiples puntos de referencia, lo que marca un avance importante en la tecnología de capacitación posterior al código abierto.

Enlace del artículo: https://allnai.org/papers/tulu-3-report.pdf

Demostración: https://playground.allnai.org/

Reflejos:

?Tülu3 es un modelo de lenguaje de código abierto lanzado por AI2, que tiene un rendimiento comparable al de modelos de código cerrado como GPT-4o-mini.

? La tecnología posterior a la capacitación es crucial y puede mejorar efectivamente el rendimiento del modelo en aplicaciones prácticas.

? El innovador proceso de formación de Tülu3 se divide en cuatro etapas: construcción de datos, ajuste supervisado, ajuste de preferencias y aprendizaje reforzado con recompensa verificable.

La naturaleza de código abierto de Tülu3 permite a los investigadores estudiar en profundidad sus métodos de formación y realizar mejoras e innovaciones sobre esta base, lo que promoverá en gran medida el desarrollo de modelos de lenguaje de código abierto. Su excelente desempeño en muchos campos también indica que el modelo de código abierto desempeñará un papel más importante en el futuro. Se espera que Tülu3 pueda promover aún más la popularización y aplicación de la tecnología de inteligencia artificial.