En el campo de la inteligencia artificial, la inferencia eficiente de modelos es crucial. Los desarrolladores continúan explorando formas de ejecutar modelos de lenguaje grandes en diferentes plataformas de hardware. Recientemente, el desarrollador Andrei David logró un logro llamativo: trasplantó con éxito el modelo Llama 2 de Meta AI a una consola de juegos Xbox 360 que tiene casi veinte años. Esto no solo demuestra su excelente tecnología, sino que también proporciona la aplicación de inteligencia artificial. La informática de punta ofrece nuevas posibilidades. Este movimiento supera muchos desafíos, como la arquitectura PowerPC, las limitaciones de memoria y la conversión endian, y proporciona una experiencia valiosa para ejecutar modelos de lenguaje grandes en entornos de bajos recursos.

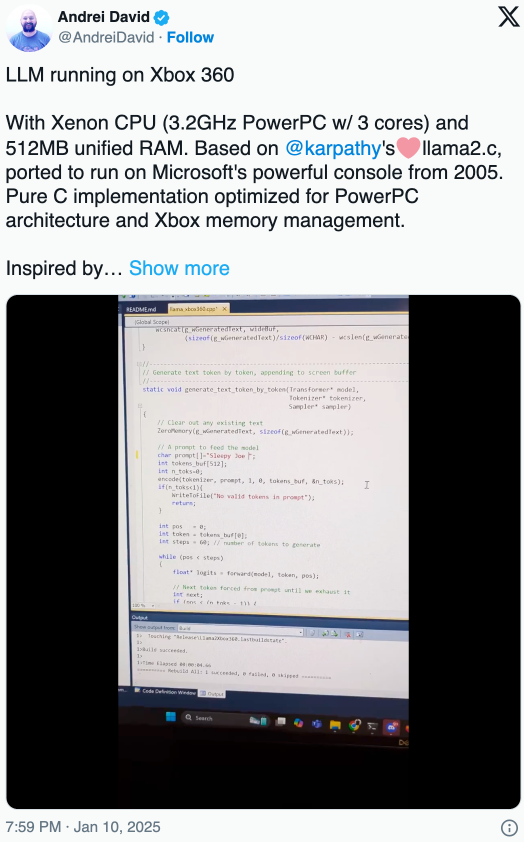

Hoy en día, con el rápido desarrollo de la tecnología de inteligencia artificial, cómo implementar una inferencia de modelo eficiente en diversos hardware se ha convertido en un desafío importante para los desarrolladores. Recientemente, el desarrollador Andrei David se inspiró en una consola de juegos Xbox 360 que tenía casi veinte años. Trasplantó con éxito un modelo liviano de la serie Llama LLM de Meta AI, llama2.c, a esta vieja consola.

David compartió su logro en la plataforma de redes sociales X y dijo que los desafíos que enfrentó fueron enormes. La CPU PowerPC de Xbox 360 utiliza una arquitectura big-endian, lo que significa que se debe realizar una gran cantidad de conversiones endian cuando el modelo está configurado y ponderado. Además, David necesitaba modificar y optimizar profundamente el código original para que se ejecutara sin problemas en una pieza de hardware tan antigua.

La gestión de la memoria también es un gran problema que debe resolver. El tamaño del modelo llama2 alcanza los 60 MB y la arquitectura de memoria de Xbox360 es memoria unificada, lo que significa que la CPU y la GPU deben compartir la misma memoria. Esto obliga a David a tener mucho cuidado al diseñar el uso de la memoria. Él cree que a pesar de las limitaciones de memoria de la Xbox 360, su arquitectura era muy vanguardista en ese momento, presagiando la tecnología de administración de memoria estándar de las consolas de juegos y APU modernas.

Después de repetidas codificaciones y optimizaciones, David finalmente ejecutó con éxito el modelo llama2 en Xbox360 con un simple mensaje: "Sleepy Joe dijo". Cabe mencionar que el modelo llama2 tiene sólo 700 líneas de código C y no tiene dependencias externas, lo que le permite mostrar un rendimiento "sorprendentemente" potente cuando se personaliza en áreas específicas.

Para otros desarrolladores, el éxito de David les dio una nueva dirección. Algunos usuarios sugirieron que la memoria de 512 MB de Xbox360 también podría admitir la implementación de otros LLM pequeños, como smolLM desarrollado por Hugging Face. David agradece esto y es probable que veamos más resultados experimentales de LLM en Xbox360 en el futuro.

La historia de éxito de David proporciona nuevas ideas e inspiración para los desarrolladores, lo que demuestra que incluso en dispositivos con recursos limitados, se pueden ejecutar grandes modelos de lenguaje mediante optimización inteligente y ajustes de código. Esto no sólo promueve un mayor desarrollo de la tecnología de inteligencia artificial en el campo de la informática de punta, sino que también ofrece posibilidades ilimitadas para aplicaciones más innovadoras en el futuro. En el futuro, esperamos ver más avances similares que lleven la tecnología de inteligencia artificial a una gama más amplia de escenarios de aplicación.