Codestral 25.01, el último modelo de codificación de código abierto lanzado por Mistral, ha logrado mejoras significativas en el rendimiento y es dos veces más rápido que la generación anterior. Como versión mejorada de Codestral, Codestral 25.01 hereda sus características de operación de baja latencia y alta frecuencia, y está optimizado para aplicaciones de nivel empresarial, admitiendo tareas como corrección de código, generación de pruebas y llenado intermedio. Su excelente rendimiento en la prueba de codificación Python, especialmente la alta puntuación del 86,6% en la prueba HumanEval, lo convierte en líder entre los modelos de codificación pesados actuales, superando a muchos productos similares.

Al igual que el Codestral original, Codestral 25.01 todavía se centra en operaciones de baja latencia y alta frecuencia, admitiendo corrección de código, generación de pruebas y tareas de llenado intermedio. Mistral dijo que esta versión es particularmente adecuada para empresas que requieren más datos y residencia de modelos. Las pruebas comparativas muestran que Codestral25.01 supera las expectativas en la prueba de codificación de Python, con una puntuación de prueba HumanEval del 86,6 %, superando con creces la versión anterior, Codellama70B Instruct y DeepSeek Coder33B Instruct.

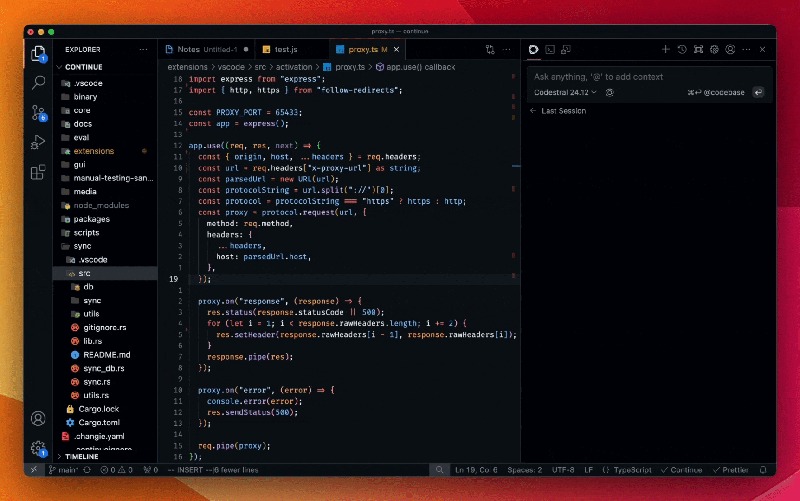

Los desarrolladores pueden acceder al modelo a través del complemento Mistral IDE, así como a través de la herramienta de implementación local Continuar. Además, Mistral también proporciona acceso a la API a través de Google Vertex AI y Mistral la Plateforme. El modelo está actualmente disponible en versión preliminar en Azure AI Foundry y pronto estará disponible en la plataforma Amazon Bedrock.

Desde su lanzamiento el año pasado, Codestral by Mistral se ha convertido en líder en el modelo de código abierto centrado en el código. Su primera versión de Codestral es un modelo de parámetros de 22B que admite hasta 80 idiomas y tiene un mejor rendimiento de codificación que muchos productos similares. Inmediatamente después, Mistral lanzó Codestral-Mamba, un modelo de generación de código basado en la arquitectura Mamba que puede manejar cadenas de código más largas y hacer frente a más requisitos de entrada.

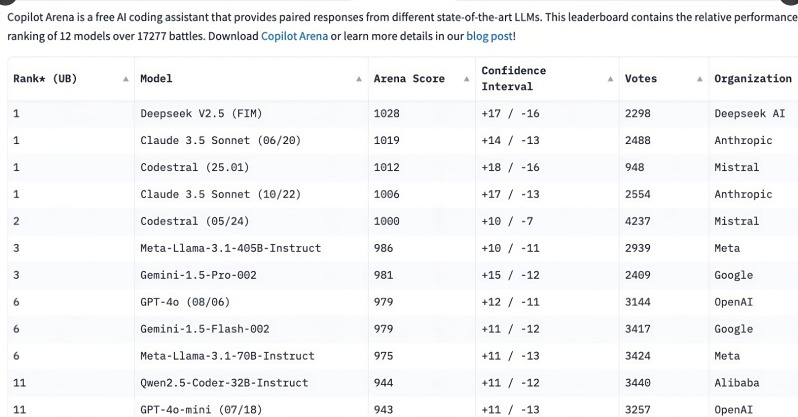

El lanzamiento de Codestral 25.01 atrajo una gran atención por parte de los desarrolladores, ubicándose en la cima de la clasificación de C o pilot Arena a las pocas horas de su lanzamiento. Esta tendencia muestra que los modelos de codificación especializados se están convirtiendo rápidamente en la primera opción para los desarrolladores, especialmente en el campo de las tareas de codificación, en comparación con los modelos generales multifuncionales, la necesidad de modelos de codificación enfocados es cada vez más obvia.

Aunque los modelos de propósito general como o3 de OpenAI y Claude de Anthropic también pueden codificar, los modelos de codificación especialmente optimizados tienden a funcionar mejor. El año pasado, varias empresas lanzaron modelos dedicados a la codificación, como el Qwen2.5-Coder de Alibaba y el DeepSeek Coder de China, convirtiéndose este último en el primer modelo en superar al GPT-4Turbo. Además, Microsoft también lanzó GRIN-MoE basado en el modelo de mezcla de expertos (MOE), que no solo puede codificar sino también resolver problemas matemáticos.

Aunque los desarrolladores todavía están debatiendo si elegir modelos de propósito general o modelos especializados, el rápido aumento de los modelos de codificación ha revelado una gran necesidad de herramientas de codificación eficientes y precisas. Con la ventaja de estar especialmente capacitado para tareas de codificación, Codestral25.01 sin duda ocupa un lugar en el futuro de la codificación.

El lanzamiento de Codestral25.01 marca otro paso adelante en el campo de los modelos de codificación profesionales. Su rendimiento superior y su cómodo acceso brindarán a los desarrolladores una experiencia de codificación más eficiente y promoverán un mayor desarrollo de la inteligencia artificial en el campo del desarrollo de software. En el futuro, esperamos ver surgir más modelos profesionales similares para brindar a los desarrolladores más opciones.