Deepseek lanzó recientemente los modelos Deepseek-V3 y Deepseek-R1 ha causado una gran respuesta en el campo de la inteligencia artificial. En particular, Deepseek-R1 de código abierto del modelo de código abierto y revela todas las tecnologías de capacitación, lo que ha atraído una atención generalizada en la industria y también ha aportado una gran presión a las empresas como Meta. Los ingenieros meta incluso declararon públicamente que el equipo estaba en pánico e intentaron replicar la tecnología de Deepseek.

La serie de modelos lanzados recientemente por Deepseek ha causado shock en el círculo global de IA. Deepseek-V3 logra un alto rendimiento a bajo costo y es comparable al modelo de código cerrado superior en muchas reseñas; También es de código abierto.

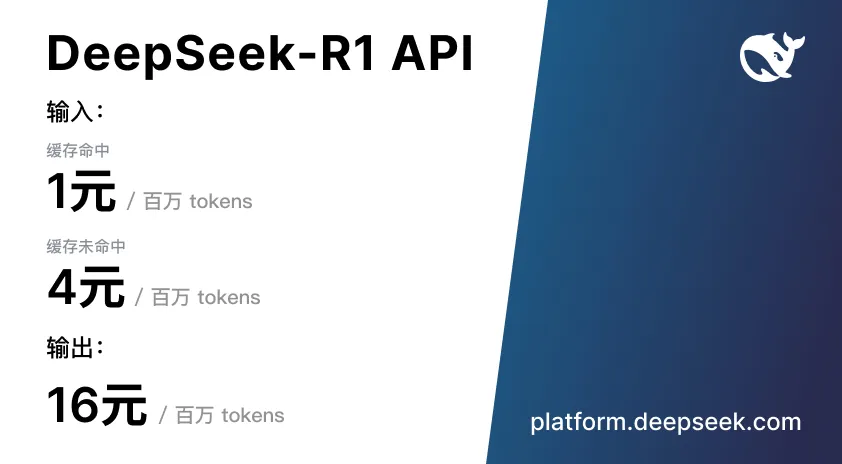

Deepseek también revela todas las técnicas de entrenamiento. R1 se comparó con el modelo O1 de OpenAI, y la tecnología de aprendizaje de refuerzo se usa ampliamente en la etapa posterior al entrenamiento. Deepseek dijo que R1 es comparable a O1 en tareas como las matemáticas, el código, el razonamiento del lenguaje natural y el precio de la API es inferior al 4% de O1.

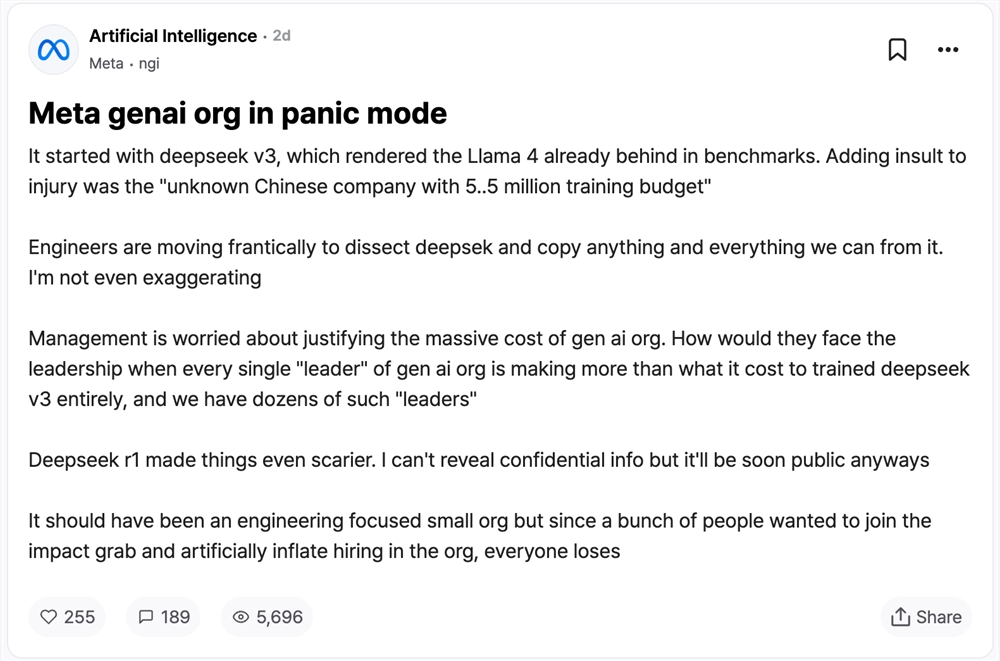

Recientemente, el equipo de Teamblind, un puesto anónimo de un meta empleado en la comunidad laboral anónima en el extranjero, fue particularmente popular. El lanzamiento de Deepseek V3 pone a Llama 4, todos en puntos de referencia, y el equipo de IA meta generativo está en pánico. Una "empresa china desconocida" tiene un presupuesto de $ 5.5 millones para completar la capacitación y abofetear el modelo grande existente en la cara.

Los ingenieros meta desmantelan frenéticamente a Deepseek e intentan copiar, mientras que la gerencia está ansiosa por explicar los altos costos para la alta gerencia. La aparición de Deepseek R1 empeora la situación, y aunque todavía no se puede revelar información, se hará pública pronto, y la situación puede ser aún más desfavorable para entonces.

La traducción del puesto anónimo de meta empleados es la siguiente (traducida por Deepseek R1):

El departamento de IA meta generativa ingresa a un estado de emergencia

Todo comenzó con Deepseek V3: hizo que la puntuación de referencia LLAMA 4 se viera al instante anticuada. Lo que es aún más vergonzoso es que "una empresa china desconocida logró un gran avance con solo $ 5 millones en presupuesto de capacitación".

El equipo de ingenieros está desmantelando frenéticamente la arquitectura Deepseek, tratando de replicar todos sus detalles técnicos. Esta no es una exageración, nuestra base de código está experimentando una búsqueda de estilo de alfombra.

La gerencia está muriendo sobre la racionalidad de los enormes gastos del departamento. Cuando el salario anual de cada "líder" en el departamento generativo de IA excede todo el costo de capacitación de Deepseek V3, y tenemos docenas de tales "líderes", ¿cómo deberían explicar a la alta gerencia?

Deepseek R1 hace que la situación sea aún más grave. Aunque no se puede divulgar información confidencial, los datos relevantes se harán públicos pronto.

Debería ser un equipo calificado orientado a la tecnología, pero la estructura organizativa se expandió deliberadamente debido a la afluencia de una gran cantidad de personas para la influencia. El resultado de este juego de tronos? Al final, todos se convirtieron en perdedores.

Introducción a los modelos de la serie DeepseekDeepseek-V3: es un modelo de lenguaje híbrido experto (MOE) con una cantidad de parámetros de 671B, y cada token activa 37B. Adopta la atención latente de múltiples cabezas (MLA) y la arquitectura de Deepseekmoe, previamente entrenado en 14.8 billones de tokens de alta calidad, y después de un aprendizaje supervisado de ajuste fino y refuerzo, supera algunos modelos de código abierto en múltiples evaluaciones, y se asocia con Los modelos de código cerrado GPT-4O y Claude 3.5 Top Close-Source, como Sonnet, tienen un rendimiento comparable. El costo de capacitación es bajo, solo 2.788 millones de horas de GPU H800, aproximadamente 5.576 millones de dólares estadounidenses, y el proceso de capacitación es estable.

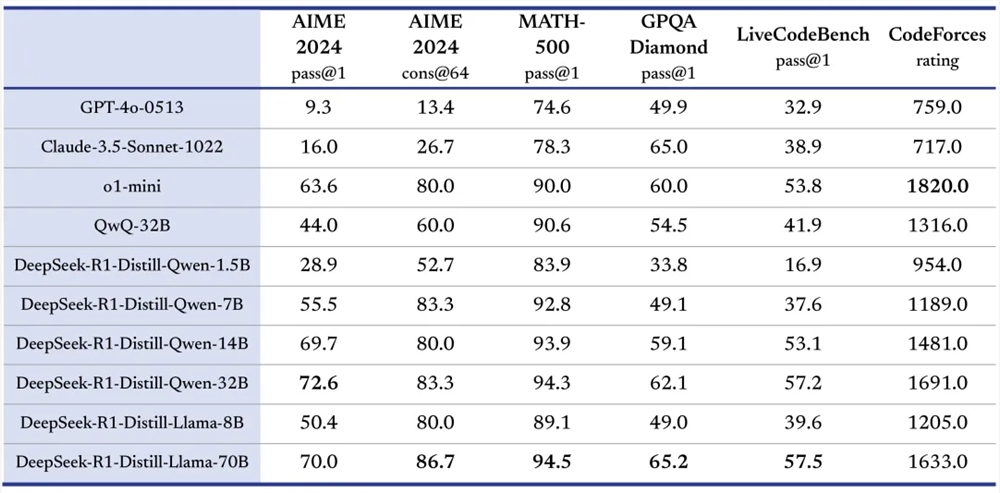

Deepseek-r1: incluye Deepseek-R1-Zero y Deepseek-R1. A través del entrenamiento de aprendizaje de refuerzo a gran escala, Deepseek-R1-Zero demuestra autoverificación, reflexión y otras habilidades a través de la capacitación de aprendizaje de refuerzo a gran escala, y no confía en el ajuste (SFT) supervisado, pero hay problemas como pobres Leyabilidad y confusión del lenguaje. Basado en Deepseek-R1, Deepseek-R1 presenta entrenamiento en varias etapas y datos de inicio en frío, lo que resuelve algunos problemas es comparable a la versión oficial de OpenAI O1 en tareas como las matemáticas, el código y el razonamiento del lenguaje natural. Al mismo tiempo, se han abierto múltiples modelos con diferentes escalas de parámetros para promover el desarrollo de la comunidad de código abierto.

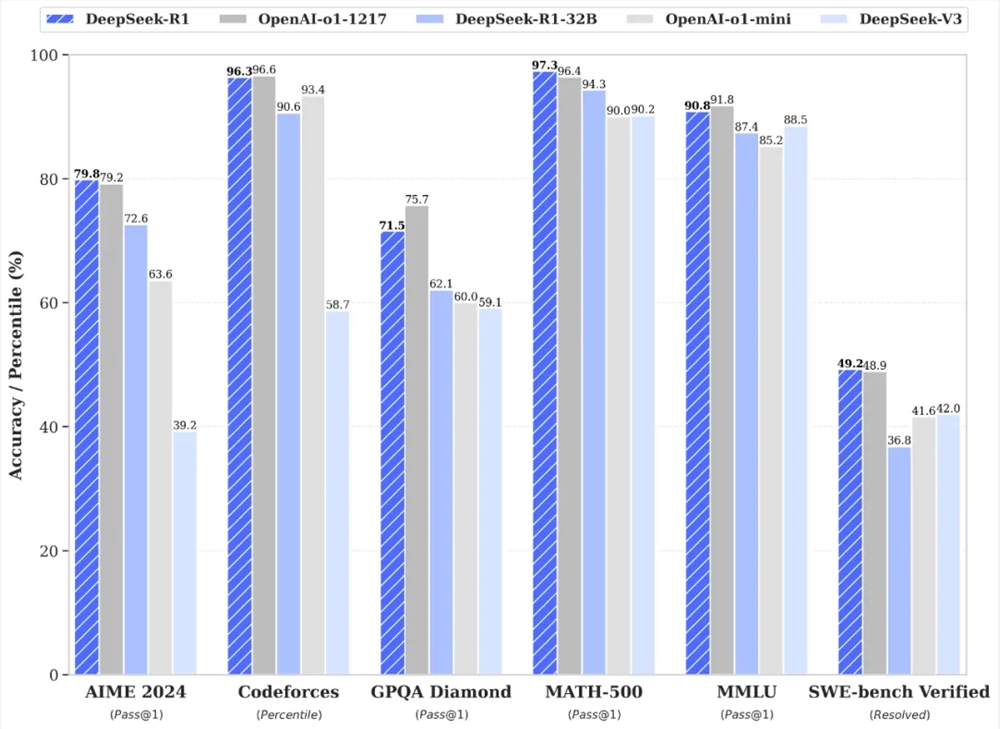

Excelente rendimiento: Deepseek-v3 y Deepseek-R1 se desempeñaron bien en múltiples puntos de referencia. Por ejemplo, Deepseek-V3 logró excelentes resultados en MMLU, Drop y otras evaluaciones; .

Innovación de capacitación:

Deepseek-v3 adopta estrategias de equilibrio de carga sin pérdidas auxiliares y objetivos de predicción múltiple (MTP) para reducir la degradación del rendimiento y mejorar el rendimiento del modelo;

Deepseek-r1-cero utiliza la capacitación de aprendizaje de refuerzo puro y dependiendo únicamente de señales simples de recompensa y castigo para optimizar el modelo, lo que demuestra que el aprendizaje de refuerzo puede mejorar la capacidad de inferencia del modelo; estabilidad y legibilidad.

Compartir de código abierto: los modelos de la serie Deepseek se adhieren al concepto de código abierto y pesas de modelos de código abierto, como Deepseek-V3 y Deepseek-R1 y sus pequeños modelos destilados, lo que permite a los usuarios capacitar a otros modelos a través de la tecnología de destilación para promover la comunicación e innovación en Tecnología de IA.

Ventajas de múltiples dominios: Deepseek-R1 demuestra sus poderosas capacidades en múltiples campos. y tareas de generación.

Rendimiento de alto costo: la API del modelo de la serie Deepseek es asequible. Por ejemplo, el precio de entrada y salida de la API Deepseek-V3 es mucho más bajo que los modelos similares;

Tareas de procesamiento del lenguaje natural: incluido el sistema de generación de texto, preguntas y respuestas, traducción automática, resumen de texto, etc. Por ejemplo, en un sistema de preguntas y respuestas, Deepseek-R1 puede comprender el problema y usar la capacidad de razonamiento para dar respuestas precisas;

Desarrollo del código: ayuda a los desarrolladores a escribir código, los programas de depuración y comprender la lógica del código. Por ejemplo, cuando los desarrolladores encuentran problemas de código, Deepseek-R1 puede analizar el código y proporcionar soluciones;

Resolución de problemas matemáticos: resuelva problemas matemáticos complejos en educación matemática, investigación científica y otros escenarios. Al igual que Deepseek-R1, funciona bien en las preguntas relacionadas con la competencia de AIME y puede usarse para ayudar a los estudiantes a aprender matemáticas e investigadores a tratar los problemas matemáticos.

Investigación y desarrollo de modelos: proporciona referencia y herramientas para que los investigadores de IA estudien la destilación del modelo, la estructura de modelos mejorada y los métodos de entrenamiento. Los investigadores pueden realizar experimentos basados en el modelo de código abierto Deepseek para explorar nuevas direcciones tecnológicas.

Toma de decisiones auxiliares: procesar datos e información y proporcionar asesoramiento de toma de decisiones en los campos de negocios, finanzas, etc. Por ejemplo, analizar los datos del mercado para proporcionar referencia a las empresas para formular estrategias de marketing;

Visite la plataforma: los usuarios pueden iniciar sesión en el sitio web oficial de Deepseek (https://www.deepseek.com/) para ingresar a la plataforma.

Seleccione un modelo: en el sitio web o aplicación oficial, el diálogo predeterminado es impulsado por Deepseek-V3. Si se llama a través de la API, establezca los parámetros del modelo correspondientes en el código de acuerdo con los requisitos, como la configuración del modelo = 'Deepseek-Razoner' cuando se usa Deepseek-R1.

Tareas de entrada: Ingrese las tareas descritas en el lenguaje natural en la interfaz de diálogo, como "escribir una novela de amor", "explicar la función de este código", "Resolver ecuaciones matemáticas", etc.; a las especificaciones API y agregue la información relacionada con la tarea aprobada como parámetros de entrada.

Obtenga resultados: después de que el modelo procesa la tarea, devuelva los resultados, vea el texto generado, respondió preguntas, etc. en la interfaz;

ConclusiónLos modelos de la serie Deepseek han logrado resultados notables en el campo de la IA con su rendimiento sobresaliente, métodos de capacitación innovadores, espíritu de intercambio de código abierto y ventajas rentables.

Si está interesado en la tecnología AI, también le puede gustar, comentar y compartir sus puntos de vista sobre la serie de modelos Deepseek. Al mismo tiempo, continuamos prestando atención al desarrollo posterior de Deepseek, y esperamos que brinde más sorpresas y avances al campo de IA, promoviendo el progreso continuo de la tecnología de IA y brindando más cambios y oportunidades a diversos industrias.

La aparición de Deepseek ha traído una nueva vitalidad y competencia al campo de la inteligencia artificial, y su espíritu de código abierto es aún más encomiable. En el futuro, los modelos de la serie Deepseek mostrarán sus poderosas habilidades en más campos, ¡esperemos y veamos!