Meta Fair Lab lanzó recientemente una gran tecnología de percepción táctil de la punta de los dedos multimodal llamada "Sparsh", que se espera que revolucione por completo el campo de la manipulación de robots. El modelo Sparsh utiliza el aprendizaje auto-supervisado para pre-entrenado más de 460,000 imágenes táctiles, y aprender representaciones táctiles generales sin etiquetado manual de datos, realizando la capacidad de percepción táctil del robot que es similar a los humanos. Es compatible con una variedad de sensores hápticos visuales y funciona bien en múltiples tareas, como la estimación de fuerza y la detección de deslizamiento, especialmente cuando los datos son limitados, su rendimiento excede con creces el de los modelos tradicionales.

El modelo SPARSH adopta el aprendizaje auto-supervisado, utilizando más de 460,000 imágenes táctiles para la capacitación previa, y aprende representaciones táctiles generales sin etiquetado manual de datos.

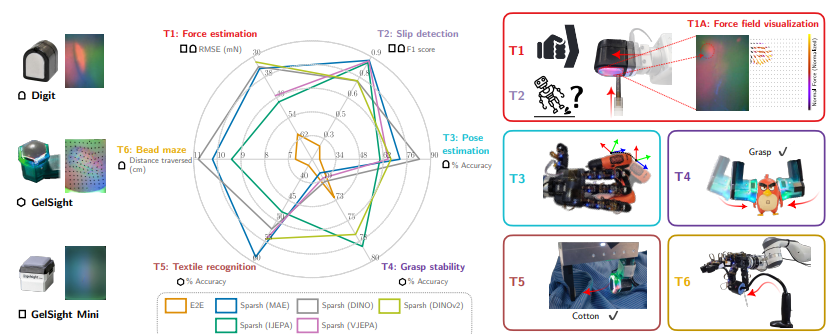

El modelo puede admitir una variedad de tipos de sensores hápticos visuales, incluidos Digit, Gelsight2017 y Gelsight Mini, y mejora significativamente el rendimiento del robot en las tareas de percepción táctil, como la estimación de la fuerza, la detección de deslizamiento, la estimación de la pose, la predicción de la estabilidad de agarre e identificación de la tela, etc. Los investigadores también construyeron una plataforma de evaluación comparativa estandarizada llamada Tacbench para evaluar el rendimiento de diferentes sensores y modelos hápticos en diversas tareas.

Los resultados de las pruebas muestran que el modelo SPARSH funciona bien en las seis tareas en Tacbench, especialmente cuando el volumen de datos es limitado, y su rendimiento está mucho más allá de los modelos tradicionales específicos de la tarea y específicos del sensor. Por ejemplo, en la estimación de la fuerza y las tareas de detección deslizante, el modelo SPARSH puede lograr resultados satisfactorios, incluso si solo se utilizan el 1% de los datos de anotación. Esto significa que Sparsh puede ayudar a los robots a comprender mejor las propiedades físicas de los objetos y realizar una manipulación más refinada.

El lanzamiento del modelo Sparsh marca un gran avance en el campo de la percepción háptica de AI. En el futuro, con la acumulación de más datos y una mayor optimización de los modelos, se espera que Sparsh cambie completamente la forma en que los robots interactúan con el mundo físico y promueven la aplicación de robótica en una gama más amplia de campos.

Dirección en papel:

https://scontent-sjc3-1.xx.fbcdn.net/v/t39.2365-6/464969941_1107633400780143_74791023473328147009_n.pdf?_nc_cat=103&ccbb=1-7&_nc_sc_sid=3c_sid=3nc_sid=3nc_sid=3nc_sid=yc_nc_nc_sid=yc_sid=3c_sid=3c_sid=3nc_sid=3c_sid=3nc_sid=3nc_sid=yc_nc_sid=yc_sid=yc_nc_nc_nc_sid=3nc_sid=3nc_sid=yc_sid=yc_sid=3nc_sid=yc_sid=3 nc_ohc = y8ui1hew3bqq7knvgfe-epu & _nc_zt = 14 & _nc_ht = scontent-sjc3-1. xx & _nc_gid = AEFSUZZIASVWPFMQSEOZQU & OH = 00_AYAMQXGQ0ATCYSDXZWB0ZT8BGSKOGYMJ13C9F3YTVTKMSG & OE = 672DEEE4

La aparición de la tecnología Sparsh indica que la tecnología de percepción háptica robótica ha alcanzado un nuevo hito. Su potencial en la manipulación refinada y la interacción humana-computadora es enorme, y vale la pena esperar sus perspectivas de aplicaciones futuras.