Clonez ce dépôt dans le Your ComfyUI root directoryComfyUIcustom_nodes et installez les packages Python dépendants :

cd Your_ComfyUI_root_directoryComfyUIcustom_nodes clone git https://github.com/Bin-sam/DynamicPose-ComfyUI.git pip install -r exigences.txt

Téléchargez des modèles pré-entraînés :

./pretrained_weights/

|-- denoising_unet.pth

|-- motion_module.pth

|-- pose_guider.pth

|-- reference_unet.pth

|-- rtmpose

| |-- rtmw-x_simcc-cocktail14_pt-ucoco_270e-384x288-f840f204_20231122.pth

| |-- rtmw-x_8xb320-270e_cocktail14-384x288.py

| |-- rtmdet_m_640-8xb32_coco-person.py

| |-- rtmdet_m_8xb32-100e_coco-obj365-person-235e8209.pth

| |-- rtmpose-x_8xb256-700e_coco-384x288.py

| |-- rtmpose-x_simcc-body7_pt-body7_700e-384x288-71d7b7e9_20230629.pth

|-- DWPose

| |-- dw-ll_ucoco_384.onnx

| |-- yolox_l.onnx Téléchargez l'encodeur d'image clip (par exemple sd-image-variations-diffusers) et placez-le sous Your_ComfyUI_root_directoryComfyUImodelsclip_vision

Téléchargez vae (par exemple sd-vae-ft-mse) et placez-le sous Your_ComfyUI_root_directoryComfyUImodelsvae

Téléchargez stable-diffusion-v1-5 (par exemple stable-diffusion-v1-5) et placez-le sous Your_ComfyUI_root_directoryComfyUImodelsdiffusers

stable-diffusion-v1-5_unet

Modèles pré-entraînés Moore-AnimateAnyone

Les liens de téléchargement du modèle DWpose se trouvent sous le titre « DWPose pour ControlNet ».

Les modèles ci-dessus doivent être placés dans le dossier pretrained_weights comme suit :

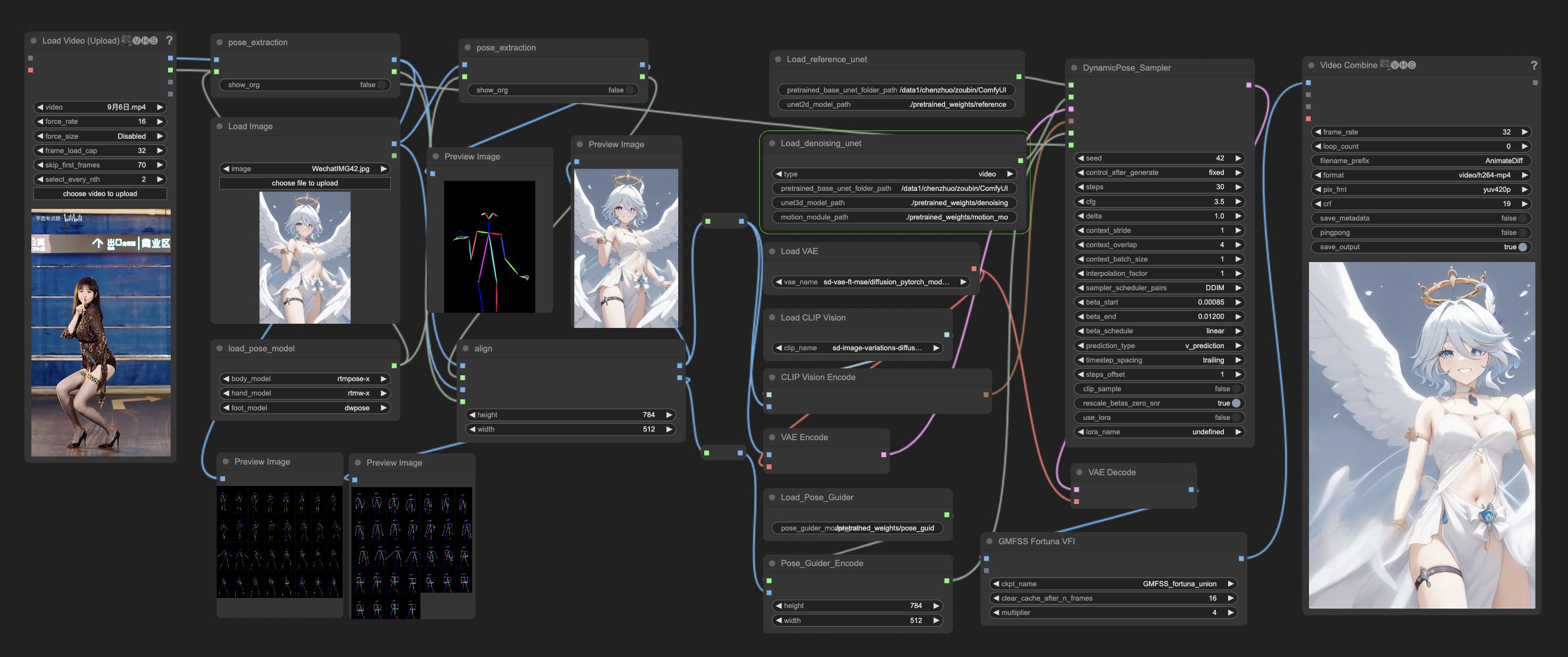

Utiliser des exemples de pipelines

ce flux de travail est Pose_to_video