Hyeongjin Nam* 1 , Daniel Sungho Jung* 1 , Gyeongsik Moon 2 , Kyoung Mu Lee 1

![]()

![]()

1 Université nationale de Séoul , 2 Codec Avatars Lab, Meta

(*Contribution égale)

CONTHO reconstruit conjointement l'homme et l'objet en 3D en exploitant le contact homme-objet comme signal clé dans une reconstruction précise. À cette fin, nous intégrons la "reconstruction 3D homme-objet" et "l'estimation du contact homme-objet" , deux tâches différentes qui ont été étudiées séparément dans deux pistes, avec un cadre unifié.

Nous vous recommandons d'utiliser un environnement virtuel Anaconda. Installez PyTorch >=1.10.1 et Python >= 3.7.0. Notre dernier modèle CONTHO est testé sur Python 3.9.13, PyTorch 1.10.1, CUDA 10.2.

Configurer l'environnement

# Initialize conda environment conda create -n contho python=3.9 conda activate contho # Install PyTorch conda install pytorch==1.10.1 torchvision==0.11.2 torchaudio==0.10.1 cudatoolkit=10.2 -c pytorch # Install all remaining packages pip install -r requirements.txt

Préparez le base_data à partir de Google Drive ou Onedrive et placez-le sous ${ROOT}/data/base_data .

Téléchargez le point de contrôle pré-entraîné depuis Google Drive ou OneDrive.

Enfin, s'il vous plaît, courez

python main/demo.py --gpu 0 --checkpoint {CKPT_PATH} Vous devez suivre la structure des répertoires des data comme ci-dessous.

${ROOT}

|-- data

| |-- base_data

| | |-- annotations

| | |-- backbone_models

| | |-- human_models

| | |-- object_models

| |-- BEHAVE

| | |-- dataset.py

| | |-- sequences

| | | |-- Date01_Sub01_backpack_back

| | | |-- Date01_Sub01_backpack_hand

| | | |-- ...

| | | |-- Date07_Sub08_yogamat

| |-- InterCap

| | |-- dataset.py

| | |-- sequences

| | | |-- 01

| | | |-- 02

| | | |-- ...

| | | |-- 10 Téléchargez les séquences Data01~Data07 de l'ensemble de données BEHAVE vers ${ROOT}/data/BEHAVE/sequences .

(Option 1) Téléchargez directement l'ensemble de données BEHAVE à partir de leur page de téléchargement.

(Option 2) Exécutez le script ci-dessous.

scripts/download_behave.sh

Téléchargez RGBD_Images.zip et Res.zip depuis l'ensemble de données InterCap vers ${ROOT}/data/InterCap/sequences .

(Option 1) Téléchargez directement l'ensemble de données InterCap à partir de leur page de téléchargement.

(Option 2) Exécutez le script ci-dessous.

scripts/download_intercap.sh

Téléchargez base_data depuis Google Drive ou Onedrive.

(Facultatif) Téléchargez les points de contrôle publiés pour l'ensemble de données BEHAVE (Google Drive | OneDrive) et InterCap (Google Drive | OneDrive).

Pour entraîner CONTHO sur l'ensemble de données BEHAVE ou InterCap, veuillez exécuter

python main/train.py --gpu 0 --dataset {DATASET}Pour évaluer CONTHO sur l'ensemble de données BEHAVE ou InterCap, veuillez exécuter

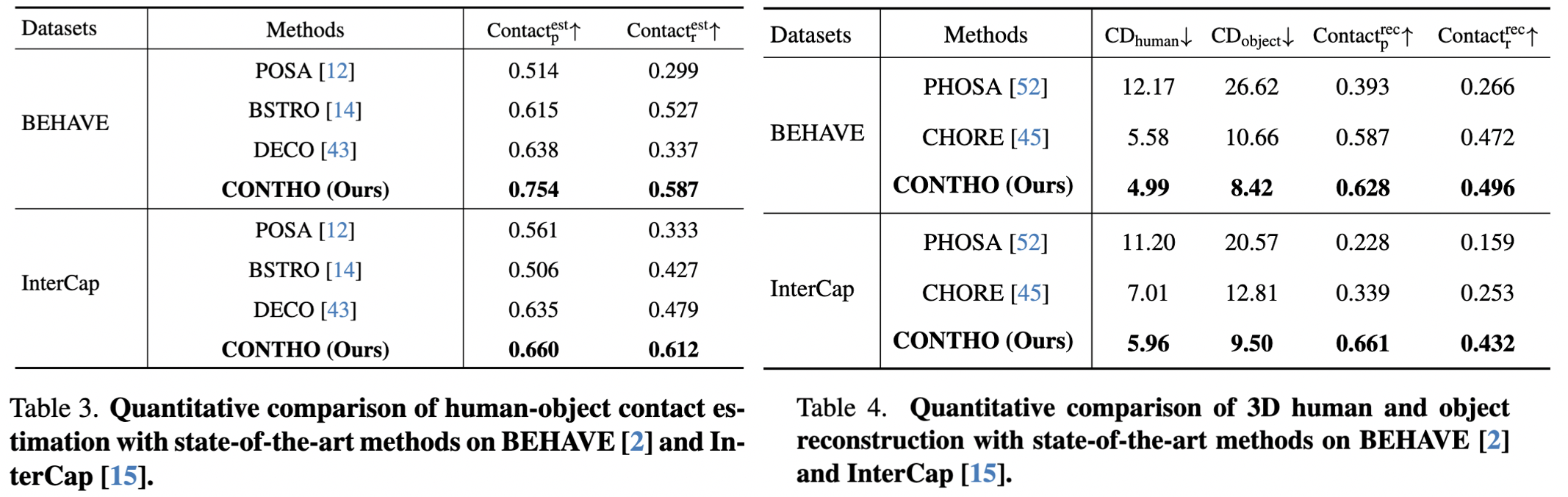

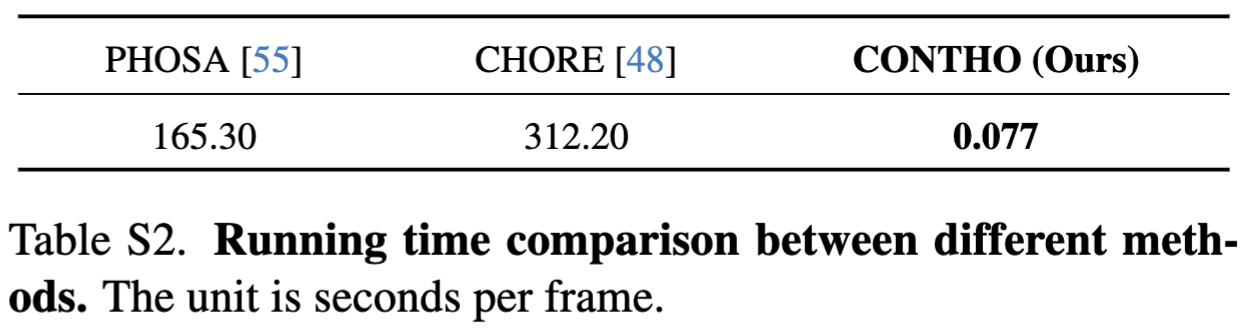

python main/test.py --gpu 0 --dataset {DATASET} --checkpoint {CKPT_PATH} Ici, nous rapportons les performances de CONTHO.

CONTHO est un framework de reconstruction humaine et d'objets 3D rapide et précis !

RuntimeError : la soustraction, l'opérateur - , avec un tenseur booléen n'est pas prise en charge. Si vous essayez d'inverser un masque, utilisez plutôt l'opérateur ~ ou logical_not() : Veuillez vérifier la référence.

bash : scripts/download_behave.sh : Autorisation refusée : veuillez vérifier la référence.

Nous remercions :

Hand4Whole pour la reconstitution du maillage humain en 3D.

CHORE pour la formation et les tests sur BEHAVE.

InterCap pour le script de téléchargement de l'ensemble de données.

DECO pour une configuration d'expérimentation en pleine nature.

@inproceedings{nam2024contho,

title = {Joint Reconstruction of 3D Human and Object via Contact-Based Refinement Transformer},

author = {Nam, Hyeongjin and Jung, Daniel Sungho and Moon, Gyeongsik and Lee, Kyoung Mu},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

year = {2024}

}