Chinois | Anglais

Tutoriel vidéo Installation et déploiement Expérience en ligne

⚡Caractéristiques :

conda create - n llm python = 3.11

conda activate llm

python - m pip install - r requirements . txt # 转为HF格式

python - m transformers . models . llama . convert_llama_weights_to_hf

- - input_dir path_to_llama_weights - - model_size 7 B - - output_dir path_to_llama_model Si vous utilisez un ensemble de données personnalisé, assurez-vous de fournir la définition de votre ensemble de données dans le fichier dataset_info.json au format suivant.

"数据集名称" : {

"hf_hub_url" : " HuggingFace上的项目地址(若指定,则忽略下列三个参数) " ,

"script_url" : "包含数据加载脚本的本地文件夹名称(若指定,则忽略下列两个参数) " ,

"file_name" : "该目录下数据集文件的名称(若上述参数未指定,则此项必需) " ,

"file_sha1" : "数据集文件的SHA-1哈希值(可选) " ,

"columns" : {

"prompt" : "数据集代表提示词的表头名称(默认:instruction) " ,

"query" : "数据集代表请求的表头名称(默认:input) " ,

"response" : "数据集代表回答的表头名称(默认:output) " ,

"history" : "数据集代表历史对话的表头名称(默认:None) "

}

} Les colonnes prompt et response doivent être des chaînes non vides. Le contenu de la colonne query sera concaténé avec la colonne prompt en tant qu'entrée du modèle. La colonne history doit être une liste, où chaque élément est un tuple de chaîne représentant respectivement la demande de l'utilisateur et la réponse du modèle.

Format .txt , une donnée non supervisée par ligne.

Machine learning (ML) is a field devoted to understanding and building methods that let machines "learn" – that is, methods that leverage data to improve computer performance on some set of tasks.

Machine learning algorithms build a model based on sample data, known as training data, in order to make predictions or decisions without being explicitly programmed to do so. Machine learning algorithms are used in a wide variety of applications, such as in medicine, email filtering, speech recognition, agriculture, and computer vision, where it is difficult or unfeasible to develop conventional algorithms to perform the needed tasks.[

{

"instruction" : "听起来很不错。人工智能可能在哪些方面面临挑战呢? " ,

"input" : " " ,

"output" : "人工智能面临的挑战包括数据隐私、安全和道德方面的问题,以及影响就业机会的自动化等问题。 " ,

"history" : [

[ "你好,你能帮我解答一个问题吗? " , "当然,请问有什么问题? " ],

[ "我想了解人工智能的未来发展方向,你有什么想法吗? " , "人工智能在未来的发展方向可能包括更强大的机器学习算法,更先进的自然语言处理技术,以及更加智能的机器人。 " ]

]

}

][

{

"instruction" : "听起来很不错。人工智能可能在哪些方面面临挑战呢? " ,

"input" : " " ,

"output" : "人工智能面临的挑战包括数据隐私、安全和道德方面的问题,以及影响就业机会的自动化等问题。 " ,

"history" : []

}

][

{

"instruction" : "生成三个与“道歉”意思相同的动词" ,

"input" : " " ,

"output" : [

"承认,表示遗憾,弥补。 " ,

"道歉"

]

}

] Vérifiez si votre carte graphique est connectée à NVLINK. Ce n'est qu'avec la connexion NVLINK que vous pouvez utiliser efficacement accelerate pour un entraînement accéléré en parallèle.

nvidia-smi topo -m

accelerate config # configure the environment

accelerate launch src / train_bash . py # arguments (same as above) # LLaMA-2

accelerate launch src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_train

- - dataset mm

- - finetuning_type lora

- - quantization_bit 4

- - overwrite_cache

- - output_dir output

- - per_device_train_batch_size 8

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 1000

- - learning_rate 5e-5

- - num_train_epochs 2.0

- - plot_loss

- - fp16

- - template llama2

- - lora_target q_proj , v_proj

# LLaMA

accelerate launch src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_train

- - dataset mm , hm

- - finetuning_type lora

- - overwrite_cache

- - output_dir output - 1

- - per_device_train_batch_size 4

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 2000

- - learning_rate 5e-5

- - num_train_epochs 2.0

- - plot_loss

- - fp16

- - template default

- - lora_target q_proj , v_proj # LLaMA-2, DPO

accelerate launch src / train_bash . py

- - stage dpo

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_train

- - dataset rlhf

- - template llama2

- - finetuning_type lora

- - quantization_bit 4

- - lora_target q_proj , v_proj

- - resume_lora_training False

- - checkpoint_dir . / output - 2

- - output_dir output - dpo

- - per_device_train_batch_size 2

- - gradient_accumulation_steps 4

- - lr_scheduler_type cosine

- - logging_steps 10

- - save_steps 1000

- - learning_rate 1e-5

- - num_train_epochs 1.0

- - plot_loss

- - fp16 # LLaMA-2

python src / web_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / web_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / web_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2 # LLaMA-2

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / api_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2API de test :

curl - X 'POST'

'http://127.0.0.1:8888/v1/chat/completions'

- H 'accept: application/json'

- H 'Content-Type: application/json'

- d ' {

"model" : "string",

"messages": [

{

"role" : "user",

"content": "你好"

}

],

" temperature ": 0 ,

"top_p" : 0 ,

"max_new_tokens" : 0 ,

"stream" : false

}' # LLaMA-2

python src / cli_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / cli_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default

# DPO

python src / cli_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output - dpo

- - finetuning_type lora

- - template llama2 # LLaMA-2

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_predict

- - dataset mm

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir predict_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate

# LLaMA

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_predict

- - dataset mm

- - template default

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir predict_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate # LLaMA-2

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - do_eval

- - dataset mm

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir eval_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate

# LLaMA

CUDA_VISIBLE_DEVICES = 0 python src / train_bash . py

- - stage sft

- - model_name_or_path . / Llama - 7 b - hf

- - do_eval

- - dataset mm

- - template default

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir eval_output

- - per_device_eval_batch_size 8

- - max_samples 100

- - predict_with_generate Pour une évaluation 4/8 bits, il est recommandé d'utiliser --per_device_eval_batch_size=1 et --max_target_length 128

# LLaMA-2

python src / export_model . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - template llama2

- - finetuning_type lora

- - checkpoint_dir output - 1

- - output_dir output_export

# LLaMA

python src / export_model . py

- - model_name_or_path . / Llama - 7 b - hf

- - template default

- - finetuning_type lora

- - checkpoint_dir output

- - output_dir output_export % cd Gradio

python app . py

# LLaMA-2

python src / api_demo . py

- - model_name_or_path . / Llama - 2 - 7 b - chat - hf

- - checkpoint_dir output

- - finetuning_type lora

- - template llama2

# LLaMA

python src / api_demo . py

- - model_name_or_path . / Llama - 7 b - hf

- - checkpoint_dir output - 1

- - finetuning_type lora

- - template default设置, modifiez接口地址en : http://127.0.0.1:8000/ (c'est-à-dire l'adresse de votre interface API), et vous pourrez ensuite l'utiliser.

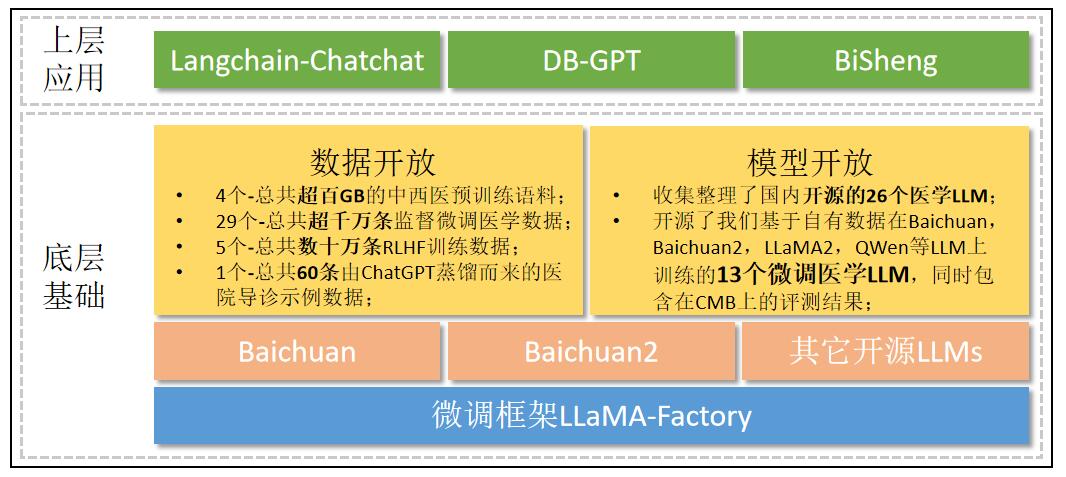

PubMed Central et PubMed Abstracts . Ces textes précieux ont considérablement enrichi le système de connaissances médicales du modèle BLOOMZ, c'est pourquoi de nombreux projets open source donneront la priorité à BLOOMZ comme modèle de base pour le réglage médical ;质量> 数量est la vérité, comme : Moins c'est plus ! Remis à Qingyuan&& Caspian | MiniGPT-4 ! , les données SFT à très grande échelle affaibliront la tâche en aval LLM ou perdront ICL, CoT et d'autres capacités ;大规模预训练+小规模监督微调=超强的LLM模型;英文10B以下选择Mistral-7B中文, 10B以下选择Yi-6B 10B, et 10B以上选择Qwen-14B和Yi-34B ; Important

Tout le monde est invité à ajouter de nouvelles expériences à ISSUE !

La méthodologie 11~13 provient de 13 milliards de grands modèles de langage. Changer un seul poids fera perdre complètement la capacité du langage ! Les dernières recherches du Laboratoire de traitement du langage naturel de l'Université de Fudan.

14Méthodologie de la façon dont les capacités dans les grands modèles linguistiques sont affectées par la composition des données de réglage fin supervisé

La méthodologie 17 ~ 25 provient de l'optimisation LLM : interprétation de la version chinoise de l'adaptation de rang optimal par couche (LORA)

| scène | Introduction aux poids | Adresse de téléchargement | Caractéristiques | modèle de base | méthode de réglage fin | Ensemble de données |

|---|---|---|---|---|---|---|

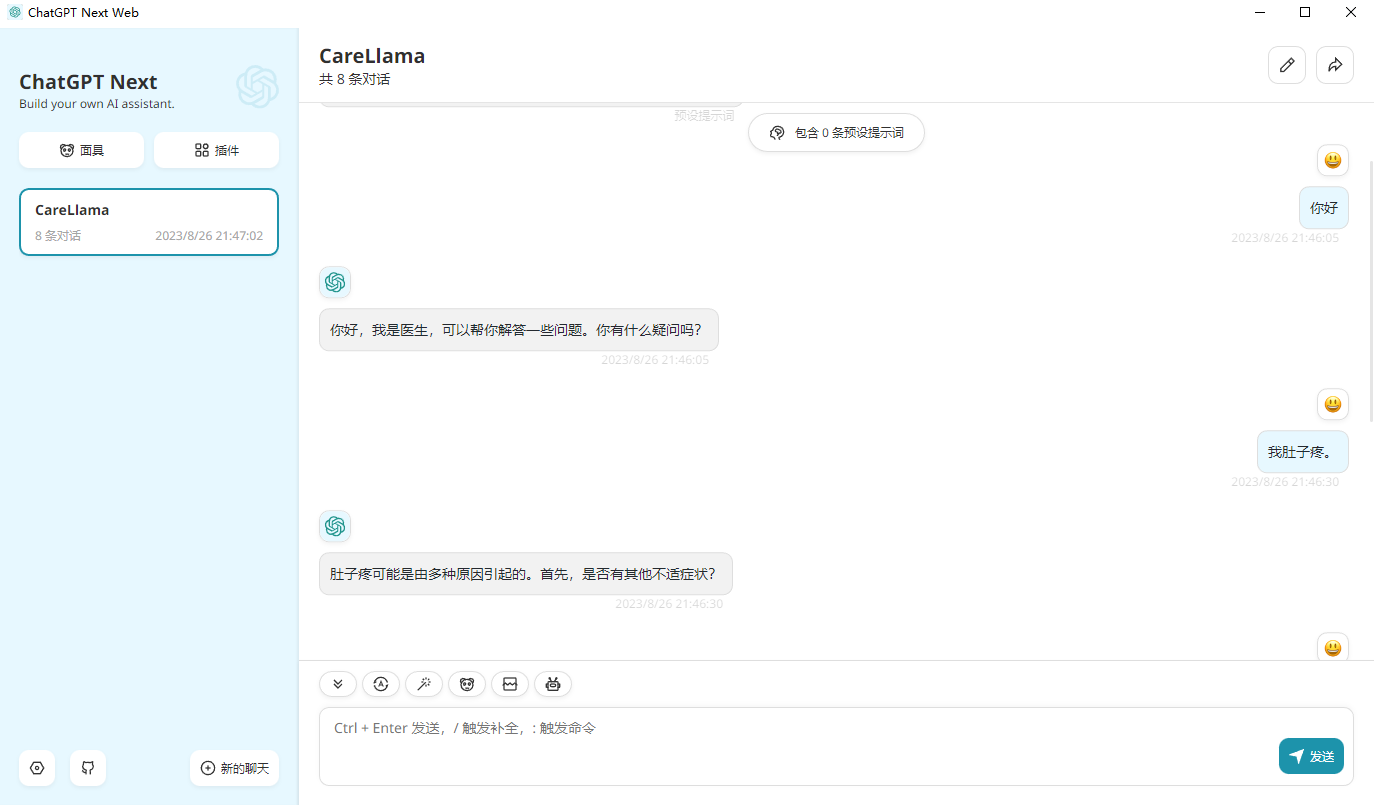

| ?Supervision et mise au point | Les données de dialogue multi-tours sont formées sur la base de LLaMA2-7b-Chat | CareLlama2-7b-chat-sft-multi、?CareLlama2-7b-multi | Excellentes compétences en conversation à plusieurs tours | LLaMA2-7b-Chat | QLoRA | mm |

| Superviser la mise au point | Des données de dialogue médecin-patient riches et efficaces sont formées sur la base de LLaMA2-7b-Chat | CareLlama2-7b-chat-sft-med | Excellentes capacités de diagnostic des maladies des patients | LLaMA2-7b-Chat | QLoRA | hum |

| superviser |