Wen Wang 1,2 , Qiuyu Wang 2 , Kecheng Zheng 2 , Hao Ouyang 2 , Zhekai Chen 1 , Biao Gong 2 , Hao Chen 1 ,

Yujun Shen 2 , Chunhua Shen 1

1 Université du Zhejiang, Chine, 2 Ant Group

Nous proposons Framer, une méthode d'interpolation d'images plus contrôlable et interactive qui permet aux utilisateurs de produire des images à transition fluide entre deux images en personnalisant la trajectoire des points clés sélectionnés, en améliorant le contrôle et en gérant les cas difficiles.

La méthode proposée, Framer, fournit une interpolation de trame interactive, permettant aux utilisateurs de personnaliser les transitions en adaptant les trajectoires des points clés sélectionnés. Cette approche atténue l'ambiguïté de la transformation d'image, permettant un contrôle beaucoup plus fin des mouvements locaux et améliorant la capacité du modèle à gérer des cas difficiles (par exemple, des objets de formes et de styles différents). Framer comprend également un mode « pilote automatique » qui estime automatiquement les points clés et affine les trajectoires, simplifiant ainsi le processus et permettant des résultats naturels et cohérents dans le temps.

Ce travail utilise un modèle de diffusion image-vidéo pré-entraîné à grande échelle (Stable Video Diffusion) comme modèle de base. Il introduit un conditionnement supplémentaire de fin de trame pour faciliter l'interpolation vidéo et intègre une branche de contrôle de trajectoire ponctuelle pour l'interaction de l'utilisateur.

Framer surpasse les méthodes d'interpolation d'images existantes en termes de qualité visuelle et de mouvement naturel, en particulier dans les cas impliquant des mouvements complexes et des changements d'apparence importants. L'évaluation quantitative utilisant FVD (Fréchet Video Distance) démontre des performances supérieures par rapport aux autres méthodes. Les études d'utilisateurs montrent une forte préférence pour les résultats de Framer, soulignant son efficacité à produire des résultats réalistes et visuellement attrayants.

Notez que les vidéos sont compressées spatialement. Nous renvoyons les lecteurs à la page du projet pour les vidéos originales.

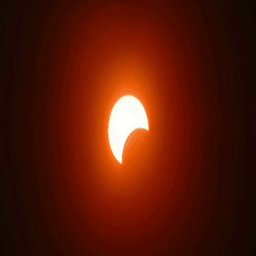

| Image de départ | Trajectoire d’entrée et résultats d’interpolation | Image de fin |

|  |  |

|  |  |

|  |  |

| Image de départ | Trajectoire d’entrée et résultats d’interpolation | Image de fin |

|  |  |

|  |  |

| Image de départ | Résultats d'interpolation | Image de fin |

|  |  |

|  |  |

| Image de départ | Résultats d'interpolation | Image de fin |

|  |  |

|  |  |

| Image de départ | Résultats d'interpolation | Image de fin |

|  |  |

|  |  |

| Image de départ | Résultats d'interpolation | Image de fin |

|  |  |

|  |  |

Veuillez envisager de citer notre article si notre code est utile :

@article { wang2024framer ,

title = { Framer: Interactive Video Interpolation } ,

author = { Wang, Wen and Wang, Qiuyu and Zheng, Kecheng and Ouyang, Hao and Chen, Zhekai and Gong, Biao and Chen, Hao and Shen, Yujun and Shen, Chunhua } ,

journal = { arXiv preprint https://arxiv.org/abs/2410.18978 } ,

year = { 2024 }

}Pour un usage académique, ce projet est sous licence BSD à 2 clauses. Pour un usage commercial, veuillez contacter C Shen.