Télécharger le PDF • À propos • Errata •

"Continuez à apprendre, sinon vous risquez de perdre votre pertinence."

Dans ce premier volume, je présente volontairement un programme de base cohérent, cumulatif et spécifique au contenu du domaine de la science des données, comprenant des sujets tels que la théorie de l'information, les statistiques bayésiennes, la différenciation algorithmique, la régression logistique, les perceptrons et les réseaux de neurones convolutifs. J'espère que vous trouverez ce livre stimulant.

Je suis convaincu que vous, les étudiants de troisième cycle et les demandeurs d'emploi à qui ce livre est principalement destiné, bénéficierez de sa lecture ; cependant, j’espère que même les chercheurs les plus expérimentés trouveront cela fascinant également.

Contacter Émir :

https://www.linkedin.com/in/amirivry/

https://scholar.google.com.mx/citations?user=rQCVwksAAAAJ&hl=iw

Contacter Shlomo :

https://www.linkedin.com/in/quantscientist/

https://scholar.google.com.mx/citations?user=bM0LGgcAAAAJ&hl

Ce livre est disponible à l'achat sur Amazon et d'autres canaux de distribution standard. Veuillez consulter la page Web de l'éditeur pour commander le livre ou pour obtenir plus de détails sur sa publication. Un manuscrit du livre se trouve ci-dessous. Il a été mis à disposition pour un usage personnel uniquement et ne doit pas être vendu.

https://amazon.com/author/quantscientist

https://arxiv.org/abs/2201.00650

@misc{kashani2021deep,

title={Deep Learning Interviews: Hundreds of fully solved job interview questions from a wide range of key topics in AI},

author={Shlomo Kashani and Amir Ivry},

year={2021},

eprint={2201.00650},

note = {ISBN 13: 978-1-9162435-4-5 },

url = {https://www.interviews.ai},

archivePrefix={arXiv},

primaryClass={cs.LG}

}LA VENTE OU L'UTILISATION COMMERCIALE EST STRICTEMENT INTERDITE . Les droits d'utilisation de cette ressource électronique sont spécifiés dans un accord de licence ci-dessous. Vous ne pouvez utiliser cette ressource électronique qu'à des fins d'étude privée . Toute vente/revente de son contenu est strictement interdite.

Ce livre (www.interviews.ai) a été écrit pour vous : un aspirant data scientist avec une formation quantitative, confronté au défi du processus d'entretien dans un domaine de plus en plus compétitif. Pour la plupart d’entre vous, le processus d’entretien constitue l’obstacle le plus important entre vous et l’emploi de vos rêves. Même si vous avez la capacité, l’expérience et la motivation nécessaires pour exceller dans votre poste cible, vous aurez peut-être besoin de conseils sur la façon de mettre le pied dans la porte.

La deuxième édition de Deep Learning Interviews (la couverture souple d'Amazon est imprimée en noir et blanc) abrite des centaines de problèmes entièrement résolus, sur un large éventail de sujets clés de l'IA. Il est conçu à la fois pour répéter des sujets spécifiques aux entretiens ou aux examens et pour fournir un apprentissage automatique en M.Sc./Ph.D. aux étudiants et à ceux en attente d'un entretien un aperçu bien organisé du domaine. Les problèmes que cela pose sont suffisamment difficiles à résoudre et à améliorer considérablement vos compétences, mais ils sont formulés dans des questions stimulantes et des histoires captivantes.

C'est ce qui rend ce volume si particulièrement précieux pour les étudiants et les demandeurs d'emploi : il leur donne la possibilité de s'exprimer avec assurance et rapidité sur n'importe quel sujet pertinent, de répondre clairement et correctement aux questions techniques et de comprendre pleinement le but et la signification des questions d'entretien. et des réponses. Ce sont des avantages puissants et indispensables lorsque vous entrez dans la salle d’entretien.

Le contenu du livre est un large inventaire de nombreux sujets pertinents pour les entretiens d'embauche DL et les examens de niveau supérieur. Cela place ce travail à l’avant-garde de la tendance scientifique croissante à enseigner un ensemble de compétences pratiques en mathématiques et en informatique. Il est largement admis que la formation de chaque informaticien doit inclure les théorèmes fondamentaux du ML, et l’IA apparaît dans le programme d’études de presque toutes les universités. Ce volume est conçu comme une excellente référence pour les diplômés de ces programmes.

Le livre fait près de 400 pages

Des centaines de problèmes entièrement résolus

Problèmes dans de nombreux domaines de l’apprentissage profond

Diagrammes et illustrations clairs

Un index complet

Solutions étape par étape aux problèmes

Pas seulement les réponses données, mais le travail montré

Pas seulement le travail présenté, mais le raisonnement donné le cas échéant

Ce livre a été écrit pour vous : un aspirant data scientist avec une formation quantitative, confronté au défi du processus d'entretien dans un domaine de plus en plus compétitif. Pour la plupart d’entre vous, le processus d’entretien constitue l’obstacle le plus important entre vous et l’emploi de vos rêves. Même si vous avez la capacité, l’expérience et la motivation nécessaires pour exceller dans votre poste cible, vous aurez peut-être besoin de conseils sur la façon de mettre le pied dans la porte. Votre curiosité vous guidera à travers les ensembles de problèmes, les formules et les instructions du livre, et au fur et à mesure de votre progression, vous approfondirez votre compréhension de l'apprentissage profond. Il existe des liens complexes entre le calcul, la régression logistique, l’entropie et la théorie de l’apprentissage profond ; parcourez le livre et ces connexions vous sembleront intuitives.

Le VOLUME-I du livre se concentre sur les perspectives statistiques et allie les principes fondamentaux avec des idées de base et des connaissances pratiques. Il y a des chapitres dédiés sur :

Théorie de l'information

Calcul et différenciation algorithmique

Apprentissage profond bayésien et programmation probabiliste

Régression logistique

Apprentissage d’ensemble

Extraction de fonctionnalités

Deep Learning : chapitre étendu (plus de 100 pages)

Ces chapitres apparaissent aux côtés de nombreux traitements approfondis de sujets en Deep Learning avec des exemples de code en PyTorch, Python et C++.

"PyTorch" est une marque commerciale de Facebook.

Copyright © Shlomo Kashani, auteur du livre "Deep Learning Interviews" Shlomo Kashani, auteur du livre Deep Learning Interviews www.interviews.ai : [email protected]

Merci à tous les lecteurs qui ont signalé ces problèmes. Errata pour la version imprimée du 12/03/2020 et reflété dans la version en ligne :

Le numéro de question PRB-267 -CH.PRB- 8.91 a été supprimé en raison d'un manque de clarté

La question numéro PRB-115 - CH.PRB- 5.16 a été supprimée en raison d'un manque de clarté

Errata pour la version imprimée du 12/05/2020 et reflété dans la version en ligne :

Page 230, numéro de question PRB-178, modifier la « validation croisée startifiée » en « validation croisée stratifiée ».

Page 231, la question numéro PRB-181 a ajouté un « . » après les replis de données

Page 231, question numéro PRB-191, modifier « un » par « un »

Page 234, numéro de question PRB-192 « in » répété deux fois

Page 236, Question numéro PRB-194, modifier « approché » par « approches », « arr » par « arr001 »

Page 247, Question numéro PRB-210, modifier « un » par « un »

Page 258, question numéro PRB-227, modifier « Une métrique de confusion » en « Une matrice de confusion »

Page 271, numéro de question PRB-240, modifier « MaxPool2D(4,4,) » en « MaxPool2D(4,4) »

Page 273, question numéro PRB-243, modifier « identité » par « identifier »

Page 281, question numéro PRB-254, modifier « suggère » par « suggère »

Page 283, numéro de question PRB-256 « se produit » mal orthographié

Page 286, « L1, L2 » modifié en « Normes »

Page 288, Question numéro SOL-184, modifier « le plein » par « est le plein »

Page 298, question numéro SOL-208, modifier « ou1 » en « out »

Page 319, question numéro SOL-240, modifier «torch.Size([1, 32, 222, 222]).» à "torch.size([1, 32, 222, 222])."

Page 283, la question numéro PRB-256 « ce qui se passe » a été mal orthographiée

Errata pour la version imprimée du 12/07/2020 et reflété dans la version en ligne :

Page 187, Question numéro PRB-140, deux tracés manquants (6.3, 6.4) qui ne se sont pas rendus correctement sur la version imprimée

6.3

6.4 Errata pour la version imprimée du 21/09/2020 et reflétée dans la version en ligne :

Page 34, numéro de solution SOL-19 , 0,21886 doit être 0,21305 et 0,21886 ± 1,95 × 0,21886 doit être 0,21305 ± 1,95 × 0,21886

Page 36-7, Numéro de solution SOL-21 , 4,8792/0,0258 = 189,116 et non 57,3 et pi(33) = 0,01748 et non pi(33) = 0,211868 .

Page 49, PRB-47 « Quelle est la probabilité que l'expert soit un singe » devrait être « Quelle est la probabilité que l'expert soit un humain »

Errata pour la version imprimée du 22/09/2020 et reflété dans la version en ligne :

Page 73, le numéro de solution SOL-56 devrait se lire : « Le Hessian est généré en différenciant »

Page 57, le problème numéro PRB-65 devrait lire « deux neurones »

Errata pour la version imprimée du 24/09/2020 et reflété dans la version en ligne :

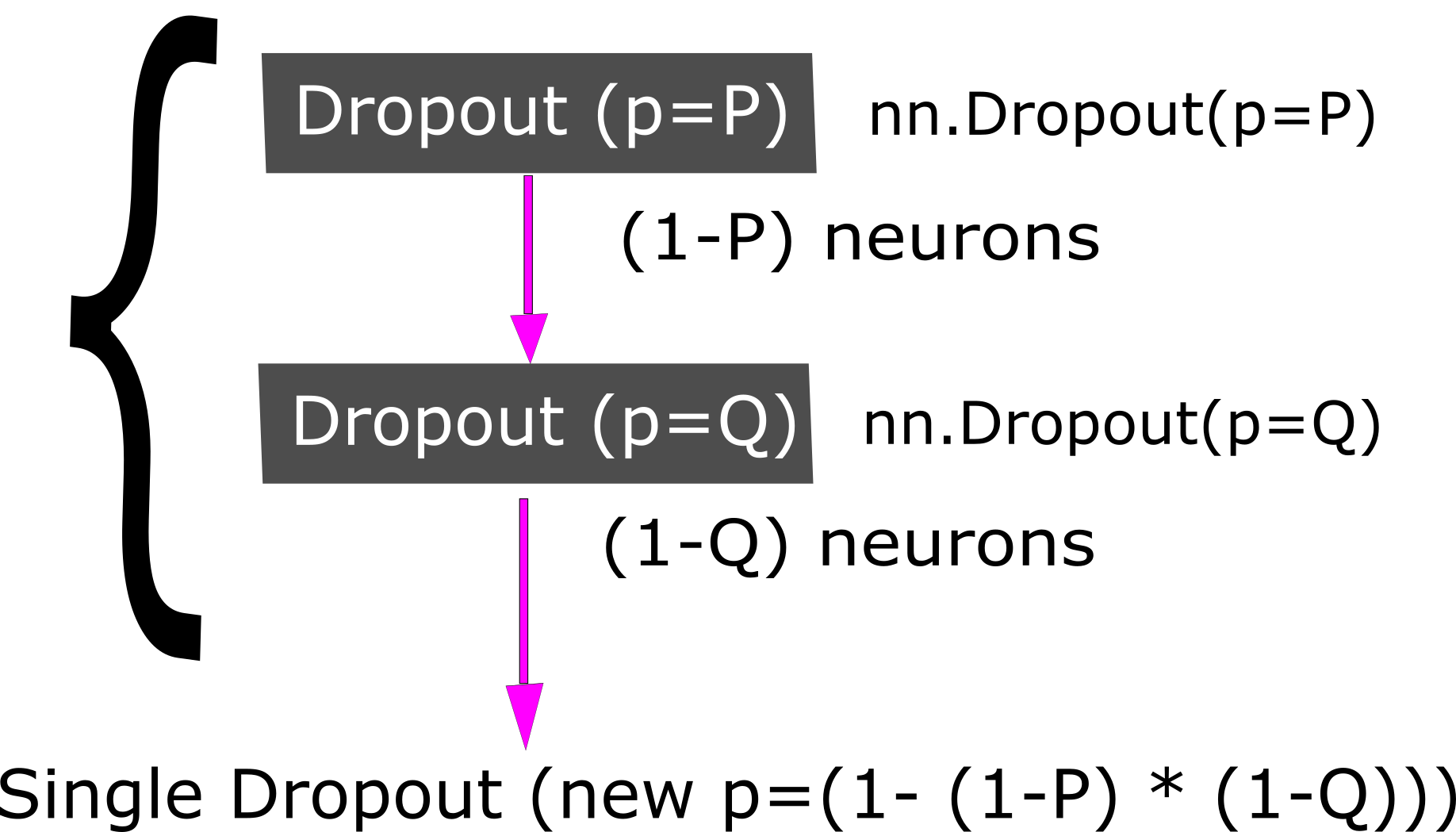

Page 78, numéro de solution SOL-64 , le OnOffLayer est désactivé uniquement si au moins 150 neurones sur 200 sont désactivés. Par conséquent, cela peut être représenté comme une distribution binomiale et la probabilité que la couche soit décalée est :