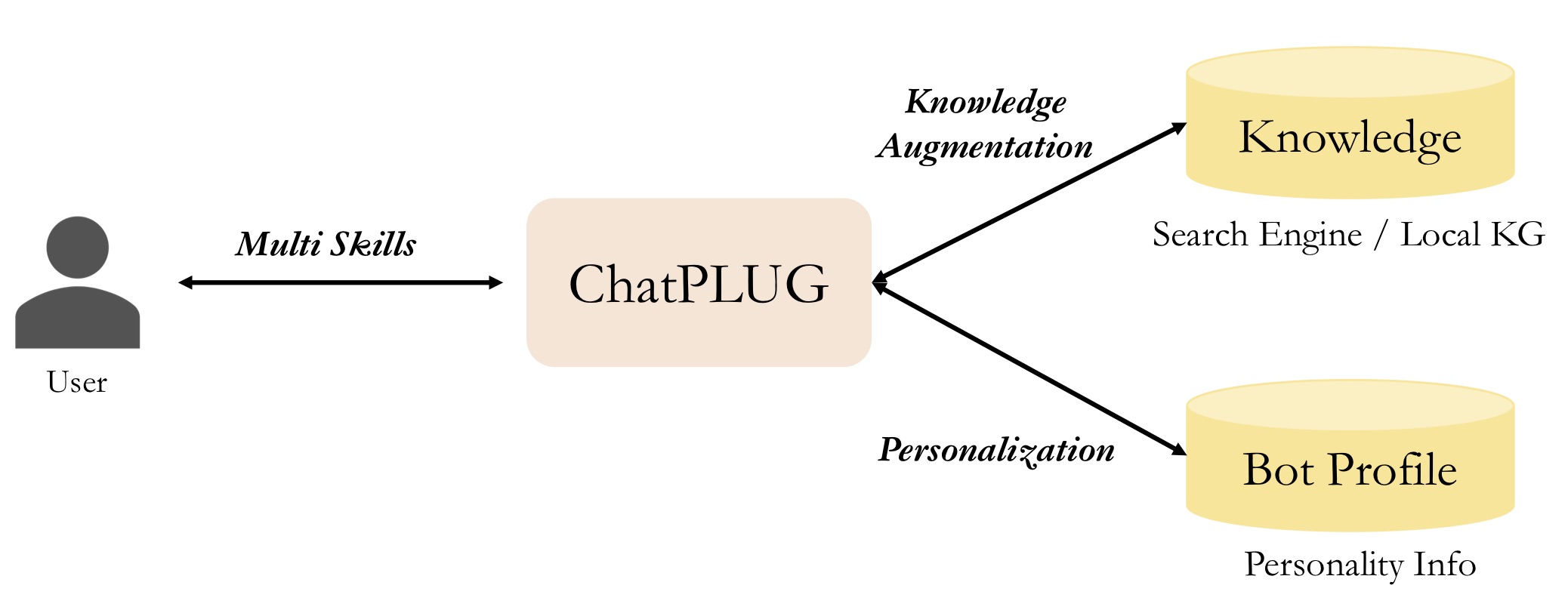

Il s'agit du dépôt du projet ChatPLUG, qui vise à construire et partager un système de dialogue chinois en domaine ouvert.

| 爱用emoji的萌妹子小婉 | 富有智慧的得道高僧 | 会说古文的的三国PNJ关羽 |

|---|---|---|

|  |  |

Jeu de rôle-Chat

Par rapport aux modèles open source existants, nous soulignons trois fonctionnalités de ChatPLUG comme suit :

Il est flexible d'intégrer des connaissances externes lors de l'inférence, et il s'agit d'une entrée facultative. Vous pouvez utiliser un

search enginepour acquérir des informations à jour ou utiliser une base de connaissances locale pour obtenir des connaissances dans le domaine.

Il est facile de personnaliser le style des conversations et des personnages en définissant

bot profilesou en utilisantrole-paly instructions.

Il démontre sa maîtrise du dialogue en domaine ouvert à travers une conversation à plusieurs tours, tout en affichant également

multi-task abilitiesimpressionnantes sur un large éventail de tâches PNL.

Nous proposons trois méthodes pour utiliser ou continuer à développer ChatPLUG comme suit :

| Commencer | Inférence | Former | Déployer | |

|---|---|---|---|---|

| ModèlePortée | Facile | ✔️Cli | Pas prêt | Pas prêt |

| ÉtreindreVisage | Moyen | ✔️Cli | Pas prêt | Pas prêt |

| XDPX | Dur | ✔️Cli | ✔️ Prise en charge | ✔️ Servir |

Vous pouvez télécharger et utiliser les modèles ChatPLUG depuis ModelScope.

| Nom du modèle | URL |

|---|---|

| ChatPLUG-240M | ChatPLUG-开放域对话模型-240M |

| ChatPLUG-3.7B | ChatPLUG-开放域对话模型-3.7B |

À venir.

XDPX est une bibliothèque facile à utiliser qui permet aux chercheurs et aux développeurs de former des modèles personnalisés et de créer leurs propres chatbots de manière rationalisée. Sa fonctionnalité tout-en-un permet une solution unique qui simplifie les processus complexes. démarrage rapide

Lorsque vous utilisez ChatPLUG-3.7B, vous pouvez définir

core_chat_half_precision : truepour économiser de la mémoire.

# Requirement

# in the dir of XDPX

cd XDPX

pip install -e .

# Download checkpoints

# in the same dir as the download.sh

cd ..

sh download.sh

# Inference

# in the dir of XDPX

cd XDPX

CUDA_VISIBLE_DEVICES=0 x-script fidchat_new chat_pipeline/chatplug_3.7B_sftv2.6.0_instruction.hjson

# input `#exit` and exit the terminal Si votre GPU (par exemple A100、A10) prend en charge bf16, définissez

deepspeed_bf16: trueetdeepspeed_fp16: false, sinon définissezdeepspeed_bf16: falseetdeepspeed_fp16: true

# 1. Download dataset from belle

# in ChatPLUG/data/belle dir

cd data/belle

git lfs install

git clone https://huggingface.co/datasets/BelleGroup/train_0.5M_CN

python process_belle_0.5M.py

# $ls data/belle

# train_0.jsonl dev.jsonl ...

# 2. Preprocess Data

# in XDPX dir

x-prepro chat_pipeline/chatplug_prepro_sft_instruction.hjson

# $ls data/dialogue/sft/chatplug/belle_instruction

# train_0.pt dev.pt

# 3. Training

# in XDPX dir

x-train chat_pipeline/chatplug_3.7B_train_sftv2.6.0_instruction.hjsonÀ venir.

Veuillez vous référer à Installation pour les instructions d'installation.

Pour des guides d'utilisation détaillés, veuillez vous référer à notre documentation :

Guides de l'utilisateur

Guides avancés

Si vous trouvez notre projet utile dans votre travail, veuillez citer :

@misc{tian2023chatplug,

title={ChatPLUG: Open-Domain Generative Dialogue System with Internet-Augmented Instruction Tuning for Digital Human},

author={Junfeng Tian and Hehong Chen and Guohai Xu and Ming Yan and Xing Gao and Jianhai Zhang and Chenliang Li and Jiayi Liu and Wenshen Xu and Haiyang Xu and Qi Qian and Wei Wang and Qinghao Ye and Jiejing Zhang and Ji Zhang and Fei Huang and Jingren Zhou},

year={2023},

eprint={2304.07849},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

@misc{plug2021,

title = {{PLUG: Pre-training for Language Understanding and Generation}},

author={ModelScope},

publisher = {ModelScope},

journal = {ModelScope repository},

year = {2021},

howpublished = {url{https://modelscope.cn/models/damo/nlp_plug_text-generation_27B/summary}},

}

Ce code est sous licence Apache (version 2.0).