cloudgrep recherche le stockage cloud.

Il prend actuellement en charge la recherche de fichiers journaux, éventuellement compressés avec gzip (.gz) ou zip (.zip), dans AWS S3, Azure Storage ou Google Cloud Storage.

Exemple simple :

./cloudgrep --bucket test-s3-access-logs --query 9RXXKPREHHTFQD77

python3 cloudgrep.py -b test-s3-access-logs -q 9RXXKPREHHTFQD77

Exemple Azure simple :

python3 cloudgrep.py -an some_account -cn some_container -q my_search

Exemple Google simple :

python3 cloudgrep.py -gb my-gcp-bucket -q my_search

Exemple de journal CloudTrail simple, affichant les résultats au format JSON :

python3 cloudgrep.py -b test-s3-access-logs -q 9RXXKPREHHTFQD77 -lt cloudtrail -jo

Exemple de journal personnalisé simple :

python3 cloudgrep.py -b test-s3-access-logs -q 9RXXKPREHHTFQD77 -lf json -lp Records

Exemple plus compliqué :

python3 cloudgrep.py -b test-s3-access-logs --prefix "logs/" --filename ".log" -q 9RXXKPREHHTFQD77 -s "2023-01-09 20:30:00" -e "2023-01-09 20:45:00" --file_size 10000 --debug

Enregistrer la sortie dans un fichier :

python3 cloudgrep.py -b test-s3-access-logs -q 9RXXKPREHHTFQD77 --hide_filenames > matching_events.log

Exemple de sortie :

[2023-11-30 13:37:12,416] - Bucket is in region: us-east-2 : Search from the same region to avoid egress charges.

[2023-11-30 13:37:12,417] - Searching 11 files in test-s3-access-logs for 9RXXKPREHHTFQD77...

{"key_name": "access2023-01-09-20-34-20-EAC533CB93B4ACBE", "line": "abbd82b5ad5dc5d024cd1841d19c0cf2fd7472c47a1501ececde37fe91adc510 bucket-72561-s3bucketalt-1my9piwesfim7 [09/Jan/2023:19:20:00 +0000] 1.125.222.333 arn:aws:sts::000011110470:assumed-role/bucket-72561-myResponseRole-1WP2IOKDV7B4Y/1673265251.340187 9RXXKPREHHTFQD77 REST.GET.BUCKET - "GET /?list-type=2&prefix=-collector%2Fproject-&start-after=&encoding-type=url HTTP/1.1" 200 - 946 - 33 32 "-" "Boto3/1.21.24 Python/3.9.2 Linux/5.10.0-10-cloud-amd64 Botocore/1.24.46" - aNPuHKw== SigV4 ECDHE-RSA-AES128-GCM-SHA256 AuthHeader bucket-72561-s3bucketalt-1my9piwesfim7.s3.us-east-2.amazonaws.com TLSv1.2 - -"}

usage: cloudgrep.py [-h] [-b BUCKET] [-an ACCOUNT_NAME] [-cn CONTAINER_NAME] [-gb GOOGLE_BUCKET] [-q QUERY]

[-v FILE] [-y YARA] [-p PREFIX] [-f FILENAME] [-s START_DATE] [-e END_DATE]

[-fs FILE_SIZE] [-pr PROFILE] [-d] [-hf] [-lt LOG_TYPE] [-lf LOG_FORMAT]

[-lp LOG_PROPERTIES] [-jo JSON_OUTPUT]

CloudGrep searches is grep for cloud storage like S3 and Azure Storage. Version: 1.0.5

options:

-h, --help show this help message and exit

-b BUCKET, --bucket BUCKET

AWS S3 Bucket to search. E.g. my-bucket

-an ACCOUNT_NAME, --account-name ACCOUNT_NAME

Azure Account Name to Search

-cn CONTAINER_NAME, --container-name CONTAINER_NAME

Azure Container Name to Search

-gb GOOGLE_BUCKET, --google-bucket GOOGLE_BUCKET

Google Cloud Bucket to Search

-q QUERY, --query QUERY

Text to search for. Will be parsed as a Regex. E.g. example.com

-v FILE, --file FILE File containing a list of words or regular expressions to search for. One per line.

-y YARA, --yara YARA File containing Yara rules to scan files.

-p PREFIX, --prefix PREFIX

Optionally filter on the start of the Object name. E.g. logs/

-f FILENAME, --filename FILENAME

Optionally filter on Objects that match a keyword. E.g. .log.gz

-s START_DATE, --start_date START_DATE

Optionally filter on Objects modified after a Date or Time. E.g. 2022-01-01

-e END_DATE, --end_date END_DATE

Optionally filter on Objects modified before a Date or Time. E.g. 2022-01-01

-fs FILE_SIZE, --file_size FILE_SIZE

Optionally filter on Objects smaller than a file size, in bytes. Defaults to 100 Mb.

-pr PROFILE, --profile PROFILE

Set an AWS profile to use. E.g. default, dev, prod.

-d, --debug Enable Debug logging.

-hf, --hide_filenames

Dont show matching filenames.

-lt LOG_TYPE, --log_type LOG_TYPE

Return individual matching log entries based on pre-defined log types, otherwise

custom log_format and log_properties can be used. E.g. cloudtrail.

-lf LOG_FORMAT, --log_format LOG_FORMAT

Define custom log format of raw file to parse before applying search logic. Used if

--log_type is not defined. E.g. json.

-lp LOG_PROPERTIES, --log_properties LOG_PROPERTIES

Define custom list of properties to traverse to dynamically extract final list of log

records. Used if --log_type is not defined. E.g. [Records].

-jo JSON_OUTPUT, --json_output JSON_OUTPUT

Output as JSON.

Installez avec : pip3 install -r requirements.txt Ou téléchargez la dernière version compilée ici

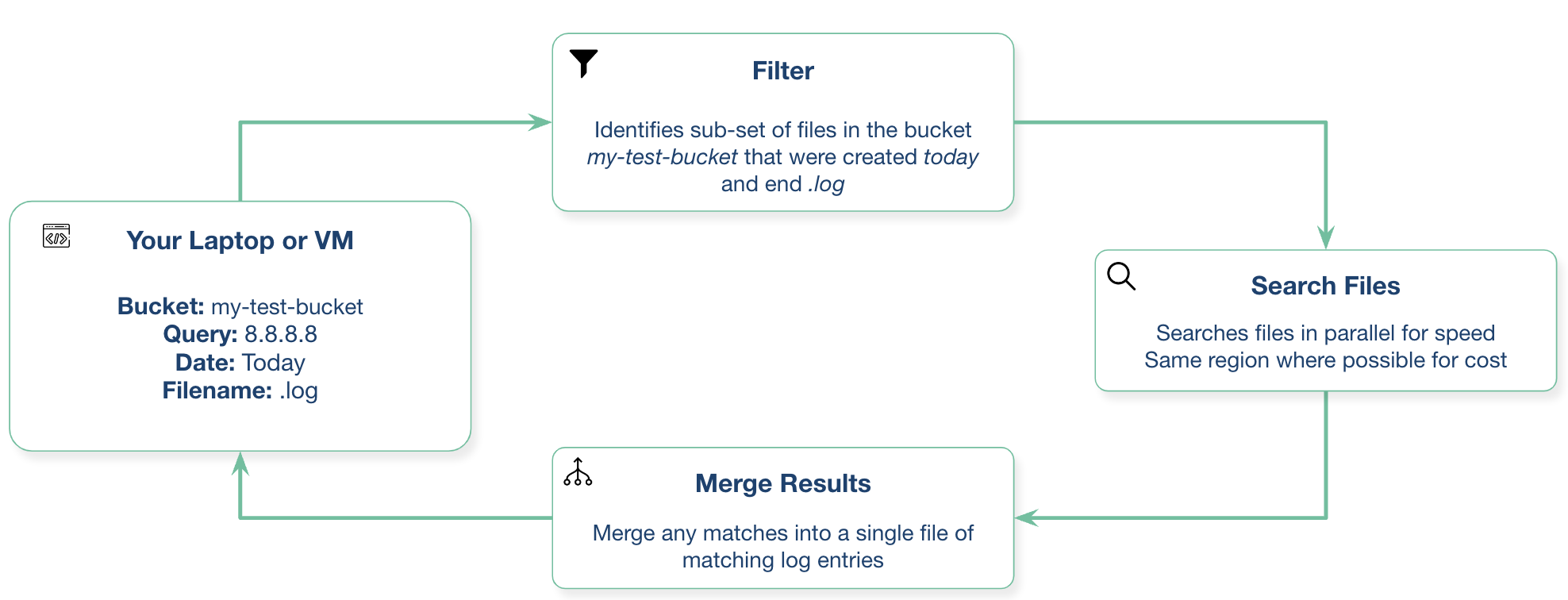

Vous pouvez l'exécuter à partir de votre ordinateur portable local ou à partir d'une machine virtuelle de votre fournisseur de cloud.

Cela nécessite python3.10 ou version ultérieure

Construire avec : docker build -t cloudgrep .

Exécuter avec : docker run --rm -ti cloudgrep

Pour transmettre des variables d'environnement, par exemple pour AWS : docker run --rm --env-file <(env|grep AWS) -ti cloudgrep

Votre système devra accéder au compartiment S3. Par exemple, si vous utilisez votre ordinateur portable, vous devrez configurer l'AWS CLI. Si vous utilisez un EC2, un profil d'instance est probablement le meilleur choix.

Si vous exécutez sur une instance EC2 dans la même région que le compartiment S3 avec un point de terminaison VPC pour S3, vous pouvez éviter les frais de sortie. Vous pouvez vous authentifier de plusieurs manières.

Le moyen le plus simple de s’authentifier auprès d’Azure consiste à exécuter d’abord :

az login

Cela ouvrira une fenêtre de navigateur et vous invitera à vous connecter à Azure.

Vous devrez créer un compte de service et télécharger le fichier d'informations d'identification puis définir avec :

export GOOGLE_APPLICATION_CREDENTIALS="/Users/creds.json"

Nous apprécions toute contribution à ce projet ! Veuillez ajouter via une Pull Request.

Les travaux futurs possibles pourraient inclure :

Veuillez ouvrir un problème GitHub si vous avez des questions ou des suggestions. Il ne s'agit pas d'un produit Cado Security officiellement pris en charge.