Chinois | Anglais

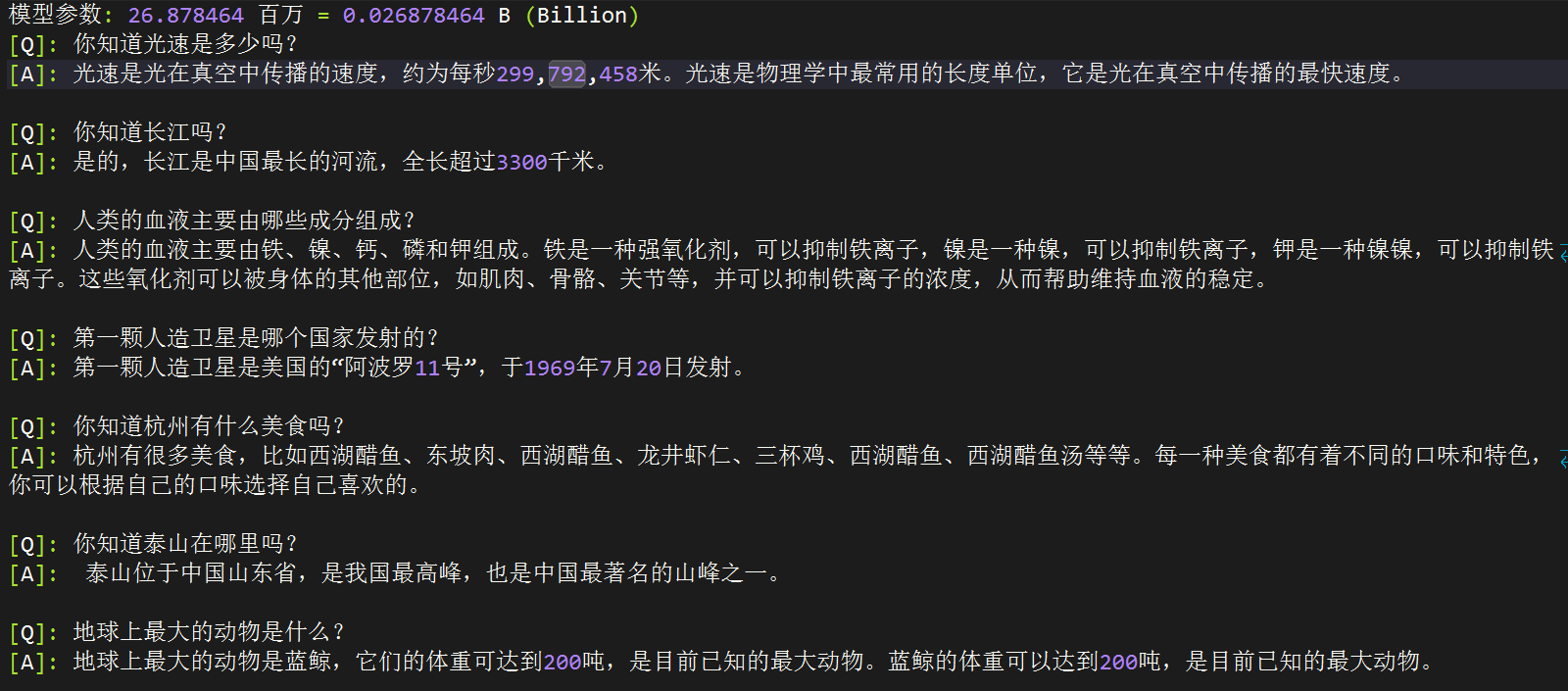

Ce projet open source vise à repartir de zéro, en aussi peu que 3 heures ! Vous pouvez entraîner MiniMind, un modèle de langage miniature d'une taille de seulement 26,88 M.

MiniMind est extrêmement léger et la plus petite version a à peu près la taille de GPT3

MiniMind a publié une structure minimaliste de grand modèle, un nettoyage et un prétraitement des ensembles de données, un pré-entraînement supervisé (Pretrain), un réglage fin des instructions supervisées (SFT), un réglage fin adaptatif de bas rang (LoRA) et un apprentissage par renforcement sans récompense, un alignement direct des préférences ( DPO) Le code complet comprend également l'expansion du modèle clairsemé d'experts hybrides partagés (MoE) ; l'expansion du VLM multimodal visuel : MiniMind-V ;

Il ne s'agit pas seulement d'une implémentation d'un modèle open source, mais également d'un tutoriel pour démarrer avec les grands modèles de langage (LLM).

Nous espérons que ce projet pourra fournir aux chercheurs un exemple d'introduction pour aider tout le monde à démarrer rapidement et à générer davantage d'exploration et d'innovation dans le domaine du LLM.

Pour éviter tout malentendu, « jusqu'à 3 heures » signifie que vous avez besoin d'une machine avec ma propre configuration matérielle. Les détails des spécifications spécifiques seront fournis ci-dessous.

Test en ligne ModelScope | Lien vidéo Bilibili

Dans le domaine des grands modèles de langage (LLM), tels que GPT, LLaMA, GLM, etc., bien que leurs effets soient étonnants, les énormes paramètres de modèle de 10 milliards et la mémoire des appareils personnels sont loin d'être suffisants pour la formation, et même l’inférence est difficile. Presque tout le monde ne se contente pas de peaufiner de grands modèles à l'aide de programmes tels que Lora pour apprendre de nouvelles instructions. Cela revient à peu près à apprendre à Newton à jouer avec un smartphone du 21e siècle. Cependant, cela est loin d'apprendre les mystères de l'informatique. la physique elle-même. De plus, les comptes marketing vendant des cours par abonnement payant regorgent de failles et de tutoriels expliquant l'IA avec seulement des connaissances partielles, ce qui rend encore plus difficile la compréhension du contenu de haute qualité du LLM et gêne sérieusement les apprenants.

Par conséquent, l'objectif de ce projet est d'abaisser infiniment le seuil pour démarrer avec LLM et former un modèle de langage extrêmement léger directement à partir de zéro.

Conseil

(Au 17/09/2024) La série MiniMind a terminé la pré-formation de 3 modèles de modèles. Le minimum requis est de seulement 26 M (0,02 B) pour avoir des capacités de conversation fluides !

| Modèle (taille) | longueur du tokeniseur | raisonnement occupation | libérer | Note subjective (/100) |

|---|---|---|---|---|

| minimind-v1-petit (26M) | 6400 | 0,5 Go | 2024.08.28 | 50' |

| minimind-v1-moe (4×26M) | 6400 | 1,0 Go | 2024.09.17 | 55' |

| minimind-v1 (108M) | 6400 | 1,0 Go | 2024.09.01 | 60' |

L'analyse a été réalisée sur un GPU 2 × RTX 3090 avec Torch 2.1.2, CUDA 12.2 et Flash Attention 2.

Le projet comprend :

transformers , accelerate , trl , peft , etc.J'espère que ce projet open source pourra aider les débutants en LLM à démarrer rapidement !

Étend les capacités multimodales de MiniMind - vision

Accédez au projet jumeau minimind-v pour voir les détails !

09-27 Mise à jour de la méthode de prétraitement de l'ensemble de données de pré-entraînement Afin de garantir l'intégrité du texte, le prétraitement a été abandonné et converti en formation .bin (sacrifiant légèrement la vitesse de formation).

Le fichier actuel après le traitement de pré-entraînement est nommé : pretrain_data.csv.

Suppression d'un code redondant.

Mettre à jour le modèle minimind-v1-moe

Afin d'éviter toute ambiguïté, mistral_tokenizer n'est plus utilisé comme segmentation de mots et tous les minimind_tokenizer personnalisés sont utilisés comme segmentation de mots.

Modèle minimind-v1 (108M) mis à jour, utilisant minimind_tokenizer, tours de pré-entraînement 3 + tours SFT 10, entraînement plus complet et performances plus fortes.

Le projet a été déployé sur l'espace de création ModelScope et peut être expérimenté sur ce site :

?Expérience en ligne ModelScope ?

Il s'agit simplement de ma configuration personnelle d'environnement logiciel et matériel, veuillez la modifier à votre propre discrétion :

CPU: Intel(R) Core(TM) i9-10980XE CPU @ 3.00GHz

内存:128 GB

显卡:NVIDIA GeForce RTX 3090(24GB) * 2

环境:python 3.9 + Torch 2.1.2 + DDP单机多卡训练MiniMind (HuggingFace)

MiniMind (ModèleScope)

# step 1

git clone https://huggingface.co/jingyaogong/minimind-v1 # step 2

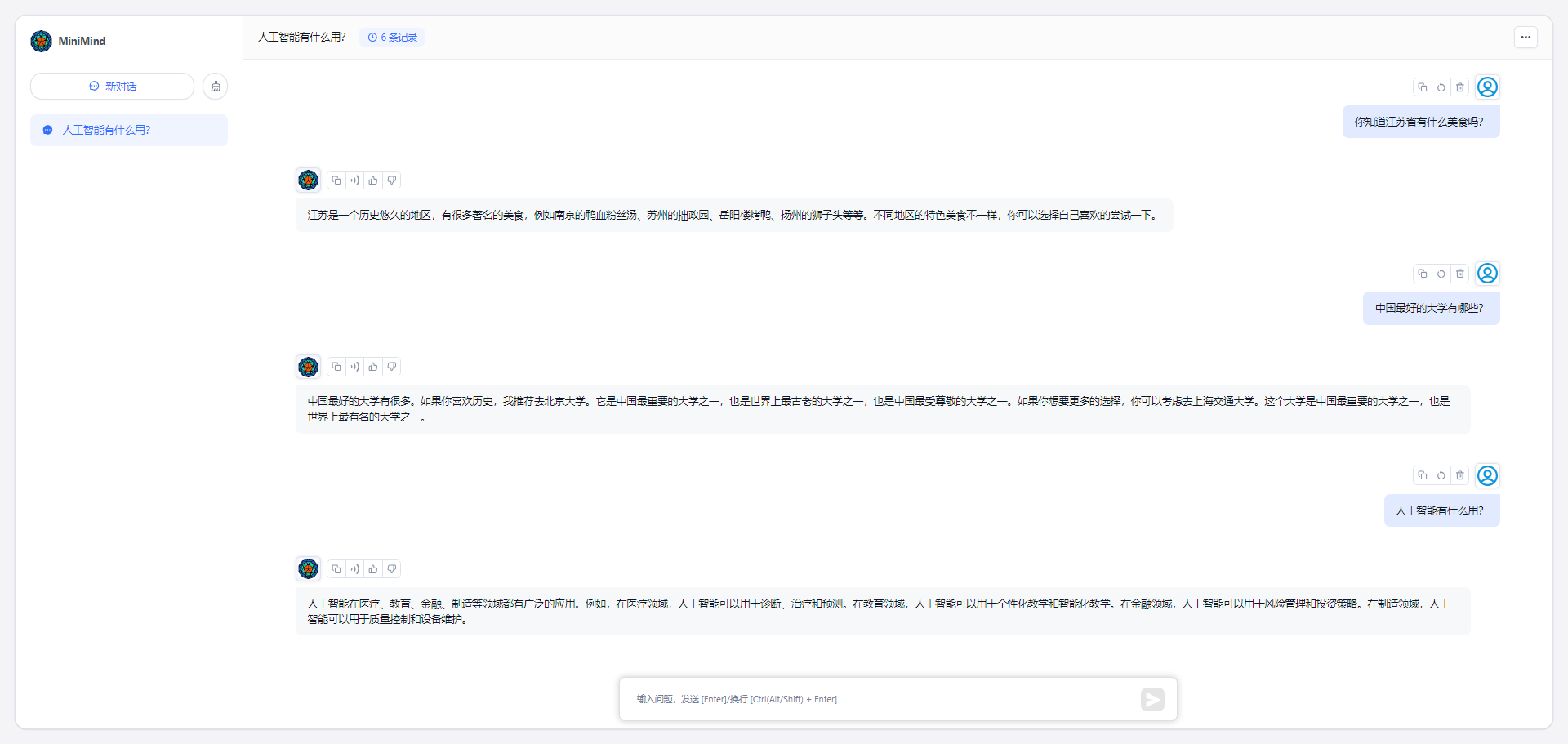

python 2-eval.pyOu démarrez Streamlit et démarrez l'interface de chat Web

"Remarque" nécessite python>=3.10, installez

pip install streamlit==1.27.2

# or step 3, use streamlit

streamlit run fast_inference.py0. Cloner le code du projet

git clone https://github.com/jingyaogong/minimind.git

cd minimind1. Installation de l'environnement

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple # 测试torch是否可用cuda

import torch

print(torch.cuda.is_available())

S'il n'est pas disponible, veuillez vous rendre sur torch_stable pour télécharger le fichier whl et l'installer vous-même. Lien de référence

2. Si vous avez besoin de vous former

2.1 Téléchargez l'adresse de téléchargement de l'ensemble de données et placez-la dans ./dataset .

2.2 python data_process.py traite les ensembles de données Par exemple, les données de pré-entraînement sont codées à l'avance par jetons et les ensembles de données sft sont extraits des fichiers qa vers csv.

2.3 Ajuster la configuration des paramètres du modèle dans ./model/LMConfig.py

Ici, il vous suffit d'ajuster les paramètres dim, n_layers et use_moe, qui sont respectivement

(512+8)ou(768+16), correspondant àminimind-v1-smalletminimind-v1

2.4 python 1-pretrain.py effectue un pré-entraînement et obtient pretrain_*.pth comme poids de sortie du pré-entraînement

2.5 python 3-full_sft.py exécute le réglage fin des instructions et obtient full_sft_*.pth comme poids de sortie du réglage fin des instructions

2.6 python 4-lora_sft.py effectue un réglage fin de Lora (non requis)

2.7 python 5-dpo_train.py effectue l'alignement de l'apprentissage par renforcement des préférences humaines DPO (facultatif)

3. Testez l'effet de raisonnement du modèle

*.pth qui doivent être utilisés et terminés la formation se trouvent dans le répertoire ./out/ .*.pth entraîné. minimind/out

├── multi_chat

│ ├── full_sft_512.pth

│ ├── full_sft_512_moe.pth

│ └── full_sft_768.pth

├── single_chat

│ ├── full_sft_512.pth

│ ├── full_sft_512_moe.pth

│ └── full_sft_768.pth

├── pretrain_768.pth

├── pretrain_512_moe.pth

├── pretrain_512.pth

python 0-eval_pretrain.py teste l'effet solitaire du modèle pré-entraînépython 2-eval.py teste l'effet de dialogue du modèle

Le pré-entraînement ?" Astuce » et le pré-entraînement de réglage fin des paramètres complets et full_sft prennent tous deux en charge l'accélération multi-cartes

En supposant que votre appareil ne dispose que d'une seule carte graphique, utilisez simplement Python natif pour démarrer l'entraînement :

python 1-pretrain.py

# and

python 3-full_sft.pySupposons que votre appareil dispose de N (N>1) cartes graphiques :

Formation de démarrage de carte N autonome (DDP)

torchrun --nproc_per_node N 1-pretrain.py

# and

torchrun --nproc_per_node N 3-full_sft.pyFormation de démarrage de la carte N autonome (DeepSpeed)

deepspeed --master_port 29500 --num_gpus=N 1-pretrain.py

# and

deepspeed --master_port 29500 --num_gpus=N 3-full_sft.pyActiver wandb pour enregistrer le processus de formation (facultatif)

torchrun --nproc_per_node N 1-pretrain.py --use_wandb

# and

python 1-pretrain.py --use_wandb En ajoutant le paramètre --use_wandb , le processus de formation peut être enregistré une fois la formation terminée, le processus de formation peut être consulté sur le site Web de wandb. En modifiant wandb_project et wandb_run_name , vous pouvez spécifier le nom du projet et le nom de l'exécution.

? Tokenizer : Le Tokenizer en NLP est similaire à un dictionnaire. Il mappe les mots du langage naturel avec des nombres tels que 0, 1 et 36 via le « dictionnaire ». le « dictionnaire ». Il existe deux façons de créer un tokenizer LLM : l'une consiste à construire vous-même une liste de mots pour entraîner un tokenizer, le code peut être trouvé train_tokenizer.py ; l'autre consiste à sélectionner un tokenizer entraîné par un modèle open source. Bien sûr, vous pouvez directement choisir le dictionnaire Xinhua ou Oxford Dictionary pour « dictionnaire ». L'avantage est que le taux de compression de conversion des jetons est très bon, mais l'inconvénient est que la liste de vocabulaire est trop longue, avec des centaines de milliers d'expressions de vocabulaire. Vous pouvez également utiliser votre propre segmenteur de mots formé. L'avantage est que la liste de mots peut être contrôlée à volonté. L'inconvénient est que le taux de compression n'est pas assez idéal et qu'il n'est pas facile de couvrir tous les mots rares. Bien entendu, le choix du « dictionnaire » est important. Le résultat de LLM est essentiellement un problème de multi-classification de N mots de SoftMax vers le dictionnaire, puis décodé en langage naturel via le « dictionnaire ». Étant donné que le LLM est très petit, afin d'éviter que le modèle ne soit trop lourd (le rapport entre les paramètres de la couche d'incorporation de mots et l'ensemble du LLM est trop élevé), la longueur du vocabulaire doit être choisie pour être relativement petite. De puissants modèles open source tels que 01 Wanwu, Qianwen, chatglm, mistral, Llama3, etc. ont les longueurs de vocabulaire tokenizer suivantes :

| Modèle de tokeniseur | Taille du vocabulaire | source |

|---|---|---|

| yi tokeniseur | 64 000 | 01 Tout (Chine) |

| générateur de jetons qwen2 | 151 643 | Alibaba Cloud (Chine) |

| tokeniseur glm | 151 329 | Wisdom AI (Chine) |

| tokeniseur mistral | 32 000 | Mistral IA (France) |

| tokeniseur lama3 | 128 000 | Méta (États-Unis) |

| tokeniseur minimind | 6 400 | Personnaliser |

Mise à jour 2024-09-17 : Afin d'éviter toute ambiguïté et de contrôler le volume dans les versions précédentes, tous les modèles minimind utilisent la segmentation de mots minimind_tokenizer et toutes les versions de mistral_tokenizer sont abandonnées.

Bien que la longueur de minimind_tokenizer soit très petite, l'efficacité d'encodage et de décodage est plus faible que celle des tokenizers chinois tels que qwen2 et glm. Cependant, le modèle minimind a choisi son propre minimind_tokenizer formé comme segmenteur de mots pour garder les paramètres globaux légers et éviter un déséquilibre dans la proportion de la couche de codage et de la couche de calcul, qui est très lourde, car la taille du vocabulaire du minimind est seulement 6400. De plus, minimind n’a pas manqué de décoder des mots rares lors de tests réels, et les résultats sont bons. Étant donné que la liste de mots personnalisée est compressée à 6 400 mots, la taille totale des paramètres de LLM est aussi faible que 26 Mo.

?[Données de pré-entraînement] : l'ensemble de données de texte universel Seq-Monkey/le disque réseau Seq-Monkey Baidu est compilé et nettoyé à partir d'une variété de données de source publique (telles que des pages Web, des encyclopédies, des blogs, des codes open source, des livres, etc.) . Il est organisé dans un format JSONL unifié et a fait l'objet d'un filtrage et d'une déduplication stricts pour garantir l'exhaustivité, l'échelle, la crédibilité et la haute qualité des données. Le montant total est d'environ 10 milliards de jetons, ce qui convient à la pré-formation de grands modèles de langue chinoise.

Option 2 : La partie accessible au public de l'ensemble de données SkyPile-150B contient environ 233 millions de pages Web uniques, chacune contenant en moyenne plus de 1 000 caractères chinois. L'ensemble de données comprend environ 150 milliards de jetons et 620 Go de données en texte brut. Si vous êtes pressé , vous pouvez essayer de sélectionner uniquement une partie du téléchargement jsonl de SkyPile-150B (et générer un fichier *.csv pour le tokenizer de texte dans ./data_process.py) pour exécuter rapidement le processus de pré-formation. .

Télécharger dans ./dataset/

| Ensemble de données d'entraînement MiniMind | Adresse de téléchargement |

|---|---|

| [ensemble de formation tokenizer] | HuggingFace / Baidu Netdisk |

| 【Données de pré-entraînement】 | Officiel Seq-Monkey/Disque réseau Baidu/HuggingFace |

| 【Données SFT】 | Ensemble de données SFT grand modèle de Jiangshu |

| 【Données DPO】 | Visage câlin |

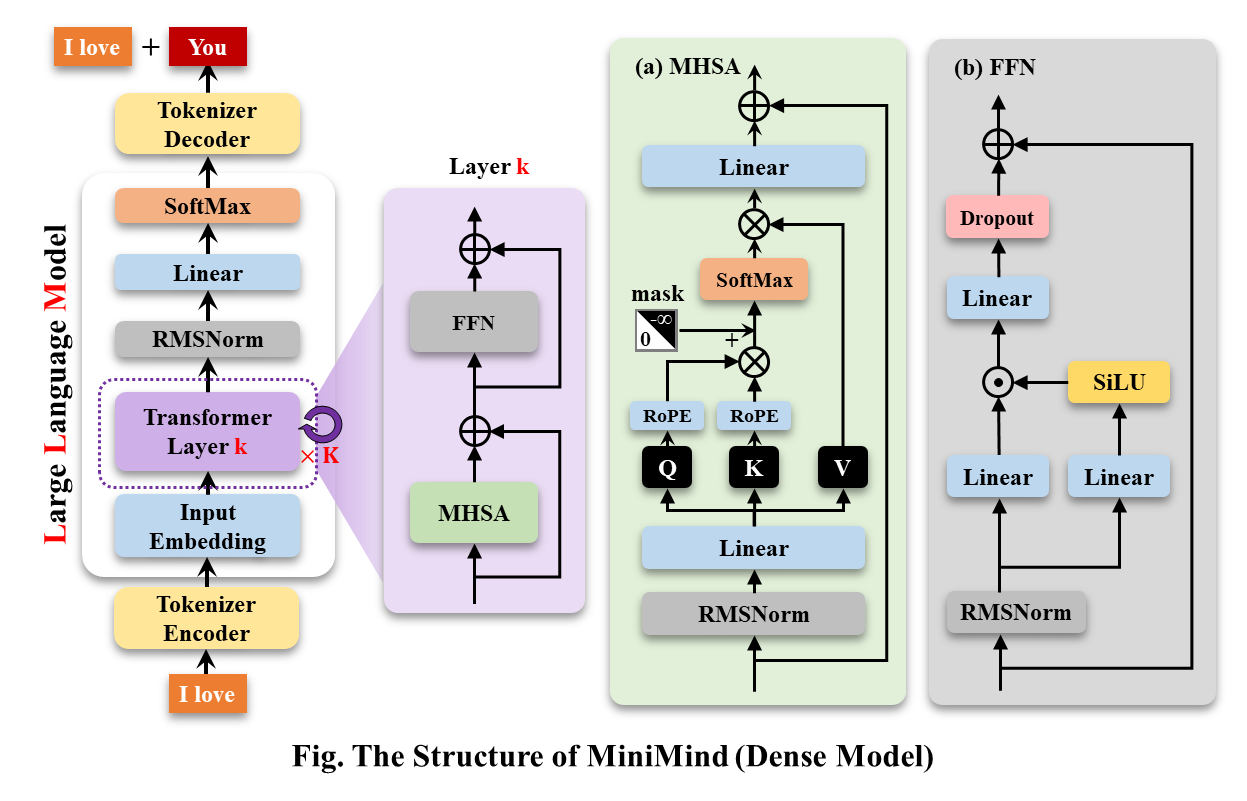

MiniMind-Dense (identique à Llama3.1) utilise la structure Decoder-Only de Transformer. La différence avec GPT-3 est :

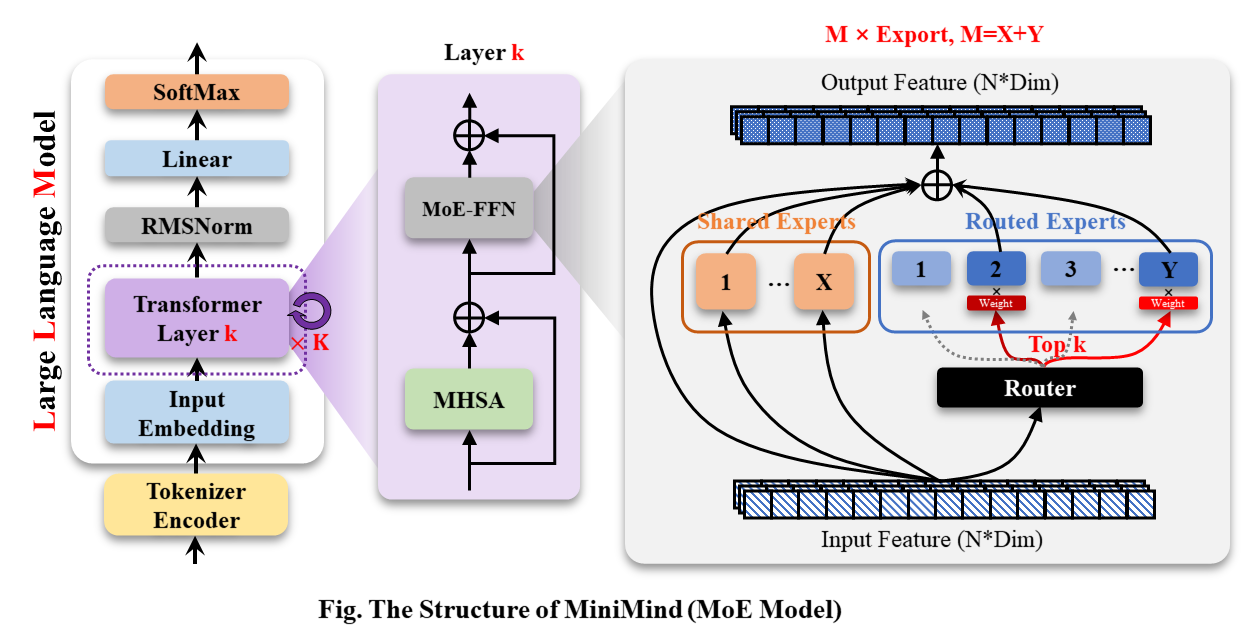

Modèle MiniMind-MoE, sa structure est basée sur Llama3 et le module expert hybride MixFFN dans Deepseek-V2.

La structure globale de MiniMind est la même, à l'exception de quelques ajustements mineurs dans le code de calcul RoPE, la fonction d'inférence et la couche FFN. Sa structure est la suivante (version redessinée) :

Pour modifier la configuration du modèle, consultez ./model/LMConfig.py. Les versions de modèles actuellement entraînées par minimind sont présentées dans le tableau ci-dessous :

| Nom du modèle | paramètres | len_vocab | n_couches | d_modèle | kv_heads | q_heads | partager+itinéraire | TopK |

|---|---|---|---|---|---|---|---|---|

| minimind-v1-petit | 26M | 6400 | 8 | 512 | 8 | 16 | - | - |

| minimind-v1-moe | 4×26M | 6400 | 8 | 512 | 8 | 16 | 2+4 | 2 |

| minimind-v1 | 108M | 6400 | 16 | 768 | 8 | 16 | - | - |

| Nom du modèle | paramètres | len_vocab | taille_lot | prétrain_time | sft_single_time | sft_multi_time |

|---|---|---|---|---|---|---|

| minimind-v1-petit | 26M | 6400 | 64 | ≈2 heures (1 époque) | ≈2 heures (1 époque) | ≈0,5 heure (1 époque) |

| minimind-v1-moe | 4×26M | 6400 | 40 | ≈6 heures (1 époque) | ≈5 heures (1 époque) | ≈1 heure (1 époque) |

| minimind-v1 | 108M | 6400 | 16 | ≈6 heures (1 époque) | ≈4 heures (1 époque) | ≈1 heure (1 époque) |

Pré-formation (Text-to-Text) :

Le taux d'apprentissage du pré-entraînement est fixé à un taux d'apprentissage dynamique de 1e-4 à 1e-5, et le nombre d'époques de pré-entraînement est fixé à 5.

torchrun --nproc_per_node 2 1-pretrain.pyDialogue unique Mise au point :

En ajustant la différence linéaire RoPE pendant l'inférence, il est pratique d'extrapoler la longueur à 1 024 ou 2 048 et plus. Le taux d'apprentissage est défini sur un taux d'apprentissage dynamique de 1e-5 à 1e-6, et le nombre d'époques de réglage fin est de 6.

# 3-full_sft.py中设置数据集为sft_data_single.csv

torchrun --nproc_per_node 2 3-full_sft.pyMise au point multi-dialogue :

Le taux d'apprentissage est défini sur un taux d'apprentissage dynamique de 1e-5 à 1e-6, et le nombre d'époques de réglage fin est de 5.

# 3-full_sft.py中设置数据集为sft_data.csv

torchrun --nproc_per_node 2 3-full_sft.pyApprentissage par renforcement du feedback humain (RLHF) - Optimisation des préférences directes (DPO) :

Ensemble de données triplet de type mobile (q, choisir, rejeter), taux d'apprentissage le-5, demi-précision fp16, un total de 1 époque et prend 1 heure.

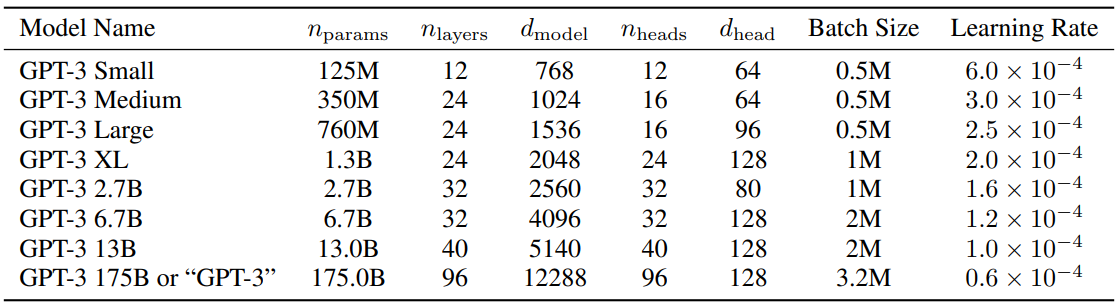

python 5-dpo_train.py ? Concernant la configuration des paramètres de LLM, il existe un article très intéressant MobileLLM qui fait des recherches et des expériences détaillées. La loi de mise à l'échelle a ses propres règles uniques dans les petits modèles. Les paramètres qui entraînent la mise à l'échelle des paramètres du Transformer dépendent presque exclusivement de d_model et n_layers .

d_model ↑+ n_layers ↓->Humpty Dumptyd_model ↓+ n_layers ↑->mince et grand L'article proposant la loi de mise à l'échelle en 2020 estime que la quantité de données d'entraînement, la quantité de paramètres et le nombre d'itérations d'entraînement sont les facteurs clés qui déterminent les performances, et que l'impact de l'architecture du modèle peut presque être ignoré. Il semble toutefois que cette loi ne s’applique pas pleinement aux petits modèles. MobileLLM propose que la profondeur de l'architecture est plus importante que la largeur. Le modèle « élancé » « profond et étroit » peut apprendre des concepts plus abstraits que le modèle « large et peu profond ». Par exemple, lorsque les paramètres du modèle sont fixés à 125M ou 350M, le modèle « étroit » avec 30 à 42 couches a des performances nettement meilleures que le modèle « court et gros » avec environ 12 couches, dans 8 tests de référence tels que le raisonnement de bon sens. , questions et réponses et compréhension écrite. Il existe des tendances similaires. Il s’agit en fait d’une découverte très intéressante, car dans le passé, lors de la conception d’architectures pour des petits modèles d’environ 100 Mo, presque personne n’avait essayé d’empiler plus de 12 couches. Ceci est cohérent avec l'effet observé expérimentalement de MiniMind ajustant les paramètres du modèle entre d_model et n_layers pendant le processus de formation. Cependant, le "étroit" de "profond et étroit" a également une limite de dimension. Lorsque d_model<512, l'inconvénient de l'effondrement de la dimensionnalité de l'intégration de mots est très évident. Les couches ajoutées ne peuvent pas compenser l'inconvénient d'un d_head insuffisant causé par l'intégration de mots. dans q_head fixe. Lorsque d_model>1536, l'augmentation des couches semble avoir une priorité plus élevée que d_model, et peut apporter des paramètres plus "rentables" -> gain d'effet. Par conséquent, MiniMind définit d_model=512 et n_layers=8 du petit modèle pour obtenir l'équilibre « très petit volume <-> meilleur effet ». Définissez d_model=768, n_layers=16 pour obtenir de plus grands avantages de l'effet, qui est plus conforme à la courbe changeante de la loi d'échelle des petits modèles.

Pour référence, les réglages des paramètres de GPT3 sont indiqués dans le tableau ci-dessous :

?BaiduNetdisk

| Nom du modèle | paramètres | Configuration | prétrain_model | modèle_sft_single | multi_sft_model | rl_model |

|---|---|---|---|---|---|---|

| minimind-v1-petit | 26M | d_modèle=512 n_couches=8 | pretrain_512.pth | single_chat/full_sft_512.pth | multi_chat/full_sft_512.pth | rl_512.pth |

| minimind-v1-moe | 4×26M | d_modèle=512 n_couches=8 | pretrain_512_moe.pth | single_chat/full_sft_512_moe.pth | multi_chat/full_sft_512_moe.pth | - |

| minimind-v1 | 108M | d_modèle=768 n_couches=16 | pretrain_768.pth | single_chat/full_sft_768.pth | multi_chat/full_sft_768.pth | rl_768.pth |

Conseil

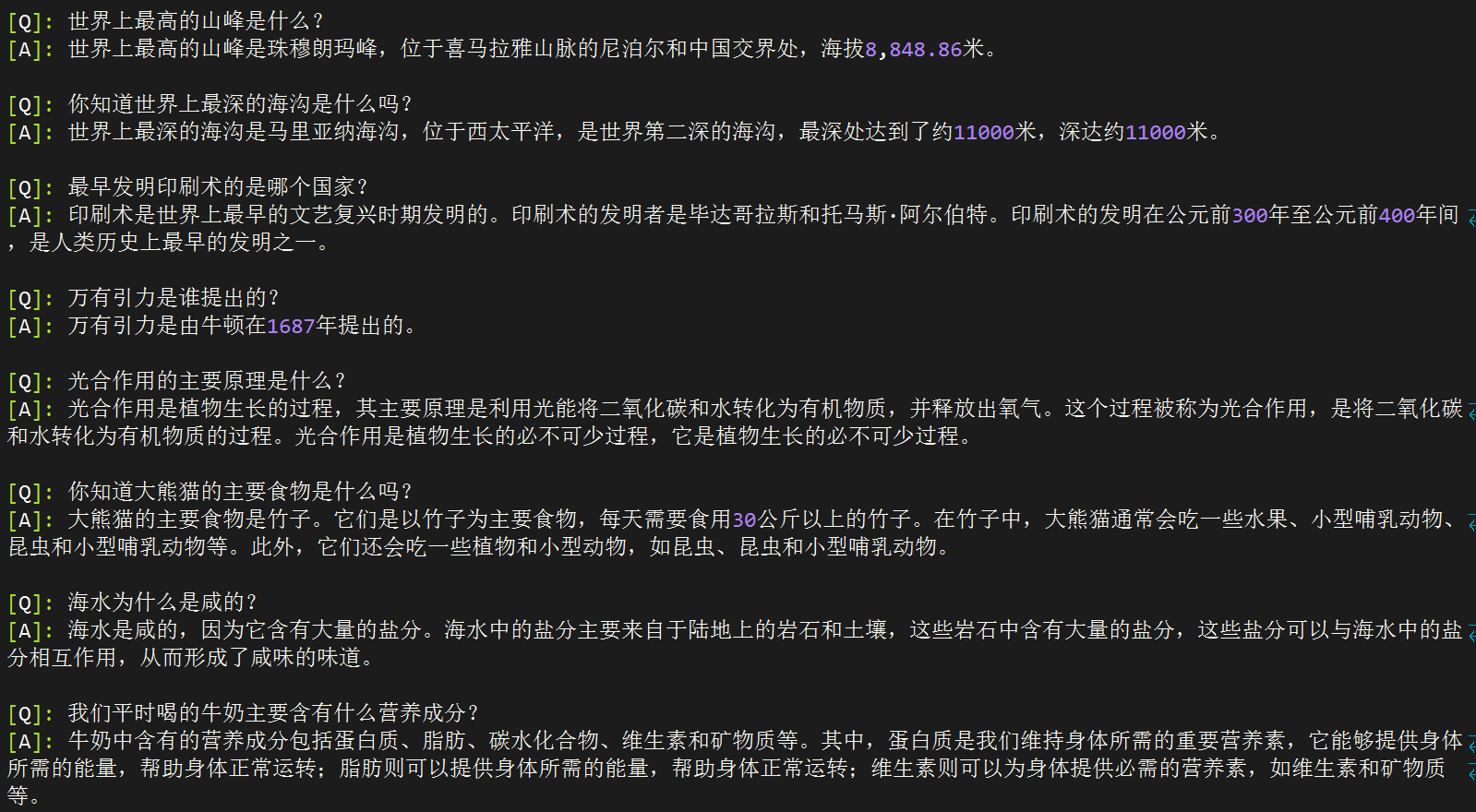

Testez la comparaison du modèle minimind basée sur le « dialogue à un seul tour full_sft » et « l'alignement de l'apprentissage par renforcement DPO ».

Fichier modèle Baidu Netdisk, où rl_<dim>.pth est le poids du modèle minimind après « alignement d'apprentissage par renforcement DPO ».

[Q]: 你叫什么名字?

[ft_768]: 我是一款人工智能语言模型,可以回答您的问题和提供帮助。您有什么需要我帮忙的吗?

[rl_768]: 我是一款基于人工智能技术的自然语言处理系统,主要用于处理和生成人类语言的任务。我可以帮助用户进行文本处理、语音识别、文本生成等任务,同时也可以帮助用户进行智能聊天、翻译、翻译等多种应用。如果您需要更多关于该项目的信息,请告诉我。

[ft_512]: 我很高兴能够帮助你。你有什么其他问题需要我帮忙解答吗?

[rl_512]: 我是一款基于自然语言处理技术的聊天机器人,能够理解和回复用户的问题和指令,并进行相应的回复和回复。我被训练为能够与人类进行交互和回答各种问题和任务。请问有什么需要吗?

[Q]: 你是谁?

[ft_768]: 我是一个人工智能语言模型,没有个人身份和身份。我只是根据输入的指令和文本信息生成响应。

[rl_768]: 我是一个计算机程序,没有个人身份或身份。我被设计来回答各种问题和提供帮助,包括回答问题、提供建议、进行实验、提供信息等等。我被广泛应用于各种领域,例如自然语言处理、计算机视觉、人工智能等等。如果您需要更多的帮助或信息,请随时与我联系。我会尽我所能来帮助您的工作和生活。

[ft_512]: 我是一个大型语言模型,可以回答各种各样的问题,包括科学、历史、文化和技术方面的问题。您有什么需要我回答的问题吗?

[rl_512]: 我是一个计算机程序,没有具体的身世和人物。如果您可以告诉我您想知道的具体信息,我会尽力回答您的问题。

[Q]: 中国有哪些比较好的大学?

[ft_768]: 中国有很多著名的大学,其中包括北京大学、上海交通大学、复兴中医药学院、浙江大学等。这些大学在不同的领域都有着自己的标志性建筑和研究方向,值得一提的是,它们在中国的顶尖教育资源中享有很高的声誉。

[rl_768]: 中国的大学有很多,具体情况还要根据你的需求来决定。如果你需要更详细的信息,建议可以去咨询一下你所在城市的大学排名和政策法规,从而选择一个合适的大学。同时,你可以在网上查阅相关信息,或者去咨询一些大学相关机构,如中国人民大学、中国人民大学等,以获得更为详细和专业的指导和建议。

[ft_512]: 中国有很多优秀的大学,比如麻省理工学院、北京大学、上海大学等等。这些大学在中国教育事业的发展和成就都非常突出。

[rl_512]: 中国教育局、中国大学、中国大陆大学和中国大陆大学均有优秀的教育体裁,但各地教育水平和专业要求都可能存在差异。中国教育局的学历要求、教学方法、师资力量等因素都各具特点,而大学的学历要求也各有千秋。中国大陆大学生的学历要求也各有不同,需要根据自己的实际情况进行选择。如果您对中国大陆大学生的专业要求有更具体需求,建议您可以通过互联网、国内外的各类机构和机构进行比较和交流。同时,您也可以向身边的人或朋友、老师、家长等人士寻求帮助和建议。希望以上回答对您有帮助。

[Q]: 你知道光速是多少吗?

[ft_768]: 光速是一个物理常数,表示光在真空中传播的速度,大约是每秒299792458米。光速是物理学中最基本的物理常数之一,也是相对论的重要基础之一。

[rl_768]: 当然知道,光速是光在真空中传播的速度,通常用c来表示。它是宇宙物理学中非常重要的理论之一。在物理学中,光速被认为是宇宙中最重要的速度之一。它代表着光在真空中传播的速度,这也是许多重要公式和公式的基础。

[ft_512]: 光速是光在真空中传播的速度,约为每秒299,792,458米。它是几乎所有的物理学概念,也是宇宙中最神秘和最重要的物理概念之一。

[rl_512]: 光速是光在真空中传播的速度,是自然界中不可逆转的速度。光源是由光的原子、分子、固体和光的组成,其速度约为每秒平方。光的速度是每秒约1个英亞或光年,这个数字是根据相对论、量子力学和引力理论来计算的。光速是相对的概念之一,它代表着我们对自然界中任何事件的理解和解释。

Conseil

Le test suivant a été effectué le 17/09/2024. Les nouveaux modèles sortis après cette date ne seront pas inclus dans le test, sauf en cas de besoins particuliers. Testez le modèle mini-esprit basé sur un dialogue à un seul tour full_sft (sans réglage fin à plusieurs tours ni réglage fin de l'apprentissage par renforcement).

[A] minimind-v1-petit (0,02B)

[B] minimind-v1-moe (0,1B)

[C] mini-esprit-v1 (0.1B)

[D] bébé-llama2-chinois (0,2B)

[E] chatlm-mini-chinois (0,2B)

[Q]: 你知道长江吗?

[A]: 是的,长江是中国最长的河流,全长超过3300千米。

[B]: 长江是中国最长的河流,总长度约为6300公里。它发源于青藏高原的青海湖,流经青海、四川、甘肃、宁夏、内蒙古、陕西和山西。长江流域是中国最大的农业区之一,也是中国的文化和经济中心。

[C]: 是的,长江是中国最长的河流之一,也是世界第三大河流。长江发源于青藏高原,流经11个省份,最终注入东海。长江流域是中国最大的河流流域之一,拥有着丰富的自然资源和文化遗产,如长江大桥、长江海洋博物馆、长江古城等。

[D]: 同时也知道,中国是世界上最长的城市之一,拥有超过3400万人口。

[E]: 是的,长江是中国最长的河流,也是世界上最长的河流之一。它发源于青藏高原,流经九个省区,最终注入东海。长江流域的气候温和,四季分明,是中国重要的农业和工业基地。长江流域的水产资源丰富,是中国的重要渔业资源之一。

[Q]: 第一颗人造卫星是哪个国家发射的?

[A]: 第一颗人造卫星是斯普特尼克1号。

[B]: 第一颗人造卫星是俄罗斯的国际卫星,于1957年发射。

[C]: 第一颗人造卫星是苏联发射的,它是由苏联于1957年10月发射的。

[D]: 这颗名为“阿姆斯特朗”的卫星,于1961年11月20日发射,是第一个成功将人类送入太空的卫星。

[E]: 第一颗人造卫星是苏联于1957年4月4日发射的,它是由苏联宇航员尤里·加加林(Yuri Gagarin)和苏联工程师罗尔德·谢尔盖耶夫(Roald Skohley)共同发射的。在发射过程中,加加林和谢尔盖耶夫使用了一个名为“斯普特尼克1号”的小型卫星,它的直径为4.3米,重量为1,051公斤。这枚卫星被称为“斯普特尼克1号”,是苏联太空竞赛中的一个里程碑,也是人类历史上第一次在太空中进行太空行走。

[Q]: 你知道泰山在哪里吗?

[A]: 泰山位于中国东部地区,是中国五岳之一。

[B]: 泰山位于山东省泰安市泰安市。泰安市是中国五岳之一,也是世界文化遗产和中国历史文化名山之一。泰安市有许多著名的景点,如五岳之一、玉皇顶、南天门、玉皇阁等。

[C]: 泰山位于中国山东省泰安市,是中国五岳之一。

[D]: 作为一个人工智能助手,我无法访问互联网,因此无法提供关于你所在位置的信息。不过,你可以通过搜索或搜索相关关键词来获取有关你所在位置的信息,或者查看相关新闻或网站来获取有关你所在位置的信息。

[E]: 泰山位于中国山东省泰安市境内,是中国五岳之一,也是中国文化和历史的重要象征之一。它是中国五岳之一,也是中国道教和佛教的发源地之一。泰山的海拔高度为1,545米,是中国五岳之一,也是中国最著名的旅游景点之一。它的历史可以追溯到公元前5世纪,是中国古代帝王祭祀的场所。泰山也是中国文化的重要组成部分,被誉为“五岳之首”,是中国文化的重要遗产之一。

[Q]: 世界上最高的山峰是什么?

[A]: 世界上最高的山峰是珠穆朗玛峰,位于尼泊尔和中国的边境上,海拔8848米。

[B]: 世界上最高的山峰是珠穆朗玛峰,位于喜马拉雅山脉,海拔8,848米。

[C]: 珠穆朗玛峰是世界上最高的山峰,海拔8848米。

[D]: 世界上最高的山峰是珠穆朗玛峰,位于喜马拉雅山脉,海拔8,848.86米(29,031.69英尺)。

[E]: 世界上最高的山峰是珠穆朗玛峰,也称为萨加玛塔,位于喜马拉雅山脉的尼泊尔和中国边境之间,海拔8,848.86米(29,031.69英尺)。它是世界上最著名的登山目标之一,吸引着来自世界各地的登山者前来挑战。珠穆朗玛峰的名字来自藏语,意思是“女神的额峰”,它是由两个不同的山峰组成的,其中一个是位于尼泊尔的珠穆朗玛峰,另一个则位于中国。它的高度是通过测量海拔高度来确定的,因为它是通过测量地球的平均高度来确定的。尽管珠穆朗玛峰是世界上最高的山峰,但它并不是地球上任何其他地方都能到达的。地球上的其他地方,如南美洲的安第斯山脉,也是世界上最高的山脉,但它并不是地球上最高的山峰。总之,珠穆朗玛峰是世界上最高的山峰,但它并不是地球上任何地方都能到达的。它是地球上最高的山脉,但它并不是地球上任何地方都能到达的。

[Q]: 万有引力是谁提出的?

[A]: 万有引力是由英国物理学家牛顿提出的。他认为,所有物体都会产生引力,这个引力是由物体的质量和距离决定的。这个理论揭示了质量和距离之间的关系,并证明了万有引力的本质。

[B]: 万有引力是由牛顿在1687年提出的。它是宇宙中一个基本的物理现象,它描述了物体之间的相互作用。这个力被称为万有引力,它在所有物体之间都存在,这种力与物体的质量和距离有关。万有引力是自然界中最基本的力量之一,它不仅影响着物体的运动和变化,还对宇宙的结构和演化产生着重要的影响。

[C]: 万有引力是英国物理学家艾萨克·牛顿在17世纪提出的。

[D]: 引力是宇宙中一种力量,它是由质量或能量所组成的。根据牛顿的万有引力定律,一个物体之间的引力大小与它的质量成正比,与它的质量成反比。因此,牛顿的万有引力定律表明,一个物体之间的引力大小与它的质量成正比,与它的质量成反比。这个定律在物理学、天文学和物理学中都有广泛的应用。

[E]: 万有引力是由英国物理学家艾萨克·牛顿于1687年提出的。他在1687年发表了一篇著名的论文,题为《自然哲学的数学原理》,其中提出了万有引力定律,指出任何两个物体之间都存在着一种引力,这种引力的大小与它们的质量成正比,与它们之间的距离的平方成反比。这个定律被称为万有引力定律,它描述了质量和距离之间的关系。它表明,两个物体之间的引力与它们的质量成正比,与它们之间的距离的平方成反比。这个定律对于解释宇宙中的许多现象和现象之间的相互作用非常重要,例如行星绕太阳运动、恒星之间的引力透镜效应等等。它也被广泛应用于天文学、物理学和工程学等领域,为我们理解宇宙的本质和演化提供了重要的理论基础。

[Q]: 你知道大熊猫的主要食物是什么吗?

[A]: 大熊猫的主要食物是竹子。它们通常吃竹子,每天需要吃掉大约30公斤的竹子。

[B]: 是的,大熊猫主要以竹子为食。它们每天需要吃掉大量的竹子来维持生命,每天需要吃掉40至80公斤的竹子。此外,它们也会吃一些其他的植物,如草、果实、坚果和小型哺乳动物。

[C]: 大熊猫主要以竹子为食,也会偶尔食用其他的植物和动物。此外,大熊猫也会吃一些野果、小动物和植物,但这些都不属于它们的主要食物来源。

[D]: 大熊猫的主要食物是竹子。

[E]: 大熊猫是一种以竹子为主要食物的植食动物,它们的肠道结构适合消化纤维素含量高的竹子,但也会吃一些其他植物,如草本植物和小型哺乳动物。大熊猫的肠道结构也适应了高纤维的竹子,这使得它们能够消化大量的纤维素,从而帮助它们在野外生存。大熊猫的肠道中还含有一种叫做“纤维素酶”的酶类物质,这种酶能够帮助大熊猫分解纤维素,从而帮助它们消化大量的水分和营养物质。此外,大熊猫的肠道还含有一种叫做“纤维素蛋白”的蛋白质,这种蛋白质能够帮助大熊猫维持体内的能量水平,从而帮助它们在野外生存。总的来说,大熊猫的主要食物是竹子,但它们也会吃一些其他植物,如草本植物和小型哺乳动物。

[Q]: 海水为什么是咸的?

[A]: 海水中含有许多盐分,这些盐分可以导致海水咸度的增加。海水中的盐分主要来自于海水中的盐分,这些盐分可以从海水中的盐分中获得。海水中的氧化物和盐分可以与海水中的盐分形成氢键,从而使海水咸度增加。

[B]: 海水是咸的,这是因为它含有大量的盐分,其中包括氯离子和氯离子。这些离子在海洋中形成了大量的盐,这些盐分被称为盐分。海水中含有许多溶解在水中的盐,这些盐分会随着海水的升高而逐渐蒸发,最终导致海水中盐分的蒸发。这些盐分在海水中被完全消耗,然后被排除在海水中。此外,海水中还含有许多其他的盐分,但这些盐分是不同的,因为它们在水中的浮起和下降过程是不同的。海水中的盐分是从海底的岩石中提取出来的,这些盐分在海水中可以被利用。总的来说,海水是咸的,这也是为什么海水中含有许多盐分和盐分的原因。

[C]: 海水含有许多溶解的盐类,其中最主要的是氯化钠。当水中加入盐时,盐的分子会与水分子发生反应,形成氢氧化钠,这是一种盐。

[D]: 因为水是许多生物的生存所必需的,它能够吸收和释放二氧化碳,释放氧气,维持大气中的水蒸气,以及维持水循环。水中的盐类和化学物质会释放出氧气,使地球上的生物呼吸。此外,水还具有许多其他功能,如保持水循环、维持水循环、调节气候和环境等。水是许多生物生存所必需的,它也是许多自然现象的重要基础。

[E]: 海水是咸的主要原因是因为其中含有大量的溶解盐类,其中最主要的是氯化钠(NaCl)。氯化钠是一种非常常见的盐类,它存在于地球上的大部分地区,包括海洋、湖泊、河流和地下水。当水从海洋中蒸发时,它会带走一部分盐分,使海水变得咸。此外,海中还含有其他溶解盐类的物质,如硫酸盐、硫酸镁、硫酸钙、硫酸镁盐、硫酸镁钾、硫酸镁钠、硫酸镁钙、硫酸镁镁钙、硫酸镁镁钙、硫酸镁镁钙、硫酸镁镁钠、硫酸镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁钙、硫酸镁镁镁镁镁镁镁钙、硫酸镁镁镁镁

Note

?♂️ Lancez directement la réponse du modèle ci-dessus à GPT-4o et laissez-la aider à marquer :

Modèle A :

Modèle B :

Modèle C :

Modèle D :

Modèle E :

| Modèle | C | E | B | UN | D |

|---|---|---|---|---|---|

| Fraction | 75 | 70 | 65 | 60 | 50 |

Le tri de la série minimind (ABC) est conforme à l'intuition, et minimind-v1 (0,1B) a le score le plus élevé. Les réponses aux questions de bon sens sont fondamentalement exemptes d'erreurs et d'illusions.

epochs de tours SFT de minimind-v1 (0,1B) est inférieur à 2. Je suis trop paresseux pour tuer à l'avance pour libérer des ressources, car le petit modèle 0,1B atteint toujours les performances les plus élevées même s'il n'a pas été entièrement atteint. entraîné En fait, il est toujours un niveau plus élevé que le précédent mort.La réponse du modèle E semble très bonne à l'œil nu, bien qu'il y ait quelques hallucinations et fabrications. Cependant, les évaluations de GPT-4o et de Deepseek ont convenu qu’il contenait « des informations trop longues, un contenu répété et des illusions ». En fait, ce genre d'évaluation est un peu strict. Même si 10 mots sur 100 sont des hallucinations, on lui attribuera facilement une note faible. Étant donné que la longueur du texte de pré-formation du modèle E est plus longue et que l'ensemble de données est beaucoup plus grand, les réponses semblent complètes. Dans le cas de l’approximation du volume, la quantité et la qualité des données sont importantes.

?♂️Évaluation subjective personnelle : E>C>B≈A>D

? Cote GPT-4o : C>E>B>A>D

Loi de mise à l'échelle : plus les paramètres du modèle sont grands et plus il y a de données d'entraînement, plus les performances du modèle sont fortes.

Voir le code d'évaluation C-Eval : ./eval_ceval.py . Afin d'éviter la difficulté de fixer le format de réponse, l'évaluation des petits modèles détermine généralement directement la probabilité de prédiction du jeton correspondant aux quatre lettres A , B , C , et D , et prend la plus grande réponse. Répondez à la réponse et calculez le taux de précision avec la réponse standard. Le modèle mini-mental lui-même n'a pas utilisé un ensemble de données plus important pour la formation, ni affiné les instructions pour répondre aux questions à choix multiples. Les résultats de l'évaluation peuvent être utilisés comme référence.

Par exemple, les détails du résultat de minimind-small :

| Taper | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 | 17 | 18 | 19 | 20 | vingt-et-un | vingt-deux | vingt-trois | vingt-quatre | 25 | 26 | 27 | 28 | 29 | 30 | 31 | 32 | 33 | 34 | 35 | 36 | 37 | 38 | 39 | 40 | 41 | 42 | 43 | 44 | 45 | 46 | 47 | 48 | 49 | 50 | 51 | 52 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Données | probabilité_et_statistiques | loi | middle_school_biologie | lycée_chimie | lycée_physique | juridique_professionnel | lycée_chinois | histoire_du_lycée | comptable_taxe | histoire_chinoise_moderne | collège_école_physique | histoire_de_l'école_du_milieu | médecine_de base | système opérateur | logique | ingénieur_électrique | civil_servant | langue_et_littérature_chinoise | programmation_universitaire | comptable | protection_des_plantes | middle_school_chemistry | ingénieur_métrologie | médecine_vétérinaire | marxisme | mathématiques_avancées | lycée_mathématiques | administration des affaires | mao_zedong_thought | culture_idéologique_et_morale | collège_économie | guide_tour_professionnel | environnemental_impact_assessment_engineer | architecture_informatique | planificateur_urbain_et_rural | collège_physique | middle_school_mathématiques | high_school_politique | médecin | collège_chimie | lycée_biologie | lycée_geographie | middle_school_politique | médecine_clinique | réseau_ordinateur | sport_science | études_art | qualification_enseignant | mathématiques_discrètes | éducation_science | ingénieur_pompier | middle_school_geographie |

| Taper | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 | 17 | 18 | 19 | 20 | vingt-et-un | vingt-deux | vingt-trois | vingt-quatre | 25 | 26 | 27 | 28 | 29 | 30 | 31 | 32 | 33 | 34 | 35 | 36 | 37 | 38 | 39 | 40 | 41 | 42 | 43 | 44 | 45 | 46 | 47 | 48 | 49 | 50 | 51 | 52 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| T/A | 3/18 | 24/05 | 21/04 | 7/19 | 5/19 | 2/23 | 19/04 | 6/20 | 10/49 | 4/23 | 19/04 | 4/22 | 1/19 | 19/03 | 4/22 | 7/37 | 11/47 | 5/23 | 10/37 | 9/49 | 22/07 | 4/20 | 3/24 | 23/06 | 5/19 | 5/19 | 18/04 | 8/33 | 24/8 | 5/19 | 17/55 | 29/10 | 31/07 | 21/06 | 11/46 | 5/19 | 19/03 | 19/04 | 13/49 | 3/24 | 5/19 | 19/04 | 21/06 | 22/06 | 19/02 | 19/02 | 14/33 | 12/44 | 16/06 | 7/29 | 31/09 | 1/12 |

| Précision | 16,67% | 20,83% | 19,05% | 36,84% | 26,32% | 8,70% | 21,05% | 30,00% | 20,41% | 17,39% | 21,05% | 18,18% | 5,26% | 15,79% | 18,18% | 18,92% | 23,40% | 21,74% | 27,03% | 18,37% | 31,82% | 20,00% | 12,50% | 26,09% | 26,32% | 26,32% | 22,22% | 24,24% | 33,33% | 26,32% | 30,91% | 34,48% | 22,58% | 28,57% | 23,91% | 26,32% | 15,79% | 21,05% | 26,53% | 12,50% | 26,32% | 21,05% | 28,57% | 27,27% | 10,53% | 10,53% | 42,42% | 27,27% | 37,50% | 24,14% | 29,03% | 8,33% |

总题数: 1346

总正确数: 316

总正确率: 23.48%

| catégorie | correct | question_count | précision |

|---|---|---|---|

| minimind-v1-petit | 344 | 1346 | 25,56% |

| minimind-v1 | 351 | 1346 | 26,08% |

### 模型擅长的领域:

1. 高中的化学:正确率为42.11%,是最高的一个领域。说明模型在这方面的知识可能较为扎实。

2. 离散数学:正确率为37.50%,属于数学相关领域,表现较好。

3. 教育科学:正确率为37.93%,说明模型在教育相关问题上的表现也不错。

4. 基础医学:正确率为36.84%,在医学基础知识方面表现也比较好。

5. 操作系统:正确率为36.84%,说明模型在计算机操作系统方面的表现较为可靠。

### 模型不擅长的领域:

1. 法律相关:如法律专业(8.70%)和税务会计(20.41%),表现相对较差。

2. 中学和大学的物理:如中学物理(26.32%)和大学物理(21.05%),模型在物理相关的领域表现不佳。

3. 高中的政治、地理:如高中政治(15.79%)和高中地理(21.05%),模型在这些领域的正确率较低。

4. 计算机网络与体系结构:如计算机网络(21.05%)和计算机体系结构(9.52%),在这些计算机专业课程上的表现也不够好。

5. 环境影响评估工程师:正确率仅为12.90%,在环境科学领域的表现也不理想。

### 总结:

- 擅长领域:化学、数学(特别是离散数学)、教育科学、基础医学、计算机操作系统。

- 不擅长领域:法律、物理、政治、地理、计算机网络与体系结构、环境科学。

这表明模型在涉及逻辑推理、基础科学和一些工程技术领域的问题上表现较好,但在人文社科、环境科学以及某些特定专业领域(如法律和税务)上表现较弱。如果要提高模型的性能,可能需要加强它在人文社科、物理、法律、以及环境科学等方面的训练。

./export_model.py peut exporter le modèle au format Transformers et le pousser vers Huggingface

Adresse de la collection huggingface de MiniMind : MiniMind

my_openai_api.py complète l'interface de chat d'openai_api, facilitant la connexion de vos propres modèles à des interfaces utilisateur tierces telles que fastgpt, OpenWebUI, etc.

Téléchargez le fichier de poids du modèle depuis Huggingface

minimind (root dir)

├─minimind

| ├── config.json

| ├── generation_config.json

| ├── LMConfig.py

| ├── model.py

| ├── pytorch_model.bin

| ├── special_tokens_map.json

| ├── tokenizer_config.json

| ├── tokenizer.json

Démarrez le serveur de discussion

python my_openai_api.pyInterface du service de test

python chat_openai_api.pyExemple d'interface API, compatible avec le format openai api

curl http://ip:port/v1/chat/completions

-H " Content-Type: application/json "

-d ' {

"model": "model-identifier",

"messages": [

{ "role": "user", "content": "世界上最高的山是什么?" }

],

"temperature": 0.7,

"max_tokens": -1,

"stream": true

} '

Conseil

Si vous pensez que MiniMind vous est utile, vous pouvez ajouter un article sur GitHub. La longueur n'est pas courte et le niveau est limité. Vous êtes invités à échanger des corrections dans les problèmes ou à soumettre des projets d'amélioration des relations publiques. le moteur de l’amélioration continue du projet.

Note

Tout le monde ajoute de l'huile sur les flammes. Si vous avez essayé de former un nouveau modèle MiniMind, vous êtes invités à partager les poids de votre modèle dans les discussions ou les problèmes. Cela peut concerner des tâches spécifiques en aval ou des domaines verticaux (tels que la reconnaissance des émotions, le médical, le psychologique). , questions et réponses financières, juridiques, etc. ) MiniMind nouvelle version du modèle Il peut également s'agir d'une nouvelle version du modèle MiniMind après une formation prolongée (telle que l'exploration de séquences de texte plus longues, de volumes plus importants (0,1 B+) ou d'ensembles de données plus importants). Tout partage est considéré comme unique, et toutes les tentatives sont précieuses et encouragées. être découvert à temps et organisé dans la liste de remerciements. Merci encore pour tout votre soutien !

@ipfgao : ?Enregistrement des étapes de formation

@chuanzhubin : ? Coder les commentaires ligne par ligne

@WangRongsheng : ?Prétraitement de grands ensembles de données

@pengqianhan : ?Un tutoriel concis

@RyanSunn : ? Dossier d'apprentissage du processus de raisonnement

Ce référentiel est sous licence sous la licence Apache-2.0.